Annuncio dell'anteprima pubblica di Lakeflow Designer

Un'esperienza no-code, AI-native e completamente governata per la preparazione dei dati su Databricks

di Jason Messer, Emanuel Zgraggen, V Maharajh, Matt Jones e Tracy Yang

- Lakeflow Designer è ora in anteprima pubblica, offrendo agli utenti Databricks un modo visivo, no-code e AI-native per preparare e analizzare i dati.

- Costruito direttamente su Databricks e governato da Unity Catalog, Lakeflow Designer mantiene i dati in loco fornendo lineage, permessi e codice pronto per la produzione fin dal primo giorno.

- Lakeflow Designer aiuta a rendere le trasformazioni generate dall'IA più facili da rivedere e affidabili, suddividendo il lavoro in operatori visivi con anteprime passo-passo di come cambiano i dati.

Abbiamo introdotto per la prima volta Lakeflow Designer alla Data and AI Summit lo scorso anno. Da allora, abbiamo lavorato a stretto contatto con i primi clienti per perfezionare il prodotto e comprendere meglio dove sia più utile. Oggi, siamo entusiasti di annunciare l'Anteprima Pubblica di Lakeflow Designer. Lakeflow Designer rimuove uno dei maggiori ostacoli nei dati di oggi: la barriera tecnica all'ingresso.

Cos'è Lakeflow Designer?

Lakeflow Designer è un'esperienza visiva, no-code, AI-native per la preparazione e l'analisi dei dati. Costruito direttamente in Databricks, consente ad analisti, esperti di dominio e altri utenti meno tecnici di preparare ed esplorare i dati attraverso una tela drag-and-drop e il linguaggio naturale.

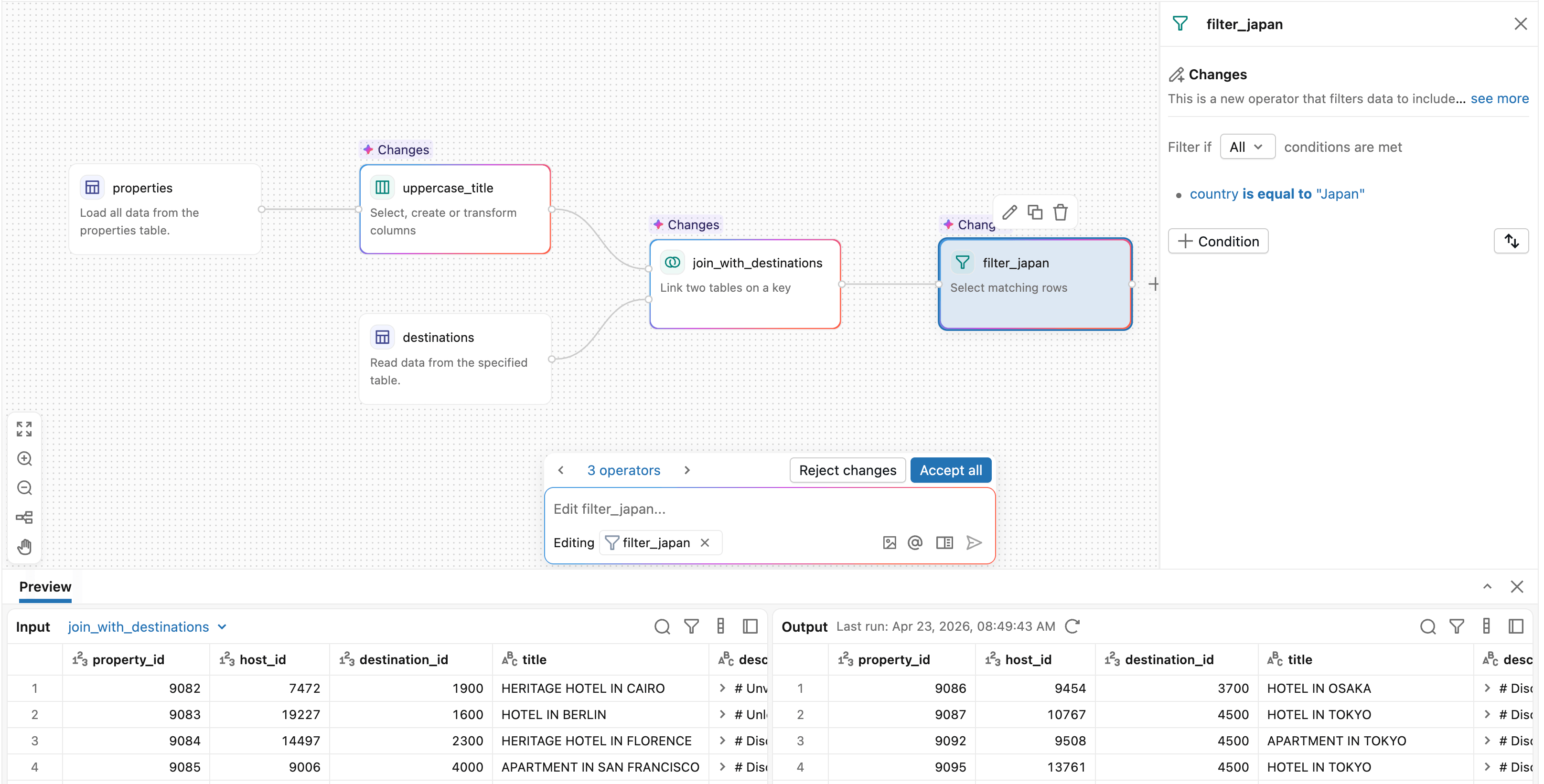

Ogni passaggio in Lakeflow Designer è rappresentato come un operatore, dando agli utenti un quadro chiaro di come i dati cambiano durante il flusso di lavoro. Questo rende più facile costruire, validare e comprendere le trasformazioni man mano che procedi.

Lakeflow Designer estende la potenza di Databricks Lakeflow a un set più ampio di utenti, consentendo la preparazione dei dati no-code pur generando codice pronto per la produzione sotto il cofano. I flussi di lavoro possono essere pianificati e operazionalizzati tramite Lakeflow Jobs, rendendo facile passare dalla preparazione interattiva dei dati alle pipeline di produzione.

Lakeflow Designer espande l'autonomia dei team aziendali, consentendo la creazione efficiente di viste dati tramite linguaggio naturale e best practice, garantendo al contempo coerenza, governance e affidabilità dei dati. — Phelipe Naman, Data & Analytics Architecture Tech Lead, Sabesp

Cosa rende diverso Lakeflow Designer?

L'auto-preparazione dei dati non è un'idea nuova, ma gli strumenti esistenti si trovano al di fuori della tua piattaforma dati centrale. Questo comporta dei compromessi:

- La disconnessione tra lo strumento di preparazione dei dati e la piattaforma dati crea lacune di governance e costi IT aggiuntivi

- L'IA è aggiunta e i suggerimenti sono generici perché lo strumento non ha una reale comprensione dei dati

- I flussi di lavoro visivi sono difficili da mettere in produzione, con la logica spesso intrappolata in linguaggi specifici del dominio o nell'interfaccia utente

- La licenza per utente è costosa e limita chi ha accesso

Lakeflow Designer adotta un approccio diverso.

1. Costruito nativamente su Databricks per governance e semplicità

Lakeflow Designer viene eseguito direttamente dove i tuoi dati vivono già: su Databricks. Non è necessario spostare i dati in uno strumento separato o sulla tua macchina locale. I dati rimangono in loco, governati da Unity Catalog fin dall'inizio, semplificando lo stack dati complessivo. Invece di gestire uno strumento low-code separato con il proprio modello di licenza, permessi e amministrazione, le organizzazioni possono abilitare il self-service direttamente all'interno di Databricks.

KPMG UK fornisce servizi di audit e assurance a migliaia di aziende, ognuna con un panorama dati diverso. Dotare i nostri professionisti di Lakeflow Designer consente un flusso di lavoro visivo, low-code e assistito dall'IA che scala e democratizza la nostra capacità di tradurre set di dati complessi e vari in insight significativi. — Mark Wallington, Audit Data and AI Partner, KPMG UK

Inizia subito a lavorare con i dati sorgente nativi

2. Costruito da zero per l'IA, e progettato per rendere l'IA verificabile

Lakeflow Designer è costruito su Genie Code, l'assistente di codifica agentivo nativo di Databricks. L'IA non è un'aggiunta qui. È al centro del funzionamento del prodotto. Descrivi semplicemente ciò che desideri in linguaggio naturale e Genie Code può generare o modificare il flusso di lavoro direttamente.

Autoring AI-native che funziona e basta

Poiché Lakeflow Designer è integrato direttamente nell'area di lavoro Databricks, Genie Code può ragionare su più delle semplici nomi delle colonne. Può utilizzare metadati di Unity Catalog, descrizioni di tabelle, lineage, popolarità ed esempi di query per comprendere il significato semantico dei dati e identificare gli asset giusti per un'attività. Ciò porta a suggerimenti più consapevoli del contesto e accurati rispetto agli strumenti che vedono solo lo schema.

Questa architettura apre anche la porta a un comportamento più agentivo. Invece di generare un risultato statico una volta, il sistema può eseguire una trasformazione, ispezionare l'output e iterare quando necessario. Ad esempio, se un join fallisce o non restituisce righe, Genie Code può valutare il risultato e provare un approccio alternativo.

Forse altrettanto importante, Lakeflow Designer rende le trasformazioni generate dall'IA facili da comprendere e validare suddividendole in operatori visivi discreti con anteprime dei dati ad ogni passaggio. Puoi vedere esattamente cosa è cambiato, dove sono state filtrate le righe, come è stato risolto un join e quale aspetto ha l'output prima di procedere.

Lakeflow Designer è un abilitatore chiave per scalare l'ingegneria dei dati oltre il team tecnico principale su Databricks. Fornendo un'interfaccia visiva integrata con capacità di linguaggio naturale, aiuta a ridurre il "collo di bottiglia SQL", consentendo ai team aziendali di prototipare e iterare sulle pipeline con maggiore autonomia. Questo va oltre la facilità d'uso, si tratta di allineamento organizzativo. Quando le trasformazioni sono visive e accessibili, il divario tra l'intento aziendale e l'esecuzione tecnica si riduce, accelerando il percorso dai dati grezzi agli insight azionabili. — Matheus Polycaropo, Data Engineering Leader, Serasa Experian

3. Ogni trasformazione visiva genera codice reale, pronto per la produzione

Ogni trasformazione in Lakeflow Designer genera codice Python pronto per la produzione sotto il cofano. Quel codice può essere rivisto, versionato in Git e integrato direttamente in flussi di lavoro di produzione più ampi. Nel tempo, Designer supporterà anche output di produzione più nativi, come le viste materializzate. Ciò riduce in definitiva uno dei maggiori costi degli strumenti self-service: il passaggio del lavoro all'ingegneria per ricostruirlo per la produzione. Invece di rifare il lavoro in un altro sistema, i team dati centrali possono costruire su ciò che gli utenti hanno già creato.

4. Nessuna licenza per utente

Una delle maggiori barriere all'adozione che abbiamo riscontrato negli strumenti low-code tradizionali è il prezzo. Le licenze basate su postazione costringono i team a decidere in anticipo quali utenti meritano l'accesso, rallentando l'adozione e limitando il self-service prima ancora che inizi.

Con Lakeflow Designer, non esiste un modello di licenza per utente. Paghi solo per il calcolo che utilizzi. Tutti nell'azienda possono partecipare al lavoro sui dati senza creare un nuovo collo di bottiglia di approvvigionamento.

Come i team utilizzano Lakeflow Designer

Stiamo già vedendo centinaia di team in vari settori utilizzare Lakeflow Designer per preparare e lavorare con i dati in modi che in precedenza erano difficili da scalare senza supporto ingegneristico.

Ad esempio:

- I team di consulenza e servizi professionali utilizzano Lakeflow Designer per pulire i dati dei clienti da fogli di calcolo, PDF e file condivisi, quindi applicano flussi di lavoro di audit o analisi ripetibili per produrre report.

- Le organizzazioni di servizi finanziari utilizzano Lakeflow Designer per la preparazione dei dati self-service, la reportistica normativa e l'analisi del rischio.

- I team aziendali di marketing, operazioni e logistica lo utilizzano per combinare dati da più origini, rispondere a domande operative e preparare dati per dashboard.

Stiamo anche vedendo Lakeflow Designer svolgere un ruolo importante nell'intera piattaforma Databricks. I team lo utilizzano per preparare i dati che fluiscono in Metric Views e dashboard AI/BI, creando un ciclo self-service completo. Gli analisti possono passare da tabelle grezze a dashboard curate senza scrivere codice.

Con l'adozione di Lakeflow Designer, abbiamo semplificato la costruzione di pipeline dati ed elevato la qualità delle analisi attraverso lo sviluppo low-code e le capacità AI potenziate dal linguaggio naturale. I team non tecnici hanno iniziato a creare complessi processi analitici in modo autonomo, generando valore aziendale reale e accelerando il processo decisionale. Inoltre, la piattaforma ci ha permesso di scalare una cultura data-driven in tutta l'azienda, espandendo la portata dell'analisi avanzata a più aree e democratizzando l'accesso all'intelligenza dei dati in tutta l'organizzazione. — Carlos Gumz, Data Lead, Hering

Iniziare

Designer è attualmente disponibile in tutti gli spazi di lavoro. Per iniziare, fai clic sul pulsante + Nuovo nell'angolo in alto a sinistra dello spazio di lavoro e seleziona Visual data prep. Se non vedi l'opzione Visual data prep, Designer potrebbe dover essere abilitato da un amministratore nel portale di anteprima.

Ecco alcuni altri passaggi che puoi intraprendere con Lakeflow Designer:

- Guarda un video dimostrativo di 8 minuti di Lakeflow Designer

- Consulta la pagina di documentazione per risorse più dettagliate sull'avvio di Lakeflow Designer.

- Il feedback dei clienti continua a plasmare il prodotto e a svolgere un ruolo chiave nella nostra roadmap. Se hai commenti o domande, saremmo lieti di riceverli all'indirizzo [email protected].

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.