Annuncio degli endpoint ottimizzati per lo storage per la ricerca vettoriale

Scala di miliardi di vettori, costi 7 volte inferiori

- Introduzione della ricerca vettoriale ottimizzata per lo storage: scala di miliardi di vettori, costi fino a 7 volte inferiori, indicizzazione 20 volte più veloce, filtri familiari simili a SQL.

- Sblocca più valore dai dati non strutturati per l'IA: crea sistemi RAG, di risoluzione delle entità e di ricerca semantica ad alte prestazioni su documenti, immagini e altro.

- Pronto per l'azienda e facile da adottare: supportato dalla governance di Unity Catalog e integrato con strumenti come AI Playground per la prototipazione rapida di RAG e policy di budget per la gestione dei costi.

La maggior parte delle aziende dispone di un'enorme quantità di dati non strutturati: documenti, immagini, audio, video, eppure solo una frazione si trasforma in insight azionabili. Le app basate sull'IA come la generazione aumentata dal recupero (RAG), la risoluzione delle entità, i motori di raccomandazione e la ricerca consapevole dell'intento possono cambiare la situazione, ma si scontrano rapidamente con barriere familiari: limiti di capacità difficili, costi in aumento e indicizzazione lenta.

Oggi annunciamo l'anteprima pubblica degli endpoint ottimizzati per lo storage per Databricks AI Search, il nostro nuovo motore di ricerca vettoriale, creato appositamente per dati su scala petabyte. Disaccoppiando lo storage dal calcolo e sfruttando la massiccia scalabilità e parallelismo di Spark all'interno della Databricks Data Intelligence Platform, offre:

- Capacità di miliardi di vettori

- Costi fino a 7 volte inferiori

- Indicizzazione 20 volte più veloce

- Filtri in stile SQL

Soprattutto, è un vero sostituto diretto delle API che i vostri team già utilizzano, ora potenziato per RAG, ricerca semantica e risoluzione delle entità in produzione reale. Inoltre, per supportare ulteriormente i team aziendali, introduciamo nuove funzionalità progettate per semplificare lo sviluppo e migliorare la visibilità dei costi.

Novità nella ricerca vettoriale ottimizzata per lo storage

Gli endpoint ottimizzati per lo storage sono stati creati in risposta diretta a ciò che i team aziendali ci hanno detto di aver bisogno di più: la capacità di indicizzare e cercare in interi data lake non strutturati, un'infrastruttura che scala senza costi esorbitanti e cicli di sviluppo più rapidi.

Scala di miliardi di vettori, costi 7 volte inferiori

La scala non è più un limite. Mentre la nostra offerta Standard supportava centinaia di milioni di vettori, quella ottimizzata per lo storage è costruita per miliardi di vettori a un costo ragionevole, consentendo alle organizzazioni di eseguire carichi di lavoro completi sul data lake senza dover campionare o filtrare. I clienti che eseguono carichi di lavoro di grandi dimensioni stanno riscontrando costi infrastrutturali fino a 7 volte inferiori, rendendo finalmente fattibile l'esecuzione di GenAI in produzione su enormi set di dati non strutturati.

A titolo di confronto, il prezzo ottimizzato per lo storage sarebbe di circa 900 $/mese per 45 milioni di vettori e circa 7.000 $/mese per 1,3 miliardi di vettori. Quest'ultimo rappresenta un risparmio significativo rispetto ai circa 47.000 $/mese della nostra offerta standard.

Indicizzazione fino a 20 volte più veloce

Sblocca cicli di iterazione rapidi che prima erano impossibili. La nostra riarchitettura alimenta uno dei miglioramenti più richiesti: un'indicizzazione drasticamente più veloce. Ora puoi creare un indice da 1 miliardo di vettori in meno di 8 ore, e indici più piccoli di 100 milioni di vettori o meno vengono creati in pochi minuti.

“Il miglioramento della velocità di indicizzazione con la versione ottimizzata per lo storage è enorme per noi. Quello che prima richiedeva circa 7 ore, ora richiede solo un'ora, un miglioramento di 7-8 volte.” — Ritabrata Moitra, Sr. Lead ML Engineer, CommercelIQ

Filtri simili a SQL

Filtra facilmente i record senza dover imparare sintassi non familiari. Oltre alle prestazioni e alla scalabilità, ci siamo concentrati anche sull'usabilità. Il filtraggio dei metadati viene ora eseguito utilizzando una sintassi intuitiva in stile SQL, rendendo semplice restringere i risultati della ricerca utilizzando criteri che già conosci.

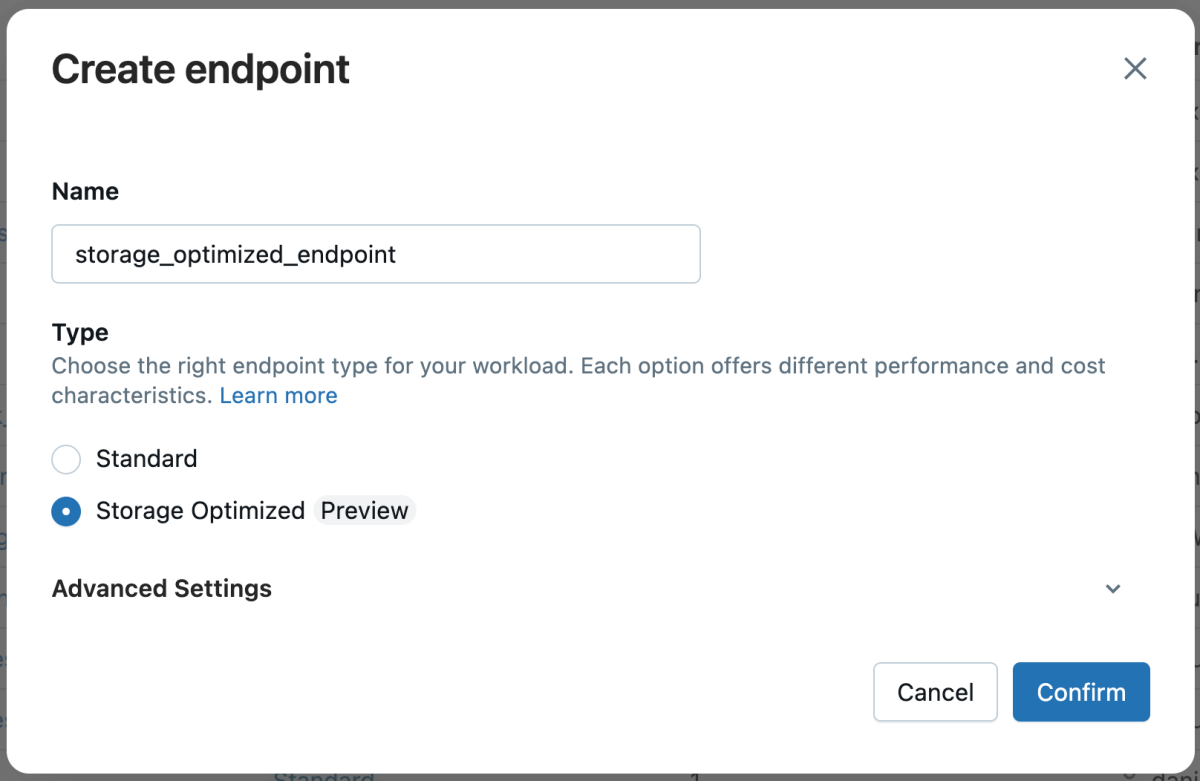

Stesse API, Backend completamente nuovo

La migrazione agli endpoint ottimizzati per lo storage è semplice: selezionalo quando crei un nuovo endpoint e crea un nuovo indice sulla tua tabella. L'API di ricerca di similarità rimane la stessa, quindi non sono necessarie modifiche sostanziali al codice.

“Consideriamo la ricerca vettoriale ottimizzata per lo storage essenzialmente un sostituto diretto dell'offerta standard. Sblocca la scala di cui abbiamo bisogno per supportare centinaia di investitori interni che interrogano decine di milioni di documenti al giorno, senza compromettere latenza o qualità.” — Alexandre Poulain, Director, Data Science & AI Team, PSP Investments

Poiché questa funzionalità fa parte della piattaforma Databricks, viene fornita con la piena governance basata su Unity Catalog. Ciò significa controlli di accesso appropriati, audit trail e tracciamento della lineage su tutti i tuoi asset di ricerca vettoriale, garantendo la conformità con le politiche aziendali di dati e sicurezza fin dal primo giorno.

Funzionalità avanzate per semplificare il tuo flusso di lavoro

Per supportare ulteriormente i team aziendali, introduciamo nuove funzionalità che rendono più facile sperimentare, distribuire e gestire carichi di lavoro di ricerca vettoriale su larga scala.

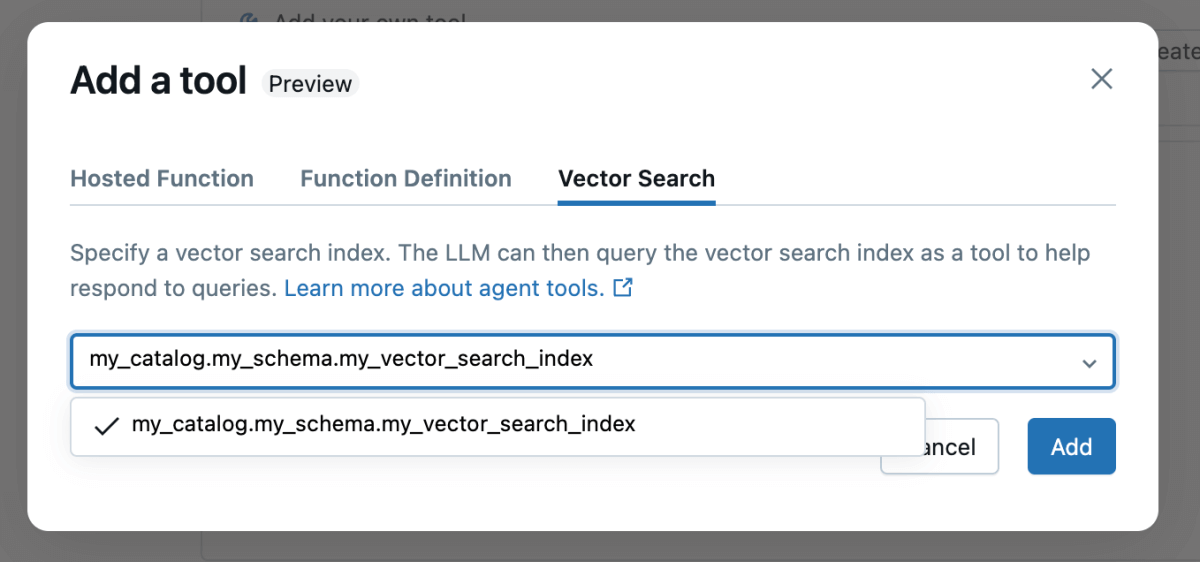

I team possono ora testare e distribuire un agente di chat basato su un indice di ricerca vettoriale come knowledge base in due clic, un processo che prima richiedeva un codice personalizzato significativo. Con l'integrazione diretta nell'Agent Playground ora in anteprima pubblica, seleziona il tuo indice di ricerca vettoriale come strumento, testa il tuo agente RAG ed esporta, distribuisci e valuta gli agenti senza scrivere una sola riga di codice. Ciò riduce drasticamente il percorso dal prototipo alla produzione.

La nostra migliore visibilità dei costi con il tagging delle policy di budget dell'endpoint consente ai proprietari della piattaforma e ai team FinOps di monitorare e comprendere facilmente la spesa tra più team e casi d'uso, allocare budget e gestire i costi all'aumentare dell'utilizzo. Ulteriori supporti per il tagging di indici e risorse di calcolo arriveranno presto.

Questo è solo l'inizio

Il rilascio degli endpoint ottimizzati per lo storage è una pietra miliare importante, ma stiamo già lavorando a futuri miglioramenti:

- Scale-to-Zero: Scala automaticamente le risorse di calcolo quando non vengono utilizzate per ridurre ulteriormente i costi

- Supporto High QPS: Infrastruttura per gestire migliaia di query al secondo per applicazioni in tempo reale esigenti

- Oltre la ricerca semantica: Efficienti capacità di recupero non semantico per carichi di lavoro solo keyword.

Il nostro obiettivo è semplice: costruire la migliore tecnologia di ricerca vettoriale disponibile, completamente integrata con la Databricks Data Intelligence Platform su cui fai già affidamento.

Inizia a costruire oggi

Gli endpoint ottimizzati per lo storage trasformano il modo in cui lavori con dati non strutturati su larga scala. Con capacità massiccia, economie migliori, indicizzazione più veloce e filtri familiari, puoi creare con sicurezza applicazioni AI più potenti.

Pronto per iniziare?

- Prova Databricks AI Search gratuitamente: la configurazione rapida ti offre accesso immediato e crediti serverless gratuiti.

- Dai un'occhiata alla nostra documentazione per vedere come si fa!

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.