All'interno di una delle prime implementazioni di produzione di Lakebase: il motore di governance del flusso di lavoro agentivo di LangGuard

I flussi di lavoro agentici aziendali comprendono decine di agenti, centinaia di strumenti e oltre 15 sistemi di registrazione. Controllarli e gestirli in tempo reale richiede un'infrastruttura che non esisteva fino a Lakebase.

di Venkat Raghavan, Jason Keirstead, Ravi Srinivasan, Nina Williams e Amelia Westberg

- Meno del 10% delle imprese ha implementato con successo agenti AI autonomi su larga scala, principalmente perché gli agenti aggirano i tradizionali controlli di sicurezza generando la propria logica in fase di esecuzione, creando un vuoto di governance invisibile.

- Databricks fornisce governance unificata per dati, modelli e policy di accesso tramite Unity Catalog e AI Gateway. LangGuard estende questi controlli a livello di piattaforma con un livello di enforcement in fase di esecuzione per i flussi di lavoro agentici, monitorando e applicando le policy sull'intera catena di azioni, decisioni, strumenti e credenziali. Utilizza un data fabric GRAIL™ in attesa di brevetto che cattura ogni azione dell'agente in un knowledge graph live e valuta ogni decisione di policy in tempo reale, senza impattare le prestazioni dell'agente.

- Databricks Lakebase, il primo database Postgres completamente gestito e serverless del settore costruito sul lakehouse, rende possibile tutto ciò, fornendo compute elastico scale-to-zero, esecuzione di query a bassa latenza per dati operativi "hot" e branching istantaneo del database per testare in sicurezza le policy di governance.

Il problema invisibile dell'IA agentiva

La maggior parte delle aziende sta sperimentando con agenti AI autonomi. Pochissime li stanno distribuendo in modo sicuro su larga scala. Secondo il sondaggio "The State of AI in 2025" di McKinsey (novembre 2025), in nessuna funzione aziendale più del dieci percento delle aziende ha scalato agenti AI in produzione. Il fallimento raramente è una mancanza di ambizione; è una mancanza di visibilità.

A differenza del software tradizionale, gli agenti autonomi generano la propria logica al volo. Aggirano i monitor di sicurezza convenzionali, invocano strumenti e accedono ai dati in modi difficili da verificare a posteriori, e operano attraverso complessi flussi di lavoro multi-agente in cui una singola autorizzazione mal configurata o una lacuna nelle policy può trasformarsi in un incidente di sicurezza significativo. Ciò di cui le aziende hanno bisogno è una nuova categoria di infrastruttura di controllo: una che operi nel momento in cui una decisione viene presa, non dopo che il danno è fatto.

Questo è il problema che LangGuard è stato creato per risolvere.

L'applicazione in tempo reale incontra la governance della piattaforma

LangGuard agisce come uno strato di applicazione in tempo reale per i flussi di lavoro agentivi, monitorando e applicando le policy attraverso la catena end-to-end di azioni, decisioni, strumenti, credenziali e intenti che copre ogni sistema toccato da un agente. Databricks fornisce governance unificata tramite Unity Catalog e AI Gateway, il sistema di registrazione per dati, modelli e policy di accesso. Man mano che le aziende distribuiscono agenti in produzione, anche il flusso di lavoro stesso necessita di uno strato di applicazione in tempo reale che estenda tali controlli a livello di piattaforma a ogni fase dell'esecuzione dell'agente. È qui che entra in gioco LangGuard. Il motore di governance di LangGuard, il data fabric GRAIL™ (Governance AI Run-time Links), cattura ogni azione dell'agente come dati di traccia multidimensionali e costruisce un knowledge graph live del comportamento e del contesto del flusso di lavoro. Quando un agente tenta di invocare uno strumento, accedere a un dataset o chiamare un modello, LangGuard valuta quell'azione rispetto alla policy prima che venga eseguita, attraverso ogni sistema toccato dal flusso di lavoro, indipendentemente da dove viene eseguito.

La scala di una distribuzione di agenti aziendali in produzione rende questo compito veramente difficile. Un singolo flusso di lavoro può coinvolgere decine di agenti coordinati, centinaia di invocazioni di strumenti, più modelli di base e policy gestite attraverso quindici o più Sistemi di Registrazione aziendali, inclusi sistemi di ticketing IT come ServiceNow, piattaforme IAM e IDP, sistemi CRM come Salesforce, piattaforme HR come Workday, piattaforme di sicurezza cloud come Wiz e CrowdStrike, piattaforme di contact center come TalkDesk, MCP Gateways e API Gateways. Governare questo in tempo reale, senza influire sulle prestazioni dell'agente, richiede un'infrastruttura costruita appositamente per il problema.

Perché abbiamo scelto Lakebase

Il team di LangGuard ha trascorso anni a costruire IBM QRadar, un leader pluripremiato nel Gartner Magic Quadrant e una delle piattaforme SIEM aziendali più diffuse al mondo. QRadar ingerisce e correla petabyte di telemetria di sicurezza al giorno in condizioni rigorose di latenza e affidabilità. Quell'esperienza ci ha insegnato una dura lezione: l'architettura del database è il destino. Quando abbiamo progettato il motore di governance dei flussi di lavoro di LangGuard, abbiamo affrontato la stessa sfida che avevamo risolto in precedenza: dati operativi di sicurezza che arrivano in raffiche imprevedibili e ad alta intensità, dove ogni millisecondo di latenza decisionale conta e la spesa per infrastrutture inattive è inaccettabile. I database tradizionali che accoppiano calcolo e archiviazione ti costringono a effettuare il provisioning per il carico di picco e a pagare per quella capacità 24 ore su 24. Il modello serverless di Lakebase, che disaccoppia completamente il calcolo dall'archiviazione e scala a zero tra le raffiche, è stata la risposta di cui avevamo sempre avuto bisogno ma a cui non avevamo accesso quando stavamo costruendo QRadar. Corrispondeva esattamente al problema.

Cosa rende Lakebase la scelta giusta

Lakebase è una nuova categoria di architettura di database operativo che disaggrega il calcolo dall'archiviazione, consentendo al calcolo di scalare elasticamente con la domanda del carico di lavoro, mentre lo stato duraturo risiede in modo indipendente in uno strato di archiviazione replicato. Costruita sulla base aperta di PostgreSQL, l'architettura lakebase preserva tutto ciò su cui gli sviluppatori fanno affidamento in un database relazionale comprovato, eliminando i vincoli infrastrutturali che rendono i RDBMS tradizionali e monolitici la scelta sbagliata per la velocità e la scala richieste dalle moderne app, agenti e AI.

Autoscaling serverless e scale-to-zero

Il comportamento degli agenti è notoriamente a raffiche. Un flusso di lavoro di agenti potrebbe essere completamente dormiente per ore e poi generare improvvisamente centinaia di scritture di traccia e letture di applicazione in pochi secondi. Lakebase effettua il provisioning dinamico delle risorse di calcolo nel preciso momento in cui queste tracce inondano il nostro sistema e si spegne completamente quando l'attività si interrompe. Poiché lo stato duraturo risiede nello strato di archiviazione, non nel nodo di calcolo, l'avvio di una nuova istanza di calcolo non richiede alcun spostamento di dati. Si collega semplicemente alla cronologia del database esistente e inizia immediatamente a servire le query.

Per una startup che opera su scala aziendale, questa è la differenza tra un'infrastruttura che corrisponde all'uso effettivo e un'infrastruttura che ti penalizza per i periodi di inattività. I nostri costi operativi rimangono perfettamente allineati con i carichi di lavoro che stiamo effettivamente servendo.

Latenza di lettura in millisecondi per i dati operativi attivi

La preoccupazione naturale con qualsiasi database disaggregato è la latenza di lettura. Lakebase affronta questo problema attraverso uno strato di caching tra calcolo e archiviazione che mantiene i dati attivi vicini al calcolo.

Per le query di applicazione di LangGuard, ricerche indicizzate strette contro le tabelle di contesto e policy di GRAIL™, ci aspettiamo che l'insieme di lavoro attivo si adatti comodamente alla memoria locale del calcolo. Questa architettura ci dà la certezza che le decisioni di governance possano essere applicate alla velocità del flusso di lavoro, senza aggiungere una latenza significativa all'esecuzione dell'agente.

Branching istantaneo del database per il test delle policy di governance

Il branching istantaneo del database di Lakebase è una delle sue capacità operative più preziose per un prodotto di governance. Quando creiamo un branch, nessun dato viene copiato fisicamente. Il branch diverge dallo stato attuale del database utilizzando la semantica copy-on-write, consumando spazio di archiviazione solo per dati nuovi o modificati. I nostri sviluppatori possono creare una replica isolata ed esatta dei nostri dati di traccia di produzione in pochi secondi, testare nuove policy di governance rispetto al comportamento reale dell'agente e validare la logica di applicazione senza rischiare la stabilità dell'ambiente live.

PostgreSQL: una base comprovata

Lakebase è costruito su PostgreSQL, il database relazionale open-source più avanzato al mondo, con decenni di indurimento in produzione in ogni settore. Per LangGuard, ciò significa piena compatibilità con gli strumenti, le librerie e le estensioni che il nostro team già conosce, senza linguaggi di query proprietari o rischi di migrazione.

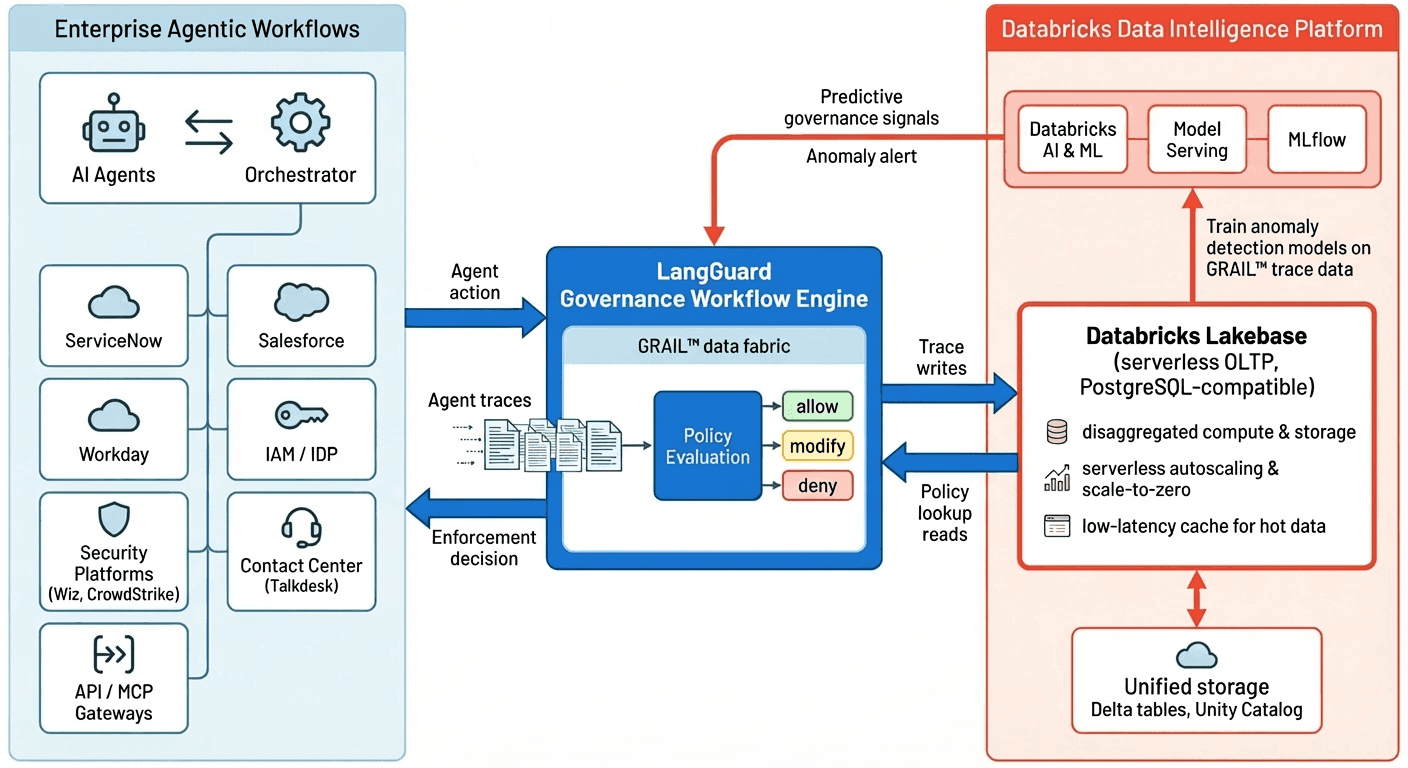

Come LangGuard e Databricks lavorano insieme

L'architettura congiunta LangGuard e Databricks è progettata per governare i flussi di lavoro agentivi aziendali end-to-end, mantenendo tutti i dati operativi su un'unica piattaforma dati e AI fidata. A sinistra dell'architettura ci sono i flussi di lavoro agentivi aziendali stessi: agenti AI e i loro orchestratori che interagiscono con dozzine di sistemi di registrazione come gestione dei servizi IT, CRM, HR, identità, sicurezza, contact center e gateway API/MCP. Ogni azione dell'agente, invocazione di strumenti e richiesta di accesso ai dati genera ricchi eventi di traccia che fluiscono in LangGuard in tempo reale.

Al centro del diagramma si trova il LangGuard Governance Workflow Engine, alimentato dal data fabric GRAIL™ in attesa di brevetto. GRAIL cattura ogni azione dell'agente come dati di traccia multidimensionali e costruisce un knowledge graph live del comportamento e del contesto del flusso di lavoro. Quando un agente tenta di chiamare uno strumento, accedere a un dataset o invocare un modello, LangGuard esegue una valutazione della policy rispetto a questo contesto live e alle regole di governance pertinenti, restituendo una decisione di allow/deny/modify prima che l'azione venga eseguita. Ciò fornisce alle aziende un unico punto di controllo per l'applicazione delle policy attraverso ogni sistema toccato dal flusso di lavoro, indipendentemente da dove vengano eseguiti gli agenti sottostanti.

A destra, Databricks Lakebase funge da sistema operativo di registrazione per i dati di traccia e policy di LangGuard. L'architettura serverless basata su PostgreSQL di Lakebase disaggrega il calcolo dall'archiviazione, consentendo l'autoscaling elastico e lo scale-to-zero tra le raffiche di attività dell'agente, mantenendo i dati operativi attivi in una cache a bassa latenza vicino al calcolo. LangGuard scrive continuamente eventi di traccia in Lakebase ed esegue letture a bassa latenza per le ricerche di policy di governance e le query contestuali, garantendo che le decisioni di applicazione possano essere prese alla velocità del flusso di lavoro senza un provisioning eccessivo della capacità del database.

Poiché i dati operativi di LangGuard risiedono nativamente in Lakebase, sono immediatamente disponibili per la più ampia Databricks Data Intelligence Platform per l'analisi e l'AI senza ETL aggiuntivo. Databricks AI, Model Serving e MLflow possono addestrare e distribuire modelli di rilevamento delle anomalie direttamente sui dati di traccia GRAIL per identificare agenti che deviano dalla loro baseline comportamentale stabilita. Questi segnali predittivi vengono reimmessi nel LangGuard Governance Engine, chiudendo il cerchio tra l'applicazione in tempo reale e il monitoraggio predittivo, e consentendo alle aziende di passare da controlli reattivi a una governance AI proattiva basata sul comportamento su un'unica piattaforma.

Cosa succederà dopo: governance predittiva per flussi di lavoro agentivi

Il motore di LangGuard applica oggi policy consolidate in fase di esecuzione attraverso l'intero flusso di lavoro. La prossima evoluzione è predittiva: addestramento di modelli comportamentali su dati storici di tracciamento GRAIL per rilevare comportamenti anomali dell'agente prima che si manifestino come violazione delle policy.

Poiché i nostri dati operativi di tracciamento risiedono già nell'ecosistema Databricks, come descritto sopra, possiamo passare direttamente dall'applicazione alla predizione senza creare pipeline ETL separate o impostare una seconda piattaforma analitica.

Se un agente inizia a comportarsi in modo erratico o a discostarsi dalla sua baseline stabilita, quei modelli lo segnaleranno come anomalia prima che venga causato alcun danno. Questa convergenza tra applicazione in tempo reale e machine learning predittivo è il futuro della governance dell'IA aziendale, ed è l'architettura che stiamo costruendo oggi.

| ASPIRAZIONE CHIAVE |

|---|

| LangGuard è una delle prime startup a costruire infrastrutture di produzione su Databricks Lakebase. La scelta è stata guidata da un insieme specifico di requisiti non negoziabili: applicazione a bassa latenza, gestione di burst elastici e test delle policy di governance rispetto a dati reali. Solo un database OLTP serverless poteva soddisfarli tutti. Lakebase è il primo database a soddisfarli tutti. |

| Per le aziende che necessitano di governare i flussi di lavoro agentivi end-to-end, attraverso ogni agente, strumento, credenziale e sistema di registrazione nella catena, questa architettura significa un'applicazione che opera alla velocità del flusso di lavoro, scala con la complessità del deployment e si evolve verso la sicurezza comportamentale predittiva senza richiedere una piattaforma dati separata. |

Pronto a governare i tuoi flussi di lavoro agentivi end-to-end? Visita langguard.ai per scoprire come LangGuard protegge, controlla e gestisce i flussi di lavoro agentivi aziendali con piena conformità alle policy, o esplora Databricks Lakebase per vedere come l'infrastruttura OLTP serverless alimenta la governance dell'IA in tempo reale su larga scala.

Scopri di più su LangGuard Esplora Databricks Lakebase

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.