Introduzione al Databricks AI Security Framework (DASF)

Un framework attuabile per gestire la sicurezza dell'AI

di Omar Khawaja, Arun Pamulapati, Kelly Albano e Erika Ehrli

Siamo entusiasti di annunciare il rilascio del whitepaper Databricks AI Security Framework (DASF) versione 1.0! Il framework è progettato per migliorare la collaborazione tra i team aziendali, IT, dati, AI e sicurezza. Semplifica i concetti di AI e ML catalogando la knowledge base dei rischi di sicurezza dell'AI basati su osservazioni di attacchi reali e offre un approccio di difesa in profondità alla sicurezza dell'AI, fornendo consigli pratici per un'applicazione immediata.

Il machine learning (ML) e l'intelligenza artificiale generativa (GenAI) stanno trasformando il futuro del lavoro migliorando l'innovazione, la competitività e la produttività dei dipendenti. Tuttavia, le organizzazioni si trovano ad affrontare la duplice sfida di sfruttare le tecnologie di intelligenza artificiale (AI) per cogliere opportunità, gestendo al contempo potenziali rischi di sicurezza e privacy, come violazioni dei dati e non conformità normativa.

Questo blog fornirà una panoramica del DASF, come utilizzarlo per proteggere le iniziative AI della tua organizzazione, condividerà un aggiornamento sul nostro slancio esterno e guiderà in modo sicuro l'adozione dell'AI nella tua organizzazione.

Costruire le fondamenta del Databricks AI Security Framework

L'AI sta influenzando ogni settore e trasformando il modo in cui lavoriamo. Ora più che mai, i leader vogliono sfruttare i dati e l'AI per trasformare le proprie organizzazioni. La sicurezza e la governance dell'AI sono fondamentali per stabilire la fiducia negli obiettivi AI della tua organizzazione. Secondo Gartner, la gestione della fiducia, del rischio e della sicurezza dell'AI è la tendenza strategica n. 1 del 2024 che influenzerà le decisioni aziendali e tecnologiche, e entro il 2026, i modelli AI delle organizzazioni che operazionalizzano la trasparenza, la fiducia e la sicurezza dell'AI otterranno un aumento del 50% in termini di adozione, obiettivi aziendali e accettazione da parte degli utenti.

All'inizio di quest'anno, abbiamo annunciato l'acquisizione di MosaicML da parte di Databricks e abbiamo condiviso maggiori dettagli sul nostro impegno per l'AI Responsabile. Negli ultimi mesi, abbiamo continuato a rafforzare il nostro impegno e slancio come leader del settore nell'AI attraverso nuove partnership. Per integrare questi investimenti, il team di sicurezza di Databricks ospita ora workshop sulla sicurezza dell'AI per i CISO per educare le organizzazioni su come gestire con successo il proprio percorso AI in modo consapevole dei rischi. Abbiamo appreso dai nostri clienti che i team di sicurezza e governance faticano a trovare materiale affidabile che demistifichi cos'è l'AI, come funziona e quali rischi di sicurezza potrebbero sorgere man mano che queste tecnologie vengono implementate.

Abbiamo utilizzato queste informazioni per sviluppare il framework DASF al fine di aiutare i team aziendali, IT, dati, AI e sicurezza a collaborare meglio nell'implementazione dell'AI secondo i seguenti principi:

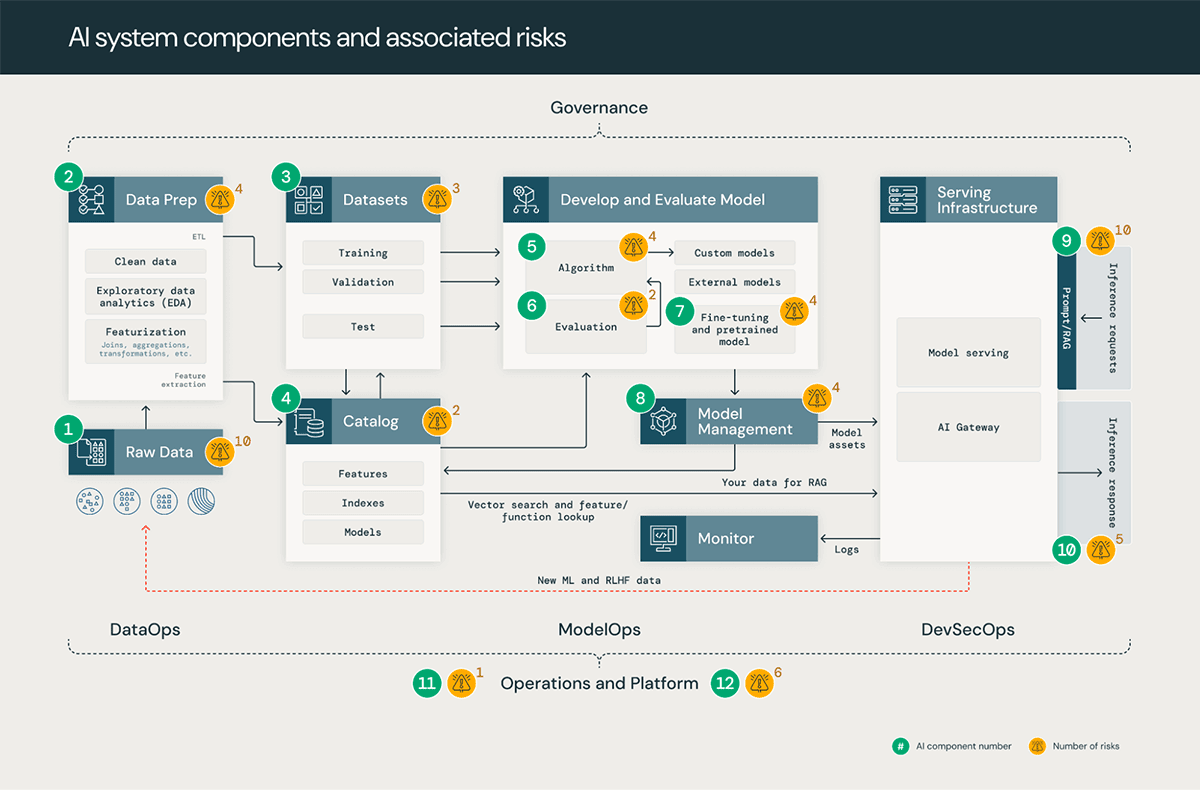

- Demistificare AI e ML: Il DASF scompone i 12 componenti di un sistema AI, i tipi di modelli AI esistenti e come funzionano insieme. Ciò aiuta la capacità dei team di lavorare insieme definendo una nomenclatura comune dei sistemi, processi e persone coinvolti nell'AI.

- Fornire un approccio di difesa in profondità per la messa in sicurezza dell'AI: Nelle nostre conversazioni con i leader della sicurezza, è necessaria chiarezza sul fatto che la sicurezza dell'AI sia un problema di cybersecurity, un problema di machine learning avversario o qualcosa di completamente nuovo. La realtà è che è tutto quanto sopra. Il DASF fornisce un framework per comprendere i 55 rischi di sicurezza attraverso le tre fasi di qualsiasi sistema AI in base ai tuoi specifici casi d'uso e modelli di implementazione dell'AI. Mappiamo anche i rischi ai framework comuni di sicurezza dell'AI come MITRE ATLAS, OWASP Top 10 per LLM e NIST AML Taxonomy.

- Fornire raccomandazioni attuabili: Molti framework esistenti fanno un buon lavoro nel delineare i rischi associati all'AI, ma non delineano chiaramente i controlli necessari per mitigarli. Il DASF raccomanda 53 controlli applicabili a qualsiasi piattaforma dati e AI tu utilizzi. Se sei un cliente Databricks, andiamo oltre: abbiamo incluso collegamenti alla documentazione Databricks (per cloud) per fornire istruzioni specifiche sull'implementazione di ciascun controllo di mitigazione!

Iniziare con il Databricks AI Security Framework

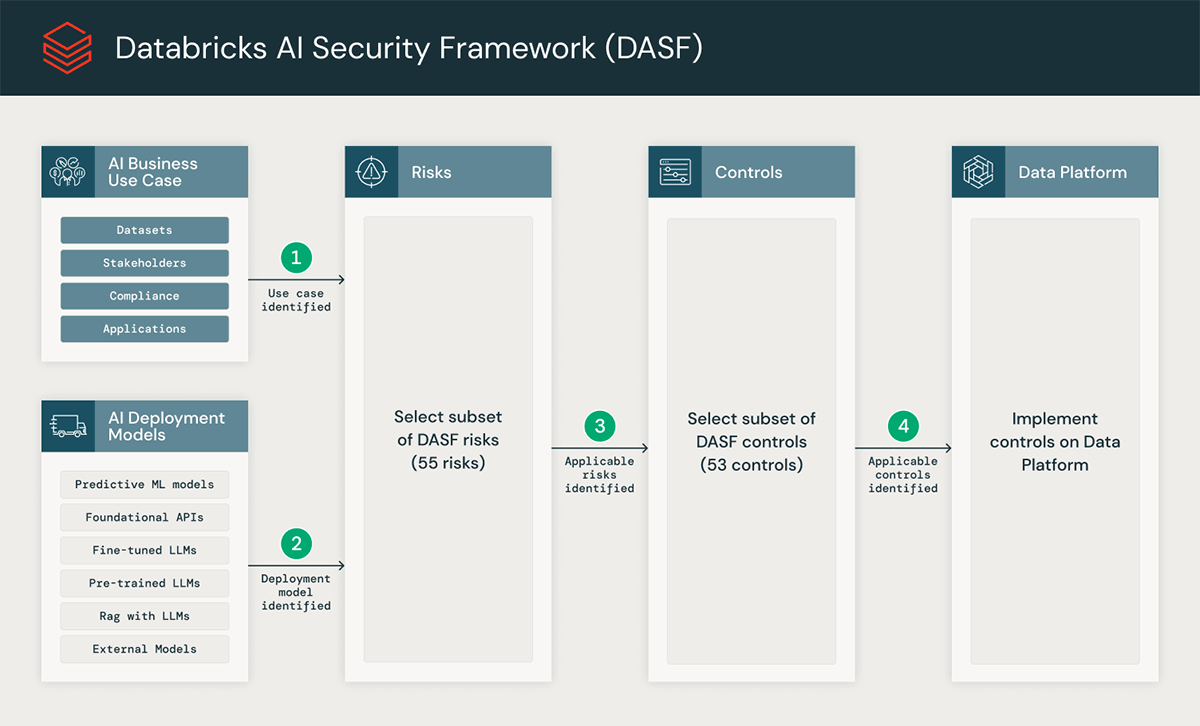

Il DASF è stato progettato in modo che, indipendentemente dalla piattaforma dati e AI che utilizzi, tu possa ottenere un profilo di rischio end-to-end per le esigenze di implementazione AI della tua organizzazione con un set concreto di controlli da considerare per l'implementazione. Per iniziare con il DASF, raccomandiamo il seguente approccio, come illustrato nella figura seguente:

Passaggio 1 - Identificare il caso d'uso aziendale dell'AI: Collabora con i tuoi stakeholder, sia che siano già implementati o in fase di pianificazione, sui casi d'uso AI della tua organizzazione. Raccomandiamo di utilizzare i Databricks Solution Accelerators, che sono guide specifiche per accelerare i risultati nei tuoi casi d'uso AI e ML più comuni e di maggiore impatto. Esamina quali set di dati verranno utilizzati, quali requisiti di conformità potrebbero essere applicabili e quali applicazioni saranno interessate da questi sistemi AI per definire le capacità di base richieste dalla tua piattaforma dati e AI.

Passaggio 2 - Determinare il modello di implementazione dell'AI: Scegli un modello di implementazione appropriato come modelli ML predittivi, LLM RAG, LLM affinati, LLM pre-addestrati, modelli fondazionali e modelli esterni. Ogni modello di implementazione ha una diversa suddivisione della responsabilità condivisa tra i 12 componenti del sistema AI e tra la tua organizzazione, la tua piattaforma dati e AI e qualsiasi partner coinvolto.

Passaggio 3 - Selezionare i rischi più pertinenti: Dal nostro elenco documentato di 55 rischi di sicurezza, individua quelli più rilevanti per la tua organizzazione in base al caso d'uso e al modello di implementazione che la tua organizzazione sta adottando. Per la maggior parte dei casi d'uso, sarà necessario affrontare solo un piccolo sottoinsieme dei 55 rischi.

Passaggio 4 - Scegliere e implementare i controlli: Seleziona i controlli che sono in linea con l'appetito per il rischio della tua organizzazione. Questi controlli sono definiti genericamente per la compatibilità con qualsiasi piattaforma dati e AI. Il nostro framework fornisce anche linee guida per personalizzare questi controlli specificamente per la Databricks Data Intelligence Platform con istruzioni specifiche per l'implementazione Databricks per cloud. Utilizzi questi controlli insieme alle policy della tua organizzazione e hai le giuste garanzie in atto.

Se questo sembra ancora molto, continueremo a ospitare i nostri workshop sulla sicurezza dell'AI per coloro che desiderano un'esperienza interattiva.

Promuovere la sicurezza dell'AI attraverso alleati, partner e clienti del settore

Nel settore della sicurezza, coltivare la collaborazione tra pari è fondamentale per garantire sicurezza, protezione e successo collettivi. Non saremmo in grado di pubblicare oggi un documento come il DASF senza gli standard, i framework e gli strumenti di terze parti che ci precedono, come le Linee guida per lo sviluppo sicuro di sistemi AI, il NIST AI Risk Management Framework e il Framework multistrato per buone pratiche di cybersecurity per l'AI. Molti altri sono referenziati nel DASF e possono essere consultati nella sezione risorse.

Mentre abbiamo condotto innumerevoli revisioni interne con i nostri esperti di AI, ML e sicurezza in Databricks, ci siamo anche incontrati con 15 leader del settore della sicurezza AI, tra cui rappresentanti di HITRUST, Carnegie Mellon University, Capital One, Protect AI e Barracuda (e altri citati di seguito!). Li ringraziamo per il loro tempo, le loro intuizioni e il loro feedback su come rendere il DASF il più pratico possibile per i nostri colleghi. Un elenco completo dei revisori si trova nella sezione ringraziamenti del DASF.

"Quando penso a cosa rende un buon acceleratore, si tratta di rendere le cose più fluide, più efficienti e di promuovere l'innovazione. Il DASF è uno strumento collaudato ed efficace per i team di sicurezza per aiutare i loro partner a ottenere il massimo dall'IA. Inoltre, si allinea con framework di rischio consolidati come NIST, quindi non si tratta solo di velocizzare le cose, ma di creare una solida base nel lavoro di sicurezza." — Riyaz Poonawala, Vice President of Information Security, Navy Federal Credit Union

"Le aziende non devono sacrificare la sicurezza per l'innovazione dell'IA. Il Databricks AI Security Framework è uno strumento completo per abilitare l'adozione dell'IA in modo sicuro. Non solo mappa le preoccupazioni sulla sicurezza dell'IA alla pipeline di sviluppo dell'IA, ma le rende attuabili per i clienti Databricks con controlli pratici. Siamo lieti di aver contribuito allo sviluppo di questa preziosa risorsa comunitaria." — Hyrum Anderson, CTO, Robust Intelligence

"Il DASF è un ottimo esempio della leadership di Databricks nell'IA ed è un prezioso contributo al settore in un momento critico. Sappiamo che il rischio maggiore associato all'Intelligenza Artificiale per il prossimo futuro sono le persone malintenzionate e questo framework offre un efficace contrappeso a tali criminali informatici. Il DASF è un modo pragmatico, operativo ed efficiente per proteggere la tua organizzazione." — Chris "Tito" Sestito, CEO e Co-fondatore di HiddenLayer

Fai il primo passo per espandere una solida base di sicurezza per l'IA – scarica il Databricks AI Security Framework e interagisci con il nostro team

Il whitepaper Databricks AI Security Framework è disponibile per il download sul Databricks Security and Trust Center. Ci siamo impegnati a garantire l'accuratezza e il nostro team è desideroso di ricevere il tuo feedback. In caso di feedback o domande, non esitare a contattarci via email all'indirizzo [email protected]. Questo alias è anche il luogo dove puoi richiedere maggiori informazioni sull'adesione a un prossimo workshop sulla sicurezza dell'IA o programmarne uno dedicato per la tua organizzazione. Consulta la nostra nuova pagina sulla sicurezza dell'IA per risorse dettagliate sulla sicurezza dell'IA e del ML.

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.