Sicurezza & Trust Center

La sicurezza dei tuoi dati è la nostra priorità

Sicurezza dell'AI

Best practice per mitigare i rischi associati ai modelli di IA

La sicurezza dell'IA si riferisce alle pratiche, alle misure e alle strategie implementate per proteggere i sistemi, i modelli e i dati di intelligenza artificiale da accessi non autorizzati, manipolazioni o attività dannose. Le organizzazioni devono implementare solidi protocolli di sicurezza, metodi di crittografia, controlli degli accessi e meccanismi di monitoraggio per salvaguardare gli asset di IA e mitigare i potenziali rischi associati al loro utilizzo.

Il nostro team di sicurezza collabora con i clienti per distribuire soluzioni di AI e machine learning su Databricks in modo sicuro e con funzionalità appropriate ai requisiti dell'architettura dei clienti. Collaboriamo inoltre con decine di esperti interni a Databricks e nella più ampia community di ML e GenAI per identificare i rischi per la sicurezza dei sistemi di IA e definire i controlli necessari per mitigare tali rischi.

Comprensione dei sistemi di AI

Da quali componenti è composto un sistema di IA e come funzionano insieme?

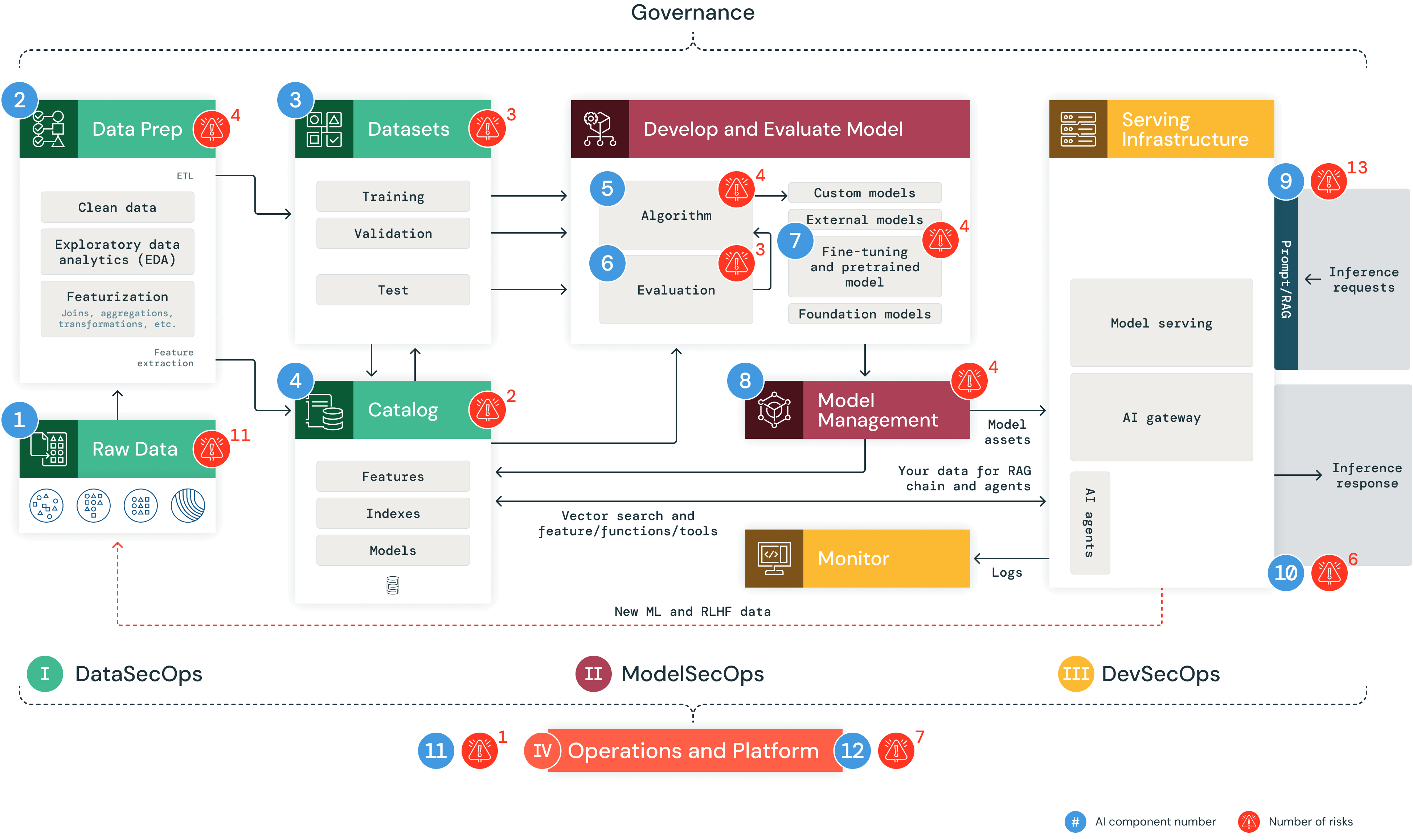

I sistemi di IA sono composti da dati, codice e modelli. Un tipico sistema di IA end-to-end ha 12 componenti architetturali fondamentali, ampiamente classificati in quattro fasi principali:

- Le attività operative sui dati includono l'acquisizione e la trasformazione dei dati e la garanzia della sicurezza e della governance dei dati. I buoni modelli di ML dipendono da pipeline di dati affidabili e da un'infrastruttura sicura.

- Le attività operative sui modelli includono la creazione di modelli personalizzati, l'acquisizione di modelli da un marketplace di modelli o l'utilizzo di modelli linguistici di grandi dimensioni (LLM) software-as-a-service (SaaS), come OpenAI. Lo sviluppo di un modello richiede una serie di esperimenti e un modo per monitorare e confrontare le condizioni e i risultati di tali esperimenti.

- La distribuzione e il servizio dei modelli consiste nella creazione sicura di immagini dei modelli, nell'isolamento e nel servizio sicuro dei modelli, nella scalabilità automatizzata, nella limitazione della velocità e nel monitoraggio dei modelli distribuiti.

- Attività operative e piattaforma includono la gestione delle vulnerabilità e l'applicazione di patch della piattaforma, l'isolamento dei modelli e i controlli del sistema, nonché l'accesso autorizzato ai modelli con sicurezza integrata nell'architettura. Include anche strumenti operativi per CI/CD. Garantisce che l'intero ciclo di vita soddisfi gli standard richiesti, mantenendo sicuri per MLOps i distinti ambienti di esecuzione (sviluppo, staging e produzione).

L'immagine seguente evidenzia i 12 componenti e il modo in cui interagiscono all'interno di un sistema di IA.

Comprensione dei rischi per la sicurezza dell'IA

Quali sono le minacce alla sicurezza che possono sorgere con l'adozione dell'IA?

Nella nostra analisi dei sistemi di IA, abbiamo identificato 62 rischi tecnici per la sicurezza nei 12 componenti dell'architettura di base. Nella tabella seguente illustriamo questi componenti di base, che corrispondono alle fasi di qualsiasi sistema di IA, ed evidenziamo alcuni esempi di rischi per la sicurezza. L'elenco completo dei 62 rischi tecnici per la sicurezza è disponibile nel Databricks AI Security Framework.

Fase del sistema di IA | Componenti del sistema di AI | Potenziali rischi per la sicurezza |

|---|---|---|

Attività operative sui dati | 1. Dati grezzi 2. Preparazione dei dati 3. Set di dati 4. Catalogo e governance | 20 rischi specifici, come:

|

Le attività operative del modello | 5. Algoritmo di ML 6. Valutazione 7. Creazione del modello 8. Gestione del modello | 15 rischi specifici, come:

|

Distribuzione e serving del modello | 9. Model Serving: richieste di inferenza 10. Model Serving: risposte di inferenza | 19 rischi specifici come:

|

Attività operative e piattaforma | 11. attività operative di ML 12. Piattaforma di ML | 8 rischi specifici, quali:

|

Quali controlli sono disponibili per mitigare i rischi per la sicurezza dell'IA?

Esistono 64 controlli prescrittivi per mitigare i 62 rischi per la sicurezza dell'IA identificati. Questi controlli includono:

- Best practice di cybersecurity quali single sign-on, tecniche di crittografia, controlli delle librerie e del codice sorgente e controlli di accesso alla rete con un approccio di difesa in profondità alla gestione dei rischi

- Controlli specifici per la governance dei dati e dell'AI, quali classificazione dei dati, provenienza dei dati, data versioning, monitoraggio dei modelli, autorizzazioni per gli asset di dati e modelli e governance dei modelli

- Controlli specifici per l'AI come isolamento del model serving, strumenti per i prompt, auditing e monitoraggio dei modelli, MLOps e LLMOps, gestione centralizzata degli LLM, fine-tuning e pre-addestramento dei modelli

Se desideri una panoramica approfondita dei rischi per la sicurezza associati ai sistemi di IA e dei controlli da implementare per ciascun rischio, ti invitiamo a download il nostro Whitepaper sulla sicurezza dell'IA di Databricks.

Best practice per la sicurezza dei modelli di AI e ML

I team che si occupano di dati e sicurezza devono collaborare attivamente per perseguire l'obiettivo di migliorare la sicurezza dei sistemi di IA. Sia che tu stia implementando soluzioni di machine learning tradizionali o applicazioni basate su LLM, Databricks consiglia di adottare i seguenti passaggi, come descritto nel Whitepaper sulla sicurezza di Databricks AI.

Domande frequenti

Risorse per la sicurezza dell'IA

Databricks AI Security Framework (DASF)

Il team di sicurezza di Databricks ha creato il Databricks AI Security Framework (DASF) per affrontare le vulnerabilità in evoluzione nei sistemi di AI con un approccio olistico alla mitigazione dei rischi che vanno oltre la sicurezza dei modelli.

Workshop sul rischio IA di Databricks

Il team Sicurezza di Databricks organizza workshop sui rischi dell'IA per aiutare i leader a comprendere i sistemi di IA, i loro rischi e le strategie di mitigazione.

Addestramento sui fondamenti della sicurezza dell'AI

Questo corso esplora i fondamenti della sicurezza nei sistemi di IA all'interno della Databricks Data Intelligence Platform in cinque moduli completi.

Eventi e webinar sulla sicurezza dell'AI

I leader della sicurezza di Databricks condividono regolarmente le loro competenze in occasione di eventi con leader del settore, aziende, agenzie e fornitori.