Che cos'è la piattaforma di analisi dei dati?

Un ecosistema di servizi per l'analisi di dati voluminosi e complessi, che consente agli utenti di recuperare, combinare, esplorare e visualizzare dati da varie fonti

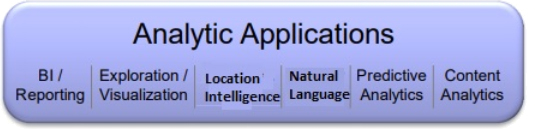

- Integra analisi predittiva, visualizzazione dei dati, intelligence sulla posizione, elaborazione del linguaggio naturale e analisi dei contenuti per trasformare tutti i tipi di dati in informazioni aziendali fruibili.

- Integra diverse fonti di big data con accesso utente trasparente, gestisce e protegge le risorse di dati tramite governance e monitora lo stato e le prestazioni del sistema.

- Consente la descrizione dei dati, l'identificazione delle relazioni variabili, la previsione, la riduzione dei costi e l'individuazione di mercati nascosti e richieste dei clienti non soddisfatte attraverso un'analisi completa.

Che cos'è una piattaforma di analisi dei dati?

Una piattaforma di analisi dei dati è un ecosistema di servizi e tecnologie che esegue analisi su dati voluminosi, complessi e dinamici per consentire all'utente di recuperare, combinare, esplorare, visualizzare e interagire con dati provenienti da diverse sorgenti all'interno dell'azienda. Una piattaforma di analisi dei dati completa integra numerosi strumenti con varie funzionalità, dall'analisi predittiva alla visualizzazione dei dati, dall'intelligenza spaziale al linguaggio naturale, fino all'analisi dei contenuti. Il suo scopo principale è trasformare qualsiasi tipo di dati in informazioni fruibili per portare risultati concreti alle aziende.

Una piattaforma completa per l'analisi dei Big Data dovrebbe essere in grado di:

- integrare diverse sorgenti di Big Data e fornire una vista trasparente agli utenti;

- gestire e proteggere il patrimonio di dati dell'organizzazione allo scopo di garantire dati generalmente comprensibili, corretti, completi e sicuri;

- monitorare i dati, le risorse e le applicazioni per esaminare e valutare lo stato di salute e le prestazioni dell'intero sistema

Un'analisi dei Big Data eseguita correttamente, indipendentemente dal fatto che i dati siano qualitativi o quantitativi, offre la possibilità di:

- descrivere e riassumere i dati

- individuare relazioni fra le variabili

- confrontare variabili

- individuare differenze fra le variabili

- scoprire mercati nascosti

- scoprire richieste dei clienti non soddisfatte

- scoprire richieste dei clienti e opportunità di riduzione dei costi non soddisfatte

- prevedere esiti e risultati

- promuovere miglioramenti significativi

Il playbook sull'AI agentiva per l'enterprise

Quando si parla di Big Data, Hadoop è la soluzione preferita per questi requisiti, soprattutto perché ha dimostrato di essere affidabile, flessibile, economica e scalabile. Anche se Hadoop è in grado di conservare grandi quantità di dati su HDFS (Hadoop Distributed File System), questo non significa che sia l'unica soluzione disponibile. Esistono molti altri strumenti in commercio per analizzare grandi quantità di dati, come MapReduce, Pig e Hive.

Risorse aggiuntive

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.