Databricks Lakeflow의 일반 공급 발표

수집, 변환 및 오케스트레이션 전반에 걸친 통합 데이터 엔지니어링 접��근 방식

작성자: Bilal Aslam , Michael Armbrust

- Databricks Lakeflow는 데이터 인텔리전스 플랫폼에서 수집, 변환 및 오케스트레이션을 위한 통합 솔루션을 제공하여 파편화된 스택으로 인한 데이터 엔지니어링 문제를 해결합니다.

- Lakeflow Connect는 데이터베이스, 파일 소스, 엔터프라이즈 애플리케이션 및 데이터 웨어하우스에 ��더 많은 커넥터를 추가합니다. Zerobus는 낮은 지연 시간으로 높은 처리량의 직접 쓰기를 도입합니다.

- 새로운 오픈 Spark Declarative Pipelines 표준을 기반으로 구축된 Lakeflow Declarative Pipelines는 데이터 엔지니어를 위한 새로운 IDE를 제공하여 ETL 파이프라인 개발을 개선합니다.

Databricks의 통합 데이터 엔지니어링 솔루션인 Lakeflow가 정식 출시되었음을 기쁜 마음으로 알려드립니다. Lakeflow에는 인기 있는 데이터 소스에 대한 확장된 수집 커넥터, 데이터 파이프라인 구축 및 디버깅을 쉽게 해주는 새로운 “데이터 엔지니어링용 IDE”, 그리고 ETL 운영 및 모니터링을 위한 확장된 기능이 포함되어 있습니다.

작년 Data + AI Summit에서 저희는 데이터 엔지니어링의 미래 비전인 종단간 솔루션인 Lakeflow를 소개했습니다. Lakeflow는 세 가지 핵심 구성 요소로 이루어져 있습니다.

- Lakeflow Connect: 사용자 지정 커넥터나 외부 서비스의 오버헤드 없이 엔터프라이즈 앱, 데이터베이스, 파일 시스템 및 실시간 스트림에서 안정적이고 관리되는 데이터 수집을 제공합니다.

- Lakeflow Declarative Pipelines: Spark Declarative Pipelines의 개방형 표준을 기반으로 구축된 확장 가능한 ETL 파이프라인으로, 거버넌스 및 관찰 가능성과 통합되어 있으며 현대적인 “데이터 엔지니어링용 IDE”를 통해 간소화된 개발 환경을 제공합니다.

- Lakeflow Jobs: Data Intelligence Platform을 위한 네이티브 오케스트레이션으로, 고급 제어 흐름, 실시간 데이터 트리거 및 포괄적인 ��모니터링을 지원합니다.

Lakeflow는 데이터 엔지니어링을 통합함으로써 다양한 도구를 연결하는 복잡성과 비용을 제거하여 데이터 팀이 비즈니스를 위한 가치 창출에 집중할 수 있도록 합니다. 새로운 AI 기반 시각적 파이프라인 빌더인 Lakeflow Designer는 코드를 작성하지 않고도 누구나 프로덕션 등급의 데이터 파이프라인을 구축할 수 있도록 지원합니다.

바쁜 한 해였으며, Lakeflow가 정식 출시됨에 따라 새로운 기능들을 공유하게 되어 매우 기쁩니다.

데이터 엔지니어링 팀은 조직의 데이터 요구 사항을 따라가는 데 어려움을 겪고 있습니다

모든 산업에서 분석 및 AI를 통해 데이터에서 가치를 추출하는 비즈니스의 능력은 경쟁 우위입니다. 데이터는 고객 360도 뷰 및 새로운 고객 경험 창출, 새로운 수익원 창출, 운영 최적화, 직원 역량 강화 등 조직의 모든 측면에서 활용됩니다. 조직은 자체 데이터를 활용하려고 할 때 다양한 도구의 조합을 사용하게 됩니다. 데이터 엔지니어는 통합하기 어렵고 유지 관리 비용이 많이 드는 파편화된 도구 스택을 탐색하면서 데이터 엔지니어링 작업의 복잡성을 해결하는 데 어려움을 겪습니다.

주요 과제는 데이터 거버넌스입니다. 파편화된 도구는 표준을 적용하기 어렵게 만들어 검색, 계보 및 관찰 가능성에 격차를 초래합니다. 최근 The Economist의 연구에 따르면 “데이터 엔지니어의 절반은 거버넌스가 다른 어떤 것보다 많은 시간을 차지한다고 말합니다”. 같은 설��문 조사에서 데이터 엔지니어에게 생산성에 가장 큰 이점을 줄 수 있는 것이 무엇인지 물었을 때, 그들은 “‘데이터 수집을 위한 데이터 소스 연결 단순화’, ‘여러 도구 대신 단일 통합 솔루션 사용’, ‘문제를 찾고 해결하기 위한 데이터 파이프라인에 대한 더 나은 가시성’을 최상위 개입으로 식별했습니다.”

Data Intelligence Platform에 내장된 통합 데이터 엔지니어링 솔루션

Lakeflow는 Data Intelligence Platform에서 종단간 데이터 엔지니어링 솔루션을 제공하여 데이터 팀이 이러한 과제를 해결하도록 돕습니다. Databricks 고객은 수집, 변환 및 오케스트레이션을 포함한 데이터 엔지니어링의 모든 측면에 Lakeflow를 사용할 수 있습니다. 이러한 모든 기능이 단일 솔루션의 일부로 제공되므로 복잡한 도구 통합에 시간을 소비하거나 외부 도구 라이선스에 추가 비용을 지불할 필요가 없습니다.

또한 Lakeflow는 Data Intelligence Platform에 내장되어 있으며, 이를 통해 모든 데이터 및 AI 사용 사례를 일관되게 배포, 거버넌스 및 관찰할 수 있습니다. 예를 들어 거버넌스의 경우 Lakeflow는 Data Intelligence Platform을 위한 통합 거버넌스 솔루션인 Unity Catalog와 통합됩니다. Unity Catalog를 통해 데이터 엔지니어는 데이터 파이프라인의 모든 부분에 대한 완전한 가시성과 제어 권한을 얻어 데이터가 어디에 사용되고 있는지 쉽게 이해하고 문제가 발생했을 때 근본 원인을 파악할 수 있습니다.

코드 버전 관리, CI/CD 파이프라인 배포, 데이터 보안 또는 실시간 운영 메트릭 관찰 등 무엇이든 Lakeflow는 Data Intelligence Platform을 활용하여 종단간 데이터 엔지니어링 요구 사항을 관리할 수 있는 단일하고 일관된 장소를 제공합니다.

Lakeflow Connect: 더 많은 커넥터, Unity Catalog로의 빠른 직접 쓰기

지난 한 해 동안 2,000명 이상의 고객이 수집 커넥터를 사용하여 데이터에서 가치를 발굴하는 Lakeflow Connect를 강력하게 채택했습니다. 한 가지 예는 CRM 데이터를 분석과 통합하여 고객 경험을 개선하기 위해 Lakeflow Connect를 사용하는 Porsche Holding Salzburg입니다.

“Lakeflow Connect의 Salesforce 커넥터를 사용하면 비즈니스 측면에서 사용 편의성과 가격 면에서 Porsche의 중요한 격차를 해소하는 데 도움이 됩니다. 고객 측면에서는 통합되고 파편화되지 않은 고객 여정을 통해 Porsche와 고객 간의 유대감을 강화하는 완전히 새로운 고객 경험을 창출할 수 있습니다.” — Lucas Salzburger, Project Manager, Porsche Holding Salzburg

오늘날 저희는 간단하고 안정적인 수집을 위해 더 많은 내장 커넥터를 제공하여 지원되는 데이터 소스의 범위를 확장하고 있습니다. Lakeflow의 커넥터는 각 해당 데이터 소스에 맞게 사용자 지정된 변경 데이터 캡처(CDC) 방법을 사용하여 효율적인 데이터 추출을 위해 최적화되어 있습니다.

이러한 관리형 커넥터는 이제 다양한 릴리스 상태에 걸쳐 엔터�프라이즈 애플리케이션, 파일 소스, 데이터베이스 및 데이터 웨어하우스를 포괄합니다.

- 엔터프라이즈 애플리케이션: Salesforce, Workday, ServiceNow, Google Analytics, Microsoft Dynamics 365, Oracle NetSuite

- 파일 소스: SFTP, SharePoint

- 데이터베이스: Microsoft SQL Server, Oracle Database, MySQL, PostgreSQL

- 데이터 웨어하우스: Snowflake, Amazon Redshift, Google BigQuery

또한 고객으로부터 흔히 발생하는 사용 사례는 일반적으로 데이터 플랫폼 외부에서 호스팅되는 메시지 버스 인프라를 사용하여 실시간 이벤트 데이터를 수집하는 것입니다. Databricks에서 이 사용 사례를 단순화하기 위해 개발자가 매우 높은 처리량(초당 100MB)과 거의 실시간 지연 시간(5초)으로 이벤트 데이터를 레이크하우스에 직접 쓸 수 있도록 하는 Lakeflow Connect API인 Zerobus를 발표합니다. 이 간소화된 수집 인프라는 대규모 성능을 제공하며 Databricks Platform과 통합되어 분석 및 AI 도구를 즉시 활용할 수 있습니다.

“Joby는 Zerobus를 사용하여 제조 에이전트를 통해 텔레메트리 데이터를 분당 기가바이트 단위로 레이크하우스에 직접 푸시하여 인사이트 도출 시간을 단축할 수 있습니다. 이 모든 것이 Databricks Lakeflow와 Data Intelligence Platform을 통해 가능합니다.” — Dominik Müller, Factory Systems Lead, Joby Aviation Inc.

Lakeflow Declarative Pipelines: 개방형 표준 기반의 가속화된 ETL 개발

수천 명의 고객과 함께 페타바이트 규모의 데이터를 �운영하고 발전시켜 온 수년간의 경험을 바탕으로, 저희는 배운 모든 것을 통합하여 새로운 개방형 표준인 Spark Declarative Pipelines를 만들었습니다. 이는 선언적이고 확장 가능하며 개방적인 파이프라인 개발의 차세대 진화입니다.

오늘 저희는 Databricks Data Intelligence Platform에 Spark Declarative Pipelines의 강력한 기능을 제공하는 Lakeflow Declarative Pipelines의 정식 출시를 발표하게 되어 기쁩니다. 이 파이프라인은 개방형 표준과 100% 소스 호환되므로 파이프라인을 한 번 개발하면 어디서든 실행할 수 있습니다. 또한 DLT 파이프라인과 100% 하위 호환되므로 기존 사용자는 코드를 다시 작성할 필요 없이 새로운 기능을 채택할 수 있습니다. Lakeflow Declarative Pipelines는 Databricks에서 완전 관리형 환경을 제공합니다. 즉, 서버리스 컴퓨팅을 직접 관리할 필요가 없고, 통합 거버넌스를 위한 Unity Catalog와 깊이 통합되어 있으며, 전용 데이터 엔지니어링용 IDE를 제공합니다.

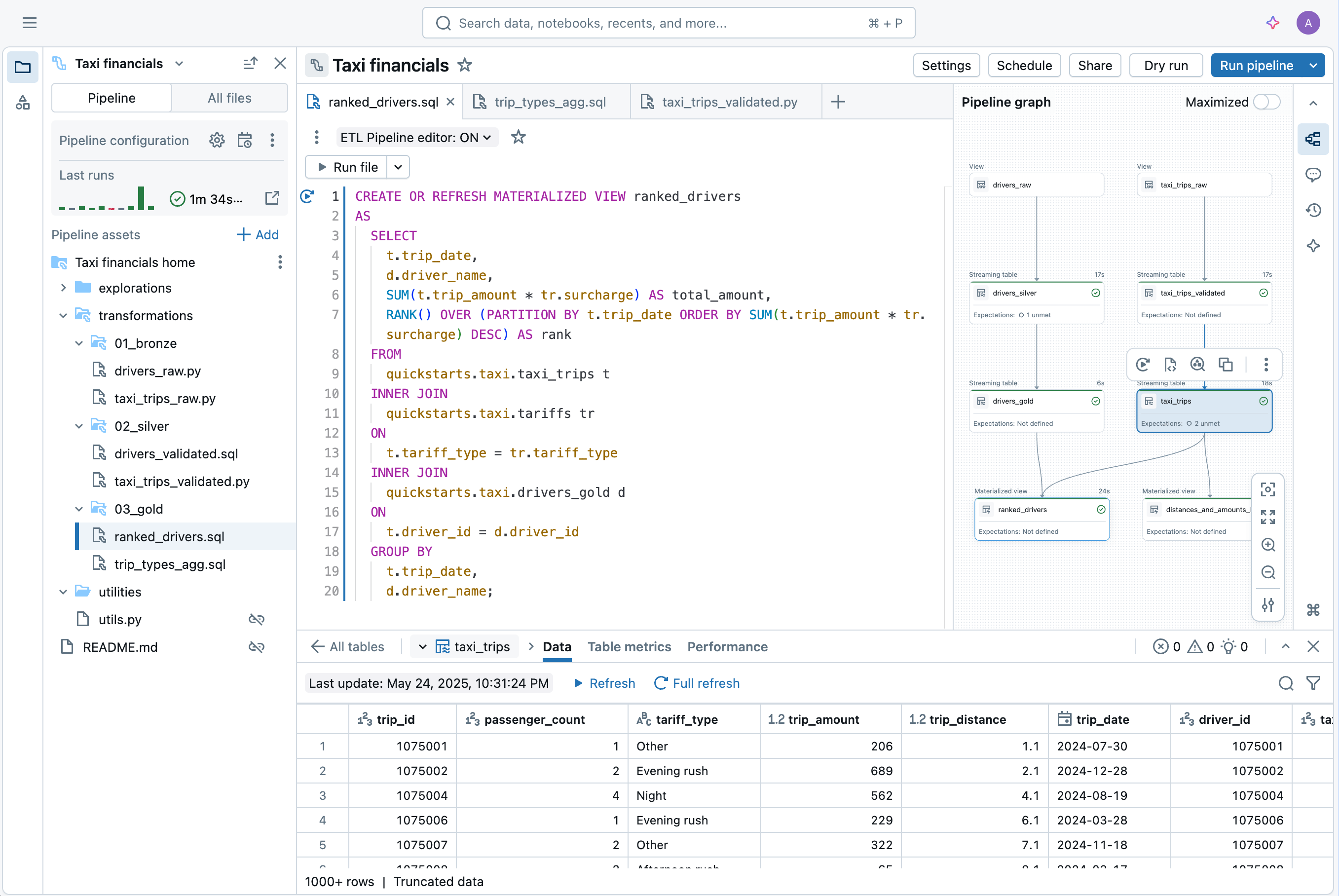

새로운 데이터 엔지니어링용 IDE는 파이프라인 개발 환경을 간소화하도록 구축된 현대적이고 통합된 환경입니다. 이 IDE에는 다음 기능이 포함됩니다.

- 코드와 DAG를 나란히 표시하고 종속성 시각화 및 즉각적인 데이터 미리보기를 제공합니다.

- 인라인으로 문제를 표시하는 상황 인식 디버깅 기능을 제공합니다.

- 빠른 개발을 위한 내장 Git 통합 기능을 제공합니다.

- AI 기반 작성 및 구성 기능을 제공합니다.

“새로운 편집기는 코드, 파이프라인 그래프, 결과, 구성 및 문제 해결 등 모든 것을 한 곳으로 모아줍니다. 더 이상 브라우저 탭을 전환하거나 컨텍스트를 잃어버릴 필요가 없습니다. 개발이 더 집중적이고 효율적으로 느껴집니다. 각 코드 변경의 영향을 직접 확인할 수 있습니다. 한 번의 클릭으로 정확한 오류 줄로 이동할 수 있어 디버깅이 빨라집니다. 모든 것이 연결됩니다. 코드와 데이터, 코드와 테이블, 테이블과 코드. 파이프라인 간 전환이 쉽고, 자동 구성된 유틸리티 폴더와 같은 기능은 복잡성을 제거합니다. 이것이 파이프라인 개발이 작동해야 하는 방식처럼 느껴집니다.” — Chris Sharratt, Data Engineer, Rolls-Royce

Lakeflow 선언형 파이프라인은 이제 Databricks에서 확장 가능하고, 거버넌스되며, 지속적으로 최적화된 파이프라인을 구축하는 통합 방식입니다. 코드 작업을 하든, 모든 기술 수준의 데이터 실무자가 안정적인 데이터 파이프라인을 구축할 수 있도록 지원하는 새로운 노코드 경험인 Lakeflow Designer를 통해 시각적으로 작업하든 마찬가지입니다.

Lakeflow Jobs: 통합 가시성으로 모든 워크로드에 대한 안정적인 오케스트레이션

Databricks Workflows는 수천 명의 고객이 매주 1억 1천만 개 이상의 작업을 실행하는 파이프라인을 위해 당사 플랫폼을 신뢰하며 오랫동안 중요한 워크플로를 오케스트레이션하는 데 사용되어 왔습니다. Lakeflow의 GA를 통해 Workflows를 Lakeflow Jobs로 발전시켜 이 성숙하고 네이티브인 오케스트레이터를 데이터 엔지니어링 스택의 나머지 부분과 통합하고 있습니다.

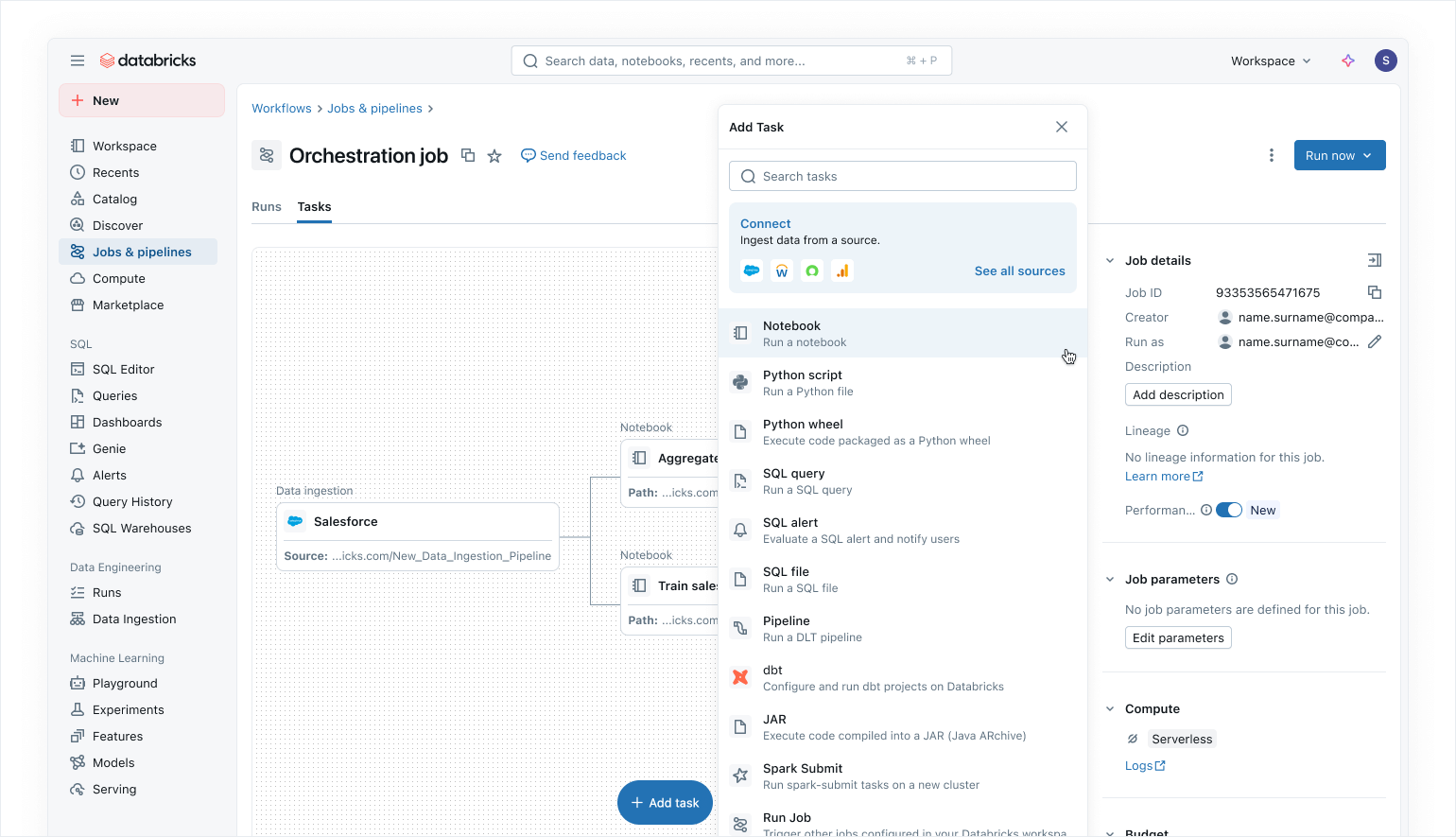

Lakeflow Jobs를 사용하면 다음과 같은 증가하는 기능 세트를 통해 Data Intelligent Platform의 모든 프로세스를 오케스트레이션할 수 있습니다.

- 선언형 파이프라인, 노트북, SQL 쿼리, dbt 변환을 포함하고 AI/BI 대시보드를 게시하거나 Power BI로 게시하는 흐름을 오케스트레이션하기 위한 포괄적인 작업 유형 컬렉션 지원.

- 조건부 실행, 루프 및 작업 또는 작업 수준에서의 매개변수 설정과 같은 제어 흐름 기능.

- 단순 예약 이상의 작업 실행 트리거. 파일 도착 트리거와 새 데이터가 있을 때만 작업이 실행되도록 보장하는 새로운 테이블 업데이트 트리거가 있습니다.

- 더 나은 성능과 더 낮은 비용을 위한 자동 최적화를 제공하는 서버리스 작업.

“서버리스 Lakeflow Jobs를 통해 지연 시간을 3~5배 개선했습니다. 이전에는 10분이 걸리던 작업이 이제 2~3분밖에 걸리지 않아 처리 시간이 크게 단축되었습니다. 이를 통해 플레이어와 코치에게 더 빠른 피드백 루프를 제공하여 실시�간에 가까운 통찰력을 얻고 실행 가능한 결정을 내릴 수 있도록 했습니다.” — Bryce Dugar, Data Engineering Manager, Cincinnati Reds

Lakeflow 통합의 일환으로 Lakeflow Jobs는 데이터 수집부터 변환 및 복잡한 오케스트레이션에 이르기까지 데이터 수명 주기의 모든 계층에 대한 엔드투엔드 가시성을 제공합니다. 다양한 도구 세트는 모든 모니터링 요구 사항에 맞춰집니다. 시각적 모니터링 도구는 한눈에 검색, 상태 및 추적을 제공하고, 쿼리 프로파일과 같은 디버깅 도구는 성능 최적화를 지원하며, 경고 및 시스템 테이블은 문제를 파악하고 기록적인 통찰력을 제공하며 데이터 품질 기대치는 규칙을 시행하고 데이터 파이프라인 요구 사항에 대한 높은 표준을 보장합니다.

Lakeflow 시작하기

Lakeflow Connect, Lakeflow 선언형 파이프라인 및 Lakeflow Jobs는 오늘날 모든 Databricks 고객에게 제공됩니다. Lakeflow에 대해 자세히 알아보려면 여기를 방문하고 공식 문서를 방문하여 다음 데이터 엔지니어링 프로젝트를 위해 Lakeflow를 시작하세요.

(이 글은 AI의 도움을 받아 번역되었습니다. 원문이 궁금하시다면 여기를 클릭해 주세요)

최신 게시��물을 이메일로 받아보세요

블로그를 구독하고 최신 게시물을 이메일로 받아보세요.