10 Mythen zur Migration von Data Warehouses, die die KI-Bereitschaft blockieren (und Ihr Plan für eine nahtlose Modernisierung)

Best Practices für die nahtlose Migration Ihres Data Warehouse in ein offenes Data Lakehouse

von Olga Romanova und George Komninos

- Migrieren Sie Ihr Data Warehouse für den ROI, nicht nur wegen der Kosten. Konsolidieren Sie Plattformen, nutzen Sie KI für Governed Data und legen Sie Altsysteme schneller still.

- Gehen Sie über die reine Code-Konvertierung hinaus. Nutzen Sie automatisierte Erkennung, wertbasiertes Descoping und rigorose Validierung, um Risiken und technische Schulden zu reduzieren.

- Modernisieren Sie pragmatisch. Kombinieren Sie Automatisierung mit Lift-and-Shift, um Zeitpläne zu beschleunigen und einen vorhersagbaren ROI zu erzielen.

Der Umstieg auf ein modernes Data Warehouse ist ein entscheidender Teil jeder KI-Readiness-Strategie eines Unternehmens. Doch ohne den richtigen Ansatz werden Data-Warehouse-Migrationen oft als risikoreiche, ressourcenintensive Initiativen wahrgenommen. Die größten Herausforderungen (die Verwaltung technischer Schulden, die Gewährleistung der Datenintegrität und die Minimierung von Ausfallzeiten) können ohne ein strukturiertes Framework überwältigend wirken.

Bei Databricks folgen nahtlose Migrationen einem bewährten, wiederholbaren Ansatz: Ermittlung und Rationalisierung, automatisierte Konvertierung, strenge Validierung, Optimierung für die Lakehouse-Architektur und frühzeitige Stilllegung von Altsystemen. Dennoch halten sich hartnäckig einige falsche Vorstellungen über die Komplexität und die Kosten der Umstellung.

Dieser Blog behandelt gängige Mythen, die den Prozess oft zum Scheitern bringen, und das Databricks-Framework für effiziente und nahtlose Migrationen.

Mythos 1: Unternehmen sollten sich bei der Planung einer Data-Warehouse-Migration nur auf die Kosten konzentrieren

Realität: Der Mehrwert entsteht durch die Ermöglichung von KI, operative Agilität und Plattformkonsolidierung

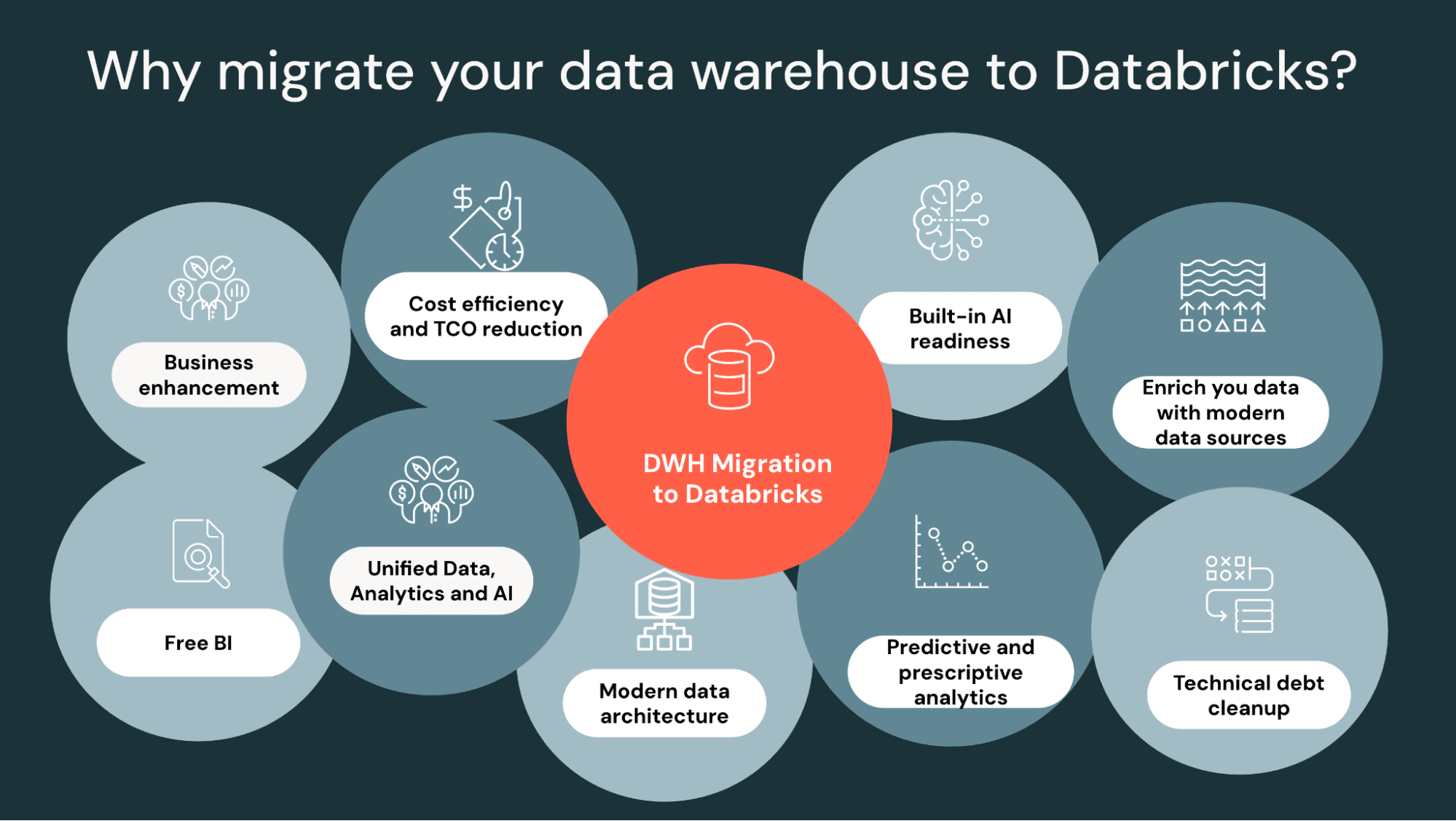

Obwohl Databricks durchgängig eine überlegene TCO liefert, die durch branchenübliche TPC-DS-Benchmarks validiert wird, ist die Kostensenkung nur eine Komponente des Wertversprechens. Unternehmen sollten sich auf den ROI der Migration für das Geschäft konzentrieren, einschließlich neuer Driver, die Legacy-Umgebungen nicht unterstützen können:

Plattformkonsolidierung und betriebliche Effizienz

Durch die Migration werden fragmentierte Data-Warehousing-Plattformen konsolidiert und die Datenlandschaft vereinfacht. Durch den Wechsel zu Databricks erzielte beispielsweise Williams eine 40-prozentige Reduzierung der TCO und revolutionierte gleichzeitig die Möglichkeiten zur Entscheidungsfindung.

KI und Intelligence ermöglichen

Die Migration ist der Katalysator für Ihre Daten, Agents und KI-Anwendungen. Sobald ihre Daten konsolidiert und verwaltet sind, können Unternehmen sie für KI-Anwendungsfälle nutzen und auf das Unternehmen zugeschnittene Datenprodukte erstellen. So erzielte Insulet beispielsweise eine Reduzierung der Verarbeitungskosten um 97 %. Noch wichtiger ist jedoch, dass das Unternehmen die Möglichkeit erhielt, Daten für Analytics und KI zu verarbeiten, was mit Altsystemen nicht in Scale gehandhabt werden konnte. DXC erreichte eine 30%ige Reduzierung der TCO durch die Vereinheitlichung seiner globalen Datenlandschaft, aber der Hauptgewinn war die Fähigkeit, die Zeit bis zur Gewinnung von Erkenntnissen von Monaten auf Tage zu reduzieren.

Plattform-EOL und Rechenzentrum-Exits

Viele Migrationen werden durch die Dringlichkeit von End-of-Life-Zyklen (EOL) veralteter Plattformen oder strategische Ausstiege aus Rechenzentren vorangetrieben, was Unternehmen in Richtung Cloud-nativer Zuverlässigkeit drängt.

Kostenlose BI freischalten

Databricks Lakehouse vereint sowohl KI- als auch BI-Workloads und ermöglicht Self-Service-Dienst Analytics durch natürliche Sprache mithilfe von AI/BI Genie. Demokratisieren Sie den Datenzugriff ohne die "Benutzersteuer" herkömmlicher BI-Tools. Durch die Migration zu Databricks Lakehouse sparen Unternehmen wie Novade (60 % TCO-Reduzierung) und Thrivent (46 % TCO-Reduzierung) nicht nur Geld, sondern reduzieren auch den Betriebsaufwand und verbessern die Zuverlässigkeit. Dieser Wandel ermöglicht Anwendungsfälle, die nur mit den erweiterten Analysen, Echtzeit-Einblicken und KI-gesteuerten Funktionen moderner Plattformen realisierbar sind, und schafft so Möglichkeiten für Innovationen und differenzierte Geschäftsergebnisse.

Mythos 2: Bei der Data-Warehouse-Migration geht es nur um die Konvertierung von SQL-Code

Realität: Eine erfolgreiche Migration erfordert eine architektonische Neuausrichtung, Governance und ein tiefgreifendes geschäftliches Engagement

Ein häufiger Fehler ist es, die Migration nur aus dem engen Blickwinkel der SQL-Übersetzung zu betrachten. Eine erfolgreiche Migration erfordert einen breiteren Blickwinkel, der Design, Governance, Validierung, Orchestrierung, Change Management und die geschäftliche Ausrichtung umfasst.

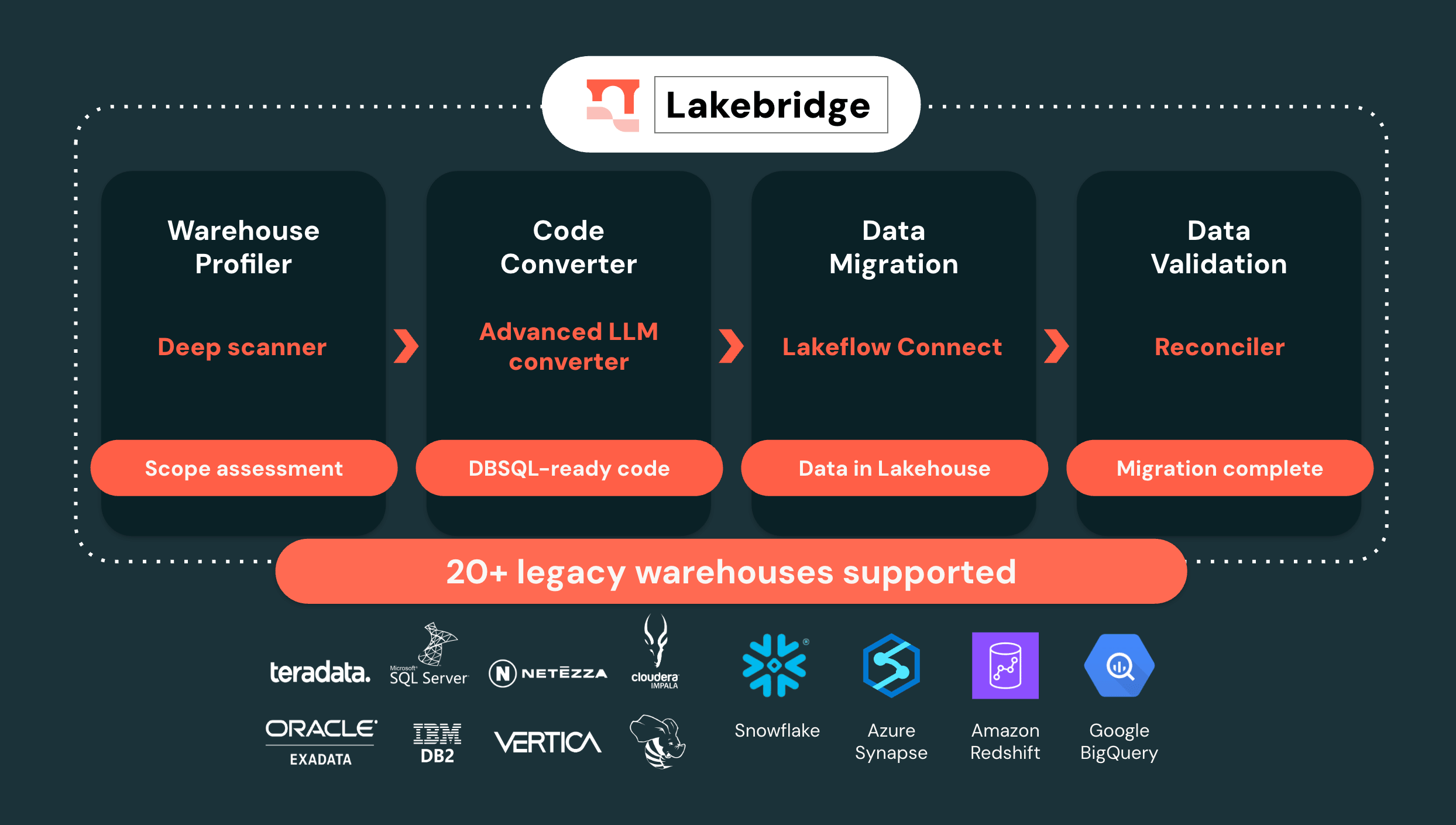

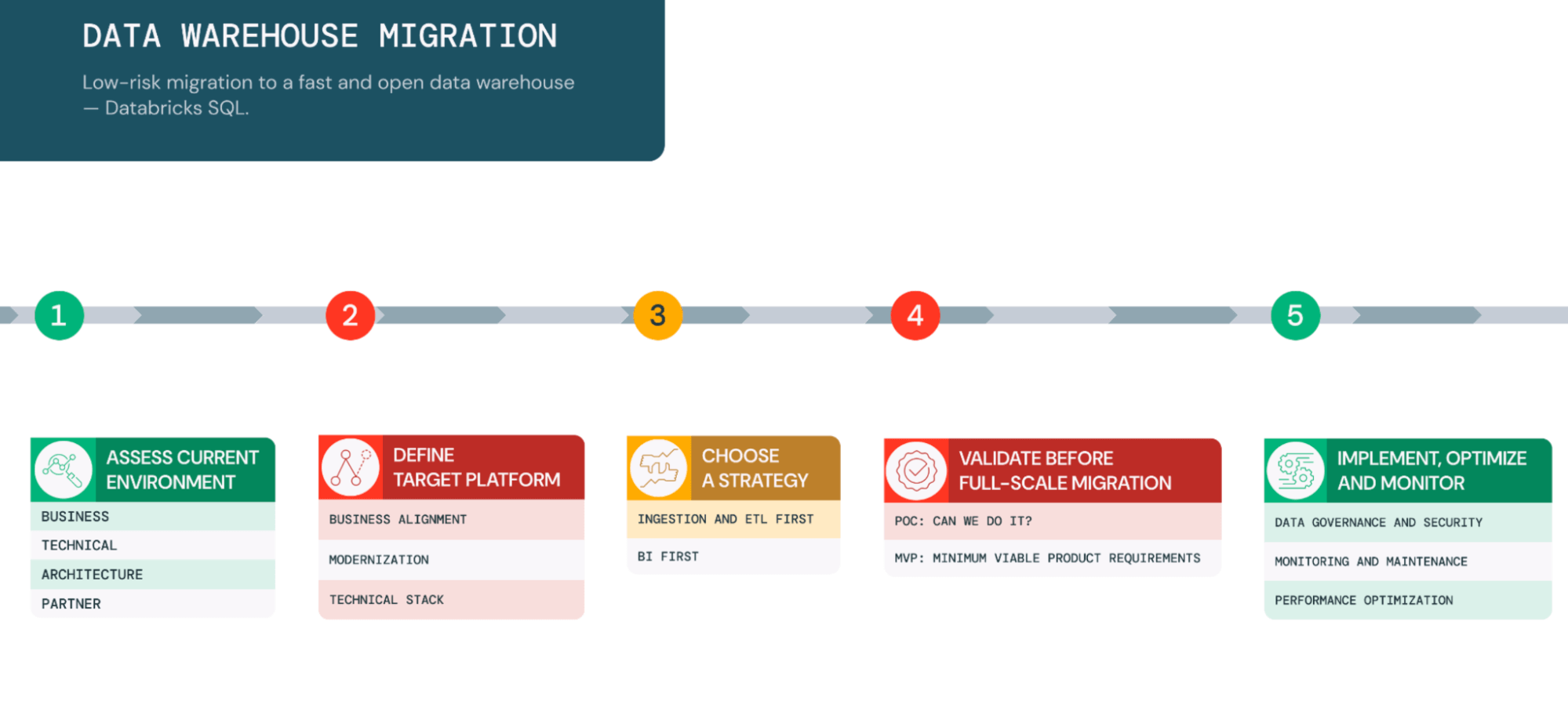

Während der Bewertungsphase sind der Migrationsplan und das Architekturdesign von entscheidender Bedeutung. Databricks nutzt Lakebridge als Key-Beschleuniger in dieser Phase, um die Erkennung und die Analysen der Objektnutzung zu automatisieren. So wird sichergestellt, dass Sie den vollen Umfang Ihrer Datenlandschaft verstehen, bevor auch nur eine einzige Tabelle verschoben wird, und Schätzungen überflüssig werden. Internes Know-how hilft, die Schätzungen für Aufwand und Zeitplan während der Planung zu automatisieren.

Während der Migration übersehen Unternehmen oft die „Validierungslücke“. Obwohl die Validierung 50–60 % des gesamten Migrationsaufwands ausmachen kann, ist dies kein Grund zur Sorge. Das Migrations-Framework von Databricks berücksichtigt die Validierung ausdrücklich als eine erstklassige Phase, wobei automatisierte Abgleichs- und Lineage-Tools in den Prozess integriert sind.

Bei der Migration zu einem neuen Orchestrierungs-Framework muss die bestehende Logik aufgrund von Unterschieden bei Triggern, Fehlerbehandlung und Skalierbarkeitsaspekten auf der neuen Plattform oft neu ausgerichtet, neu gestaltet oder neu implementiert werden.

Eine erfolgreiche Migration hängt von mehr als nur technischem Fachwissen ab; sie erfordert eine Abstimmung mit dem Unternehmen, der Governance und dem Change Management. Deshalb arbeiten wir bei Databricks während der Validierungsphase mit den Geschäftsteams zusammen, um sicherzustellen, dass wir ihre SLAs erfüllen. Das Fachwissen der Business-Stakeholder ist entscheidend für die Interpretation von Ergebnissen, das Erkennen von Abweichungen und die Zertifizierung, dass das modernisierte System die nachgelagerten Reporting- und Analyseanforderungen unterstützt.

Mythos 3: Alle Legacy-Objekte müssen migriert werden

Realität: Eine „Value-First“-Prüfung deckt massive Redundanzen auf

Der Versuch, jedes Legacy-Objekt zu migrieren – einschließlich veralteter Tabellen und obsoleter Stored Procedures – führt zu technischen Schulden, einem verlängerten Zeitplan und unnötigen Kosten. Branchen-Benchmarks deuten darauf hin, dass ein erheblicher Teil der Legacy-Data-Warehouse-Objekte häufig redundant oder ungenutzt ist. Durch die Bewertung von Geschäftsanwendungsfällen und die vorrangige Identifizierung kritischer Workloads erzielen Unternehmen einen deutlich schnelleren Return on Investment.

Das Databricks-Migrationsframework empfiehlt einen gründlichen Ermittlungsprozess, der die Ausgliederung unnötiger Assets (Vermögenswerte) ermöglicht, und ein erfolgreiches Migrationsdesign stellt die angemessene Zusammenführung oder Modernisierung unter Nutzung von Automatisierung sicher.

Mythos 4: Automatisierung garantiert eine erfolgreiche Migration

Realität: Erfolgreiche Automatisierung erfordert eine pragmatische Balance und spezialisierte Tools.

Der Einsatz einer rein toolbasierten Migration verlagert die technischen Schulden des Altsystems lediglich auf die moderne Plattform. Eines der Migrationsziele ist der Abbau technischer Schulden.

Bei Databricks betrachten wir Migrationen ganzheitlich, wobei Lakebridge und Accelerators eine wichtige Rolle bei der Migration spielen. Es ist entscheidend zu evaluieren, wie die Automatisierung die Migration beschleunigen könnte. Die Quantifizierung der Beschleunigungsgrade dient als Grundlage für Entscheidungen über den Migrationsprozess und optimiert die Migrationsergebnisse, während gleichzeitig die Beseitigung technischer Schulden sichergestellt wird.

In der Praxis ist jede gut durchgeführte Migration eine Gratwanderung zwischen der Modernisierung von Komponenten mit großer Wirkung wie Architektur, Frameworks und alter Codebasis und dem "Lift-and-Shift" von modernem Code und Reporting-Assets (Vermögenswerte). Natürlich muss mancher nicht performanter Code einem Refactoring unterzogen werden, aber das Ziel ist es, den Modernisierungsaufwand auf ertragreiche, langfristige Investitionen mit hohen Renditen zu konzentrieren, wie z. B. die ressourcenintensivsten Abfragen, während die Automatisierung genutzt wird, um den Großteil der standardmäßigen Transformationen zu bewältigen. Dieser Ansatz, kombiniert mit dem Know-how von Professional Dienste, ermöglicht eine Automatisierung von bis zu 90 %.

Mythos 5: Der Erfolg einer technischen Migration hängt ausschließlich von technischem Fachwissen und den Konversionsraten der Tools ab

Realität: Erfolg erfordert die Abstimmung mit Fachexperten (SMEs), ein Center of Excellence (COE) und das richtige Tooling.

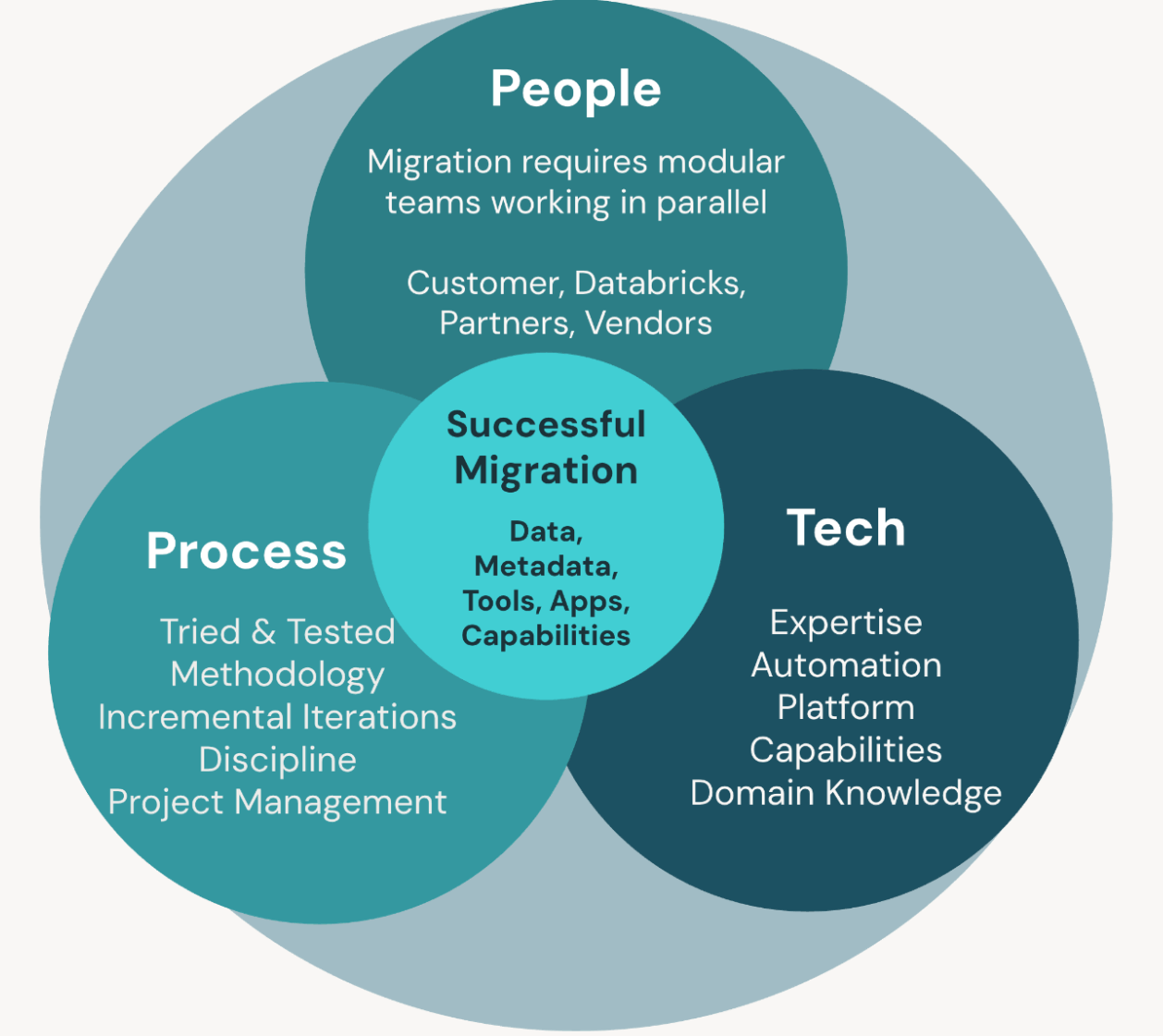

Technische Teams gehen oft davon aus, dass die Anforderungen von Altsystemen genau dokumentiert sind. In der Praxis ist die Einbeziehung von Fachexperten (SMEs) aus dem Geschäftsbereich entscheidend, um die zugrundeliegende Logik zu validieren und hochwertige Anwendungsfälle zu priorisieren. Über technische Überlegungen hinaus verfolgt Databricks bei der Förderung der Einführung des Lakehouse eine ganzheitliche „Mensch, Prozess, Plattform“-Mentalität.

- Die Menschen stehen im Mittelpunkt – wir befähigen funktionsübergreifende Teams und fördern die Zusammenarbeit zwischen technischen und geschäftlichen Stakeholdern, um die Abstimmung und den Wissenstransfer während der gesamten Migration sicherzustellen.

- Der Prozess ist entscheidend für nachhaltige Veränderungen. Unsere Standardlieferung umfasst strukturierte Methoden, Accelerators und ein robustes Change Management, was es Unternehmen ermöglicht, Best Practices zu verankern und Workflows für moderne Datenumgebungen anzupassen.

- Die Plattform -Dimension nutzt die flexiblen Funktionen von Databricks und setzt eine Mischung aus LLMs, regelbasierten und deterministischen Engines ein, die auf die Komplexität des zu konvertierenden Codes und die einzigartige Umgebung des Kunden zugeschnitten sind. Um diesen Wert in Scale aufrechtzuerhalten, unterstützen wir die Schaffung eines CoE als Drehscheibe für Innovation und Governance und stärken so die kontinuierliche Verbesserung und operative Exzellenz. Dieser integrierte Ansatz stellt sicher, dass Unternehmen nicht nur ihre Daten migrieren, sondern auch die Fähigkeiten, Prozesse und technologischen Grundlagen aufbauen, die erforderlich sind, um die Vorteile einer Lakehouse-Plattform voll auszuschöpfen.

Mythos 6: Datenvalidierung ist trivial

Realität: Präzision und Abgleich sind hochkomplex und erfordern definierte SLAs

Die Validierung komplexer Datentypen in Altsystemen (z. B. Oracle oder Teradata) und deren Abgleich mit Lakehouse-Formaten erfordert mehr als nur einfache Zeilenzählungen. Bei der Validierung von Daten und Logik ist es wichtig, zwei Arten von Logik zu unterscheiden:

- Deterministische Logik: Erzeugt bei gleicher Eingabe immer die gleiche Ausgabe, was eine unkomplizierte, wiederholbare Validierung ermöglicht.

- Nicht-deterministische Logik: Kann bei verschiedenen Ausführungen leicht unterschiedliche Ergebnisse liefern. Die Validierung dieser Artefakte erfordert einen starken Geschäftskontext, um akzeptable Bereiche oder Muster zu definieren, anstatt sich auf exakte Übereinstimmungen zu verlassen.

Diese Komplexität ist nicht nur für Altsysteme relevant, sondern auch für Change Data Capture (CDC), Snapshotting und die In-Place-Automatisierung für inkrementelle Ladevorgänge und Streaming. Da Produktionsdaten dynamisch sind, ist die Definition eines SLA (z. B. die Forderung, dass die Validierung zu 99,x % genau sein muss) der Key für den Erfolg des Abgleichs. Die Zusammenarbeit mit Professional Services garantiert, dass ein detaillierter Validierungsplan vorhanden ist und befolgt wird und dass strenge Tools für den Abgleich und die Nachverfolgung der Datenherkunft (Lineage) verwendet werden, um die Datenintegrität während des gesamten Migrationslebenszyklus aufrechtzuerhalten.

Mythos 7: Die Modernisierung ist von Natur aus teurer und zeitaufwändiger als die Wartung von Altsystemen

Realität: Eine frühzeitige Stilllegung führt zu einem schnellen ROI

Während Migrationen eine anfängliche Kapital- und Zeitinvestition erfordern, ist die "Betriebssteuer" von Altsystemen oft die größte Belastung für die IT-Budgets. Durch die Nutzung von Beschleunigungs-Frameworks und die Planung einer schnellen Stilllegung von alten Lizenzen erzielen Unternehmen oft einen positiven ROI innerhalb der ersten 12 Monate.

Eine zusätzliche Rechtfertigung für die Investition ist, dass die Migration die Einführung neuer Anwendungsfälle und Funktionen ermöglicht, die auf der alten Plattform nicht realisierbar sind. Die Modernisierung des Stacks reduziert den langfristigen Wartungsaufwand und befähigt Engineering-Teams, über das bloße „Am-Laufen-Halten“ hinauszugehen und sich auf die Förderung von KI-gestützten Innovationen zu konzentrieren. Nach der Migration sind Entwickler von der Verwaltung der alten Plattform befreit und können sich auf produktivere und strategischere Aufgaben konzentrieren, die einen größeren Geschäftswert liefern.

Mythos 8: Die Skalierung der Plattform erfordert eine massive Aufstockung der Engineering-Ressourcen

Realität: Der Erfolg wird durch ein zertifiziertes Partner-Ökosystem und interne Befähigung vorangetrieben

Während traditionelle Ansätze zur Data-Warehouse-Migration oft große Teams zur Bewältigung komplexer Arbeitsabläufe erfordern, haben moderne Tools und Automatisierung diesen Bedarf drastisch reduziert. Zertifizierte Migrations-Partner mit Professional Services stellen Qualität sicher, bringen umfassende Erfahrung ein und nutzen bewährte Methoden und Beschleuniger, die auf Databricks zugeschnitten sind, was gängige Herausforderungen direkt angeht und unnötigen Engineering-Aufwand vermeidet. Ihre Expertise ermöglicht es dem internen Team eines Kunden, sich auf geschäftskritische Aktivitäten zu konzentrieren, anstatt auf die Feinheiten des Refactorings von Legacy-Workloads oder der Behebung nuancierter Kompatibilitätsprobleme.

Darüber hinaus ist der Migrationsprozess so konzipiert, dass er minimale Disruptionen gewährleistet, wobei Change Management und Enablement integriert sind. Interaktive Workshops, praktische Trainings und Dokumentationen stärken die Benutzer, sodass das interne Team nach Projektabschluss über die Fähigkeiten und das Wissen verfügt, um die Plattform unabhängig zu betreiben, zu optimieren und zu erweitern. Mit diesem Modell realisieren Unternehmen fortlaufende Agilität und Kosteneffizienz ohne die Altlast eines großen Migrationsteams.

Mythos 9: Lift and Shift funktioniert mit Databricks nie

Realität: Lift and Shift kann bei engen Zeitplänen der beste Weg sein

Während eine vollständige Modernisierung sofort erweiterte Funktionen ermöglicht, erlaubt ein Lift-and-Shift-Ansatz es Unternehmen, Altsysteme schnell außer Betrieb zu nehmen und das Betriebsrisiko während der Umstellung zu reduzieren. Lift-and-Shift ist der empfohlene Migrationsansatz, wenn die Haupt-Driver die Migrationszeit, die einfache und genaue Planung oder die Kritikalität nachgelagerter Anwendungen sind, die von einem stabilen Schema und Verhalten abhängen.

In der Praxis verfolgen die meisten Programme eine hybride Strategie: Zuerst migrieren, um zu stabilisieren, und dann schrittweise modernisieren. Ein gängiges Muster ist „Ingestion and ETL first“, um langlebige Pipelines, Governance und Beobachtbarkeit als Grundlage zu schaffen, bevor Modelle, Performance und Kosten optimiert werden. Es ist nicht ungewöhnlich, Anwendungsfälle als „kritisch/immer aktiv“ und „nice to have“ zu klassifizieren, Erstere per Lift-and-Shift zu migrieren, um die Zuverlässigkeit zu erhalten, und Letztere zu modernisieren, um neue Funktionen freizuschalten.

Mythos 10: Migrationskosten sind immer unvorhersehbar

Realität: Bewährte Frameworks und Validierungsschritte sorgen für Vorhersehbarkeit

Eines der häufigsten Missverständnisse besteht darin, eine Migration ausschließlich unter Kostenaspekten zu betrachten. Obwohl Migrationen tatsächlich – direkt oder indirekt – finanzielle Investitionen erfordern, sollten sie als strategische Wegbereiter für neue Möglichkeiten betrachtet werden. Mit einem sorgfältig ausgearbeiteten Business Case ist ein schneller und positiver Return on Investment (ROI) nicht nur erreichbar, sondern zu erwarten.

Migration ist komplex, aber sie muss nicht finanziell riskant sein. Durch den Einsatz von Strategien wie Proof of Concept (PoCs) oder Minimum Viable Products (MVPs) während der Validierungsphase können Unternehmen die Machbarkeit testen und den Wert schnell nachweisen, bevor sie sich zu einem vollständigen Rollout verpflichten. Durch die Priorisierung der richtigen Anwendungsfälle auf der Grundlage des Geschäftswerts und die frühzeitige Erschließung neuer Funktionen können Teams die Wirksamkeit des Modells beweisen, ohne das gesamte Budget zu riskieren.

Das bewährte Migrations-Framework von Databricks, kombiniert mit Beschleunigern wie Lakebridge und tiefgreifendem Fachwissen, hilft, Migrationen End-to-End auf die effizienteste Weise durchzuführen. Dieser strukturierte Ansatz reduziert die „Validierungslücke“ und minimiert den manuellen Aufwand, was letztendlich die erforderliche Teamgröße, den Zeitplan und die damit verbundenen Kosten reduziert.

Schließlich unterstützt unser kommerzielles Ökosystem die finanzielle Vorhersehbarkeit. Durch starke Partnerschaften mit Hyperscalern bietet Databricks kosteneffiziente Unterstützung bei der Ausführung. Wir unterstützen Kundenmigrationen aktiv finanziell, indem wir in zertifizierte Partner investieren und Sicherheit durch professionelle Dienstleistungen bieten, um sicherzustellen, dass Ihr Weg zum Lakehouse kaufmännisch ebenso solide wie technisch robust ist.

Erste Schritte

Erfolgreiche Migrationen sind kein Endzustand. Sie schaffen eine Grundlage für Serverless Analytics, gesteuerte KI und schnellere Innovationen – ohne parallele Systeme unterhalten zu müssen.

Migrationen können eine Herausforderung sein. Es wird immer Kompromisse geben, die abgewogen werden müssen, und unerwartete Probleme und Verzögerungen, die zu bewältigen sind. Sie benötigen bewährte Partner und Lösungen für die Aspekte Menschen, Prozesse und Technologie der Migration. Wir empfehlen, den Experten von Databricks Professional Services und unseren zertifizierten Partnern zu vertrauen, die über umfassende Erfahrung in der zeitnahen Bereitstellung hochwertiger Migrationslösungen verfügen. Kontaktieren Sie uns, um mit Ihrer Migrationsbewertung zu beginnen.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.