Ankündigung der automatischen Veröffentlichung für Power BI

Halten Sie Berichte und Dashboards ganz einfach mit Datenänderungen synchron

von Adam Wasserman und Alex Guo

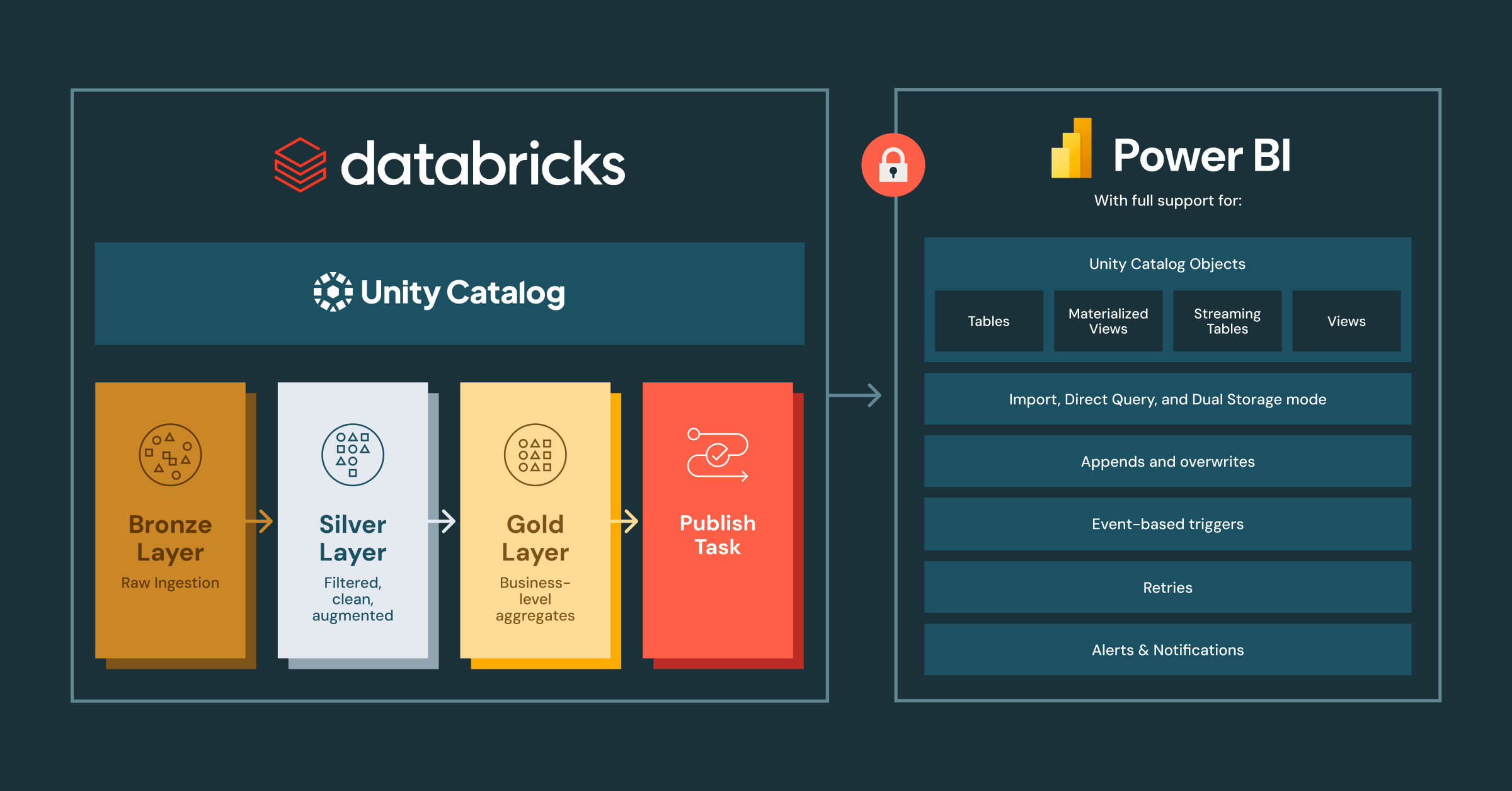

- Databricks Workflows unterstützt jetzt einen neuen Aufgabentyp für Power BI

- Unterstützung für das Aktualisieren und Neuladen von Semantikmodellen in den Modi Import/DirectQuery/Dual Storage

- Die Power BI-Aufgabe integriert sich nativ in Unity Catalog

Wir freuen uns, die öffentliche Vorschau des Microsoft Power BI-Aufgabentyps in Databricks Workflows bekannt zu geben, verfügbar auf Azure, AWS und GCP.

Mit diesem neuen Aufgabentyp können Benutzer jetzt Power BI-Semantikmodelle direkt aus Databricks aktualisieren und neu laden. Dies führt zu einer besseren Gesamtkostenbilanz, höherer Effizienz und stellt sicher, dass die Daten für Power BI-Berichts- und Dashboard-Benutzer aktuell sind.

Hauptvorteile umfassen:

- Direkte Integration: Veröffentlichen Sie Datasets aus Unity Catalog direkt aus Datenpipelines in Power BI.

- Aktualisieren Sie Power BI, wenn sich Ihre Daten ändern: Reduzieren Sie die Kosten für das Neuladen erheblich, indem Sie Semantikmodelle nur dann aktualisieren, wenn sich Daten ändern.

- Aktualität der Daten für BI: Liefern Sie aktuelle Erkenntnisse, indem Sie Änderungen an zugrunde liegenden Tabellen und deren Beziehungen automatisch übertragen.

Automatisieren Sie die Datenintegration aus Unity Catalog mit Power BI

Mit der Power BI-Aufgabe können Sie jetzt Power BI-Semantikmodellaktualisierungen und -neuladungen direkt aus Databricks Workflows automatisieren. Dies macht den Wechsel zwischen Databricks und Power BI überflüssig und optimiert den Prozess, Ihre Daten für die Visualisierung und Analyse in Power BI verfügbar zu machen.

Power BI-Aufgaben unterstützen vollständig Unity Catalog-Datenobjekte, einschließlich Tabellen, Ansichten, materialisierten Ansichten und Streaming-Tabellen. Das Beste daran: Sie können Power BI-Semantikmodelle basierend auf Unity Catalog-Datenobjekten aus mehreren Schemata und Katalogen erstellen.

Die native Integration zwischen Unity Catalog, Power BI und Microsoft Entra ID bedeutet erstklassige Sicherheit, Governance und Beobachtbarkeit. Power BI-Semantikmodelle können so konfiguriert werden, dass sie OAuth mit Single Sign-On verwenden, um sicherzustellen, dass Berechtigungen für jede Dashboard-Abfrage eingehalten werden, zusammen mit der gesamten Bandbreite an Governance- und Beobachtbarkeitsfunktionen, die Unity Catalog bietet. Diese Integration verbessert die Sicherheit und Compliance, indem sie nahtlose Authentifizierung, Autorisierung und Datenzugriffskontrolle über Ihre Databricks- und Power BI-Umgebungen hinweg bietet.

Die gesamte Leistung von Databricks Workflows und Power BI

Power BI-Aufgaben sind in Databricks Workflows integriert, sodass Sie dessen erweiterte Orchestrierungs- und Überwachungsfunktionen nutzen können. Das bedeutet, dass Sie leistungsstarke Funktionen wie Aufgabenabhängigkeiten, Zeitpläne/Trigger, Wiederholungsversuche und Benachrichtigungen auf Datenpipelines anwenden können, die Power BI-Aufgaben verwenden.

Power BI-Aufgaben unterstützen die Veröffentlichung, Aktualisierung und Neuladung von Semantikmodellen in den Modi Import, Direct Query und Dual Storage, was Ihnen die volle Flexibilität bietet, Leistung und Sicherheit auszubalancieren.

Erweiterbarkeit steht bei Power BI-Aufgaben im Vordergrund. Sie können mit Power BI-Aufgaben visuell in der Databricks Jobs-Benutzeroberfläche sowie programmgesteuert über die Jobs API und Databricks Asset Bundles arbeiten.

So funktioniert's

Szenario: Sie haben eine bestehende Datenpipeline für die Einzelhandelsanalyse, die Daten aus Quelldatenbanken mithilfe einer Pipeline-Aufgabe erfasst und Transformationen und Aggregationen mithilfe einer Notebook-Aufgabe anwendet, was zu einer Sammlung von BI-bereiten Tabellen führt. Sie haben die Anforderung erhalten, sicherzustellen, dass ein Power BI-Semantikmodell mit diesen Daten synchron bleibt, wenn sie sich im Laufe der Zeit ändern.

Das Erstellen einer Power BI-Aufgabe ist einfach. Alles, was Sie tun müssen, ist:

- Navigieren Sie zu Ihrem vorhandenen Job

- Fügen Sie eine Power BI-Aufgabe zum vorhandenen Job hinzu und wählen Sie ein SQL-Warehouse aus

- Wählen Sie eine Power BI-Verbindung, einen Arbeitsbereich und ein Semantikmodell aus

- Wählen Sie den Import- oder DirectQuery-Modus aus

- Wählen Sie Unity Catalog-Datenobjekte aus

- Legen Sie eine Authentifizierungsmethode fest

- Speichern Sie die Aufgabe

Wenn Ihre vorhandene Datenpipeline das nächste Mal ausgeführt wird, wird Ihr Power BI-Semantikmodell automatisch aktualisiert, wenn sich Ihre Daten ändern.

Wenige Sekunden nach erfolgreichem Abschluss Ihres Jobs wird Ihr Dataset in Power BI aktualisiert und steht für die Berichterstellung und Analyse bereit.

Erste Schritte mit Power BI-Aufgaben

Mit den Power BI-Aufgaben, die jetzt in der öffentlichen Vorschau verfügbar sind, können Sie Daten-Ingenieure befähigen, ihre Datenpipelines zu beschleunigen und ihre geschäftsfreundlichen Datasets nahtlos in Power BI zu integrieren.

Wir sind gespannt, wie Sie Power BI-Aufgaben nutzen werden, und ermutigen Sie, sie noch heute auszuprobieren. Um loszulegen, besuchen Sie bitte die Power BI-Aufgabendokumentation.

Möchten Sie Ihre Power BI + Azure Databricks-Integration vertiefen?

Schauen Sie sich Teil 1 und Teil 2 unserer Konnektivitätsserie an:

- Teil 1: Power BI Service-Verbindungen zu Azure Databricks mit privatem Networking

- Teil 2: Leistungskonfigurationen für die Verbindung von PBI zu einem privaten Link Azure Databricks-Arbeitsbereich

Gemeinsam bieten diese Blogs wesentliche Best Practices zur Optimierung von Sicherheit und Leistung bei der Verbindung von Power BI mit Azure Databricks.

Das Databricks-Team ist stets bestrebt, die Power BI-Integrationserfahrung zu verbessern, und freut sich über Ihr Feedback!

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.