Ankündigung der öffentlichen Vorschau von Lakeflow Designer

Eine No-Code-, KI-native und vollständig verwaltete Erfahrung für die Datenvorbereitung auf Databricks

von Jason Messer, Emanuel Zgraggen, V Maharajh, Matt Jones und Tracy Yang

- Lakeflow Designer ist jetzt in der öffentlichen Vorschau verfügbar und bietet Databricks-Benutzern eine visuelle, No-Code-Möglichkeit, Daten vorzubereiten und zu analysieren, die KI-nativ ist.

- Lakeflow Designer wurde direkt auf Databricks aufgebaut und wird von Unity Catalog verwaltet. Es behält die Daten an ihrem Speicherort bei und bietet von Anfang an Lineage, Berechtigungen und produktionsbereiten Code.

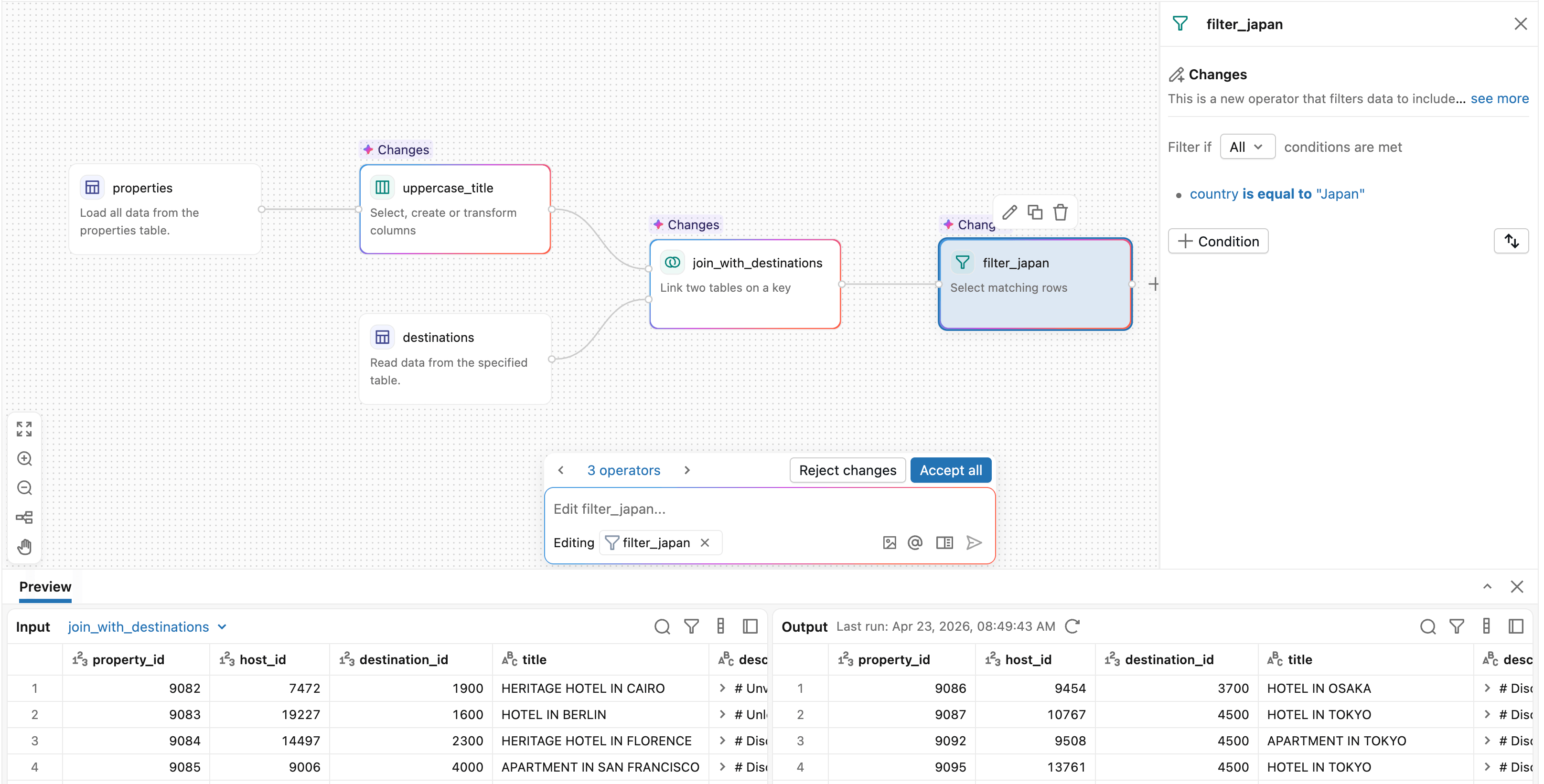

- Lakeflow Designer erleichtert die Überprüfung und das Vertrauen in KI-generierte Transformationen, indem die Arbeit in visuelle Operatoren mit schrittweisen Vorschauen auf Datenänderungen unterteilt wird.

Wir haben Lakeflow Designer letztes Jahr auf dem Data and AI Summit vorgestellt. Seitdem haben wir eng mit frühen Kunden zusammengearbeitet, um das Produkt zu verfeinern und besser zu verstehen, wo es am nützlichsten ist. Heute freuen wir uns, die Public Preview von Lakeflow Designer anzukündigen. Lakeflow Designer beseitigt eines der größten heutigen Datenhindernisse: die technische Eintrittsbarriere.

Was ist Lakeflow Designer?

Lakeflow Designer ist eine visuelle, No-Code-Erfahrung, die KI-nativ für Datenaufbereitung und -analyse ist. Direkt in Databricks integriert, ermöglicht es Analysten, Domänenexperten und anderen weniger technisch versierten Benutzern, Daten über eine Drag-and-Drop-Oberfläche und natürliche Sprache aufzubereiten und zu erkunden.

Jeder Schritt in Lakeflow Designer wird als Operator dargestellt, was den Benutzern ein klares Bild davon gibt, wie sich die Daten während des gesamten Workflows ändern. Dies erleichtert das Erstellen, Validieren und Verstehen von Transformationen während der Arbeit.

Lakeflow Designer erweitert die Leistung von Databricks Lakeflow auf eine breitere Benutzergruppe und ermöglicht die No-Code-Datenaufbereitung, während im Hintergrund weiterhin produktionsreifer Code generiert wird. Workflows können über Lakeflow Jobs geplant und operationalisiert werden, wodurch der Übergang von der interaktiven Datenaufbereitung zu Produktionspipelines erleichtert wird.

Lakeflow Designer erweitert die Autonomie von Business-Teams und ermöglicht die effiziente Erstellung von Datenansichten durch natürliche Sprache und Best Practices, während gleichzeitig Datenkonsistenz, Governance und Zuverlässigkeit gewährleistet werden. — Phelipe Naman, Data & Analytics Architecture Tech Lead, Sabesp

Was unterscheidet Lakeflow Designer?

Self-Service-Datenaufbereitung ist keine neue Idee, aber bestehende Tools sitzen außerhalb Ihrer zentralen Datenplattform. Das bringt Kompromisse mit sich:

- Die Trennung zwischen dem Datenaufbereitungstool und der Datenplattform schafft Governance-Lücken und zusätzlichen IT-Aufwand

- KI ist nur aufgesetzt und Vorschläge sind generisch, da das Tool kein echtes Verständnis der Daten hat

- Visuelle Workflows sind schwer zu produzieren, da die Logik oft in domänenspezifischen Sprachen oder der Benutzeroberfläche gefangen ist

- Pro-Benutzer-Lizenzierung ist teuer und schränkt den Zugriff ein

Lakeflow Designer verfolgt einen anderen Ansatz.

1. Nativ auf Databricks aufgebaut für Governance und Einfachheit

Lakeflow Designer läuft direkt dort, wo Ihre Daten bereits liegen – auf Databricks. Es ist nicht notwendig, Daten in ein separates Tool oder auf Ihren lokalen Rechner zu verschieben. Die Daten bleiben erhalten und werden von Anfang an durch Unity Catalog verwaltet, während der gesamte Daten-Stack vereinfacht wird. Anstatt ein separates Low-Code-Tool mit eigener Lizenzierung, Berechtigungen und Verwaltungsmodell zu verwalten, können Organisationen Self-Service-Arbeiten direkt innerhalb von Databricks ermöglichen.

KPMG UK bietet Audit- und Assurance-Dienstleistungen für Tausende von Unternehmen an – jedes mit einer anderen Datenlandschaft. Die Ausstattung unserer Praktiker mit Lakeflow Designer ermöglicht einen visuellen, Low-Code- und KI-gestützten Workflow, der unsere Fähigkeit skaliert und demokratisiert, komplexe und vielfältige Datensätze in aussagekräftige Erkenntnisse zu übersetzen. — Mark Wallington, Audit Data and AI Partner, KPMG UK

Beginnen Sie sofort mit nativen Quelldaten zu arbeiten

2. Von Grund auf für KI entwickelt und so konzipiert, dass KI überprüfbar ist

Lakeflow Designer basiert auf Genie Code, dem nativen agentenbasierten Coding-Assistenten von Databricks. KI ist hier kein Zusatz. Sie ist Kernbestandteil der Funktionsweise des Produkts. Beschreiben Sie einfach, was Sie in einfachem Englisch wünschen, und Genie Code kann den Workflow direkt generieren oder ändern.

KI-native Autorenschaft, die einfach funktioniert

Da Lakeflow Designer direkt in die Databricks-Arbeitsumgebung integriert ist, kann Genie Code mehr als nur Spaltennamen analysieren. Es kann Unity Catalog-Metadaten, Tabellenbeschreibungen, Datenherkunft, Beliebtheit und Beispielabfragen verwenden, um die semantische Bedeutung von Daten zu verstehen und die richtigen Assets für eine Aufgabe zu identifizieren. Dies führt zu kontextbezogeneren und genaueren Vorschlägen als bei Tools, die nur das Schema sehen.

Diese Architektur eröffnet auch die Tür für agentenbasierteres Verhalten. Anstatt einmal ein statisches Ergebnis zu generieren, kann das System eine Transformation ausführen, die Ausgabe überprüfen und bei Bedarf iterieren. Wenn beispielsweise ein Join fehlschlägt oder keine Zeilen zurückgibt, kann Genie Code das Ergebnis auswerten und einen alternativen Ansatz versuchen.

Vielleicht ebenso wichtig ist, dass Lakeflow Designer KI-generierte Transformationen leicht verständlich und überprüfbar macht, indem es sie in diskrete visuelle Operatoren mit Datenvorschau in jedem Schritt unterteilt. Sie können genau sehen, was sich geändert hat, wo Zeilen gefiltert wurden, wie ein Join aufgelöst wurde und wie die Ausgabe aussieht, bevor Sie fortfahren.

Lakeflow Designer ist ein wichtiger Wegbereiter für die Skalierung von Data Engineering über das Kern-Technikteam auf Databricks hinaus. Durch die Bereitstellung einer visuellen Benutzeroberfläche, die mit Funktionen für natürliche Sprache integriert ist, hilft es, den „SQL-Engpass“ zu reduzieren, sodass Business-Teams Pipelines mit größerer Autonomie prototypisieren und iterieren können. Dies geht über die Benutzerfreundlichkeit hinaus – es geht um organisatorische Ausrichtung. Wenn Transformationen visuell und zugänglich sind, verringert sich die Lücke zwischen Geschäftsabsicht und technischer Umsetzung, was den Weg von Rohdaten zu umsetzbaren Erkenntnissen beschleunigt. — Matheus Polycaropo, Data Engineering Leader, Serasa Experian

3. Jede visuelle Transformation generiert echten, produktionsreifen Code

Jede Transformation in Lakeflow Designer generiert im Hintergrund produktionsreifen Python-Code. Dieser Code kann überprüft, in Git versioniert und direkt in größere Produktions-Workflows integriert werden. Im Laufe der Zeit wird Designer auch weitere native Produktionsausgaben unterstützen, wie z. B. materialisierte Ansichten. Dies reduziert letztendlich eine der größten Kosten von Self-Service-Tools: die Übergabe der Arbeit an die Ingenieure, um sie für die Produktion neu zu erstellen. Anstatt die Arbeit in einem anderen System zu wiederholen, können zentrale Datenteams auf dem aufbauen, was die Benutzer bereits erstellt haben.

4. Keine Lizenzgebühren pro Benutzer

Eines der größten Hindernisse bei der Einführung traditioneller Low-Code-Tools ist die Preisgestaltung. Sitzbasierte Lizenzierung zwingt Teams, im Voraus zu entscheiden, welchen Benutzern der Zugriff gewährt werden soll, was die Einführung verlangsamt und Self-Service von vornherein einschränkt.

Mit Lakeflow Designer gibt es kein Lizenzmodell pro Benutzer. Sie zahlen nur für die Rechenleistung, die Sie nutzen. Jeder im Unternehmen kann an Datenarbeiten teilnehmen, ohne einen neuen Beschaffungsengpass zu schaffen.

Wie Teams Lakeflow Designer nutzen

Wir sehen bereits Hunderte von Teams aus verschiedenen Branchen, die Lakeflow Designer nutzen, um Daten auf Arten aufzubereiten und damit zu arbeiten, die bisher ohne Unterstützung durch Ingenieure schwer zu skalieren waren.

Zum Beispiel:

- Beratungs- und professionelle Dienstleistungsteams nutzen Lakeflow Designer, um Kundendaten aus Tabellenkalkulationen, PDFs und gemeinsam genutzten Dateien zu bereinigen und dann wiederholbare Audit- oder Analyse-Workflows anzuwenden, um Berichte zu erstellen.

- Finanzdienstleistungsorganisationen nutzen Lakeflow Designer für Self-Service-Datenaufbereitung, regulatorische Berichterstattung und Risikoanalysen.

- Business-Teams aus Marketing, Betrieb und Logistik nutzen es, um Daten aus mehreren Quellen zu kombinieren, operative Fragen zu beantworten und Daten für Dashboards aufzubereiten.

Wir sehen auch, dass Lakeflow Designer eine wichtige Rolle auf der gesamten Databricks-Plattform spielt. Teams nutzen es, um Daten aufzubereiten, die in Metric Views und KI/BI-Dashboards fließen, wodurch eine vollständige Self-Service-Schleife entsteht. Analysten können von Rohdaten zu aufbereiteten Dashboards gelangen, ohne Code schreiben zu müssen.

Mit der Einführung von Lakeflow Designer vereinfachten wir die Erstellung von Datenpipelines und erhöhten die Qualität der Analysen durch Low-Code-Entwicklung und KI-Funktionen, die durch natürliche Sprache angetrieben werden. Nicht-technische Teams begannen, komplexe analytische Prozesse autonom zu erstellen, was echten Geschäftswert generierte und die Entscheidungsfindung beschleunigte. Darüber hinaus ermöglichte uns die Plattform, eine datengesteuerte Kultur im gesamten Unternehmen zu skalieren, die Reichweite fortgeschrittener Analysen auf mehr Bereiche auszudehnen und den Zugang zu Datenintelligenz in der gesamten Organisation zu demokratisieren. — Carlos Gumz, Data Lead, Hering

Erste Schritte

Designer ist derzeit in allen Arbeitsbereichen verfügbar. Um zu beginnen, klicken Sie auf die Schaltfläche + Neu oben links im Arbeitsbereich und wählen Sie Visuelle Datenaufbereitung. Wenn Sie die Option Visuelle Datenaufbereitung nicht sehen, muss Designer möglicherweise von einem Administrator im Vorschauportal aktiviert werden.

Hier sind einige weitere nächste Schritte, die Sie mit Lakeflow Designer unternehmen können:

- Sehen Sie sich ein 8-minütiges Demovideo von Lakeflow Designer an

- Besuchen Sie die Dokumentationsseite für detailliertere Ressourcen zum Einstieg in Lakeflow Designer.

- Kundenfeedback prägt das Produkt weiterhin und spielt eine Schlüsselrolle in unserer Roadmap. Wenn Sie Feedback oder Fragen haben, würden wir uns freuen, von Ihnen unter [email protected] zu hören.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.