Ankündigung von speicheroptimierten Endpunkten für AI Search

Milliarden von Vektoren, 7x niedrigere Kosten

von Adam Gurary und Dima Kotlyarov

- Einführung von speicheroptimierten AI Search: Milliarden von Vektoren, bis zu 7x niedrigere Kosten, 20x schnellere Indizierung, vertraute SQL-ähnliche Filterung.

- Mehr Wert aus unstrukturierten Daten für KI gewinnen: Erstellen Sie leistungsstarke RAG-, Entity Resolution- und semantische Suchsysteme für Dokumente, Bilder und mehr.

- Enterprise-ready und einfach zu übernehmen: Unterstützt durch Unity Catalog Governance und integriert mit Tools wie AI Playground für schnelle RAG-Prototypen und Budgetrichtlinien für das Kostenmanagement.

Die meisten Unternehmen verfügen über riesige Mengen unstrukturierter Daten – Dokumente, Bilder, Audio, Video –, doch nur ein Bruchteil davon wird jemals in umsetzbare Erkenntnisse umgewandelt. KI-gestützte Anwendungen wie Retrieval-Augmented Generation (RAG), Entity Resolution, Empfehlungs-Engines und Intent-Aware Search können das ändern, stoßen aber schnell auf bekannte Hürden: harte Kapazitätsgrenzen, explodierende Kosten und langsame Indizierung.

Heute kündigen wir die Public Preview von speicheroptimierten Endpunkten für Databricks AI Search an – unsere neue Vector-Search-Engine, die speziell für Petabyte-große Daten entwickelt wurde. Durch die Entkopplung von Speicher und Rechenleistung und die Nutzung der massiven Skalierbarkeit und Parallelität von Spark innerhalb der Databricks Data Intelligence Platform liefert sie:

- Kapazität für Milliarden von Vektoren

- Bis zu 7x niedrigere Kosten

- 20x schnellere Indizierung

- SQL-ähnliche Filterung

Das Beste daran: Sie ist ein echter Drop-in-Ersatz für dieselben APIs, die Ihre Teams bereits verwenden, jetzt aber für RAG, semantische Suche und Entity Resolution im realen Produktionsbetrieb optimiert. Darüber hinaus führen wir zur weiteren Unterstützung von Enterprise-Teams neue Funktionen ein, die die Entwicklung optimieren und die Kostentransparenz verbessern.

Neues bei speicheroptimierten AI Search

Speicheroptimierte Endpunkte wurden als direkte Reaktion auf die Bedürfnisse von Enterprise-Teams entwickelt, die uns mitgeteilt haben, was sie am dringendsten benötigen: die Möglichkeit, über gesamte unstrukturierte Daten-Seen hinweg zu indizieren und zu suchen, eine Infrastruktur, die ohne explodierende Kosten skaliert, und schnellere Entwicklungszyklen.

Milliarden von Vektoren, 7x niedrigere Kosten

Skalierbarkeit ist keine Einschränkung mehr. Während unser Standardangebot Hunderte von Millionen Vektoren unterstützte, ist die speicheroptimierte Version für Milliarden von Vektoren zu angemessenen Kosten konzipiert, sodass Organisationen Workloads für den gesamten Datenbestand ausführen können, ohne Stichproben nehmen oder filtern zu müssen. Kunden, die große Workloads ausführen, sehen bis zu 7x niedrigere Infrastrukturkosten, was es endlich machbar macht, GenAI in der Produktion über riesige unstrukturierte Datensätze hinweg auszuführen.

Zum Vergleich: Die Preise für speicheroptimierte Endpunkte würden etwa 900 $/Monat für 45 Mio. Vektoren und etwa 7.000 $/Monat für 1,3 Mrd. Vektoren betragen. Letzteres stellt im Vergleich zu etwa 47.000 $/Monat bei unserem Standardangebot eine erhebliche Einsparung dar.

Bis zu 20x schnellere Indizierung

Ermöglichen Sie schnelle Iterationszyklen, die zuvor unmöglich waren. Unsere Neukonstruktion treibt eine der am häufigsten nachgefragten Verbesserungen voran – eine dramatisch schnellere Indizierung. Sie können jetzt einen Index mit 1 Milliarde Vektoren in weniger als 8 Stunden erstellen, und kleinere Indizes mit 100 Millionen Vektoren oder weniger sind in wenigen Minuten erstellt.

„Die Verbesserung der Indizierungsgeschwindigkeit mit speicheroptimierten Endpunkten ist für uns enorm wichtig. Was früher etwa 7 Stunden dauerte, dauert jetzt nur noch eine Stunde, eine Verbesserung um das 7- bis 8-fache.“ — Ritabrata Moitra, Sr. Lead ML Engineer, CommercelIQ

SQL-ähnliche Filterung

Filtern Sie Datensätze einfach, ohne eine neue Syntax lernen zu müssen. Neben Leistung und Skalierbarkeit haben wir uns auch auf die Benutzerfreundlichkeit konzentriert. Die Metadatenfilterung erfolgt jetzt mit intuitiver, SQL-ähnlicher Syntax, sodass Sie Suchergebnisse einfach anhand von Kriterien eingrenzen können, die Sie bereits kennen.

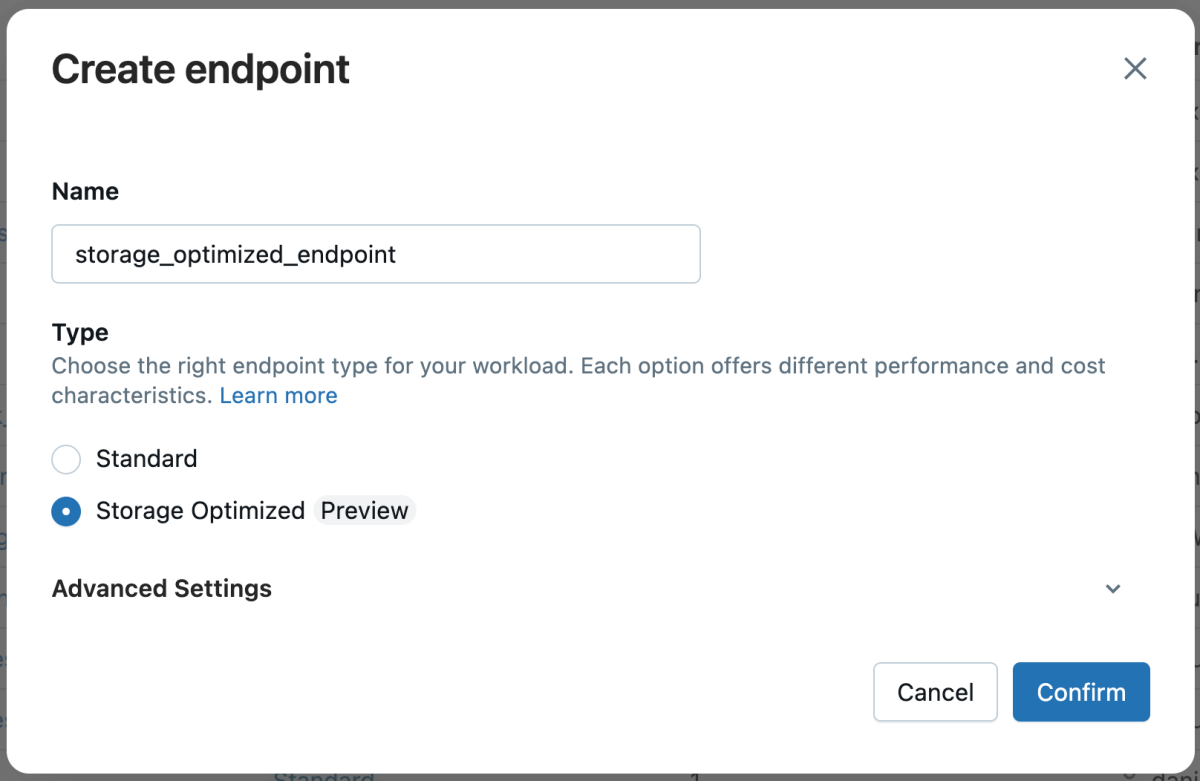

Gleiche APIs, brandneues Backend

Die Migration zu speicheroptimierten Endpunkten ist einfach – wählen Sie ihn einfach bei der Erstellung eines neuen Endpunkts aus und erstellen Sie einen neuen Index für Ihre Tabelle. Die Ähnlichkeitssuch-API bleibt gleich, sodass keine größeren Codeänderungen erforderlich sind.

„Wir betrachten speicheroptimierte AI Search im Wesentlichen als Drop-in-Ersatz für das Standardangebot. Sie ermöglicht die Skalierung, die wir benötigen, um Hunderte von internen Investoren zu unterstützen, die täglich Millionen von Dokumenten abfragen, ohne Kompromisse bei Latenz oder Qualität einzugehen.“ — Alexandre Poulain, Director, Data Science & AI Team, PSP Investments

Da diese Funktion Teil der Databricks-Plattform ist, verfügt sie über die vollständige Governance durch Unity Catalog. Das bedeutet ordnungsgemäße Zugriffskontrollen, Audit-Protokolle und Lineage-Tracking für alle Ihre Vector-Search-Assets – und gewährleistet so die Einhaltung von Unternehmensdaten- und Sicherheitsrichtlinien von Anfang an.

Erweiterte Funktionen zur Optimierung Ihres Workflows

Um Enterprise-Teams weiter zu unterstützen, führen wir neue Funktionen ein, die das Experimentieren, Bereitstellen und Verwalten von Vector-Search-Workloads im großen Maßstab erleichtern.

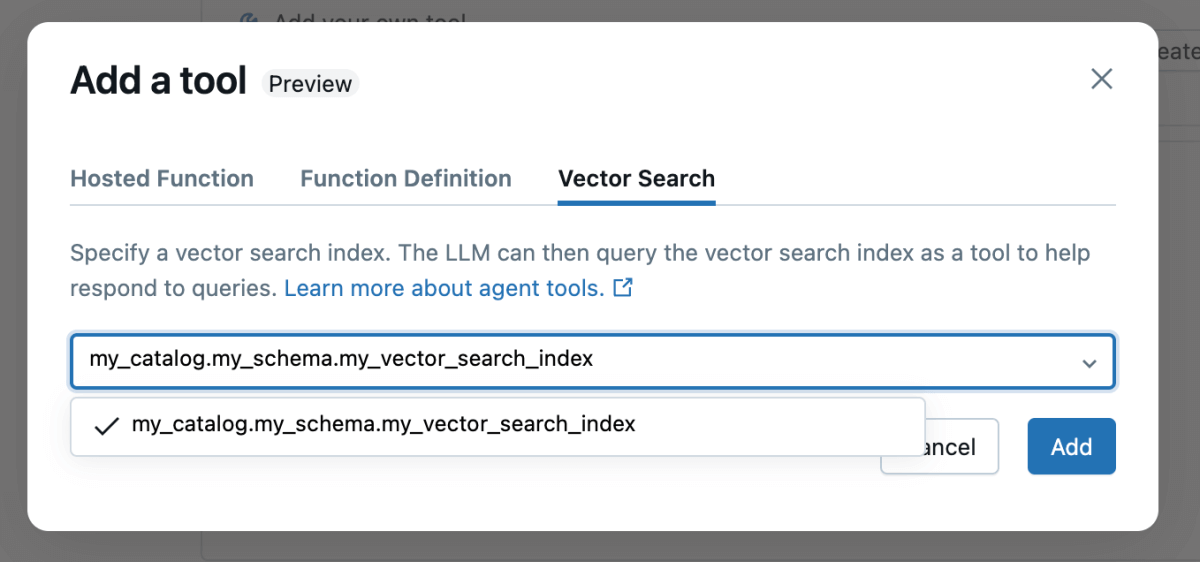

Teams können jetzt einen Chat-Agenten, der von einem Vector-Search-Index als Wissensbasis unterstützt wird, mit zwei Klicks testen und bereitstellen – ein Prozess, der früher erheblichen benutzerdefinierten Code erforderte. Mit der direkten Integration im Agent Playground, jetzt in der Public Preview, wählen Sie Ihren Vector-Search-Index als Tool aus, testen Sie Ihren RAG-Agenten und exportieren, stellen Sie bereit und bewerten Sie Agenten, ohne eine einzige Codezeile zu schreiben. Dies verkürzt den Weg von Prototyp zu Produktion erheblich.

Unsere verbesserte Kostentransparenz mit der Budget-Richtlinien-Tagging für Endpunkte ermöglicht es Plattformbesitzern und FinOps-Teams, Ausgaben über mehrere Teams und Anwendungsfälle hinweg einfach zu verfolgen und zu verstehen, Budgets zuzuweisen und Kosten bei wachsender Nutzung zu verwalten. Weitere Unterstützung für das Tagging von Indizes und Rechenressourcen wird bald verfügbar sein.

Dies ist erst der Anfang

Die Veröffentlichung von speicheroptimierten Endpunkten ist ein wichtiger Meilenstein, aber wir arbeiten bereits an zukünftigen Verbesserungen:

- Scale-to-Zero: Automatische Reduzierung der Rechenressourcen bei Nichtgebrauch, um die Kosten weiter zu senken

- Unterstützung für hohe QPS: Infrastruktur zur Verarbeitung von Tausenden von Abfragen pro Sekunde für anspruchsvolle Echtzeitanwendungen

- Über semantische Suche hinaus: Effiziente nicht-semantische Abruffunktionen für reine Keyword-Workloads.

Unser Ziel ist einfach: die beste verfügbare Vector-Search-Technologie zu entwickeln, die vollständig in die Databricks Data Intelligence Platform integriert ist, auf die Sie sich bereits verlassen.

Beginnen Sie noch heute mit dem Erstellen

Speicheroptimierte Endpunkte verändern die Art und Weise, wie Sie mit unstrukturierten Daten im großen Maßstab arbeiten. Mit massiver Kapazität, besserer Wirtschaftlichkeit, schnellerer Indizierung und vertrauter Filterung können Sie selbstbewusst leistungsfähigere KI-Anwendungen erstellen.

Bereit, loszulegen?

- Probieren Sie Databricks AI Search kostenlos aus: Die Express-Einrichtung bietet Ihnen sofortigen Zugriff und kostenlose Serverless-Credits.

- Lesen Sie unsere Dokumentation, um zu erfahren, wie es geht!

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.