Über die Bereitstellung hinaus: Der Entwicklerleitfaden für Databricks Lakebase Autoscaling

von Bryan Clark und Susan Pierce

- Databricks Lakebase Autoscaling eliminiert den traditionellen Kompromiss zwischen Über- und Unterbereitstellung, indem es die compute Units basierend auf CPU-Auslastung, Speichernutzung und der Größe des Working Sets dynamisch anpasst.

- Entwickler definieren minimale und maximale CU-Leitplanken, um Performance und Kosten auszugleichen, wobei die Skalierung automatisch und ohne Neustart der Datenbank erfolgt.

- Die Kombination von Autoscaling mit Scale-to-Zero reduziert die Ausgaben für inaktive Compute drastisch und liefert gleichzeitig sofortige Performance für KI-, Entwicklungs- und Workloads mit Lastspitzen.

Bei der Bereitstellung von Datenbanken haben Sie nur 2 Möglichkeiten:

- Überprovisionierung: Stellen Sie Ihre compute für das Worst-Case-Szenario hoch ein und zahlen Sie zu viel für die inaktive CPU.

- Unterprovisionierung: Sparen Sie jetzt Geld, indem Sie die compute niedrig einstellen, aber eine Lastspitze wird Ihr System später lahmlegen

Das ist das „Provisionierungs-Paradoxon“, und wenn Sie jemals eine Produktionsdatenbank verwaltet haben, standen Sie vor dieser Herausforderung.

Jahrelang haben wir dies einfach als den Preis für den Betrieb relationaler Datenbanken akzeptiert. Aber mit der Einführung von Databricks Lakebase, serverless Postgres, das in Databricksintegriert ist, haben sich die Spielregeln geändert. Wir haben uns von „Always-on“-Instanzen mit fester Größe entfernt und uns einem intelligenteren, elastischeren Modell zugewandt: Autoscaling.

In diesem Beitrag befassen wir uns damit, wie das Autoscaling von Lakebase tatsächlich funktioniert, warum es für moderne Entwickler-Workflows eine enorme Erleichterung ist und wie Sie Ihre Guardrails konfigurieren, damit Sie sich auf die Entwicklung von Features konzentrieren können, anstatt die Infrastruktur zu verwalten.

Was ist Lakebase Autoscaling?

Die Lakebase-Autoskalierung ist ein intelligentes compute-Modell, das sicherstellt, dass die Größe Ihrer Datenbank den unmittelbaren Anforderungen Ihrer Anwendung entspricht.

Die richtige Größe für Ihre Datenbank ist die, die Ihre Anwendung benötigt. Die Datenbank compute sollte reaktiv sein und nicht statisch und auf eine T-Shirt-Größe beschränkt. Mit der Autoskalierung definieren Sie den Ressourcenbereich, den Sie der Datenbank zuweisen möchten. Das System passt dann die für Ihre Datenbank verfügbare compute dynamisch an die aktuelle Auslastung an.

In Lakebase wird dies über eine Abstraktion namens Compute Units (CUs) gehandhabt. Autoscaling verwendet einen granularen Ansatz, bei dem 1 CU 2 GB Arbeitsspeicher zuweist. Dadurch kann das System in kleineren, präziseren Schritten skalieren, was Ihnen eine bessere Kontrolle über Performance und Kosten gibt.

Spezifikation | Mehrwert |

Speicher pro Compute-Einheit | 2 GB |

Maximaler Autoskalierungsbereich | 32 CU |

Maximale Min-zu-Max-CU-Spanne | 8 CU |

Inaktivitäts-Timeout für Scale auf Null | Benutzerdefiniert (z. B. 15 Min.) |

Geschätzte Kosteneinsparungen (Scale auf Null) | 70 %+ für lastspitzenintensive/Entwicklungs-Workloads |

Neustart der Datenbank für Scale erforderlich. | Nein |

Die Funktionsweise: Wie der Skalierungsalgorithmus denkt

Man könnte leicht annehmen, dass Autoscaling nur die reine CPU-Auslastung berücksichtigt, aber Lakebase ist intelligenter. Um sicherzustellen, dass die Performance Ihrer Anwendung nicht beeinträchtigt wird, überwacht der Autoscaling-Algorithmus drei Keye technische Säulen:

1. CPU-Auslastung

Die intuitivste Metrik. Wenn Ihre Anwendung beginnt, komplexe Joins auszuführen oder das Volumen gleichzeitiger Anfragen steigt, erkennt das System die Spitzenlast in der Prozessorauslastung und fügt weitere CUs hinzu, um sicherzustellen, dass die Abfragelatenz niedrig bleibt.

2. Speichernutzung

Relationale Datenbanken sind für ihren hohen Speicherbedarf bekannt. Diese Metrik erfasst, wie viel Speicher Ihre aktiven Prozesse und Puffer verbrauchen. Durch das Monitoring des Speichers kann Lakebase hochskalieren, um „Out of Memory“-Probleme (OOM) zu verhindern, bevor sie Ihre Sitzung zum Absturz bringen. Dies gewährleistet eine konsistente Verfügbarkeit selbst bei hoher Auslastung.

3. Größe des Arbeitssatzes

Dies ist vielleicht die wichtigste Pro-Level-Metrik. Das Working-Set ist der Teil Ihrer Daten, auf den häufig zugegriffen wird und der idealerweise „heiß“ im Cache bleiben sollte. Wenn Ihr Working-Set größer wird als der aktuell zugewiesene RAM, muss die Datenbank Daten auf die Festplatte "auslagern", was um Größenordnungen langsamer ist. Lakebase schätzt die Größe Ihres Working-Sets und skaliert Ihre Compute hoch, um sicherzustellen, dass Ihre "heißen" Daten im Hochgeschwindigkeitsspeicher bleiben.

Das Schöne an diesem Ansatz ist, dass alles ohne Neustarts geschieht. Ihre Datenbankverbindungen bleiben offen und Ihre Anwendung reagiert weiterhin, während sich die zugrunde liegende Infrastruktur fließend an Ihren Traffic anpasst.

Konfigurieren der Guardrails: Minimale und maximale CUs

Autoscaling bedeutet nicht unbegrenzte Ressourcen oder unbegrenzte Rechnungen. Als Entwickler benötigen Sie Kontrolle über Ihre Performance-Untergrenze und Ihre Kostenobergrenze. Dazu legen Sie einen Skalierungsbereich fest.

Festlegen der Skalierungsgrenzen

Wenn Sie eine Lakebase-Compute-Instanz konfigurieren, legen Sie zwei primäre Werte fest:

- Minimale CU: Dies ist Ihr Basiswert. Er stellt sicher, dass Ihre Datenbank auch in Zeiten mit geringem Datenverkehr reaktionsschnell genug ist, um auf administrative Aufgaben oder Hintergrundjobs zu reagieren.

- Maximale CU: Dies ist Ihr Budget-Sicherheitsnetz. Es verhindert, dass die Kosten durch einen unkontrollierten Prozess, einen rekursiven Abfragefehler oder einen unerwarteten Datenverkehrsanstieg über den von Ihnen genehmigten Rahmen hinaus steigen.

Wichtiger Hinweis zu Grenzwerten: Um die Skalierung vorhersagbar und reaktionsschnell zu halten, erfordert Lakebase, dass die Differenz zwischen Ihrer maximalen und minimalen compute-Größe 8 CU nicht überschreitet (z. B. ein Bereich von 2 bis 10 CU). Das Autoscaling von Lakebase unterstützt Bereiche von bis zu 32 CU. Für Workloads, die konstant mehr Leistung benötigen, sind auch größere compute-Instanzen mit fester Größe verfügbar.

Praxisszenarien: Wann die automatische Skalierung gewinnt

1. Workloads für KI-Agenten und interaktive Apps

Wenn Sie KI-gestützte Anwendungen oder autonome Agenten auf Databricks erstellen, sind Ihre Traffic-Muster fast nie linear. Ein Agent kann stundenlang inaktiv sein und dann plötzlich eine massive Kette von Abfragen auslösen, während er einen komplexen Prompt verarbeitet oder ein neues Dataset aufnimmt.

Autoscaling stellt sicher, dass die Datenbank diese plötzlichen Aktivitätsspitzen bewältigt, ohne dass Sie die Infrastruktur "vorwärmen" müssen. Wenn der Agent seine Task beendet, wird die Scale der Datenbank automatisch wieder heruntergefahren, was das Budget Ihres Projekts schützt.

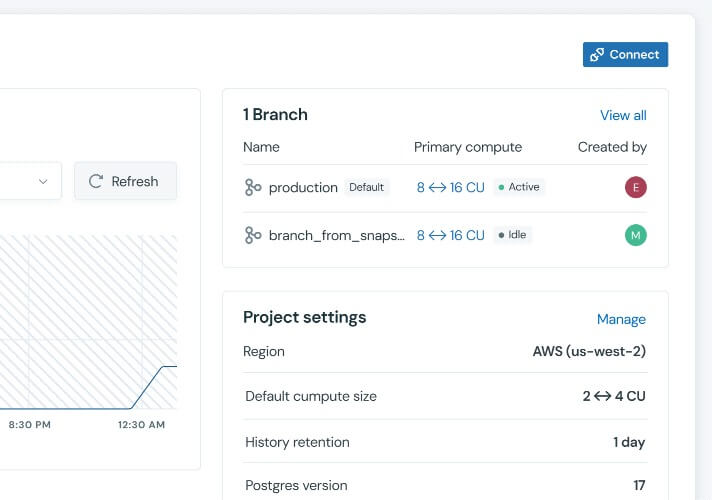

2. Entwicklung, Testen und Branching

Moderne Datenbank-Workflows in Lakebase beinhalten oft Datenbank-Branching, also die Möglichkeit, isolierte Copy-on-Write-Umgebungen für bestimmte Features oder PRs zu erstellen.

Die meisten dieser Dev-Branches sind 90 % der Zeit inaktiv. Mit Autoscaling bleiben diese Umgebungen bei ihrer minimalen CU, wenn sie nicht verwendet werden. Sobald jedoch eine CI/CD-Pipeline einen aufwendigen Integrationstest startet oder ein Entwickler eine manuelle Datenvalidierung beginnt, skaliert die Umgebung sofort hoch, um eine Performance auf Produktionsniveau zu bieten.

Der Scale-to-Zero-Vorteil

Die Autoskalierung regelt die aktiven Stunden, aber was passiert, wenn der Arbeitstag endet?

Hier wird die Scale auf Null zum ultimativen Werkzeug zur Kostenoptimierung. Wenn sie zusammen mit Autoscaling aktiviert ist, kann Lakebase Phasen völliger Inaktivität erkennen. Nach einem benutzerdefinierten Timeout, z. B. 15 Minuten ohne Abfragen, wird die compute-Instanz vollständig angehalten.

- Keine compute-Kosten: Während die Instanz angehalten ist, fällt Ihre compute-Rechnung auf null.

- Sofortiger Neustart: Sobald eine neue Verbindung oder Abfrage eingeht, wird die Datenbank sofort mit der von Ihnen definierten minimalen Autoscaling-Größe fortgesetzt.

Für Entwicklungsumgebungen oder interne Dashboards, die nur während der Geschäftszeiten genutzt werden, kann diese Kombination die monatlichen Compute-Kosten um 70 % oder mehr senken.

Warum moderne Entwickler zu Lakebase wechseln

Der Umstieg auf Autoscaling dient ebenso der betrieblichen Vereinfachung wie der Kostenersparnis.

- Keine manuelle Größenanpassung: Sie müssen keine Grafana-Boards beobachten und die Größe von Instanzen manuell anpassen, wenn Sie eine CPU-Auslastung von 80 % erreichen.

- Vorhersagbare Leistung: Durch das Monitoring des Working Sets und der Speichernutzung skaliert Lakebase, bevor Ihre Nutzer eine Verlangsamung bemerken.

- Granulare Steuerung: Das Modell mit 2 GB pro CU ermöglicht eine wesentlich feinere Abstimmung als bei herkömmlichen Cloud-Anbietern, die Sie zwingen, die Größe Ihrer Instanz und Ihre Rechnung zu verdoppeln, nur um ein wenig mehr RAM zu erhalten.

Fazit

Die Zeit der auf Schätzungen basierenden Datenbank-Dimensionierung ist vorbei. Durch die Nutzung von Databricks Lakebase Autoscaling müssen Sie nicht länger als Teilzeit-Sysadmin agieren und können sich stattdessen auf das Wesentliche konzentrieren: Ihren Code und Ihre Daten.

Legen Sie Ihre Grenzen fest, aktivieren Sie die Scale auf null für Ihre Dev-Branches und überlassen Sie dem Lakebase-Algorithmus die schwere Arbeit. Ihre Nutzer und Stakeholder werden es Ihnen danken.

Möchten Sie loslegen?

Erfahren Sie mehr in der Dokumentation zum Lakebase Autoscaling, um zu lernen, wie Sie noch heute Ihre erste Compute-Instanz mit Autoscaling konfigurieren.

Häufig gestellte Fragen (FAQ)

Was ist Autoscaling? Autoscaling ist ein intelligentes Compute-Modell, das sicherstellt, dass Ihre Datenbankgröße den Anforderungen Ihrer Anwendung entspricht. Es geht weg von Instanzen mit fester Größe hin zu einem elastischen Modell, das die für Ihre Datenbank verfügbare Compute basierend auf der aktuellen Auslastung anpasst.

Was ist das Hauptziel der Autoskalierung? Das Hauptziel ist die Lösung des Bereitstellungs-Paradoxons, bei dem Entwickler traditionell zwischen einer Überzahlung für inaktive CPU-Leistung und dem Risiko eines Systemausfalls bei Lastspitzen wählen mussten. Sie ermöglicht es, dass die Datenbank-Compute reaktiv und präzise dimensioniert wird, anstatt auf eine statische Größe beschränkt zu sein.

Was sind die Vorteile von Autoscaling? Zu den Vorteilen gehören eine einfachere Bedienung, da keine manuelle Größenanpassung erforderlich ist, und eine vorhersagbare Performance durch die proaktive Monitoring von Speicher und Workingsets. Darüber hinaus ermöglicht das granulare Modell mit 2 GB pro CU eine genauere Kosten- und Performanceabstimmung im Vergleich zu Anbietern, bei denen für mehr RAM eine Verdoppelung der Instanzgrößen erforderlich ist.

Wie verwaltet Autoscaling die Kapazität dynamisch? Die Kapazität wird durch eine granulare Abstraktion namens Compute Units verwaltet, wobei eine Einheit 2 GB Arbeitsspeicher zuweist. Das System fügt diese Einheiten hinzu oder entfernt sie, ohne dass ein Neustart der Datenbank erforderlich ist. So wird sichergestellt, dass die Verbindungen offen bleiben, während sich die zugrunde liegende Infrastruktur anpasst.

Wie verbessert Autoscaling die Cloud-Skalierbarkeit? Autoscaling verbessert die Skalierbarkeit, indem es Datenbanken ermöglicht, plötzliche Aktivitätsspitzen ohne manuelles Vorwärmen zu bewältigen. Diese Elastizität stellt sicher, dass die Infrastruktur bei anspruchsvollen Tasks für eine Performance auf Produktionsniveau hochskaliert und nach Abschluss automatisch wieder herunterskaliert werden kann, um Budgets zu schonen.

Welche Metriken überwacht Lakebase Autoscaling? Der Algorithmus überwacht drei Key technische Säulen: CPU-Auslastung zur Aufrechterhaltung einer niedrigen Abfragelatenz, Speichernutzung zur Vermeidung von Out-of-Memory-Problemen und die Größe des Arbeitssatzes, um sicherzustellen, dass häufig aufgerufene Daten im Cache bleiben.

Was ist eine Compute Unit (CU) in Lakebase? Eine Compute Unit ist eine granulare Ressourcenabstraktion, die in Lakebase verwendet wird, um den Skalierungsbereich zu definieren. Jede einzelne Einheit stellt genau 2 GB Arbeitsspeicher zur Verfügung.

Welchen maximalen CU-Bereich unterstützt Lakebase Autoscaling? Lakebase Autoscaling unterstützt Bereiche bis zu einem Maximum von 32 CU. Innerhalb dieses Bereichs darf die Spanne zwischen der benutzerdefinierten minimalen und maximalen CU 8 CU nicht überschreiten.

Wie funktioniert die Skalierung auf null in Lakebase? Die Skalierung auf null erkennt Phasen vollständiger Inaktivität und setzt die Compute-Instanz nach einem benutzerdefinierten Timeout vollständig aus. Sobald eine neue Verbindung oder Abfrage eingeht, wird die Datenbank mit der definierten minimalen Autoskalierungsgröße fortgesetzt.

Worin besteht der Unterschied zwischen Autoscaling und Scale-to-Zero in Lakebase? Autoscaling regelt den Betrieb während der aktiven Stunden, indem die Compute-Größe innerhalb eines festgelegten Bereichs an den schwankenden Bedarf angepasst wird. Scale-to-Zero regelt inaktive Zeiträume, indem die Instanz vollständig angehalten wird, um die Compute-Kosten zu eliminieren, wenn keine Abfragen anstehen.

Kann ich Lakebase Autoscaling mit Datenbank-Branching verwenden? Autoscaling ist für das Datenbank-Branching sehr vorteilhaft, da es isolierten Umgebungen für Features ermöglicht, inaktiv mit einer minimalen CU betrieben zu werden. Diese Branch-Umgebungen skalieren dann hoch, um eine Performance auf Produktionsniveau bereitzustellen, sobald ein Entwickler mit der Validierung beginnt oder eine CI/CD-Pipeline Tests ausführt.

Erfordert Autoscaling einen Neustart der Datenbank? Nein. Ihre Datenbankverbindungen bleiben aktiv und offen, während Lakebase die zugrunde liegenden Ressourcen nahtlos skaliert.

Wie ist das RAM-zu-CU-Verhältnis in Lakebase? Jede Compute Unit (CU) stellt genau 2 GB Arbeitsspeicher bereit.

Wie viel kann ich mit „Scale to Zero“ sparen? Bei Workloads, die nur zu bestimmten Tageszeiten aktiv sind, wie z. B. Entwicklungs-Branches oder interne Dashboards, sehen Benutzer häufig eine Reduzierung der Compute-Kosten um 70 % oder mehr.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.