Reranking in Databricks AI Search für schnellere, intelligentere Abfragen in RAG-Agenten

Liefern Sie relevantere Antworten in kürzerer Zeit mit einer einzigen Codezeile

von Adam Gurary, Andrew Drozdov, Erik Lindgren, Ankit Vij, Dima Kotlyarov, Michael Carbin, Sergei Tsarev und Bruce Fontaine

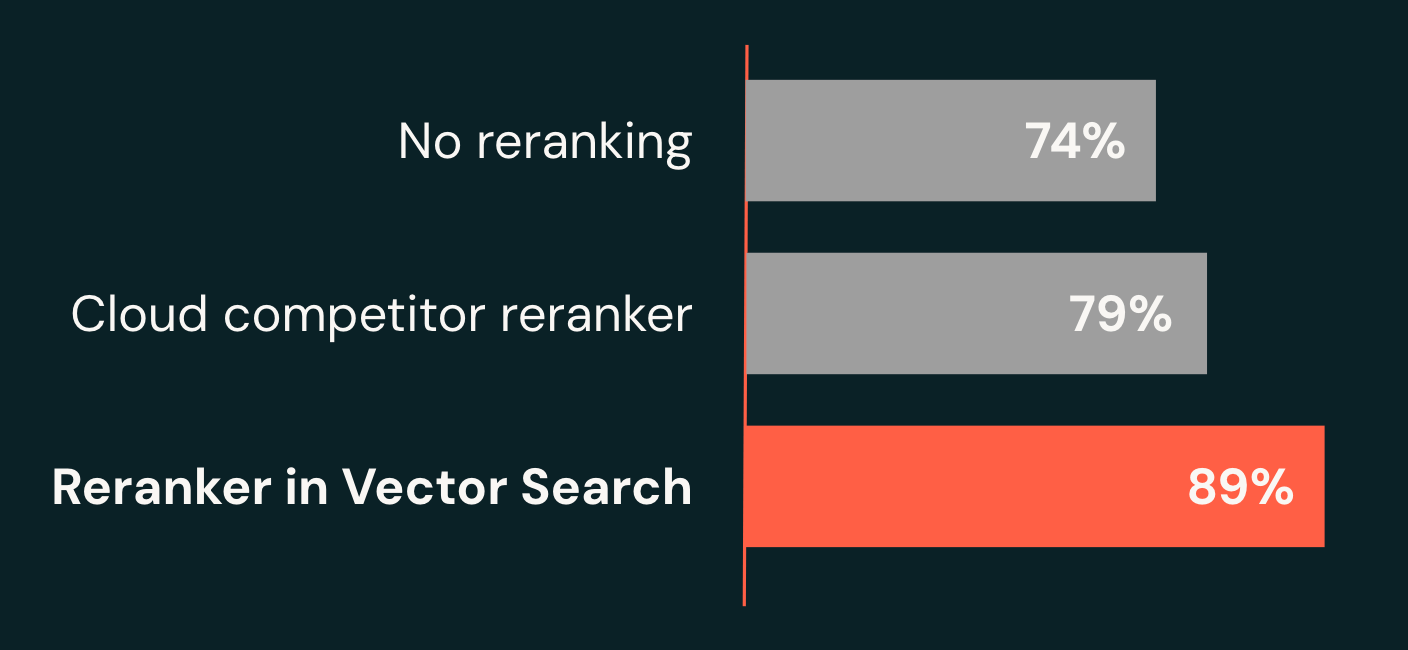

- Einzeilige Codeänderung für sofortige Verbesserung der Agentenqualität: Fügen Sie einen einzigen Parameter zu Ihren AI Search-Abfragen hinzu, um die Agentenqualität in unseren Enterprise Benchmarks um durchschnittlich 15 Prozentpunkte zu verbessern.

- Nahtlose Integration mit Ihren Agenten: Native Unterstützung für LangChain und andere Frameworks, Multi-Column-Reranking für reichhaltigeren Kontext und integrierte Leistungsmetriken.

- Konsistente Leistung im großen Maßstab: Die neuartige, parallelisierte Reranking-Architektur erreicht Latenzzeiten von nur 1,5 Sekunden für 50 Dokumente und liefert gleichzeitig extrem hohe Relevanz, was führende Cloud-Alternativen übertrifft.

Für viele Organisationen ist die größte Herausforderung bei KI-Agenten, die auf unstrukturierten Daten basieren, nicht das Modell selbst, sondern der Kontext. Wenn der Agent die richtigen Informationen nicht abrufen kann, wird selbst das fortschrittlichste Modell wichtige Details übersehen und unvollständige oder falsche Antworten liefern.

Wir führen Reranking in Databricks AI Search ein, jetzt in der Public Preview. Mit einem einzigen Parameter können Sie die Abfragegenauigkeit in unseren Enterprise Benchmarks um durchschnittlich 15 Prozentpunkte verbessern. Das bedeutet qualitativ hochwertigere Antworten, bessere Schlussfolgerungen und eine konsistentere Agentenleistung – ohne zusätzliche Infrastruktur oder komplexe Einrichtung.

Was ist Reranking?

Reranking ist eine Technik, die die Qualität von Agenten verbessert, indem sichergestellt wird, dass der Agent die relevantesten Daten für seine Aufgabe erhält. Während Vektordatenbanken hervorragend darin sind, schnell relevante Dokumente aus Millionen von Kandidaten zu finden, wendet Reranking ein tieferes kontextuelles Verständnis an, um sicherzustellen, dass die semantisch relevantesten Ergebnisse ganz oben erscheinen. Dieser zweistufige Ansatz – schnelle Abfrage gefolgt von intelligenter Neuanordnung – ist für RAG-Agentensysteme, bei denen die Qualität zählt, unerlässlich geworden.

Warum wir Reranking hinzugefügt haben

Vielleicht erstellen Sie interne Chat-Agenten, um Fragen zu Ihren Dokumenten zu beantworten. Oder Sie erstellen Agenten, die Berichte für Ihre Kunden generieren. In jedem Fall ist die Qualität an die Abfrage gebunden, wenn Sie Agenten erstellen möchten, die Ihre unstrukturierten Daten genau verwenden können. Reranking ist die Methode, mit der AI Search-Kunden die Qualität ihrer Abfragen und damit die Qualität ihrer RAG-Agenten verbessern.

Aus Kundenfeedback haben wir zwei häufige Probleme festgestellt:

- Agenten können kritische Kontexte übersehen, die in großen Mengen unstrukturierter Dokumente vergraben sind. Die „richtige“ Passage steht selten ganz oben in den abgerufenen Ergebnissen einer Vektordatenbank.

- Eigenentwickelte Reranking-Systeme erhöhen die Agentenqualität erheblich, aber ihre Entwicklung dauert Wochen und erfordert dann erhebliche Wartung.

Indem wir Reranking zu einer nativen Funktion von AI Search machen, können Sie Ihre verwalteten Unternehmensdaten nutzen, um die relevantesten Informationen ohne zusätzlichen Entwicklungsaufwand zu ermitteln.

Die Reranker-Funktion hat dazu beigetragen, unseren Lexi-Chatbot von einem Gymnasiasten zu einem Jurastudenten zu verbessern. Wir haben transformative Fortschritte bei der Art und Weise erzielt, wie unsere Systeme juristische Dokumente verstehen, analysieren und Inhalte daraus generieren – und Einblicke gewonnen, die zuvor in unstrukturierten Daten verborgen waren. — David Brady, Senior Director, G3 Enterprises

Eine erhebliche Qualitätsverbesserung gegenüber Baselines

Unser Forschungsteam hat einen Durchbruch erzielt, indem es ein neuartiges, kombiniertes KI-System für Agenten-Workloads entwickelt hat. Auf unseren Enterprise Benchmarks ruft das System die richtige Antwort in 89 % der Fälle innerhalb der Top-10-Ergebnisse ab (Recall@10), eine Verbesserung um 15 Punkte gegenüber unserer Baseline (74 %) und 10 Punkte höher als führende Cloud-Alternativen (79 %). Entscheidend ist, dass unser Reranker diese Qualität mit Latenzzeiten von nur 1,5 Sekunden liefert, während zeitgenössische Systeme oft mehrere Sekunden – oder sogar Minuten – benötigen, um qualitativ hochwertige Antworten zu liefern.

Einfache, qualitativ hochwertige Abfrage

Ermöglichen Sie Enterprise-Reranking in Minuten, nicht in Wochen. Teams verbringen normalerweise Wochen mit der Recherche von Modellen, der Bereitstellung von Infrastruktur und dem Schreiben benutzerdefinierter Logik. Im Gegensatz dazu erfordert die Aktivierung von Reranking für AI Search nur einen zusätzlichen Parameter in Ihrer AI Search-Abfrage, um sofort eine höhere Abfragequalität für Ihre Agenten zu erzielen. Keine Model-Serving-Endpunkte zu verwalten, keine benutzerdefinierten Wrapper zu warten, keine komplexen Konfigurationen abzustimmen.

Durch die Angabe mehrerer Spalten in columns_to_rerank bringen Sie die Qualität des Rerankers auf die nächste Stufe, indem Sie ihm Zugriff auf Metadaten über den Haupttext hinaus gewähren. In diesem Beispiel verwendet der Reranker Vertragszusammenfassungen und Kategorieinformationen, um den Kontext besser zu verstehen und die Relevanz der Suchergebnisse zu verbessern.

Optimiert für Agentenleistung

Geschwindigkeit trifft auf Qualität für Echtzeit-KI und agentenbasierte Anwendungen. Unser Forschungsteam hat dieses kombinierte KI-System optimiert, um 50 Ergebnisse in nur 1,5 Sekunden neu zu ordnen. Dies macht es für Agentensysteme, die sowohl Genauigkeit als auch Reaktionsfähigkeit erfordern, äußerst effektiv. Diese bahnbrechende Leistung ermöglicht ausgefeilte Abfragestrategien, ohne die Benutzererfahrung zu beeinträchtigen.

Wann sollte Reranking verwendet werden?

Wir empfehlen, Reranking für jeden RAG-Agenten-Anwendungsfall zu testen. Typischerweise sehen Kunden massive Qualitätssteigerungen, wenn ihre aktuellen Systeme die richtige Antwort irgendwo in den Top-50-Ergebnissen der Abfrage finden, aber Schwierigkeiten haben, sie innerhalb der Top-10 zu präsentieren. Technisch gesehen bedeutet dies, dass Kunden mit niedrigem Recall@10, aber hohem Recall@50.

Verbesserte Entwicklererfahrung

Über die Kernfunktionen des Rerankings hinaus machen wir es einfacher denn je, qualitativ hochwertige Abfragesysteme zu erstellen und bereitzustellen.

LangChain-Integration: Reranker funktioniert nahtlos mit VectorSearchRetrieverTool, unserer offiziellen LangChain-Integration für AI Search. Teams, die RAG-Agenten mit VectorSearchRetrieverTool erstellen, profitieren von einer höheren Abfragequalität – ohne Codeänderungen.

Transparente Leistungsmetriken: Die Latenz des Rerankers ist jetzt in den Debug-Informationen der Abfrage enthalten, sodass Sie eine vollständige End-to-End-Aufschlüsselung Ihrer Abfrageleistung erhalten.

Antwortlatenzaufschlüsselung in Millisekunden

Flexible Spaltenauswahl: Reranken Sie basierend auf jeder Kombination von Text- und Metadatenspalten, sodass Sie den gesamten verfügbaren Domänenkontext – von Dokumentzusammenfassungen über Kategorien bis hin zu benutzerdefinierten Metadaten – für hohe Relevanz nutzen können.

Beginnen Sie noch heute mit der Entwicklung

Reranker in AI Search verändert die Art und Weise, wie Sie KI-Anwendungen erstellen. Mit null Infrastrukturaufwand und nahtloser Integration können Sie endlich die Abfragequalität liefern, die Ihre Benutzer verdienen.

Bereit, loszulegen?

- Probieren Sie Reranking in AI Search noch heute aus – fügen Sie einfach einen Parameter zu Ihren bestehenden AI Search-Abfragen hinzu

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.