Annonce du cadre de sécurité IA Databricks 2.0

Des conseils éprouvés pour atténuer le risque des modèles d'IA à grande échelle

par Kelly Albano, Omar Khawaja et Arun Pamulapati

- La deuxième édition du Databricks AI Security Framework est conçue pour permettre des déploiements d'IA sécurisés et percutants.

- Dans le DASF 2.0, nous avons identifié 62 risques de sécurité techniques et les avons mis en correspondance avec des contrôles recommandés.

- En réponse aux commentaires des utilisateurs, nous avons publié le document compendium DASF, conçu pour aider les utilisateurs à opérationnaliser le DASF.

Nous sommes ravis d'annoncer la deuxième édition du Databricks AI Security Framework (DASF 2.0 —téléchargez maintenant) ! Les organisations qui s'efforcent d'exploiter le potentiel de l'IA ont besoin à la fois de l'accélérateur de l'innovation et des freins de la gouvernance et de la gestion des risques. Le DASF comble ce fossé, permettant des déploiements d'IA sécurisés et percutants pour votre organisation en servant de guide complet sur la gestion des risques liés à l'IA.

Ce blog fournira un aperçu du DASF, explorera les principaux enseignements tirés depuis la sortie de la version originale, présentera de nouvelles ressources pour approfondir votre compréhension de la sécurité de l'IA et fournira des mises à jour sur nos contributeurs de l'industrie.

Qu'est-ce que le Databricks AI Security Framework et qu'y a-t-il de nouveau dans la version 2.0 ?

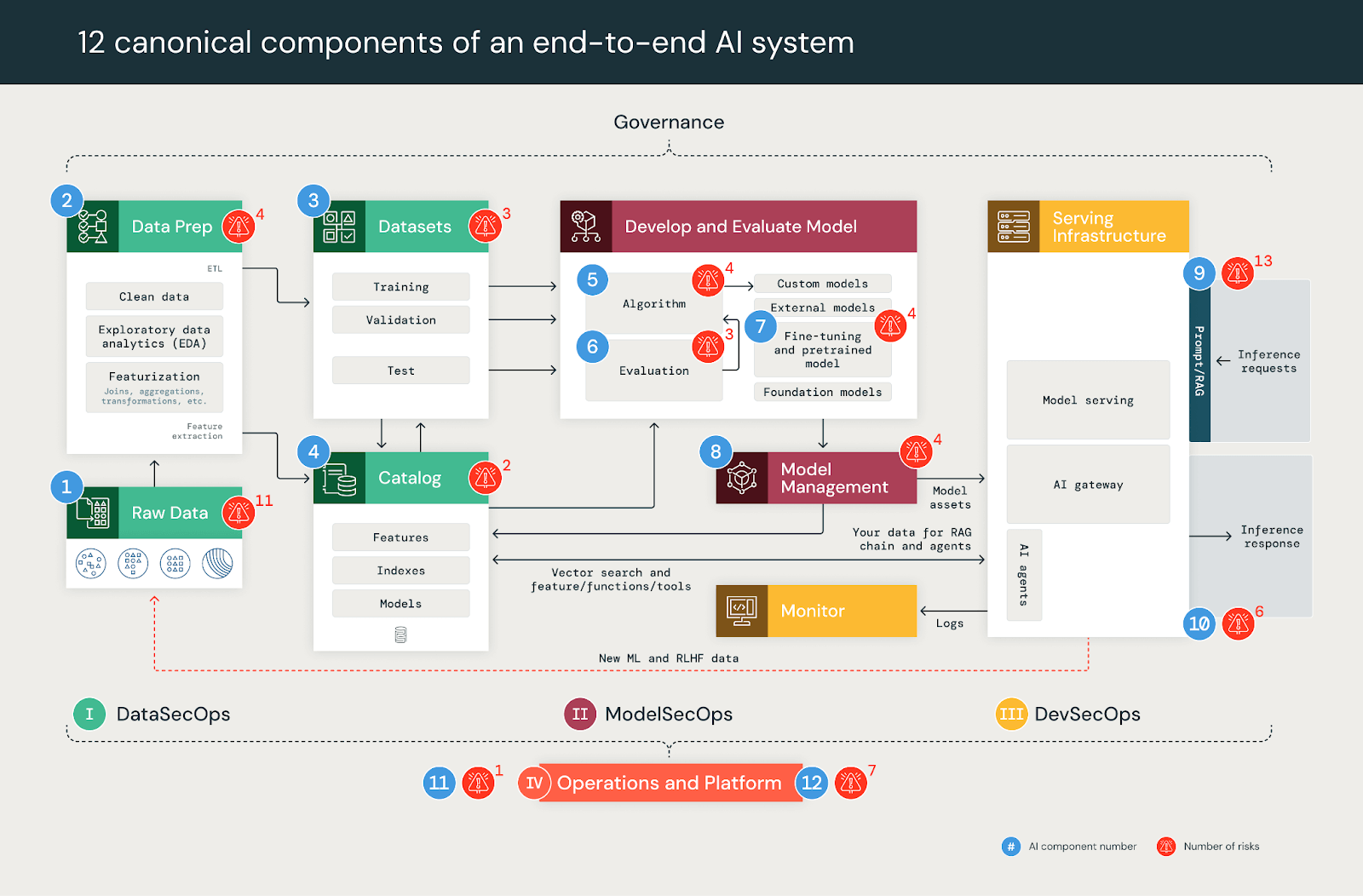

Le DASF est un cadre et un livre blanc pour la gestion des risques de sécurité et de gouvernance de l'IA. Il énumère les 12 composants canoniques d'un système d'IA, leurs risques respectifs et des contrôles exploitables pour atténuer chaque risque. Créé par les équipes de sécurité et de ML de Databricks en partenariat avec des experts de l'industrie, il comble le fossé entre les équipes commerciales, de données, de gouvernance et de sécurité avec des outils pratiques et des stratégies exploitables pour démystifier l'IA, favoriser la collaboration et assurer une mise en œuvre efficace.

Contrairement à d'autres cadres, le DASF 2.0 s'appuie sur les normes existantes pour fournir un profil de risque de bout en bout pour les déploiements d'IA. Il offre des contrôles de défense en profondeur pour simplifier la gestion des risques liés à l'IA pour votre organisation afin de l'opérationnaliser et peut être appliqué à votre plateforme de données et d'IA choisie.

Dans le DASF 2.0, nous avons identifié 62 risques de sécurité techniques et les avons mis en correspondance avec 64 contrôles recommandés pour gérer le risque des modèles d'IA. Nous avons également étendu les correspondances aux principaux cadres et normes de risque d'IA de l'industrie, notamment MITRE ATLAS, OWASP LLM et ML Top 10, NIST 800-53, NIST CSF, HITRUST, Securing ML Algorithms d'ENISA, ISO 42001, ISO 27001:2022, et le Règlement sur l'IA de l'UE.

Opérationnaliser le DASF - découvrez le nouveau compendium et la vidéo explicative associée !

Nous avons reçu des commentaires précieux en partageant le DASF lors d'événements industriels, d'ateliers et de réunions clients. Beaucoup d'entre vous ont demandé plus de ressources pour faciliter la navigation dans le DASF, son opérationnalisation et la cartographie efficace de vos contrôles.

En réponse, nous sommes ravis d'annoncer la publication du document compendium DASF (feuille Google, Excel). Cette ressource est conçue pour aider à opérationnaliser le DASF en organisant et en appliquant ses risques, menaces, contrôles et correspondances aux normes reconnues par l'industrie d'organisations telles que MITRE, OWASP, NIST, ISO, HITRUST, et plus encore. Nous avons également créé une vidéo explicative associée qui fournit une visite guidée du DASF et de son compendium.

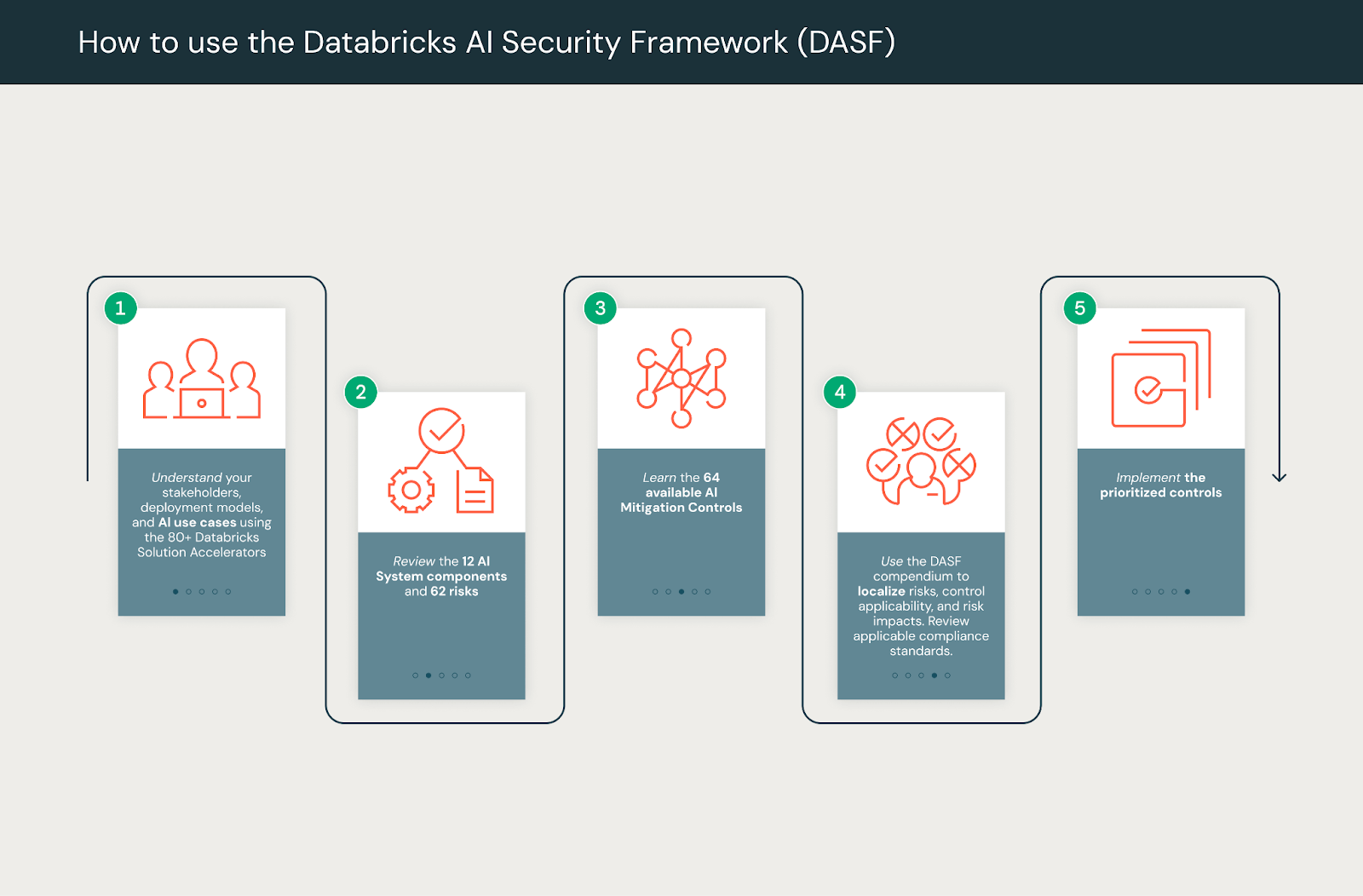

Notre objectif avec ces mises à jour est de rendre le DASF plus facile à adopter, permettant aux organisations de mettre en œuvre des systèmes d'IA en toute sécurité et confiance. Si vous êtes impatient de vous lancer, notre équipe recommande l'approche suivante :

- Comprenez vos parties prenantes, vos modèles de déploiement et vos cas d'utilisation de l'IA : Commencez par un cas d'utilisation métier, en vous appuyant sur le livre blanc DASF pour identifier le modèle de déploiement d'IA le mieux adapté. Choisissez parmi plus de 80 accélérateurs de solutions Databricks pour guider votre parcours. Les modèles de déploiement incluent les modèles ML prédictifs, les API de modèles fondamentaux, les LLM affinés et pré-entraînés, RAG, les agents IA avec LLM et les modèles externes. Assurez-vous de la clarté du développement de l'IA au sein de votre organisation, y compris les cas d'utilisation, les ensembles de données, les besoins de conformité, les processus, les applications et les parties prenantes responsables.

- Passez en revue les 12 composants des systèmes d'IA et les 62 risques : Comprenez les 12 composants des systèmes d'IA, les risques de cybersécurité traditionnels et les nouveaux risques de sécurité de l'IA associés à chaque composant, ainsi que les parties prenantes responsables (par exemple, les ingénieurs de données, les scientifiques, les responsables de la gouvernance et les équipes de sécurité). Utilisez le DASF pour favoriser la collaboration entre ces groupes tout au long du cycle de vie de l'IA.

- Passez en revue les 64 contrôles d'atténuation disponibles : Chaque risque est associé à des contrôles d'atténuation prioritaires, en commençant par la sécurité du périmètre et des données. Ces risques et contrôles sont en outre alignés sur 10 normes industrielles, fournissant des détails et une clarté supplémentaires.

- Utilisez le compendium DASF pour localiser les risques, l'applicabilité des contrôles et les impacts des risques : Commencez par utiliser l'onglet « Applicabilité des risques DASF » pour identifier les risques pertinents pour votre cas d'utilisation en sélectionnant un ou plusieurs modèles de déploiement d'IA. Ensuite, examinez les impacts des risques associés, les exigences de conformité et les contrôles d'atténuation. Enfin, documentez les détails clés pour votre cas d'utilisation, y compris la description du cas d'utilisation de l'IA, les ensembles de données, les parties prenantes, les considérations de conformité et les applications.

- Mettez en œuvre les contrôles prioritaires : Utilisez l'onglet « Applicabilité des contrôles DASF » du compendium pour examiner les contrôles DASF applicables et mettre en œuvre les contrôles d'atténuation sur votre plateforme de données à travers les 12 composants d'IA. Si vous utilisez Databricks, nous avons inclus des liens avec des instructions détaillées sur la façon de déployer chaque contrôle sur notre plateforme.

Mettez en œuvre le DASF dans votre organisation avec de nouvelles ressources de montée en compétence en IA de Databricks

Selon une récente étude d'Economist Impact, les leaders des données et de l'IA interrogés ont identifié la montée en compétence et la promotion d'un état d'esprit de croissance comme des priorités clés pour stimuler l'adoption de l'IA en 2025. Dans le cadre du lancement de DASF 2.0, nous avons des ressources pour vous aider à comprendre les concepts d'IA et de ML et à appliquer les meilleures pratiques de sécurité de l'IA à votre organisation.

- Formation Databricks Academy : Nous vous recommandons de suivre le nouveau cours Fondamentaux de la sécurité de l'IA, qui est maintenant disponible sur Databricks Academy. Avant de plonger dans le livre blanc, ce cours d'une heure est une excellente introduction aux sujets de sécurité de l'IA mis en évidence dans le DASF. Vous recevrez également une accréditation pour votre profil LinkedIn à la fin. Si vous êtes nouveau dans les concepts d'IA et de ML, commencez par notre cours Fondamentaux de l'IA générative.

- Vidéos pratiques : Nous avons enregistré des vidéos de présentation et des vidéos pratiques du DASF pour une consommation rapide. Vous pouvez trouver ces vidéos sur notre chaîne YouTube des meilleures pratiques de sécurité.

- Atelier en personne ou virtuel : Notre équipe propose un atelier sur les risques liés à l'IA sous forme de présentation en direct des concepts décrits dans le DASF, en se concentrant sur la manière de surmonter les obstacles à l'opérationnalisation de la gestion des risques liés à l'IA. Cet événement d'une demi-journée s'adresse aux responsables de niveau Directeur+ dans les fonctions de gouvernance, de données, de confidentialité, juridiques, informatiques et de sécurité.

- Support de déploiement : L'outil Security Analysis Tool (SAT) surveille en permanence l'adhésion aux meilleures pratiques de sécurité dans les espaces de travail Databricks. Nous avons récemment mis à niveau le SAT pour simplifier la configuration et améliorer les vérifications, en les alignant sur le DASF pour une meilleure couverture des risques de sécurité de l'IA.

- Assistant IA DASF : Les clients Databricks peuvent configurer l'assistant IA du Cadre de sécurité IA Databricks (DASF) directement dans leur propre espace de travail sans compétences préalables sur Databricks, interagir avec le contenu du DASF en langage humain simple et obtenir des réponses.

Construire une communauté avec des groupes industriels de l'IA, des clients et des partenaires

Veiller à ce que le DASF évolue au même rythme que l'environnement réglementaire actuel de l'IA et le paysage des menaces émergentes est une priorité absolue. Depuis le lancement de la version 1.0, nous avons formé un groupe de travail sur l'IA composé de collègues de l'industrie, de clients et de partenaires pour rester en étroite adéquation avec ces développements. Nous tenons à remercier nos collègues du groupe de travail et nos pré-réviseurs tels que Complyleft, The FAIR Institute, Ethriva Inc, Arhasi AI, Carnegie Mellon University et Rakesh Patil de JPMC. Vous pouvez trouver la liste complète des contributeurs dans la section des remerciements du DASF. Si vous souhaitez participer au groupe de travail IA du DASF, veuillez contacter notre équipe à l'adresse [email protected].

Voici ce que certains de nos meilleurs défenseurs ont à dire :

"L'IA révolutionne la prestation des soins de santé grâce à des innovations telles que le pipeline GenAI CLEVER, qui traite plus de 1,5 million de notes cliniques par jour pour classifier les déterminants sociaux clés et avoir un impact sur les soins aux vétérans. Ce pipeline repose sur une base de sécurité solide, intégrant les contrôles NIST 800-53 et s'appuyant sur le Databricks AI Security Framework pour garantir la conformité et atténuer les risques. À l'avenir, nous explorons des moyens d'étendre ces capacités grâce à l'Infrastructure as Code et à des stratégies de conteneurisation sécurisées, permettant aux agents d'être déployés et mis à l'échelle dynamiquement à partir de référentiels tout en maintenant des normes de sécurité rigoureuses." - Joseph Raetano, Responsable de l'Intelligence Artificielle, Plateforme d'analyse et d'IA de données Summit, U.S. Department of Veteran Affairs

“Le DASF est l'outil essentiel pour transformer la quantification des risques liés à l'IA en une réalité opérationnelle. Avec l'approche FAIR-AI Risk maintenant dans sa deuxième année, le DASF 2.0 permet aux RSSI de combler le fossé entre la cybersécurité et la stratégie commerciale, en parlant un langage commun fondé sur l'impact financier mesurable.” - Jacqueline Lebo, Fondatrice du groupe de travail sur l'IA, The FAIR Institute et Responsable des conseils en risque, Safe Security

“Alors que l'IA continue de transformer les industries, la sécurisation de ces systèmes contre les cyberattaques sophistiquées et uniques est plus critique que jamais. Le Databricks AI Security Framework est un atout majeur pour les entreprises qui veulent être à la pointe de l'innovation et de la sécurité. Avec le DASF, les entreprises sont mieux équipées pour comprendre les risques liés à l'IA et trouver les outils et les ressources pour atténuer ces risques tout en continuant à innover.” - Ian Swanson, PDG, Protect AI

“Avec le Databricks AI Security Framework, nous sommes en mesure d'atténuer les risques liés à l'IA de manière réfléchie et transparente, ce qui est inestimable pour établir la confiance du conseil d'administration et des employés. C'est un facteur de changement qui nous permet d'intégrer l'IA dans l'entreprise et de faire partie des 15 % d'organisations qui mettent des charges de travail d'IA en production en toute sécurité et avec confiance.” — Coastal Community Bank

"Dans le contexte des données et de l'IA, les conversations sur la sécurité sont rares. Le Databricks AI Security Framework aborde le côté souvent négligé du travail sur l'IA et le ML, servant à la fois de guide de premier ordre pour comprendre les risques de sécurité de l'IA, mais aussi comment les atténuer." - Josue A. Bogran, Architecte chez Kythera Labs & Conseiller auprès de SunnyData.ai

“Nous avons utilisé le Databricks AI Security Framework pour aider à améliorer la posture de sécurité de notre organisation dans la gestion des risques de sécurité liés au ML et à l'IA. Avec le Databricks AI Security Framework, nous sommes maintenant plus confiants dans l'exploration des possibilités offertes par l'IA et l'analyse de données, tout en veillant à ce que les mesures appropriées de gouvernance des données et de sécurité soient en place." - Muhammad Shami, Vice-président, Jackson National Life Insurance Company

Téléchargez dès aujourd'hui le Databricks AI Security Framework 2.0 !

Le Databricks AI Security Framework 2.0 et son compendium (feuille Google, Excel) sont maintenant disponibles en téléchargement. Pour en savoir plus sur les prochains ateliers sur les risques liés à l'IA ou pour demander un atelier dédié en personne ou virtuel pour votre organisation, contactez-nous à [email protected] ou votre équipe de compte. Nous avons également d'autres contenus de leadership éclairé à venir pour fournir des informations supplémentaires sur la gestion de la gouvernance de l'IA. Pour plus d'informations sur la manière de gérer les risques de sécurité de l'IA, visitez le Centre de sécurité et de confiance Databricks.

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.