Un cadre pratique de gouvernance de l'IA pour les entreprises

Un guide complet pour la mise en œuvre responsable et efficace d'outils et de programmes de gouvernance de l'IA

- Pour les organisations qui cherchent à développer et à documenter une gouvernance rigoureuse de l'IA, nous avons développé un cadre de gouvernance de l'IA qui définit une approche structurée du développement responsable de l'IA.

- Les meilleures pratiques de gouvernance de l'IA, y compris la gestion des risques, la conformité légale, la surveillance éthique et le monitoring opérationnel, sont essentielles pour soutenir des systèmes d'IA transparents et responsables.

- Le cadre de gouvernance de l'IA est conçu pour aider les entreprises à faire monter en charge les programmes d'IA tout en gérant les attentes réglementaires, en réduisant les risques et en maintenant la confiance des parties prenantes.

À mesure que les organisations adoptent l'IA à grande montée en charge, le besoin d'une gouvernance formelle augmente. Les entreprises doivent aligner le développement de l'IA sur les objectifs commerciaux, respecter les obligations légales et tenir compte des risques éthiques.

Nous avons introduit le cadre de gouvernance Databricks AI pour fournir une approche structurée et pratique de la gouvernance de l'adoption de l'IA au sein de l'entreprise. Ce cadre est conçu pour soutenir le développement, le déploiement et l'amélioration continue des programmes de gouvernance de l'IA.

Introduction à la gouvernance de l'IA

Le terme "gouvernance de l'IA" désigne l'ensemble des structures, processus et mécanismes de surveillance nécessaires au développement et au déploiement responsables des systèmes d'IA au sein d'une entreprise. Alors que les organisations montent en charge l'IA générative, la gouvernance devient un principe fondamental pour des questions telles que l'alignement des initiatives d'IA sur les objectifs commerciaux, la gestion des obligations éthiques et réglementaires, et la confirmation que les modèles se comportent de manière cohérente et prévisible en production.

De plus, la gouvernance de l'IA a un impact significatif sur le ROI de l'IA. Sans une appropriation, des politiques et des contrôles des risques clairs, les programmes d'IA peuvent souvent être bloqués, rencontrer des incidents de sécurité évitables ou même ne pas parvenir à gagner la confiance des parties prenantes. Une étude du secteur montre que les défis de la gouvernance constituent un obstacle majeur à la mise à l'échelle de l'IA, tandis que plus de la moitié des dirigeants citent une appropriation peu claire, des contrôles des risques inadéquats ou un manque de conformité comme les causes profondes de l'échec des projets d'IA. De plus, des problèmes tels que le biais des modèles, la fuite de données et le comportement non autorisé des modèles sont en augmentation, ce qui souligne la nécessité de pratiques de gouvernance plus strictes. Ces chiffres soulignent à quel point la gouvernance est une condition préalable essentielle à la valeur de l'IA, et non une simple réflexion après coup.

Il est également important de distinguer la gouvernance de la sécurité. Alors que la sécurité se concentre sur la protection des données, des modèles et de l'infrastructure contre les menaces, la gouvernance, quant à elle, définit la manière dont les décisions sont prises concernant le développement et l'utilisation de l'IA.

Cela inclut des questions telles que l'établissement des responsabilités, la définition des politiques, l'évaluation des risques et la garantie d'opérations éthiques et transparentes. Ensemble, la gouvernance et la sécurité constituent le fondement d'une IA sûre et évolutive. Avec le Databricks AI Governance Framework, les entreprises bénéficient d'une approche structurée pour développer ces capacités avant de mettre l'IA à l'échelle dans les produits et les workflows.

Pourquoi la gouvernance de l'IA ne peut pas attendre

Selon une enquête mondiale menée en 2024 par Economist Impact auprès de 1 100 dirigeants et ingénieurs du secteur de la Technologie, 40 % des personnes interrogées estimaient que le programme de gouvernance de l'IA de leur organisation était insuffisant pour garantir la sécurité et la conformité de leurs assets et cas d'usage d'IA. De plus, les violations de la confidentialité et de la sécurité des données constituaient la principale préoccupation pour 53 % des architectes d'entreprise, tandis que la sécurité et la gouvernance sont les aspects les plus difficiles de l'ingénierie des données pour les ingénieurs.

De plus, selon Gartner, la gestion de la confiance, des risques et de la sécurité de l'IA est la principale tendance stratégique n° 1 en 2024 qui influencera les décisions commerciales et technologiques, et d'ici 2026, les modèles d'IA des organisations qui opérationnalisent la transparence, la confiance et la sécurité de l'IA atteindront une augmentation de 50 % en termes d'adoption, d'objectifs commerciaux et d'acceptation par les utilisateurs.

Il est évident que l'absence de programmes de gouvernance de l'IA à l'échelle de l'entreprise devient rapidement un obstacle majeur à la rentabilisation des investissements dans l'IA et à l'adoption de l'IA dans son ensemble.

Nous avons donc développé un cadre de gouvernance complet que les entreprises peuvent exploiter pour créer des programmes de gouvernance de l'IA efficaces.

Une approche structurée de la gouvernance de l'IA

Les bonnes pratiques pour la mise en œuvre de la gouvernance de l'IA exigent une méthodologie structurée et reproductible qui aligne les personnes, les processus et la technologie à travers l'organisation. Le framework de gouvernance de l'IA de Databricks développe une approche holistique qui commence par l'établissement d'objectifs commerciaux clairs, la définition des responsabilités et la création de modèles de gouvernance qui s'intègrent de manière transparente avec les structures d'entreprise existantes. Les programmes de gouvernance réussissent lorsqu'ils sont traités comme des extensions des stratégies organisationnelles, des pratiques de gestion des risques et des processus de gestion de données existants.

Un aspect clé de cette approche consiste à intégrer les responsabilités de gouvernance au sein des équipes plutôt que de les centraliser au sein d'un seul groupe. Les dirigeants d'entreprise définissent l'orientation stratégique en formulant les objectifs de l'IA, en définissant des niveaux de risque acceptables et en garantissant l'alignement sur les priorités de l'entreprise.

Des équipes telles que l'ingénierie des données, la Data Science et l'ingénierie du ML opérationnalisent ces directives en mettant en œuvre des normes de qualité des données, de documentation des modèles, de traçabilité, de reproductibilité et de contrôle d'accès. Les équipes juridiques, de conformité et de sécurité jouent un rôle supplémentaire et parallèle pour garantir la préparation réglementaire, le respect des politiques et la protection des données et des assets de modèle tout au long du cycle de vie.

L'intégration de la gouvernance aux systèmes opérationnels garantit à la fois cohérence et évolutivité. Par exemple, les solutions de gouvernance unifiée des données comme Unity Catalog peuvent standardiser les politiques d'accès, appliquer le lignage des données et centraliser les métadonnées pour l'évaluation des risques et l'auditabilité. Parallèlement, de solides pratiques de Data Engineering garantissent que les programmes d'IA reposent sur des fondations de données fiables et bien gouvernées, avec des pipelines reproductibles et des Transformations transparentes qui peuvent être surveillées au fil du temps.

Une gouvernance efficace de l'IA n'est pas un exercice ponctuel. Des processus de monitoring et d'évaluation continus sont nécessaires pour suivre les performances des modèles, évaluer la data drift, détecter les biais, confirmer la conformité aux politiques et identifier les risques émergents. Cette boucle de rétroaction continue garantit que les modèles restent conformes aux attentes commerciales et aux exigences réglementaires à mesure que les conditions évoluent. Des examens réguliers par des équipes interfonctionnelles aident également les organisations à ajuster de manière proactive les politiques, à ré-entraîner les modèles et à affiner les processus de gouvernance.

En adoptant une approche structurée, collaborative et axée sur le cycle de vie, les organisations peuvent élaborer des programmes de gouvernance qui montent en charge de manière fiable, réduire les risques et accélérer l'adoption sécurisée de l'IA dans toute l'entreprise.

Les cinq piliers fondamentaux de la gouvernance de l'IA

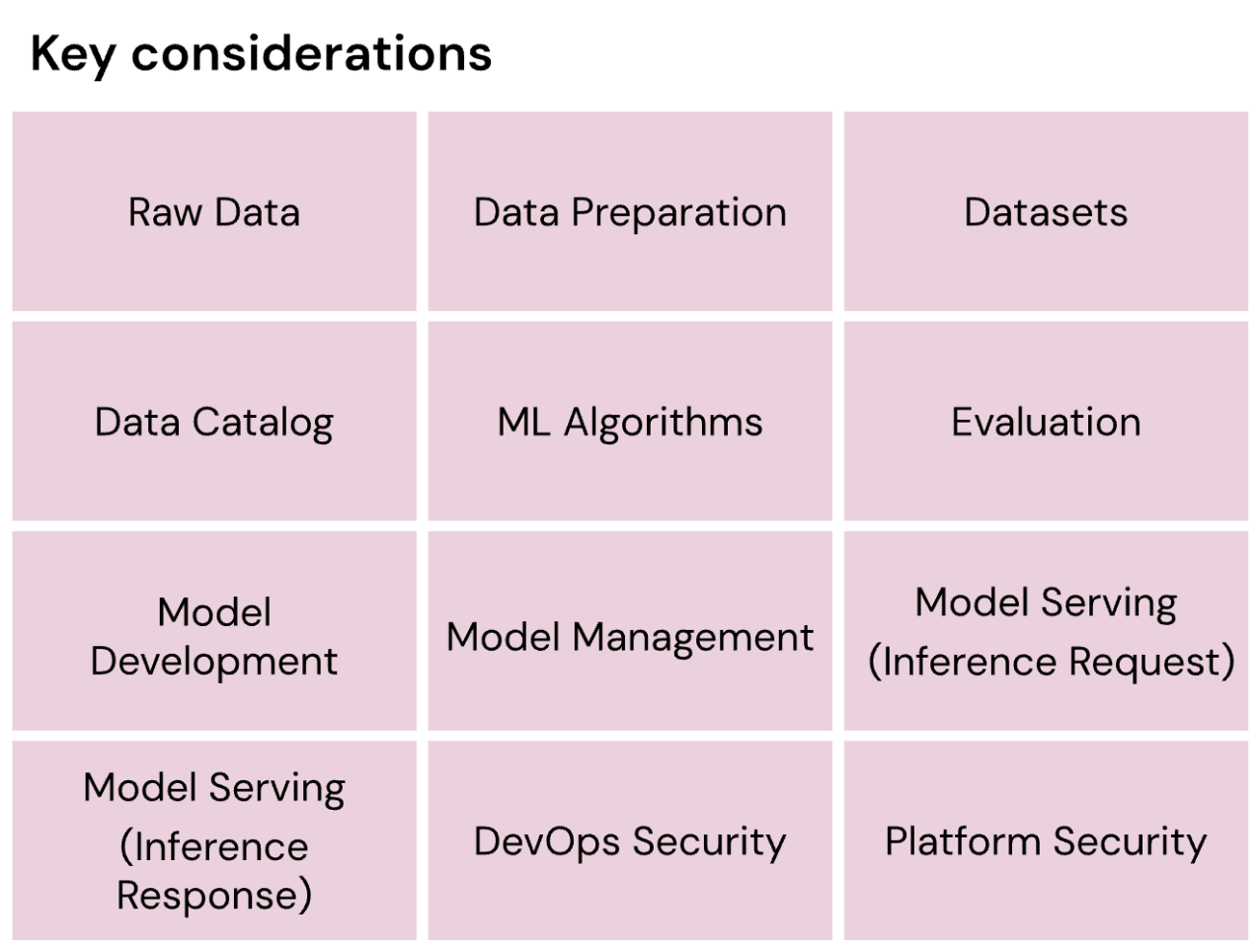

Dans ce cadre, nous présentons 43 considérations clés qu'il est essentiel pour chaque entreprise de comprendre (et de mettre en œuvre, le cas échéant) pour gouverner efficacement ses parcours d'IA.

Les considérations clés pour la gouvernance de l'IA sont regroupées logiquement en cinq piliers fondamentaux, conçus et séquencés pour refléter les structures organisationnelles et les personas typiques des entreprises.

- Organisation de l'IA

- Conformité légale et réglementaire

- Éthique, transparence et interprétabilité

- Données, AI Ops et infrastructure

- Sécurité de l'IA

Un framework pour la gouvernance de l'IA

Organisation de l'IA

L'organisation de l'IA intègre la gouvernance de l'IA dans la stratégie de gouvernance plus large de l'organisation. Elle souligne le fondement d'un programme d'IA efficace à travers des bonnes pratiques telles que des objectifs commerciaux clairement définis et l'intégration de pratiques de gouvernance appropriées qui supervisent les personnes, les processus, la technologie et les données de l'organisation. Elle explique comment les organisations peuvent établir la supervision nécessaire pour atteindre leurs objectifs stratégiques tout en réduisant les risques.

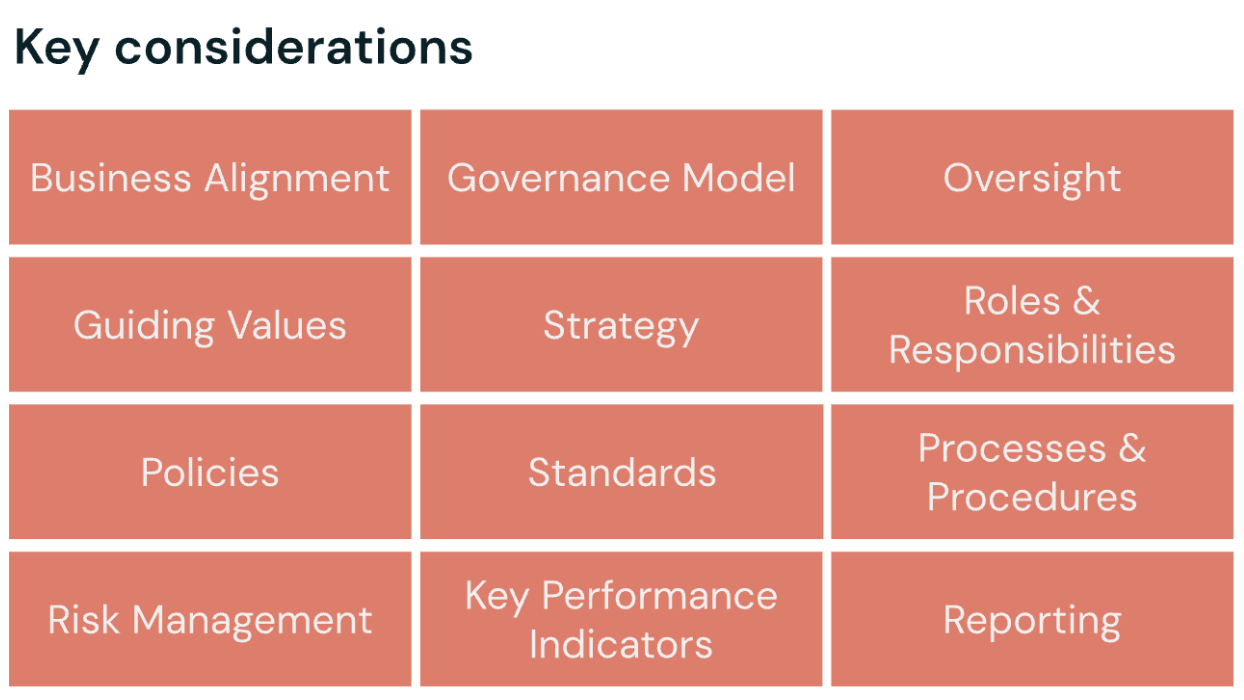

Considérations clés pour une organisation efficace de la gouvernance de l'IA

- Alignement métier

- Modèle de gouvernance

- Supervision

- Valeurs directrices

- Stratégie

- Rôles & responsabilités

- Politiques

- Standard

- Processus et procédures

- Gestion des risques

- Indicateurs de performance clés

- Reporting

Téléchargez le cadre de gouvernance de l'IA pour connaître les étapes à suivre pour commencer.

Conformité légale et réglementaire des initiatives d'IA

Le pilier Conformité légale et réglementaire aide les organisations à aligner les initiatives d'IA avec les lois et réglementations applicables. Il guide la gestion des risques juridiques, l'interprétation des exigences sectorielles et l'adaptation des stratégies de conformité en réponse à l'évolution des paysages réglementaires. Le résultat est que les programmes d'IA sont développés et déployés dans un cadre juridique et réglementaire solide.

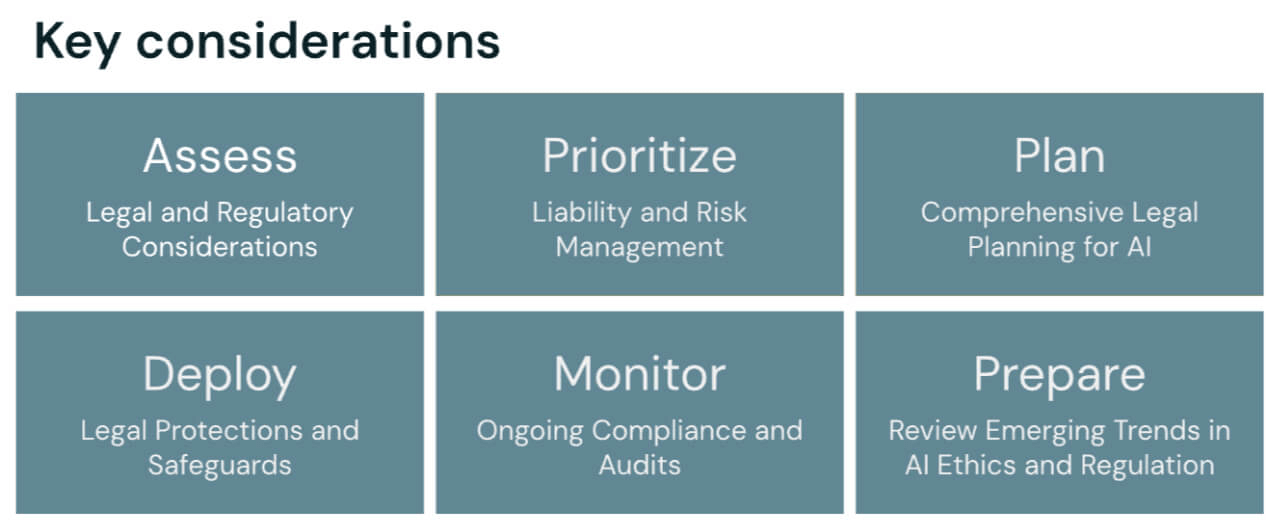

Étapes pour aligner les initiatives d'IA avec les lois et réglementations

- Évaluer les considérations juridiques et réglementaires

- Donner la priorité à la gestion de la responsabilité et des risques

- Planifier un examen juridique complet

- Déployer des protections et des garanties juridiques

- Surveiller la conformité en continu et effectuer des audits réguliers

- Examiner les nouvelles tendances en matière d'éthique et de réglementation de l'IA

Éthique, transparence et interprétabilité des programmes d'IA

Au sein des organisations qui développent des systèmes d'IA dignes de confiance et responsables, il est important de respecter des principes éthiques tels que l'équité, la responsabilité et la supervision humaine, tout en favorisant l'explicabilité et l'engagement des parties prenantes. Ce pilier du cadre de gouvernance de l'IA fournit des méthodes pour établir la responsabilité et la structure au sein des équipes organisationnelles, aidant à garantir que les décisions en matière d'IA sont interprétables, alignées sur les normes éthiques en constante évolution, et favorisant la confiance à long terme et l'acceptation sociétale.

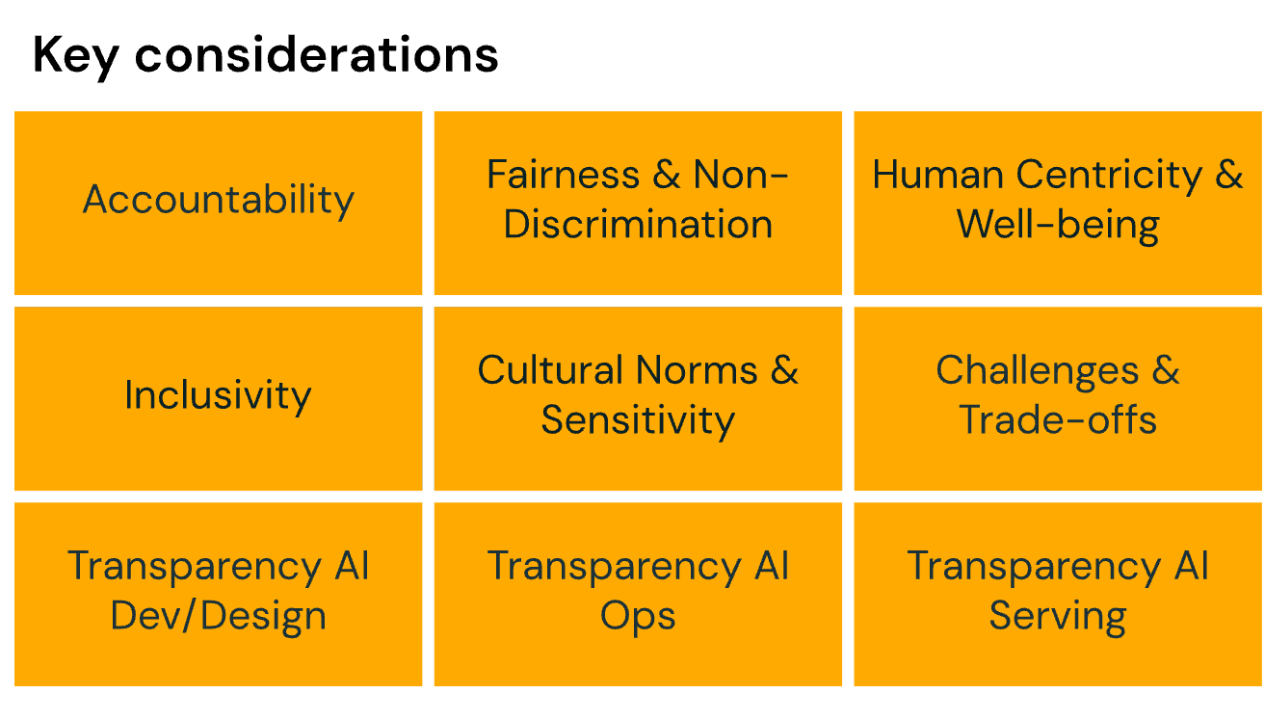

Lors de la conception de programmes d'IA et de la mise en place d'outils de gouvernance de l'IA, réfléchissez à la manière dont vous aborderez les points suivants :

- Responsabilité

- Équité et non-discrimination

- Centricité humaine et bien-être

- Inclusivité

- Normes culturelles et sensibilité

- Défis et compromis de tout ce qui précède

- Transparence dans le développement et la conception de l'IA

- Transparence dans les opérations d'IA

- Transparence dans la mise en service de l'IA

Données, AI Ops et infrastructure pour la gouvernance de l'IA

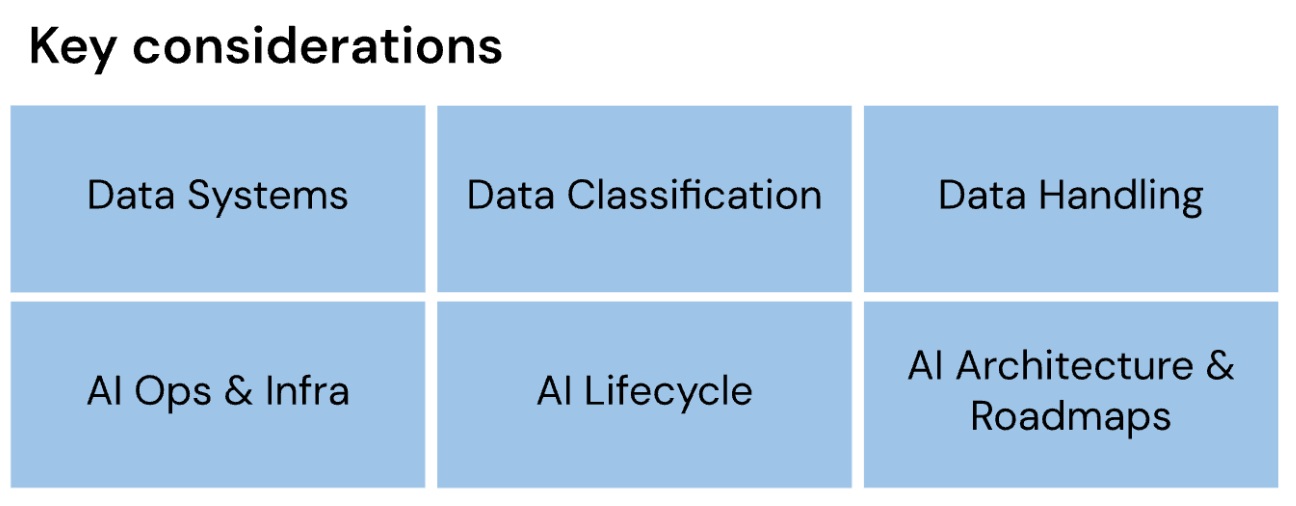

Le pilier Données, Opérations d'IA (AIOps) et Infrastructure définit la base sur laquelle les organisations s'appuient pour déployer et maintenir pleinement l'IA. Vous aurez besoin de directives pour créer une infrastructure d'IA évolutive et fiable, gérer le cycle de vie du machine learning et garantir la qualité, la sécurité et la conformité des données. Ce pilier met également l'accent sur les bonnes pratiques pour les opérations d'IA, y compris l'entraînement, l'évaluation, le déploiement et le monitoring des modèles, afin que les systèmes d'IA soient fiables, efficaces et alignés sur les objectifs de l'entreprise.

Pilier V : Sécurité de l'IA

Le pilier Sécurité de l'IA présente le cadre de sécurité Databricks AI (DASF), un cadre complet pour comprendre et atténuer les risques de sécurité tout au long du cycle de vie de l'IA. Il couvre des domaines critiques tels que la protection des données, la gestion des modèles, la diffusion sécurisée de modèles et la mise en œuvre de mesures de cybersécurité robustes pour protéger les AI assets.

Connexe : découvrez un exemple de présentation expliquant comment une organisation peut tirer parti du cadre de gouvernance de l'IA pour créer une appropriation et un alignement clairs tout au long du cycle de vie du programme d'IA. Regardez cette présentation faite lors du Data + AI Summit 2025.

Cadre de gouvernance de l'IA

Le livre blanc Cadre de gouvernance de l'IA est disponible pour les organisations qui cherchent à développer leur propre gouvernance de l'IA.

Veuillez nous contacter par e-mail à l'adresse [email protected] pour toute question ou tout commentaire. Si vous souhaitez contribuer aux futures mises à jour de ce cadre (et à d'autres artefacts à venir) en rejoignant notre communauté de réviseurs, nous serions également ravis d'avoir de vos nouvelles !

Principes clés pour une gouvernance efficace de l'IA

La gouvernance de l'IA repose sur un ensemble cohérent de principes fondamentaux qui s'appliquent à chaque étape du cycle de vie de l'IA. Ces principes garantissent que les systèmes d'IA sont développés et déployés de manière responsable, tout en fournissant une structure nécessaire aux organisations pour répondre aux attentes réglementaires, maintenir la confiance des parties prenantes et atténuer les risques à mesure que leur adoption monte en charge. Des principes tels que la transparence, la responsabilité, l'équité et la surveillance humaine sont au cœur de toute stratégie efficace.

La transparence commence par une documentation claire et accessible des sources de données, des hypothèses de modèle, des méthodologies d'entraînement et des processus d'évaluation. Une pratique de transparence nécessite un suivi systématique de la traçabilité, du contrôle des versions et des comportements du modèle afin que les équipes puissent retracer la manière dont les décisions sont prises et identifier les facteurs contributifs lorsque des problèmes surviennent. Les outils de gouvernance qui centralisent les métadonnées, les pistes d'audit et les politiques d'accès soutiennent ce travail en rendant les détails opérationnels visibles et vérifiables entre les équipes.

La gouvernance de l'IA devrait également donner la priorité aux mesures de responsabilisation afin que tout système d'IA dispose de propriétaires clairement définis responsables des résultats, de la gestion des risques et du respect des normes de gouvernance. Un cadre de responsabilisation efficace établit des rôles au sein des groupes commerciaux, techniques, juridiques et de conformité ; distribue les droits de décision ; et crée des mécanismes d'escalade en cas de comportement inattendu du modèle ou de préoccupations éthiques. De plus, la création d'indicateurs clés de performance (KPI) et de seuils de performance peut donner aux dirigeants des points de référence mesurables pour évaluer les systèmes d'IA au fil du temps.

Le principe d'équité exige d'identifier et d'atténuer de manière proactive les biais tout au long de la collecte des données, de l'entraînement des modèles et du monitoring de la production. Des techniques telles que l'analyse de l'impact disparate, les métriques de détection des biais et les stratégies d'échantillonnage représentatif peuvent aider les équipes à comprendre comment les résultats des modèles varient entre les groupes d'utilisateurs. Les évaluations continues de l'équité permettent aux organisations d'identifier le drift ou les iniquités à mesure que l'utilisation en conditions réelles évolue.

Enfin, la supervision humaine aide les systèmes d'IA à s'aligner sur les valeurs organisationnelles et les exigences réglementaires. Cette étape consiste à définir où une validation humaine est requise, à concevoir des procédures de fallback claires et à s'assurer que des experts du domaine peuvent intervenir lorsque les résultats du modèle sont ambigus, à haut risque ou sensibles. Les mécanismes de supervision devraient être intégrés à la fois dans les workflows de développement et les opérations de production afin que les garde-fous restent actifs tout au long du cycle de vie de l'IA.

Mettre en œuvre des pratiques d'IA responsable

Les pratiques d'IA responsable sont les garde-fous qui garantissent que les systèmes d'IA servent les personnes, les entreprises et la société de manière sûre, équitable et alignée sur les valeurs de l'organisation. La mise en œuvre de ces pratiques nécessite une approche holistique sur l'ensemble du cycle de vie de l'IA. De la source de données et du développement de modèles au déploiement, au monitoring et au retrait final, chaque étape est une occasion d'intégrer des garde-fous. En bref, l'objectif de toute pratique d'IA responsable est de réduire les préjudices, de renforcer la confiance et d'améliorer les performances du système au fil du temps.

Un élément essentiel de l'IA responsable consiste à aligner le comportement du système sur les valeurs humaines et les principes organisationnels. Cela commence par la définition de l'utilisation prévue d'un modèle (y compris les scénarios sensibles ou à fort impact) et l'établissement d'exigences en matière de confidentialité, d'équité, de sécurité et d'explicabilité. Il est crucial d'intégrer ces critères au début du processus de conception afin que les équipes abordent explicitement les considérations éthiques, plutôt que de simplement réagir de manière réactive. Des techniques spécifiques aident les systèmes d'IA à fonctionner de manière cohérente avec les attentes des utilisateurs et les normes sociétales, telles que les outils d'interprétabilité des modèles, les training datasets représentatifs et les processus de révision avec intervention humaine.

De plus, l'identification et l'atténuation des risques doivent être directement intégrées dans les flux de travail de développement. Les organisations doivent évaluer les risques tels que le biais, le drift du modèle, les hallucinations, la fuite de données et les résultats dangereux, et développer des stratégies d'atténuation liées à chacun. Ces stratégies peuvent également inclure la confidentialité différentielle, le filtrage des invites et des résultats, les tests adversariaux et les exercices de red teaming adaptés aux risques spécifiques au domaine. Au fur et à mesure de ces tests, les équipes doivent documenter les évaluations des risques et les contrôles afin d'assurer la transparence et de répondre aux exigences réglementaires et d'audit interne.

La mise en œuvre de pratiques d'IA responsable est un job continu. Même les modèles bien gouvernés peuvent se dégrader à mesure que les distributions de données changent ou que de nouvelles exigences apparaissent. Les équipes doivent établir des pipelines de monitoring automatisés pour les aider à suivre les métriques de performance, les indicateurs d'équité et la conformité aux politiques en production. Lorsque des problèmes surviennent, les procédures de réentraînement, les examens structurés des incidents et la documentation mise à jour garantissent que les systèmes d'IA évoluent de manière responsable.

Il est important pour toute équipe de trouver un équilibre entre l'innovation et la prudence. Les équipes doivent créer des parcours qui permettent l'expérimentation, tels que des environnements sandbox ou des déploiements pilotes contrôlés, tout en maintenant des garde-fous pour éviter tout préjudice involontaire. Cet équilibre permet aux organisations d'explorer de nouvelles capacités d'IA générative tout en respectant les attentes en matière de gouvernance et les normes éthiques.

Premiers pas avec la mise en œuvre du DAGF

La mise en œuvre du Databricks AI Governance Framework (DAGF) commence par une Feuille de route claire et pratique qui guide les organisations de la planification initiale aux Opérations à l'échelle de l'entreprise. La première étape consiste à établir des structures de gouvernance fondamentales : définir les rôles et les responsabilités, documenter les cas d'utilisation de l'IA et évaluer la préparation de l'organisation en matière de qualité des données, de pratiques de développement de modèles et d'exigences de conformité. Cet alignement initial garantit que les efforts de gouvernance soutiennent directement les priorités commerciales et la tolérance au risque.

Un modèle de maturité peut aider les organisations à évaluer où elles en sont aujourd'hui et à identifier les prochaines étapes de leur parcours de gouvernance. Par exemple, les programmes à un stade précoce se concentrent sur la documentation des actifs d'IA, la centralisation des contrôles d'accès et l'établissement de politiques de base pour l'utilisation des données, le développement de modèles et leur examen. À mesure de leur maturation, les organisations peuvent commencer à introduire des workflows standardisés, un lignage et un monitoring automatisés, ainsi que des comités interfonctionnels qui supervisent la Gestion des risques et de la conformité de l'IA. Enfin, les programmes entièrement matures opérationnalisent la gouvernance tout au long du cycle de vie, ce qui inclut des pipelines reproductibles, une évaluation continue des modèles et des processus bien définis pour le réentraînement, l'audit et la réponse aux incidents.

Même si un cadre de gouvernance est mis en œuvre avec le plus grand soin, les organisations sont confrontées à certains écueils courants. Par exemple, beaucoup rencontrent des difficultés lorsque la gouvernance est traitée après coup ou confiée à une seule équipe sans responsabilité claire. D'autres peuvent sous-estimer le rôle des données de haute qualité et ne pas mettre en œuvre certaines pratiques fondamentales telles que l'application du schéma, le suivi de la traçabilité des données et le contrôle d'accès. Ces lacunes peuvent sembler mineures en apparence, mais elles peuvent créer des défis en aval en matière de transparence, de reproductibilité et d'auditabilité. L'établissement d'une responsabilité partagée entre les équipes commerciales, techniques et de conformité, ainsi que le fait d'ancrer la gouvernance dans de solides pratiques d'ingénierie des données, peut aider à prévenir ce problème au sein d'une organisation.

Pour évaluer le succès, les organisations doivent suivre les progrès et mesurer l'impact des investissements dans la gouvernance. Les métriques peuvent inclure la réduction des incidents liés aux modèles et des constatations de biais, l'amélioration de la reproductibilité des modèles, l'augmentation de l'exhaustivité de la documentation, la réduction des cycles de révision, l'accélération des approbations pour les nouveaux cas d'utilisation de l'IA et une plus grande adoption des pipelines et outils standardisés. Au fil du temps, ces indicateurs démontrent que la gouvernance est une fonction essentielle pour la fiabilité, la conformité et l'efficacité opérationnelle.

La mise en œuvre de la gouvernance doit être une approche progressive qui aide les organisations à s'aligner soigneusement sur leurs ressources et leurs objectifs. Beaucoup commencent par des cas d'utilisation à fort impact, en appliquant des contrôles de gouvernance aux modèles les plus sensibles ou les plus critiques pour l'entreprise avant de les étendre à des programmes plus larges. Cependant, itérer et mettre à l'échelle de manière incrémentielle peut aider les organisations à construire une base de gouvernance durable qui soutient une adoption sûre, transparente et fiable de l'IA au sein de l'organisation.

Pourquoi Databricks mène cette initiative

En tant que leader du secteur des données et de l'IA, avec plus de 15 000 clients dans diverses zones géographiques et divers segments de marché, Databricks a continué à honorer son engagement en faveur des principes de développement responsable et d'innovation open source. Nous avons respecté ces engagements grâce à :

- Engagement dans les efforts de l'industrie et du gouvernement pour promouvoir l'innovation et plaider en faveur de l'utilisation d'une IA sûre et digne de confiance

- Ateliers interactifs pour former les organisations à piloter avec succès leur parcours d'IA de manière consciente des risques.

- Mise en open source d'innovations de gouvernance clés telles que MLFlow et Unity Catalog, la seule solution unifiée du secteur pour la gouvernance des données et de l'IA sur les clouds, les formats de données et les plateformes de données.

Ces programmes nous ont offert une visibilité unique sur les problèmes pratiques auxquels les entreprises et les régulateurs sont confrontés aujourd'hui en matière de gouvernance de l'IA. Pour renforcer notre engagement à aider chaque entreprise à réussir et à accélérer son parcours en matière de données et d'IA, nous avons décidé de tirer parti de cette visibilité pour créer (et mettre gratuitement à disposition) un cadre de gouvernance de l'IA qui soit complet, structuré et exploitable.

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.