Apprendimento dell'agente dal feedback umano (ALHF): un caso di studio di Databricks Knowledge Assistant

In questo blog, approfondiamo Agent Learning from Human Feedback (ALHF) — un nuovo paradigma di machine learning in cui gli agenti apprendono direttamente da un feedback minimo in linguaggio naturale, non solo da ricompense numeriche o etichette statiche. Ciò consente un adattamento più rapido e intuitivo degli agenti per le applicazioni aziendali, dove le aspettative sono spesso specializzate e difficili da formalizzare.

ALHF potenzia il prodotto Databricks Agent Bricks. Nel nostro caso di studio, esaminiamo Agent Bricks Knowledge Assistant (KA) - che migliora continuamente le sue risposte attraverso il feedback degli esperti. Come mostrato nella Figura 1, ALHF aumenta drasticamente la qualità complessiva delle risposte su Databricks DocsQA con appena 4 record di feedback. Con soli 32 record di feedback, quadruplichiamo la qualità delle risposte rispetto ai baseline statici. Il nostro caso di studio dimostra l'efficacia di ALHF e apre una nuova e interessante direzione per la ricerca sugli agenti.

La Promessa degli Agenti AI Insegnabili

Lavorando con i clienti enterprise di Databricks, una sfida chiave che abbiamo osservato è che molti casi d'uso AI enterprise dipendono da logiche di business interne altamente specializzate, dati proprietari e aspettative intrinseche, che non sono note esternamente (vedi il nostro Domain Intelligence Benchmark per saperne di più). Pertanto, anche i sistemi più avanzati necessitano di una messa a punto sostanziale per soddisfare la soglia di qualità dei casi d'uso enterprise.

Per mettere a punto questi sistemi, gli approcci esistenti si basano su output espliciti di verità di base, che sono costosi da raccogliere, o su modelli di ricompensa, che forniscono solo segnali binari/scalari. Per risolvere queste sfide, descriviamo Agent Learning from Human Feedback (ALHF), un paradigma di apprendimento in cui un agente adatta il suo comportamento incorporando una piccola quantità di feedback in linguaggio naturale da parte di esperti. Questo paradigma offre un canale naturale ed economicamente vantaggioso per l'interazione umana e consente al sistema di apprendere da segnali di aspettativa ricchi.

Esempio

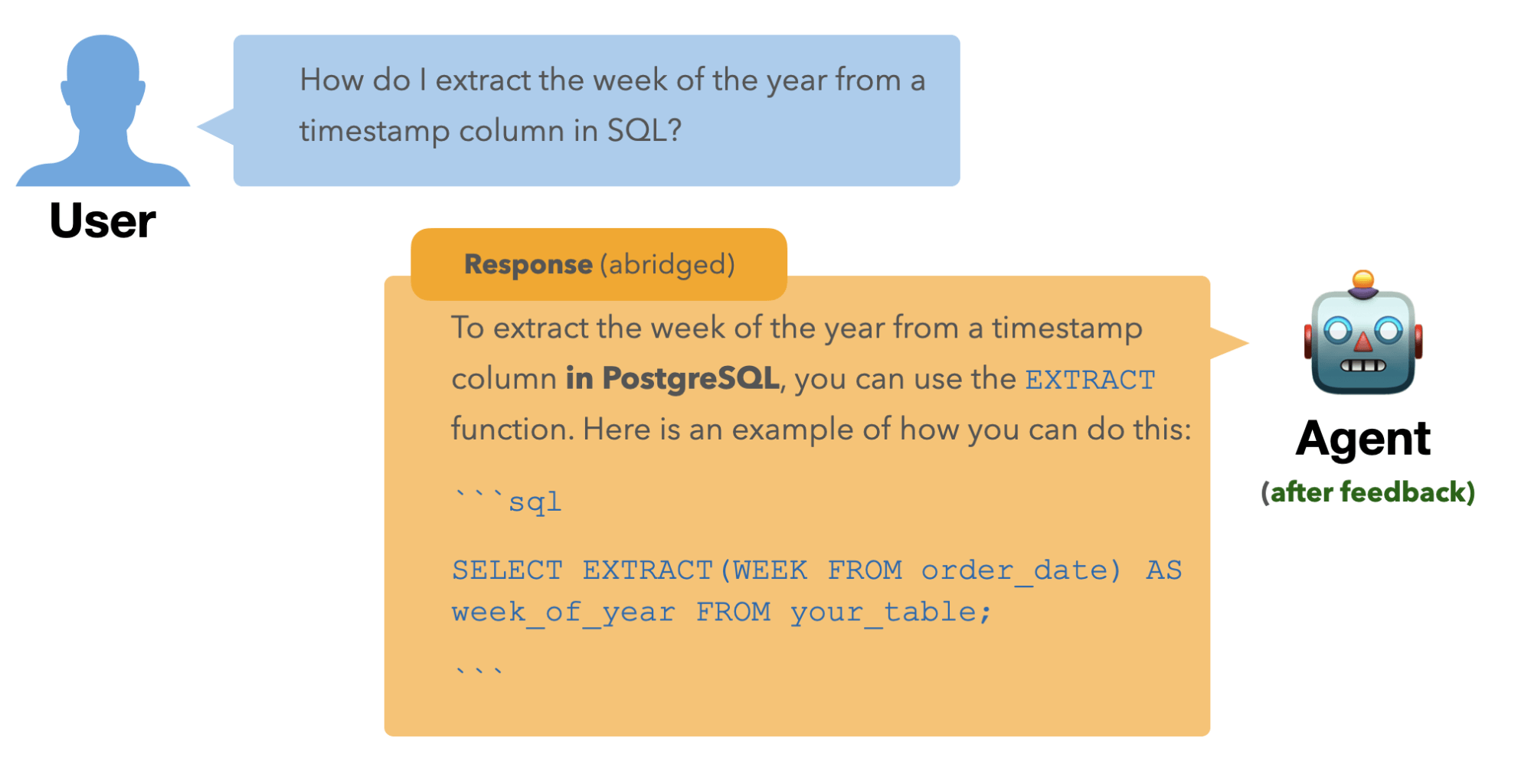

Supponiamo di creare un agente di Question Answering (QA) per rispondere a domande per un'azienda di database ospitati. Ecco una domanda di esempio:

L'agente ha suggerito di utilizzare la funzione weekofyear(), supportata in più varianti di SQL (MySQL, MariaDB, ecc.). Questa risposta è corretta in quanto, se utilizzata in modo appropriato, weekofyear() raggiunge la funzionalità desiderata. Tuttavia, non è supportata in PostgreSQL, la variante SQL preferita dal nostro gruppo di utenti. Il nostro Esperto di Materia (SME) può fornire un feedback in linguaggio naturale sulla risposta per comunicare questa aspettativa come sopra, e l'agente si adatterà di conseguenza:

ALHF adatta le risposte del sistema non solo per questa singola domanda, ma anche per domande in conversazioni future in cui il feedback è rilevante, ad esempio:

Come mostra questo esempio, ALHF offre a sviluppatori e SME un modo semplice e intuitivo per guidare il comportamento di un agente utilizzando il linguaggio naturale, allineandolo alle loro aspettative.

ALHF in Agent Bricks

Utilizzeremo un caso d'uso specifico del prodotto Agent Bricks - Knowledge Assistant - come caso di studio per dimostrare la potenza di ALHF.

Knowledge Assistant (KA) fornisce un approccio dichiarativo per creare un chatbot sui tuoi documenti, offrendo risposte affidabili e di alta qualit�à con citazioni. KA sfrutta ALHF per apprendere continuamente le aspettative degli esperti dal feedback in linguaggio naturale e migliorare la qualità delle sue risposte.

KA chiede innanzitutto istruzioni di alto livello sul compito. Una volta connesso alle fonti di conoscenza pertinenti, inizia a rispondere alle domande. Gli esperti possono quindi utilizzare una modalità Migliora Qualità per rivedere le risposte e lasciare feedback, che KA incorpora tramite ALHF per affinare le risposte future.

Valutazione

Per dimostrare il valore di ALHF in KA, valutiamo KA utilizzando DocsQA – un set di dati di domande e risposte di riferimento sulla documentazione di Databricks, parte del nostro Domain Intelligence Benchmark. Per questo set di dati, abbiamo anche un insieme di aspettative definite dagli esperti. Per un piccolo set di risposte candidate generate da KA, creiamo un breve feedback in linguaggio naturale (come nell'esempio precedente) basato su queste aspettative e forniamo il feedback a KA per affinare le sue risposte. Misuriamo quindi la qualità della risposta attraverso più cicli di feedback per valutare se KA si adatta con successo per soddisfare le aspettative degli esperti.

Si noti che mentre le risposte di riferimento riflettono la correttezza fattuale — se una risposta contiene informazioni pertinenti e accurate per rispondere alla domanda — non sono necessariamente ideali in termini di allineamento con le aspettative degli esperti. Come illustrato nel nostro esempio precedente, la risposta iniziale può essere fattualmente corretta per molte varianti di SQL, ma potrebbe comunque essere inadeguata se l'esperto si aspetta una risposta specifica per PostgreSQL.

Considerando queste due dimensioni di correttezza, valutiamo la qualità di una risposta utilizzando due giudici LLM:

- Completezza della Risposta: Quanto bene la risposta si allinea alla risposta di riferimento dal set di dati. Questo funge da misura di base della correttezza fattuale.

- Aderenza al Feedback : Quanto bene la risposta soddisfa le specifiche aspettative dell'esperto. Questo misura la capacità dell'agente di adattare il proprio output in base a criteri personalizzati.

Risultati

La Figura 2 mostra come KA migliora in qualità con cicli crescenti di feedback degli esperti su DocsQA. Riportiamo i risultati per un set di test tenuto nascosto.

- Completezza della Risposta: Senza feedback, KA produce già risposte di alta qualità paragonabili ai principali sistemi concorrenti. Con fino a 32 pezzi di feedback, la Completezza della Risposta di KA migliora di 12 punti percentuali, superando chiaramente i concorrenti.

- Aderenza al Feedback: La distinzione tra Aderenza al Feedback e Completezza della Risposta è evidente: tutti i sistemi iniziano con bassi punteggi di aderenza senza feedback. Ma è qui che ALHF eccelle: con il feedback, il punteggio di aderenza di KA salta dall'11,7% a quasi l'80%, mostrando l'impatto drastico di ALHF.

Nel complesso, ALHF è un meccanismo efficace per affinare e adattare il comportamento di un sistema per soddisfare le specifiche aspettative degli esperti. In particolare, è altamente efficiente in termini di campioni: non sono necessarie centinaia o migliaia di esempi, ma si possono osservare chiari miglioramenti con una piccola quantità di feedback.

ALHF: la sfida tecnica

Questi risultati impressionanti sono possibili perché KA affronta con successo due sfide tecniche fondamentali di ALHF.

Imparare quando applicare il feedback

Quando un esperto fornisce un feedback su una domanda, come fa l'agente a sapere quali domande future beneficeranno della stessa intuizione? Questa è la sfida dello scoping — determinare l'ambito di applicabilità corretto per ogni pezzo di feedback. O, in alternativa, determinare la pertinenza di un pezzo di feedback rispetto a una domanda.

Considera il nostro esempio PostgreSQL. Quando l'esperto dice "la risposta dovrebbe essere compatibile con PostgreSQL", questo feedback non dovrebbe solo correggere quella singola risposta. Dovrebbe informare tutte le future domande relative a SQL. Ma non dovrebbe influenzare query non correlate, come "Dovrei usare matplotlib o seaborn per questo grafico?"

Adottiamo un approccio di memoria dell'agente che registra tutto il feedback precedente e consente all'agente di recuperare in modo efficiente il feedback pertinente per una nuova domanda. Ciò consente all'agente di determinare dinamicamente e in modo olistico quali intuizioni sono più pertinenti alla domanda corrente.

Adattare i giusti componenti del sistema

La seconda sfida è l'assegnazione — capire quali parti del sistema devono cambiare in risposta al feedback. KA non è un singolo modello; è una pipeline multi-componente che genera query di ricerca, recupera documenti e produce risposte. Un ALHF efficace richiede l'aggiornamento dei componenti giusti nei modi giusti.

KA è progettato con un set di componenti basati su LLM che sono parametrizzati dal feedback. Ogni componente è un modulo che accetta il feedback pertinente e adatta il suo comportamento di conseguenza. Prendendo l'esempio precedente, in cui l'esperto fornisce il seguente feedback sull'esempio di estrazione della data:

Successivamente, l'utente pone una domanda correlata: "Come ottengo la differenza tra due date in SQL?". Senza ricevere alcun nuovo feedback, KA applica automaticamente ciò che ha appreso dall'interazione precedente. Inizia modificando la query di ricerca nella fase di recupero, adattandola al contesto:

Quindi, produce una risposta specifica per PostgreSQL:

Instradando precisamente il feedback ai componenti appropriati di recupero e generazione delle risposte, ALHF garantisce che l'agente impari e generalizzi efficacemente dal feedback degli esperti.

Cosa significa ALHF per te: all'interno di Agent Bricks

Agent Learning from Human Feedback (ALHF) rappresenta un passo avanti significativo nel consentire agli agenti AI di comprendere e adattarsi veramente alle aspettative degli esperti. Consentendo al feedback in linguaggio naturale di modellare incrementalmente il comportamento di un agente, ALHF fornisce un meccanismo flessibile, intuitivo e potente per guidare i sistemi AI verso specifiche esigenze aziendali. Il nostro studio di caso con Knowledge Assistant dimostra come ALHF possa aumentare drasticamente la qualità delle risposte e l'aderenza alle aspettative degli esperti, anche con un feedback minimo. Come ha affermato Patrick Vinton, Chief Technology Officer presso Analytics8, un cliente KA:

“Sfruttando Agent Bricks, Analytics8 ha ottenuto un aumento del 40% nell'accuratezza delle risposte con tempi di implementazione l'800% più rapidi per i nostri casi d'uso, che vanno da semplici assistenti HR ad assistenti di ricerca complessi basati su white paper e documentazione estremamente tecnici e multimodali. Dopo il lancio, abbiamo anche osservato che la qualità delle risposte continua a salire.”

ALHF è ora una funzionalità integrata nel prodotto Agent Bricks, che consente ai clienti Databricks di distribuire soluzioni AI aziendali altamente personalizzate. Incoraggiamo tutti i clienti interessati a sfruttare la potenza dell'IA insegnabile a contattare i propri Team di Account Databricks e provare KA e altri casi d'uso di Agent Bricks per esplorare come ALHF può trasformare i loro flussi di lavoro di IA generativa.

Veronica Lyu e Kartik Sreenivasan hanno contribuito in egual misura

Autori: Veronica Lyu, Kartik Sreenivasan, Moonsoo Lee, Michael Bendersky, Alkis Polyzotis, Xiangrui Meng, Omar Khattab, Sam Havens, Michael Carbin e Matei Zaharia

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.