Navigare la migrazione da Oracle a Databricks: suggerimenti per una transizione senza intoppi

Strategie, Strumenti e Best Practice per la Transizione all'Architettura Lakehouse

- Comprendi come l'architettura Lakehouse si confronta con il tradizionale modello di data warehouse relazionale di Oracle.

- Scopri come inventariare gli oggetti del database e tradurre schemi specifici di Oracle in formati supportati da Databricks.

- Esegui passaggi post-migrazione per convalidare l'integrità dei dati, eseguire sistemi paralleli per i test aziendali e ottimizzare le prestazioni.

Man mano che più organizzazioni adottano architetture lakehouse, la migrazione da data warehouse legacy come Oracle a piattaforme moderne come Databricks è diventata una priorità comune. I vantaggi—migliore scalabilità, prestazioni ed efficienza dei costi—sono chiari, ma il percorso per arrivarci non è sempre lineare.

In questo post, condividerò strategie pratiche per gestire la migrazione da Oracle a Databricks, inclusi suggerimenti per evitare insidie comuni e impostare il tuo progetto per il successo a lungo termine.

Comprendere le differenze chiave

Prima di discutere le strategie di migrazione, è importante comprendere le differenze fondamentali tra Oracle e Databricks—non solo in termini di tecnologia, ma anche di differenze architetturali.

Il modello relazionale di Oracle vs. l'architettura lakehouse di Databricks

I data warehouse Oracle seguono un modello relazionale tradizionale ottimizzato per carichi di lavoro strutturati e transazionali. Databricks è una soluzione perfetta per ospitare carichi di lavoro di data warehouse, indipendentemente dal modello di dati utilizzato, simile ad altri sistemi di gestione di database come Oracle. Al contrario, Databricks è costruito su un'architettura lakehouse, che unisce la flessibilità dei data lake con le prestazioni e l'affidabilità dei data warehouse.

Questo passaggio cambia il modo in cui i dati vengono archiviati, elaborati e acceduti—ma sblocca anche possibilità completamente nuove. Con Databricks, le organizzazioni possono:

- Supportare casi d'uso moderni come il machine learning (ML), l'IA tradizionale e l'IA generativa

- Sfruttare la separazione tra archiviazione e calcolo, consentendo a più team di avviare magazzini indipendenti accedendo agli stessi dati sottostanti

- Abbattare i silos di dati e ridurre la necessità di pipeline ETL ridondanti

Dialetti SQL e differenze di elaborazione

Entrambe le piattaforme supportano SQL, ma ci sono differenze nella sintassi, nelle funzioni integrate e nel modo in cui le query vengono ottimizzate. Queste variazioni devono essere affrontate durante la migrazione per garantire compatibilità e prestazioni.

Elaborazione dati e scalabilità

Oracle utilizza un'architettura basata su righe e scalata verticalmente (con scalabilità orizzontale limitata tramite Real Application Clusters). Databricks, d'altra parte, utilizza il modello distribuito di Apache Spark™, che supporta la scalabilità sia orizzontale che verticale su grandi set di dati.

Databricks funziona anche nativamente con Delta Lake e Apache Iceberg, formati di archiviazione colonnare ottimizzati per analisi su larga scala e ad alte prestazioni. Questi formati supportano funzionalità come transazioni ACID, evoluzione dello schema e time travel, che sono fondamentali per la creazione di pipeline resilienti e scalabili.

Passaggi pre-migrazione (comuni a tutte le migrazioni di data warehouse)

Indipendentemente dal tuo sistema di origine, una migrazione di successo inizia con alcuni passaggi critici:

- Inventaria il tuo ambiente: Inizia catalogando tutti gli oggetti del database, le dipendenze, i modelli di utilizzo e i flussi di lavoro ETL o di integrazione dei dati. Questo fornisce le basi per comprendere l'ambito e la complessità.

- Analizza i modelli di flusso di lavoro: Identifica come i dati fluiscono attraverso il tuo sistema attuale. Ciò include carichi di lavoro batch vs. streaming, dipendenze dei carichi di lavoro e qualsiasi logica specifica della piattaforma che potrebbe richiedere una riprogettazione.

- Dai priorità e pianifica la tua migrazione: Evita un approccio “big bang”. Invece, suddividi la tua migrazione in fasi gestibili in base al rischio, all'impatto aziendale e alla prontezza. Collabora con i team Databricks e i partner di integrazione certificati per costruire un piano realistico e a basso rischio che si allinei ai tuoi obiettivi e alle tue tempistiche.

Strategie di migrazione dei dati

Una migrazione dati di successo richiede un approccio ponderato che affronti sia le differenze tecniche tra le piattaforme sia le caratteristiche uniche dei tuoi asset di dati. Le seguenti strategie ti aiuteranno a pianificare ed eseguire un processo di migrazione efficiente massimizzando i vantaggi dell'architettura di Databricks.

Traduzione e ottimizzazione dello schema

Evita di copiare gli schemi Oracle direttamente senza ripensarne il design per Databricks. Ad esempio, il tipo di dati NUMBER di Oracle supporta una maggiore precisione rispetto a quanto consentito da Databricks (precisione e scala massime di 38). In tali casi, potrebbe essere più appropriato utilizzare tipi DOUBLE invece di cercare di mantenere corrispondenze esatte.

Tradurre gli schemi in modo ponderato garantisce la compatibilità ed evita problemi di prestazioni o accuratezza dei dati in futuro.

Per maggiori dettagli, consulta la Guida alla migrazione da Oracle a Databricks.

Approcci di estrazione e caricamento dati

Le migrazioni da Oracle spesso comportano lo spostamento di dati da database on-premises a Databricks, dove la larghezza di banda e il tempo di estrazione possono diventare colli di bottiglia. La tua strategia di estrazione dovrebbe essere allineata al volume dei dati, alla frequenza degli aggiornamenti e alla tolleranza per i tempi di inattività.

Le opzioni comuni includono:

- Connessioni JDBC – utili per set di dati più piccoli o trasferimenti a basso volume

- Lakehouse Federation – per replicare i data mart direttamente su Databricks

- Azure Data Factory o AWS Database Migration Services – per il movimento dati orchestrato su larga scala

- Strumenti di esportazione nativi Oracle:

- DBMS_CLOUD.EXPORT_DATA (disponibile su Oracle Cloud)

- SQL Developer unload (per uso on-premises o locale)

- Configurazione manuale di DBMS_CLOUD su deployment on-premises Oracle 19.9+

- Opzioni di trasferimento bulk – come AWS Snowball o Microsoft Data Box, per spostare tabelle storiche di grandi dimensioni nel cloud

La scelta dello strumento giusto dipende dalle dimensioni dei dati, dai limiti di connettività e dalle esigenze di recupero.

Ottimizzare per le prestazioni

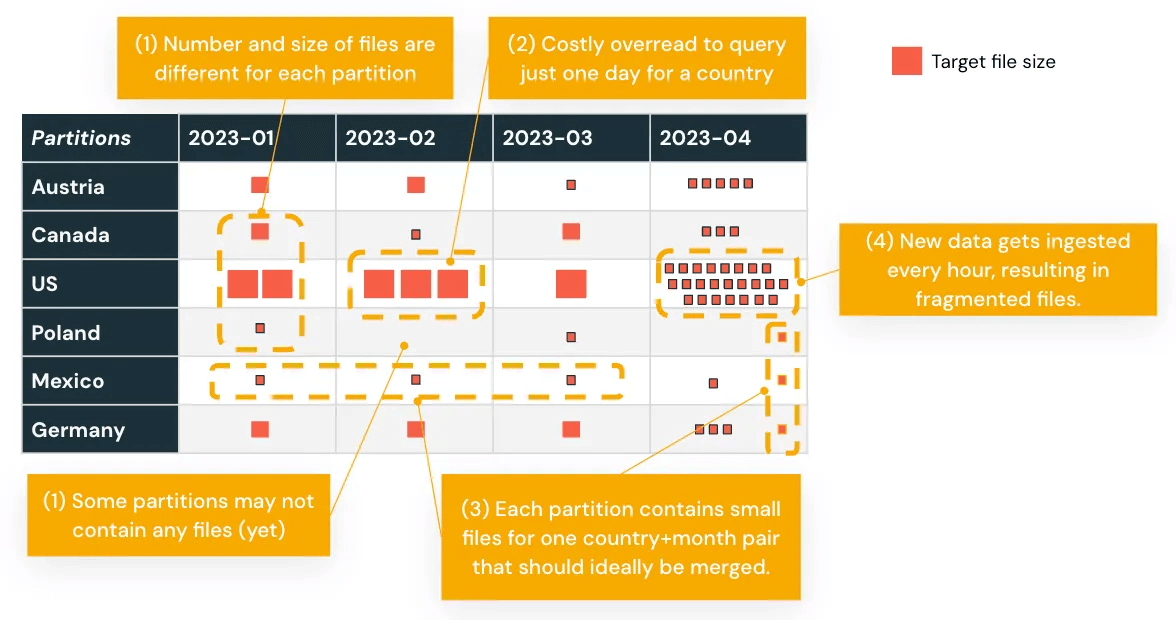

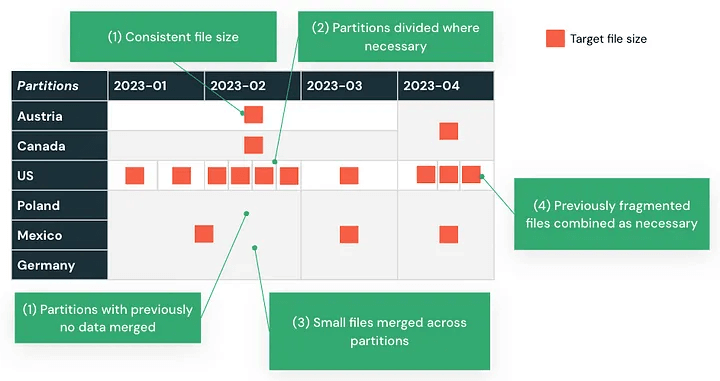

I dati migrati spesso devono essere rimodellati per funzionare bene in Databricks. Questo inizia ripensando come vengono partizionati i dati.

Se il tuo data warehouse Oracle utilizzava partizioni statiche o sbilanciate, tali strategie potrebbero non tradursi bene. Analizza i tuoi pattern di query e ristruttura le partizioni di conseguenza. Databricks offre diverse tecniche per migliorare le prestazioni:

- Liquid Clustering automatico per l'ottimizzazione continua senza tuning manuale

- Z-Ordering per il clustering su colonne frequentemente filtrate

- Liquid Clustering per organizzare dinamicamente i dati

Inoltre:

- Comprimere file di piccole dimensioni per ridurre l'overhead

- Separare dati caldi e freddi per ottimizzare costi ed efficienza di archiviazione

- Evitare il sovra-partizionamento, che può rallentare le scansioni e aumentare l'overhead dei metadati

Ad esempio, il partizionamento basato su date di transazione che si traduce in una distribuzione non uniforme dei dati può essere ribilanciato utilizzando il Liquid Clustering automatico, migliorando le prestazioni per le query basate sul tempo.

Progettare tenendo conto del modello di elaborazione di Databricks garantisce che i tuoi carichi di lavoro scalino in modo efficiente e rimangano manutenibili dopo la migrazione.

Migrazione di codice e logica

Mentre la migrazione dei dati costituisce la base della tua transizione, lo spostamento della logica applicativa e del codice SQL rappresenta uno degli aspetti più complessi della migrazione da Oracle a Databricks. Questo processo comporta la traduzione della sintassi e l'adattamento a diversi paradigmi di programmazione e tecniche di ottimizzazione che si allineano con il modello di elaborazione distribuita di Databricks.

Strategie di traduzione SQL

Converti Oracle SQL in Databricks SQL utilizzando un approccio strutturato. Strumenti automatizzati come BladeBridge (ora parte di Databricks) possono analizzare la complessità del codice ed eseguire la traduzione bulk. A seconda della codebase, i tassi di conversione tipici sono intorno al 75% o superiori.

Questi strumenti aiutano a ridurre lo sforzo manuale e a identificare le aree che richiedono rilavorazioni o modifiche architetturali post-migrazione.

Migrazione di stored procedure

Evita di cercare sostituzioni esatte uno-a-uno per i costrutti PL/SQL di Oracle. Pacchetti come DBMS_X, UTL_X e CTX_X non esistono in Databricks e richiederanno la riscrittura della logica per adattarla alla piattaforma.

Per costrutti comuni come:

- Cursori

- Gestione delle eccezioni

- Cicli e istruzioni di controllo del flusso

Databricks ora offre SQL Scripting, che supporta SQL procedurale nei notebook. In alternativa, considera la conversione di questi flussi di lavoro in Python o Scala all'interno di Databricks Workflows o pipeline DLT, che offrono maggiore flessibilità e integrazione con l'elaborazione distribuita.

BladeBridge può assistere nella traduzione di questa logica in notebook Databricks SQL o PySpark come parte della migrazione.

Trasformazione del flusso di lavoro ETL

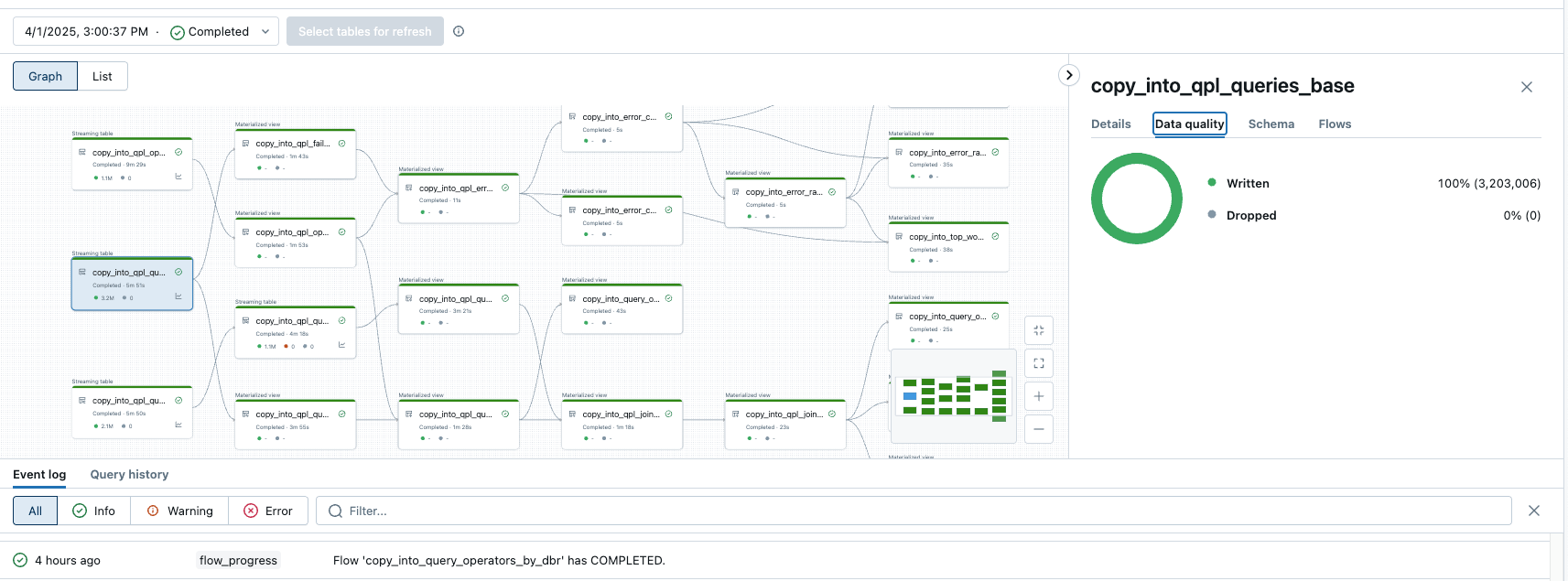

Databricks offre diversi approcci per la creazione di processi ETL che semplificano l'ETL Oracle legacy:

- Notebook Databricks con parametri – per attività ETL semplici e modulari

- DLT – per definire pipeline dichiarativamente con supporto per batch e streaming, elaborazione incrementale e controlli di qualità dei dati integrati

- Databricks Workflows – per la pianificazione e l'orchestrazione all'interno della piattaforma

Queste opzioni offrono ai team flessibilità nel refactoring e nell'operatività dell'ETL post-migrazione, allineandosi ai moderni pattern di data engineering.

Post-migrazione: validazione, ottimizzazione e adozione

Valida con test tecnici e di business

Dopo la migrazione di un caso d'uso, è fondamentale validare che tutto funzioni come previsto, sia tecnicamente che funzionalmente.

- La validazione tecnica dovrebbe includere:

- Riconciliazione del conteggio delle righe e degli aggregati tra i sistemi

- Verifiche di completezza e qualità dei dati

- Confronto dei risultati delle query tra le piattaforme di origine e di destinazione

- La validazione di business comporta l'esecuzione parallela di entrambi i sistemi e la conferma da parte degli stakeholder che gli output corrispondano alle aspettative prima del cutover.

Ottimizza per costi e prestazioni

Dopo la validazione, valuta e ottimizza l'ambiente in base ai carichi di lavoro effettivi. Le aree di interesse includono:

- Strategie di partizionamento e clustering (ad es., Z-Ordering, Liquid Clustering)

- Ottimizzazione delle dimensioni e del formato dei file

- Configurazione delle risorse e criteri di scalabilità. Queste modifiche aiutano ad allineare l'infrastruttura agli obiettivi di prestazioni e ai target di costo.

Trasferimento di conoscenze e preparazione organizzativa

Una migrazione di successo non termina con l'implementazione tecnica. Garantire che i team possano utilizzare efficacemente la nuova piattaforma è altrettanto importante.

- Pianifica formazione pratica e documentazione

- Consenti ai team di adottare nuovi flussi di lavoro, tra cui sviluppo collaborativo, logica basata su notebook e pipeline dichiarative

- Assegna la responsabilità per la qualità dei dati, la governance e il monitoraggio delle prestazioni nel nuovo sistema

La migrazione è più di un cambiamento tecnico

La migrazione da Oracle a Databricks non è solo un cambio di piattaforma, ma un cambiamento nel modo in cui i dati vengono gestiti, elaborati e utilizzati.

Una pianificazione approfondita, un'esecuzione graduale e un coordinamento stretto tra i team tecnici e gli stakeholder aziendali sono essenziali per ridurre i rischi e garantire una transizione agevole.

Altrettanto importante è preparare la tua organizzazione a lavorare in modo diverso: adottando nuovi strumenti, nuovi processi e una nuova mentalità riguardo all'analisi o all'AI. Con un focus equilibrato sia sull'implementazione che sull'adozione, il tuo team può sbloccare il pieno valore di un'architettura lakehouse moderna.

Suggerimenti pratici da Deloitte

Deloitte ha condiviso alcuni suggerimenti pratici nella migrazione da un data warehouse legacy a Databricks in questo webinar. Dacci un'occhiata per scoprire come è avvenuta la migrazione in un'azienda globale di finanziamento automobilistico! I punti salienti includono:

- implementazione e modernizzazione della piattaforma di analisi cloud con controlli di privacy cyber e PII

- sfruttamento del framework basato sui metadati di Databricks Unity Catalog per configurare le pipeline ELT per archiviare i dati nel lakehouse

- integrazione di Databricks Workflows con ServiceNow per un facile monitoraggio e gestione dei guasti

Cosa fare dopo

La migrazione raramente è semplice. Compromessi, ritardi e sfide impreviste fanno parte del processo, specialmente quando si allineano persone, processi e tecnologia.

Ecco perché è importante lavorare con team che l'hanno già fatto. I Servizi Professionali Databricks e i nostri partner di migrazione certificati portano una profonda esperienza nella realizzazione di migrazioni di alta qualità, puntuali e su larga scala. Contattaci per iniziare la valutazione della tua migrazione.

Cerchi ulteriori indicazioni? Scarica la Guida completa alla migrazione da Oracle a Databricks per passaggi pratici, approfondimenti sugli strumenti e modelli di pianificazione per aiutarti a procedere con fiducia.

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.