Predictive Optimization su larga scala: un anno di innovazione e prospettive future

Query più veloci, costi di archiviazione inferiori e automazione completa per le tabelle gestite di Unity Catalog

di Jeffrey Gong e Kelly Albano

- Predictive Optimization ora viene eseguito per impostazione predefinita per le nuove tabelle gestite di Unity Catalog e opera su larghissima scala

- Le nuove funzionalità del 2025 hanno consentito query più veloci, una manutenzione dello storage più economica e funzionalità avanzate

- Nel 2026, Predictive Optimization si espanderà all'automazione del ciclo di vita dei dati e a un'osservabilità più approfondita

Introduzione

Il lakehouse più performante ed economico è quello che si ottimizza da solo man mano che i volumi di dati, i modelli di query e l'utilizzo da parte dell'organizzazione continuano a evolversi. L'ottimizzazione predittiva (Predictive Optimization, PO) in Unity Catalog abilita questo comportamento analizzando continuamente come i dati vengono scritti e sottoposti a query, per poi applicare automaticamente le azioni di manutenzione appropriate senza richiedere lavoro manuale da parte degli utenti o dei team della piattaforma. Nel 2025, Predictive Optimization è passata da funzionalità di automazione opzionale a comportamento predefinito della piattaforma, gestendo le prestazioni e l'efficienza di archiviazione su milioni di tabelle di produzione ed eliminando al contempo l'onere operativo tradizionalmente associato all'ottimizzazione delle tabelle. Ecco una panoramica delle tappe fondamentali che ci hanno portato fin qui e delle novità in arrivo nel 2026.

Adozione su larga scala nel lakehouse

Nel corso del 2025, l'ottimizzazione predittiva (Predictive Optimization) ha visto una rapida adozione sulla Databricks Platform, poiché i clienti si sono affidati sempre più alla manutenzione autonoma per gestire un patrimonio di dati in crescita. Predictive Optimization è cresciuta rapidamente quest'ultimo anno:

- Exabyte di dati non referenziati sono stati sottoposti a vacuum, con un conseguente risparmio di decine di milioni di dollari sui costi di archiviazione

- Centinaia di petabyte di dati sono stati compattati e clusterizzati per migliorare le prestazioni delle query e l'efficienza del file pruning.

- Milioni di tabelle hanno adottato Automatic Liquid Clustering per la gestione autonoma del layout dei dati

Sulla base dei costanti miglioramenti delle prestazioni osservati su questa scala, Predictive Optimization è ora abilitata per impostazione predefinita per tutte le nuove tabelle, aree di lavoro e account gestiti di Unity Catalog.

Come funziona l'ottimizzazione predittiva

L'ottimizzazione predittiva (PO) funziona come il livello di intelligence della piattaforma per il lakehouse, ottimizzando continuamente il layout dei dati, riducendo l'ingombro di archiviazione e mantenendo le statistiche precise sui file necessarie per una pianificazione efficiente delle query su tabelle gestite da UC.

In base ai modelli di utilizzo osservati, la PO determina automaticamente quando e come eseguire comandi come:

- OPTIMIZE, che compatta i file di piccole dimensioni e migliora la località dei dati per un accesso efficiente

- VACUUM, che elimina i file non referenziati per controllare i costi di archiviazione

- CLUSTER BY, che seleziona le colonne di clustering ottimali per le tabelle con clustering liquido automatico

- ANALYZE, che gestisce statistiche accurate per la pianificazione delle query e il data skipping

Tutte le decisioni di ottimizzazione sono basate sul carico di lavoro e adattive, eliminando la necessità di gestire pianificazioni, ottimizzare parametri o rivedere le strategie di ottimizzazione al variare dei modelli di query.

Principali progressi in Predictive Optimization nel 2025

Statistiche automatiche per query più veloci del 22%

Statistiche accurate sono fondamentali per costruire piani di query efficienti, tuttavia la gestione manuale delle statistiche diventa sempre più impraticabile con l'aumentare del volume dei dati e della diversità delle query.

Con Statistiche automatiche (ora disponibile a livello generale), Predictive Optimization determina quali colonne sono importanti in base al comportamento delle query osservato e garantisce che le statistiche rimangano aggiornate senza comandi ANALYZE manuali.

Le statistiche vengono mantenute tramite due meccanismi complementari:

- Stats-on-write acquisisce le statistiche mentre i dati vengono scritti con un overhead minimo, un metodo da 7 a 10 volte più performante rispetto all'esecuzione di ANALYZE TABLE

- Il refresh in background aggiorna le statistiche quando diventano obsolete a causa di modifiche ai dati o di modelli di query in evoluzione.

Nei carichi di lavoro di produzione reali dei clienti, questo approccio ha fornito query fino al ventidue percento più veloci, eliminando al contempo il costo operativo della gestione manuale delle statistiche.

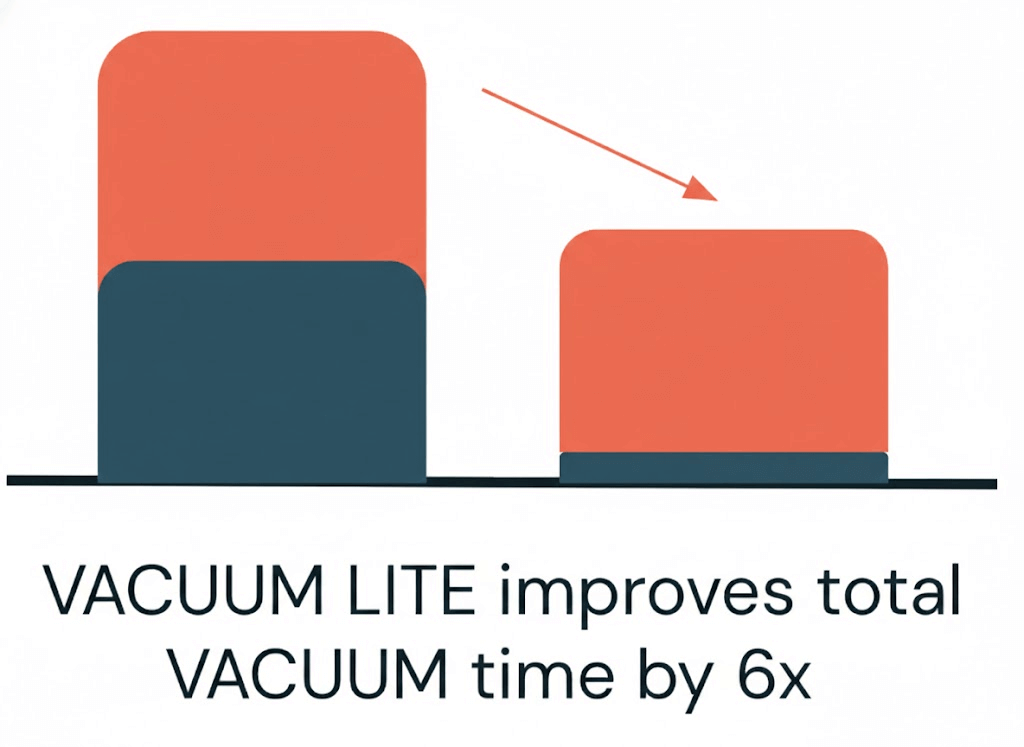

VACUUM 6 volte più veloci e 4 volte più economici

VACUUM svolge un ruolo fondamentale nella gestione dei costi di archiviazione e della conformità, eliminando i file di dati non referenziati. Il vacuum standard richiede l'elenco di tutti i file nella directory di una tabella per identificare i candidati alla rimozione, un'operazione che può richiedere più di 40 minuti per tabelle con 10 milioni di file.

Predictive Optimization ora applica un percorso di esecuzione VACUUM ottimizzato che sfrutta il log delle transazioni Delta per identificare direttamente i file rimovibili, evitando le costose operazioni di listing delle directory ove possibile.

Su larga scala, ciò ha comportato:

- Esecuzione di VACUUM fino a 6 volte più veloce

- Costo di compute fino a 4 volte inferiore rispetto agli approcci standard

Il motore determina dinamicamente quando utilizzare questo approccio basato su log e quando eseguire una scansione completa della directory per ripulire i frammenti delle transazioni interrotte.

Clustering liquido automatico

Clustering liquido automatico ha raggiunto la disponibilità generale nel 2025 e sta già ottimizzando milioni di tabelle in produzione.

Il processo è interamente guidato dal carico di lavoro:

- Innanzitutto, la PO analizza la telemetria di tutte le query sulla tabella, osservando metriche chiave come le colonne predicato, le espressioni di filtro e il numero e le dimensioni dei file letti e sottoposti a pruning.

- Successivamente, esegue la modellazione del carico di lavoro, identificando e testando varie combinazioni di chiavi di clustering candidate (ad es. clustering per data, per customer_id o per entrambi).

- Infine, PO esegue un'analisi costi-benefici per selezionare la migliore strategia di clustering che massimizzerà il query pruning e ridurrà i dati scansionati, stabilendo anche se l'ordine di inserimento esistente della tabella è già sufficiente.

Ottieni query più veloci senza alcuna ottimizzazione manuale. Analizzando automaticamente i carichi di lavoro e applicando il layout dei dati ottimale, PO elimina il complesso compito della selezione della chiave di cluster e garantisce che le tabelle rimangano altamente performanti man mano che i pattern di query si evolvono.

Copertura a livello di piattaforma

Predictive Optimization si è espansa oltre le tabelle tradizionali per supportare un insieme più ampio della Databricks Platform.

- PO ora si integra nativamente con Lakeflow Spark Declarative Pipelines (SDP), portando la manutenzione autonoma in background sia alle Materialized View che alle Streaming Table.

- PO funziona sia sulle tabelle gestite Delta che su quelle Iceberg.

- La PO è abilitata per impostazione predefinita per tutte le nuove tabelle, Workspace e account gestiti da Unity Catalog.

Ciò garantisce la manutenzione autonoma su tutto il patrimonio di dati anziché l'ottimizzazione isolata delle singole tabelle.

Novità in arrivo nel 2026?

Ci impegniamo a fornire funzionalità che sostituiscono l'ottimizzazione manuale delle tabelle con la manutenzione automatizzata. In parallelo, stiamo pianificando di estenderci oltre l'integrità delle tabelle fisiche per affrontare l'intelligenza totale del ciclo di vita dei dati, ovvero risparmi automatizzati sui costi di archiviazione, gestione del ciclo di vita dei dati ed eliminazione delle righe. Stiamo anche dando priorità all'osservabilità avanzata, integrando le informazioni dettagliate dell'ottimizzazione predittiva nelle attività operative comuni sulle tabelle e nel Governance Hub per fornire una visibilità più chiara sulle attività operative di PO e sul loro ROI.

Auto-TTL (eliminazione automatica delle righe)

La gestione della conservazione dei dati o il controllo dei costi di archiviazione è un'attività fondamentale, ma spesso manuale. Siamo entusiasti di presentare Auto-TTL, una nuova funzionalità di Predictive Optimization che automatizza completamente l'eliminazione delle righe. Utilizzando questa funzionalità, sarà possibile impostare una semplice policy time-to-live direttamente su qualsiasi tabella gestita da UC utilizzando un comando come:

Una volta impostata la policy, Predictive Optimization si occupa del resto. Automatizza l'intero processo in due passaggi, eseguendo prima un'operazione DELETE per l'eliminazione temporanea (soft-delete) delle righe scadute, e poi un'operazione VACUUM per rimuoverle definitivamente dallo storage fisico.

Contatta oggi stesso il tuo team account per provare questa funzionalità in anteprima privata!

Osservabilità potenziata

Migliorata osservabilità dell'ottimizzazione predittiva

Sarà possibile monitorare l'impatto diretto e il ROI di Predictive Optimization nel nuovo Hub di governance dei dati. Questa dashboard di osservabilità offrirà nativamente una vista centralizzata sulle attività operative di PO, mostrando le metriche chiave che ne quantificano il valore.

Utilizzala per vedere esattamente cosa sta facendo PO dietro le quinte, con visualizzazioni chiare per byte compattati, byte raggruppati da Liquid, byte sottoposti a vacuum e byte analizzati. Ma soprattutto, l'hub traduce queste azioni in valore aziendale diretto mostrando i risparmi stimati sui costi di archiviazione. In questo modo sarà più facile che mai comprendere e comunicare l'impatto positivo di PO sia sui costi di archiviazione che sulle prestazioni delle query.

In DESCRIBE EXTENDED, sarà anche possibile visualizzare i motivi per cui Predictive Optimization ha saltato l'ottimizzazione (ad es. tabella già ben clusterizzata, tabella troppo piccola per beneficiare della compattazione, ecc.).

Inoltre, abbiamo aggiunto la possibilità di visualizzare le selezioni delle colonne per il data skipping e Auto Liquid nella tabella di sistema PO.

Contatta il team del tuo account oggi stesso per provare la governance dei dati Hub in anteprima privata!

Migliore osservabilità dello storage a livello di tabella

Per offrire maggiore chiarezza sull'impronta di storage, introdurremo funzionalità di osservabilità avanzate per Predictive Optimization. Potrai monitorare lo stato di integrità e l'evoluzione delle tue tabelle attraverso metriche di alto livello come il conteggio dei file e la crescita dello spazio di archiviazione. Rendendo queste informazioni dettagliate direttamente disponibili, stiamo rendendo più semplice visualizzare l'impatto della manutenzione automatizzata e identificare nuove opportunità per ridurre i costi e ottimizzare il tuo data estate.

Inizia a usare Predictive Optimization

Predictive Optimization è disponibile da oggi per le tabelle gestite di Unity Catalog ed è abilitato per impostazione default per i nuovi carichi di lavoro.

Se abilitato, i clienti beneficiano automaticamente di un'esecuzione di VACUUM più rapida, di Automatic Statistics in grado di riconoscere il carico di lavoro e di un layout dei dati autonomo tramite Automatic Liquid Clustering.

Puoi anche esplorare l'osservabilità di Auto TTL e Predictive Optimization (Hub di governance dei dati) tramite l'anteprima privata contattando il tuo team account.

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.