Agent Learning from Human Feedback (ALHF): Eine Fallstudie zum Databricks Knowledge Assistant

In diesem Blogbeitrag tauchen wir ein in Agent Learning from Human Feedback (ALHF) — ein neues Paradigma des maschinellen Lernens, bei dem Agenten direkt aus minimalem natürlichem Sprachfeedback lernen, nicht nur aus numerischen Belohnungen oder statischen Labels. Dies ermöglicht eine schnellere und intuitivere Anpassung von Agenten für Unternehmensanwendungen, bei denen die Erwartungen oft spezialisiert und schwer zu formalisieren sind.

ALHF treibt das Databricks Agent Bricks-Produkt an. In unserer Fallstudie betrachten wir Agent Bricks Knowledge Assistant (KA) - der seine Antworten durch Expertenfeedback kontinuierlich verbessert. Wie in Abbildung 1 gezeigt, steigert ALHF die allgemeine Antwortqualität auf Databricks DocsQA mit nur 4 Feedback-Datensätzen drastisch. Mit nur 32 Feedback-Datensätzen vervierfachen wir die Antwortqualität gegenüber den statischen Basislinien. Unsere Fallstudie demonstriert die Wirksamkeit von ALHF und eröffnet eine überzeugende neue Richtung für die Agentenforschung.

Das Potenzial von trainierbaren KI-Agenten

Bei der Zusammenarbeit mit Unternehmenskunden von Databricks haben wir festgestellt, dass viele KI-Anwendungsfälle für Unternehmen auf hochspezialisierter interner Geschäftslogik, proprietären Daten und inhärenten Erwartungen beruhen, die extern nicht bekannt sind (siehe unseren Domain Intelligence Benchmark für weitere Informationen). Daher müssen selbst die fortschrittlichsten Systeme noch erheblich angepasst werden, um die Qualitätsgrenze für Anwendungsfälle in Unternehmen zu erreichen.

Um diese Systeme anzupassen, verlassen sich bestehende Ansätze entweder auf explizite Ground-Truth-Ausgaben, deren Sammlung teuer ist, oder auf Belohnungsmodelle, die nur binäre/skalare Signale liefern. Um diese Herausforderungen zu lösen, beschreiben wir Agent Learning from Human Feedback (ALHF), ein Lernparadigma, bei dem ein Agent sein Verhalten durch die Einbeziehung einer kleinen Menge an natürlichem Sprachfeedback von Experten anpasst. Dieses Paradigma bietet einen natürlichen, kostengünstigen Kanal für menschliche Interaktion und ermöglicht es dem System, aus reichhaltigen Erwartungssignalen zu lernen.

Beispiel

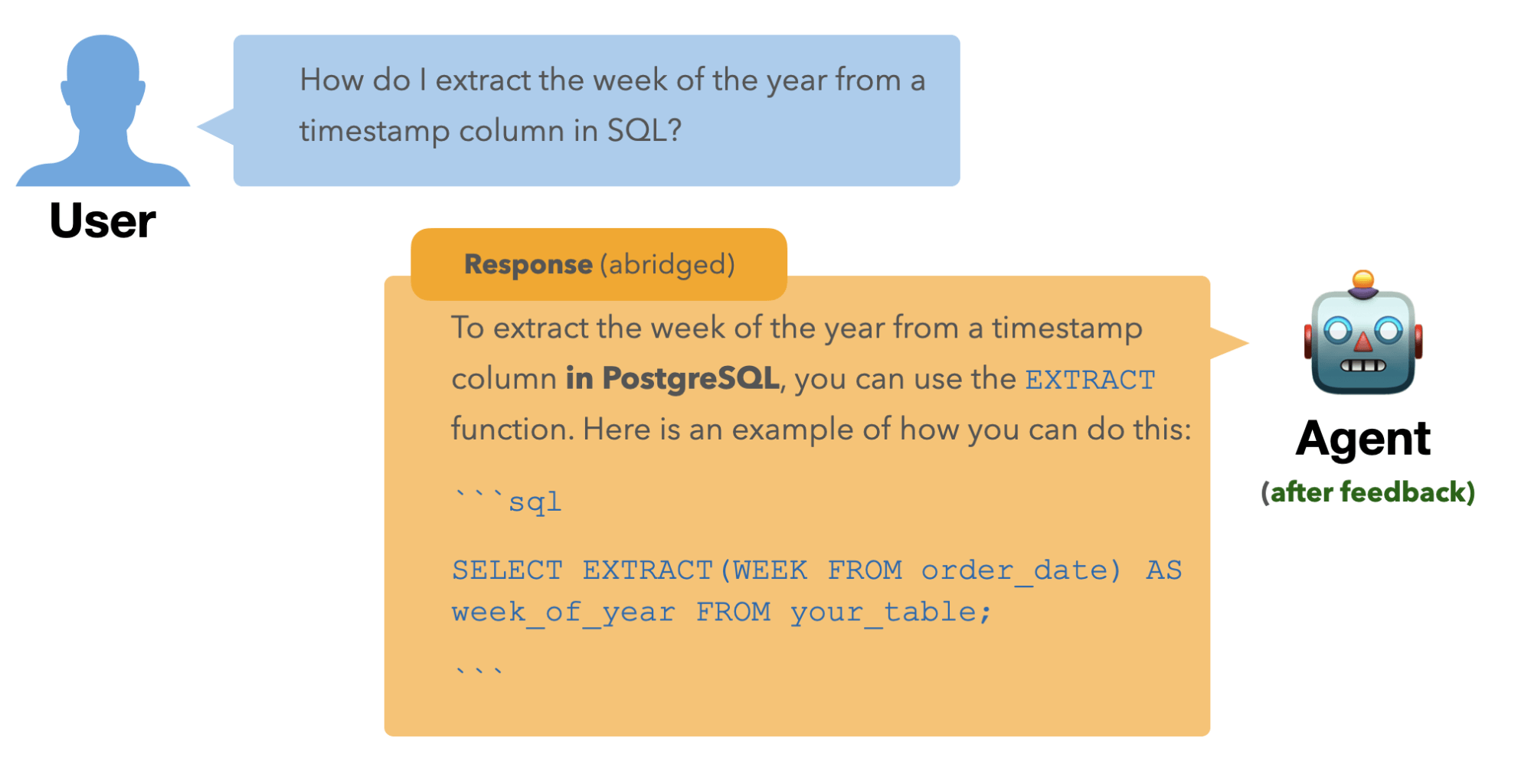

Nehmen wir an, wir erstellen einen Frage-Antwort-Agenten (QA), um Fragen für ein gehostetes Datenbankunternehmen zu beantworten. Hier ist ein Beispiel für eine Frage:

Der Agent schlug die Verwendung der Funktion weekofyear() vor, die in mehreren SQL-Varianten (MySQL, MariaDB usw.) unterstützt wird. Diese Antwort ist korrekt, da weekofyear() bei richtiger Anwendung die gewünschte Funktionalität erreicht. Sie wird jedoch nicht in PostgreSQL, der von unserer Benutzergruppe bevorzugten SQL-Variante, unterstützt. Unser Fachexperte (SME) kann natürliches Sprachfeedback zu der Antwort geben, um diese Erwartung wie oben zu kommunizieren, und der Agent wird sich entsprechend anpassen:

ALHF passt die Systemantworten nicht nur für diese einzelne Frage an, sondern auch für Fragen in zukünftigen Gesprächen, bei denen das Feedback relevant ist, zum Beispiel:

Wie dieses Beispiel zeigt, bietet ALHF Entwicklern und SMEs eine reibungslose und intuitive Möglichkeit, das Verhalten eines Agenten mithilfe natürlicher Sprache zu steuern und ihn an ihre Erwartungen anzupassen.

ALHF in Agent Bricks

Wir verwenden einen spezifischen Anwendungsfall des Agent Bricks-Produkts – Knowledge Assistant - als Fallstudie, um die Leistungsfähigkeit von ALHF zu demonstrieren.

Knowledge Assistant (KA) bietet einen deklarativen Ansatz zur Erstellung eines Chatbots über Ihre Dokumente, der qualitativ hochwertige, zuverlässige Antworten mit Zitaten liefert. KA nutzt ALHF, um kontinuierlich Expertenerwartungen aus natürlichem Sprachfeedback zu lernen und die Qualität seiner Antworten zu verbessern.

KA fragt zunächst nach allgemeinen Aufgabenanweisungen. Sobald es mit den relevanten Wissensquellen verbunden ist, beginnt es mit der Beantwortung von Fragen. Experten können dann einen Qualität verbessern-Modus nutzen, um Antworten zu überprüfen und Feedback zu hinterlassen, das KA durch ALHF integriert, um zukünftige Antworten zu verfeinern.

Bewertung

Um den Wert von ALHF in KA zu demonstrieren, bewerten wir KA anhand von DocsQA – einem Datensatz von Fragen und Referenzantworten zur Databricks-Dokumentation, Teil unseres Domain Intelligence Benchmark. Für diesen Datensatz haben wir auch eine Reihe von definierten Expertenerwartungen. Für eine kleine Auswahl von Kandidatenantworten, die von KA generiert wurden, erstellen wir ein kurzes natürliches Sprachfeedback (wie im obigen Beispiel) basierend auf diesen Erwartungen und stellen KA das Feedback zur Verfügung, um seine Antworten zu verfeinern. Wir messen dann die Antwortqualität über mehrere Feedbackrunden, um zu bewerten, ob sich KA erfolgreich an die Erwartungen der Experten anpasst.

Beachten Sie, dass die Referenzantworten zwar die faktische Korrektheit widerspiegeln – ob eine Antwort relevante und genaue Informationen zur Beantwortung der Frage enthält –, aber nicht unbedingt ideal in Bezug auf die Übereinstimmung mit den Erwartungen der Experten sind. Wie in unserem früheren Beispiel veranschaulicht, kann die anfängliche Antwort für viele SQL-Varianten faktisch korrekt sein, aber dennoch unzureichend sein, wenn der Experte eine PostgreSQL-spezifische Antwort erwartet.

Unter Berücksichtigung dieser beiden Dimensionen der Korrektheit bewerten wir die Qualität einer Antwort mit zwei LLM-Richtern:

- Antwortvollständigkeit: Wie gut die Antwort mit der Referenzantwort aus dem Datensatz übereinstimmt. Dies dient als grundlegende Messung der faktischen Korrektheit.

- Feedback-Konformität : Wie gut die Antwort die spezifischen Erwartungen der Experten erfüllt. Dies misst die Fähigkeit des Agenten, seine Ausgabe basierend auf personalisierten Kriterien anzupassen.

Ergebnisse

Abbildung 2 zeigt, wie sich die Qualität von KA mit zunehmenden Runden von Expertenfeedback auf DocsQA verbessert. Wir berichten Ergebnisse für einen zurückgehaltenen Testdatensatz.

- Antwortvollständigkeit: Ohne Feedback liefert KA bereits qualitativ hochwertige Antworten, die mit führenden Konkurrenzsystemen vergleichbar sind. Mit bis zu 32 Feedback-Datensätzen verbessert sich die Antwortvollständigkeit von KA um 12 Prozentpunkte und übertrifft damit eindeutig die Konkurrenz.

- Feedback Adherence: Die Unterscheidung zwischen Feedback Adherence und Answer Completeness ist offensichtlich – alle Systeme beginnen mit niedrigen Adhärenzwerten ohne Feedback. Aber hier glänzt ALHF: Mit Feedback steigt der KA-Adhärenzwert von 11,7 % auf fast 80 %, was die dramatische Auswirkung von ALHF zeigt.

Insgesamt ist ALHF ein effektiver Mechanismus zur Verfeinerung und Anpassung des Systemverhaltens, um spezifische Expertenerwartungen zu erfüllen. Insbesondere ist es sehr Stichprobeneffizient: Sie benötigen nicht Hunderte oder Tausende von Beispielen, sondern können klare Fortschritte mit einer kleinen Menge an Feedback erzielen.

ALHF: die technische Herausforderung

Diese beeindruckenden Ergebnisse sind möglich, weil KA erfolgreich zwei zentrale technische Herausforderungen von ALHF bewältigt.

Lernen, wann Feedback angewendet werden soll

Wenn ein Experte Feedback zu einer Frage gibt, woher weiß der Agent, welche zukünftigen Fragen von derselben Erkenntnis profitieren sollten? Dies ist die Herausforderung des Scoping – die Bestimmung des richtigen Geltungsbereichs für jedes Feedback. Oder anders ausgedrückt, die Bestimmung der Relevanz eines Feedbacks für eine Frage.

Betrachten Sie unser PostgreSQL-Beispiel. Wenn der Experte sagt „Die Antwort sollte mit PostgreSQL kompatibel sein“, sollte dieses Feedback nicht nur diese eine Antwort korrigieren. Es sollte alle zukünftigen SQL-bezogenen Fragen informieren. Aber es sollte keine unrelateden Abfragen beeinflussen, wie z. B. „Sollte ich matplotlib oder seaborn für dieses Diagramm verwenden?“

Wir verfolgen einen Agent-Memory-Ansatz, der alle vorherigen Feedbacks aufzeichnet und es dem Agenten ermöglicht, relevante Feedbacks für eine neue Frage effizient abzurufen. Dies ermöglicht es dem Agenten, dynamisch und ganzheitlich zu bestimmen, welche Erkenntnisse für die aktuelle Frage am relevantesten sind.

Anpassen der richtigen Systemkomponenten

Die zweite Herausforderung ist die Assignment – herauszufinden, welche Teile des Systems als Reaktion auf Feedback geändert werden müssen. KA ist kein einzelnes Modell; es ist eine Multi-Komponenten-Pipeline, die Suchanfragen generiert, Dokumente abruft und Antworten liefert. Effektives ALHF erfordert die Aktualisierung der richtigen Komponenten auf die richtige Weise.

KA ist mit einer Reihe von LLM-gesteuerten Komponenten ausgestattet, die durch Feedback parametrisiert sind. Jede Komponente ist ein Modul, das relevantes Feedback akzeptiert und sein Verhalten entsprechend anpasst. Nehmen wir das obige Beispiel, bei dem der SME das folgende Feedback zur Extraktion von Datumsinformationen gibt:

Später stellt der Benutzer eine verwandte Frage – „Wie ermittle ich die Differenz zwischen zwei Daten in SQL?“. Ohne neues Feedback anzuwenden, wendet KA automatisch an, was es aus der früheren Interaktion gelernt hat. Es beginnt mit der Änderung der Suchanfrage in der Abrufphase und passt sie an den Kontext an:

Dann liefert es eine PostgreSQL-spezifische Antwort:

Durch die präzise Weiterleitung des Feedbacks an die entsprechenden Abruf- und Antwortgenerierungskomponenten stellt ALHF sicher, dass der Agent effektiv aus Expertenfeedback lernt und generalisiert.

Was ALHF für Sie bedeutet: Inside Agent Bricks

Agent Learning from Human Feedback (ALHF) stellt einen großen Fortschritt dar, um KI-Agenten in die Lage zu versetzen, Expertenerwartungen wirklich zu verstehen und sich daran anzupassen. Indem ALHF natürliches Sprachfeedback ermöglicht, um das Verhalten eines Agenten schrittweise zu gestalten, bietet es einen flexiblen, intuitiven und leistungsstarken Mechanismus, um KI-Systeme auf spezifische Unternehmensanforderungen auszurichten. Unsere Fallstudie mit Knowledge Assistant zeigt, wie ALHF die Antwortqualität und die Einhaltung von Expertenerwartungen dramatisch steigern kann, selbst mit minimalem Feedback. Wie Patrick Vinton, Chief Technology Officer bei Analytics8, einem KA-Kunden, sagte:

„Durch die Nutzung von Agent Bricks erreichte Analytics8 eine 40%ige Steigerung der Antwortgenauigkeit bei 800% schnelleren Implementierungszeiten für unsere Anwendungsfälle, die von einfachen HR-Assistenten bis hin zu komplexen Rechercheassistenten reichen, die auf extrem technischen, multimodalen Whitepapers und Dokumentationen basieren. Nach dem Start haben wir auch festgestellt, dass die Antwortqualität weiter steigt.“

ALHF ist jetzt eine integrierte Funktion des Agent Bricks-Produkts und ermöglicht es Databricks-Kunden, hochgradig angepasste Enterprise-KI-Lösungen bereitzustellen. Wir ermutigen alle Kunden, die die Leistungsfähigkeit von lernfähiger KI nutzen möchten, sich mit ihren Databricks Account Teams in Verbindung zu setzen und KA und andere Agent Bricks Anwendungsfälle auszuprobieren, um zu erfahren, wie ALHF ihre generativen KI-Workflows transformieren kann.

Veronica Lyu und Kartik Sreenivasan haben gleichermaßen beigetragen

Autoren: Veronica Lyu, Kartik Sreenivasan, Moonsoo Lee, Michael Bendersky, Alkis Polyzotis, Xiangrui Meng, Omar Khattab, Sam Havens, Michael Carbin und Matei Zaharia

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.