Vorstellung von Databricks Lakeflow: Eine einheitliche, intelligente Lösung für Data Engineering

Erfassen Sie Daten aus Datenbanken, Unternehmensanwendungen und Cloud-Quellen, transformieren Sie sie im Batch- und Echtzeit-Streaming und stellen Sie sie sicher in der Produktion bereit und betreiben Sie sie.

von Michael Armbrust und Bilal Aslam

Heute freuen wir uns, Databricks Lakeflow ankündigen zu können, eine neue Lösung, die alles enthält, was Sie zum Erstellen und Betreiben von Produktionsdatenpipelines benötigen. Sie umfasst neue native, hoch skalierbare Konnektoren für Datenbanken wie SQL Server und für Unternehmensanwendungen wie Salesforce, Workday, Google Analytics, ServiceNow und SharePoint. Benutzer können Daten im Batch- und Streaming-Verfahren mit Standard-SQL und Python transformieren. Wir kündigen außerdem den Echtzeitmodus für Apache Spark an, der eine Stream-Verarbeitung mit Latenzzeiten ermöglicht, die um Größenordnungen schneller sind als bei Micro-Batches. Schließlich können Sie Workflows orchestrieren und überwachen und mit CI/CD in die Produktion überführen. Databricks Lakeflow ist nativ in die Data Intelligence Platform integriert und bietet Serverless Computing und einheitliche Governance mit Unity Catalog.

In diesem Blogbeitrag erörtern wir die Gründe, warum wir glauben, dass Lakeflow Datenteams helfen wird, die wachsende Nachfrage nach zuverlässigen Daten und KI zu erfüllen, sowie die wichtigsten Funktionen von Lakeflow, die in einer einzigen Produkterfahrung integriert sind.

Herausforderungen beim Erstellen und Betreiben zuverlässiger Datenpipelines

Data Engineering – das Sammeln und Aufbereiten frischer, qualitativ hochwertiger und zuverlässiger Daten – ist eine notwendige Zutat für die Demokratisierung von Daten und KI in Ihrem Unternehmen. Dennoch ist dies nach wie vor mit Komplexität verbunden und erfordert die Verknüpfung vieler verschiedener Tools.

Zunächst müssen Datenteams Daten aus mehreren Systemen aufnehmen, die jeweils ihre eigenen Formate und Zugriffsmethoden haben. Dies erfordert die Erstellung und Wartung eigener Konnektoren für Datenbanken und Unternehmensanwendungen. Allein die Anpassung an die API-Änderungen von Unternehmensanwendungen kann für ein ganzes Datenteam eine Vollzeitbeschäftigung sein. Daten müssen dann sowohl im Batch- als auch im Streaming-Verfahren aufbereitet werden, was das Schreiben und Warten komplexer Logik für die Auslösung und inkrementelle Verarbeitung erfordert. Wenn die Latenzzeiten ansteigen oder ein Fehler auftritt, bedeutet dies, dass man benachrichtigt wird, eine Reihe unzufriedener Datennutzer und sogar Geschäftsunterbrechungen, die sich auf das Endergebnis auswirken.

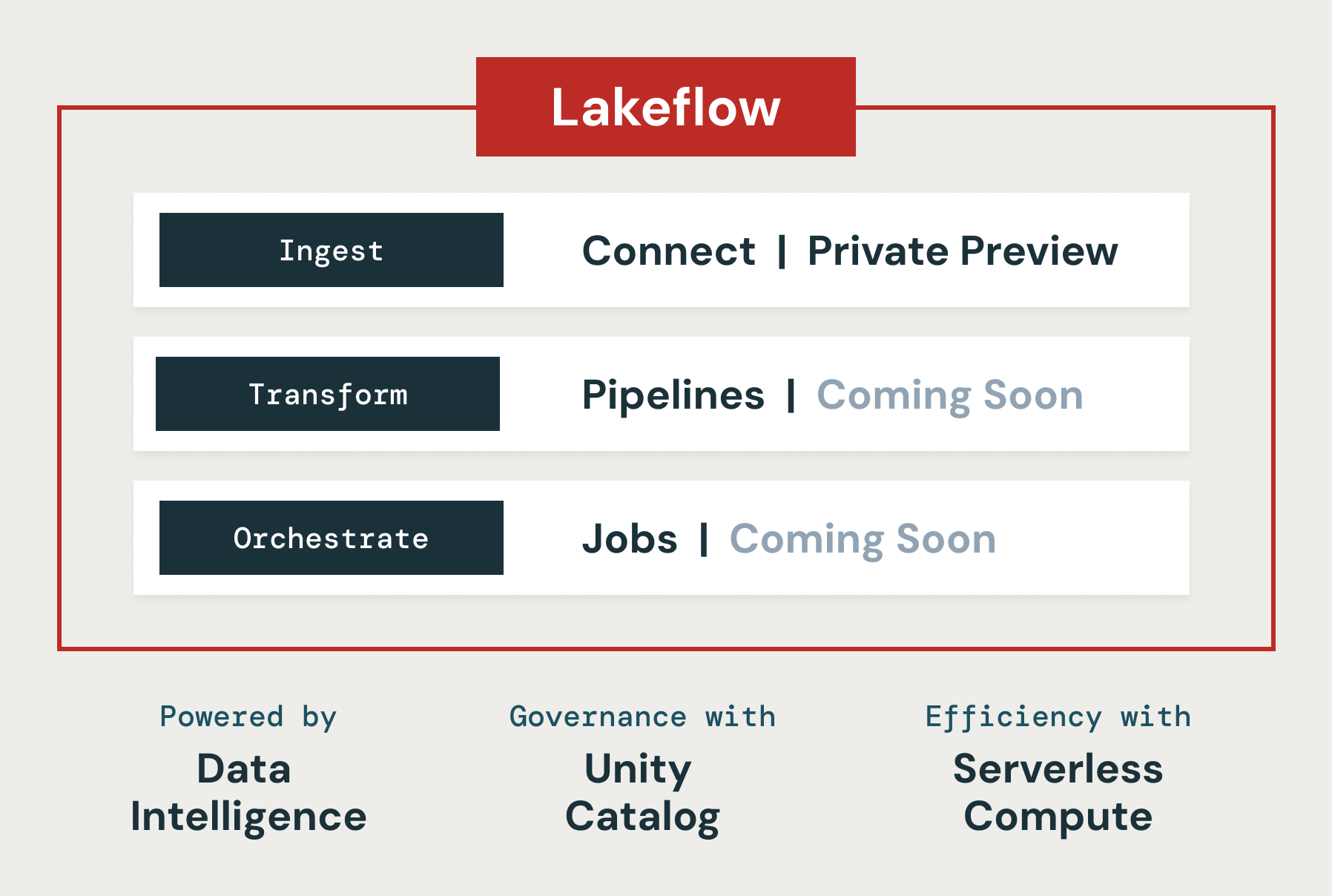

Deshalb haben wir uns entschieden, Lakeflow zu entwickeln, eine einheitliche Lösung für die Datenaufnahme, -transformation und -orchestrierung, die durch Datenintelligenz angetrieben wird. Seine drei Hauptkomponenten sind: Lakeflow Connect, Lakeflow Pipelines und Lakeflow Jobs.

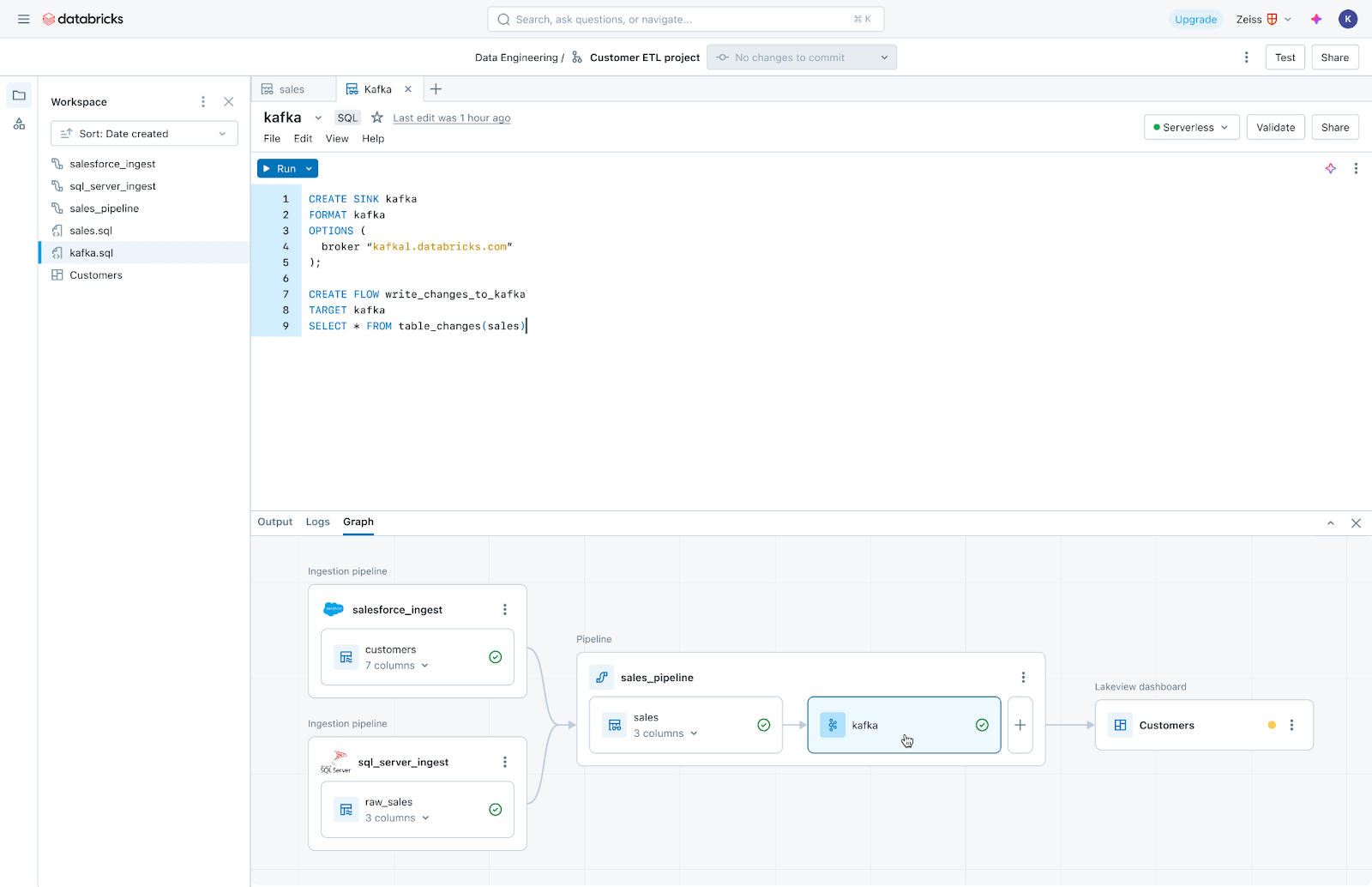

Lakeflow Connect: Einfache und skalierbare Datenaufnahme

Lakeflow Connect bietet Point-and-Click-Datenaufnahme für Datenbanken wie SQL Server und Unternehmensanwendungen wie Salesforce, Workday, Google Analytics und ServiceNow. Die Roadmap umfasst auch Datenbanken wie MySQL, Postgres und Oracle sowie Unternehmensanwendungen wie NetSuite, Dynamics 365 und Google Ads. Lakeflow Connect kann auch unstrukturierte Daten wie PDFs und Excel-Tabellen aus Quellen wie SharePoint aufnehmen.

Es ergänzt unsere beliebten nativen Konnektoren für Cloud-Speicher (z. B. S3, ADLS Gen2 und GCS) und Queues (z. B. Kafka, Kinesis, Event Hub und Pub/Sub-Konnektoren) sowie Partnerlösungen wie Fivetran, Qlik und Informatica.

Besonders begeistert sind wir von den Datenbankkonnektoren, die durch unsere Übernahme von Arcion angetrieben werden. Eine unglaubliche Menge wertvoller Daten ist in operativen Datenbanken eingeschlossen. Anstatt naiver Ansätze, diese Daten zu laden, die zu operativen und Skalierungsproblemen führen, verwendet Lakeflows Change Data Capture (CDC)-Technologie, um es einfach, zuverlässig und betrieblich effizient zu machen, diese Daten in Ihr Lakehouse zu bringen.

Databricks-Kunden, die Lakeflow Connect verwenden, stellen fest, dass eine einfache Aufnahmelösung die Produktivität verbessert und es ihnen ermöglicht, schneller von Daten zu Erkenntnissen zu gelangen. Insulet, ein Hersteller eines tragbaren Insulinmanagement-Systems, des Omnipod, verwendet den Salesforce-Aufnahmekonnektor, um Daten im Zusammenhang mit Kundenfeedback in seine auf Databricks basierende Lösungsplattform aufzunehmen. Diese Daten werden über Databricks SQL zur Analyse bereitgestellt, um Erkenntnisse über Qualitätsprobleme zu gewinnen und Kundenbeschwerden zu verfolgen. Das Team fand erheblichen Wert in der Nutzung der neuen Funktionen von Lakeflow Connect.

"Mit dem neuen Salesforce-Aufnahmekonnektor von Databricks haben wir unseren Datenintegrationsprozess erheblich gestrafft, indem wir fragile und problematische Middleware eliminiert haben. Diese Verbesserung ermöglicht es Databricks SQL, Salesforce-Daten direkt innerhalb von Databricks zu analysieren. Infolgedessen können unsere Datenpraktiker jetzt aktualisierte Erkenntnisse nahezu in Echtzeit liefern, wodurch die Latenz von Tagen auf Minuten reduziert wird." — Bill Whiteley, Senior Director of AI, Analytics, and Advanced Algorithms, Insulet

Lakeflow Pipelines: Effiziente deklarative Datenpipelines

Lakeflow Pipelines reduzieren die Komplexität beim Erstellen und Verwalten effizienter Batch- und Streaming-Datenpipelines. Sie basieren auf dem deklarativen Delta Live Tables-Framework und geben Ihnen die Freiheit, Geschäftslogik in SQL und Python zu schreiben, während Databricks die Datenorchestrierung, inkrementelle Verarbeitung und das automatische Skalieren der Compute-Infrastruktur in Ihrem Namen automatisiert. Darüber hinaus bietet Lakeflow Pipelines eine integrierte Überwachung der Datenqualität und sein Echtzeitmodus ermöglicht eine durchgängig latenzarme Bereitstellung zeitkritischer Datensätze ohne Codeänderungen.

Lakeflow Jobs: Zuverlässige Orchestrierung für jede Workload

Lakeflow Jobs orchestriert und überwacht Produktions-Workloads zuverlässig. Basierend auf den erweiterten Funktionen von Databricks Workflows orchestriert es jede Workload, einschließlich Aufnahme, Pipelines, Notebooks, SQL-Abfragen, maschinelles Lernen-Training, Modellbereitstellung und Inferenz. Datenteams können auch Trigger, Verzweigungen und Schleifen nutzen, um komplexe Datenbereitstellungsanwendungsfälle zu erfüllen.

Lakeflow Jobs automatisiert und vereinfacht auch den Prozess des Verständnisses und der Verfolgung der Datenintegrität und -bereitstellung. Es verfolgt einen datenzentrierten Blick auf die Integrität und bietet Datenteams die vollständige Datenherkunft, einschließlich der Beziehungen zwischen Aufnahme, Transformationen, Tabellen und Dashboards. Darüber hinaus verfolgt es die Aktualität und Qualität der Daten, sodass Datenteams mit einem Klick Monitore über Lakehouse Monitoring hinzufügen können.

Auf der Data Intelligence Platform aufgebaut

Databricks Lakeflow ist nativ in unsere Data Intelligence Platform integriert, die folgende Funktionen bietet:

- Datenintelligenz: KI-gestützte Intelligenz ist nicht nur ein Merkmal von Lakeflow, sondern eine grundlegende Fähigkeit, die jeden Aspekt des Produkts berührt. Databricks Assistant treibt die Entdeckung, Erstellung und Überwachung von Datenpipelines voran, sodass Sie mehr Zeit mit dem Erstellen zuverlässiger Daten verbringen können.

- Einheitliche Governance: Lakeflow ist auch tief in Unity Catalog integriert, das Datenherkunft und Datenqualität ermöglicht.

- Serverless Compute: Erstellen und orchestrieren Sie Pipelines im großen Stil und helfen Sie Ihrem Team, sich auf die Arbeit zu konzentrieren, ohne sich um die Infrastruktur kümmern zu müssen.

Die Zukunft des Data Engineering ist einfach, einheitlich und intelligent

Wir glauben, dass Lakeflow unseren Kunden ermöglichen wird, aktuellere, vollständigere und qualitativ hochwertigere Daten für ihre Unternehmen bereitzustellen. Lakeflow wird bald in der Vorschauversion verfügbar sein, beginnend mit Lakeflow Connect. Wenn Sie Zugang beantragen möchten, melden Sie sich hier an. In den kommenden Monaten sollten Sie weitere Lakeflow-Ankündigungen erwarten, da zusätzliche Funktionen verfügbar werden.

Möchten Sie es in Aktion sehen?

Probieren Sie die Lakeflow Produkttour aus, um Daten aus mehreren Quellen nahtlos im Batch- und Echtzeitmodus zu erfassen, zu transformieren und in die Produktion zu überführen.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.