Migration von Oracle zu Databricks: Tipps für einen reibungslosen Übergang

Strategien, Tools und Best Practices für den Übergang zur Lakehouse-Architektur

von Laurent Léturgez

- Verstehen Sie, wie die Lakehouse-Architektur im Vergleich zum traditionellen relationalen Data-Warehouse-Modell von Oracle abschneidet.

- Entdecken Sie, wie Sie Datenbankobjekte inventarisieren und Oracle-spezifische Schemata in von Databricks unterstützte Formate übersetzen.

- Führen Sie Post-Migrationsschritte aus, um die Datenintegrität zu validieren, parallele Systeme für Geschäftstests auszuführen und die Leistung zu optimieren.

Da immer mehr Unternehmen Lakehouse-Architekturen einführen, ist die Migration von Legacy-Data Warehouses wie Oracle zu modernen Plattformen wie Databricks zu einer gemeinsamen Priorität geworden. Die Vorteile – bessere Skalierbarkeit, Leistung und Kosteneffizienz – liegen auf der Hand, aber der Weg dorthin ist nicht immer einfach.

In diesem Beitrag teile ich praktische Strategien für die Migration von Oracle zu Databricks, einschließlich Tipps zur Vermeidung häufiger Fallstricke und zur erfolgreichen Einrichtung Ihres Projekts für den langfristigen Erfolg.

Die wichtigsten Unterschiede verstehen

Bevor wir über Migrationsstrategien sprechen, ist es wichtig, die Kernunterschiede zwischen Oracle und Databricks zu verstehen – nicht nur technologisch, sondern auch architektonisch.

Oracles relationales Modell vs. die Lakehouse-Architektur von Databricks

Oracle Data Warehouses folgen einem traditionellen relationalen Modell, das für strukturierte, transaktionale Workloads optimiert ist. Databricks ist eine perfekte Lösung für die Ausführung von Data Warehouse-Workloads, unabhängig vom verwendeten Datenmodell, ähnlich wie andere Datenbankmanagementsysteme wie Oracle. Im Gegensatz dazu basiert Databricks auf einer Lakehouse-Architektur, die die Flexibilität von Data Lakes mit der Leistung und Zuverlässigkeit von Data Warehouses verbindet.

Diese Umstellung verändert, wie Daten gespeichert, verarbeitet und abgerufen werden – eröffnet aber auch völlig neue Möglichkeiten. Mit Databricks können Unternehmen:

- Moderne Anwendungsfälle wie Machine Learning (ML), traditionelle KI und generative KI unterstützen

- Die Trennung von Speicher und Rechenleistung nutzen, sodass mehrere Teams unabhängige Warehouses starten können, während sie auf dieselben zugrunde liegenden Daten zugreifen

- Datensilos aufbrechen und den Bedarf an redundanten ETL-Pipelines reduzieren

SQL-Dialekte und Verarbeitungsunterschiede

Beide Plattformen unterstützen SQL, aber es gibt Unterschiede in der Syntax, den integrierten Funktionen und der Optimierung von Abfragen. Diese Unterschiede müssen während der Migration berücksichtigt werden, um Kompatibilität und Leistung sicherzustellen.

Datenverarbeitung und Skalierung

Oracle verwendet eine zeilenbasierte, vertikal skalierte Architektur (mit begrenzter horizontaler Skalierung über Real Application Clusters). Databricks hingegen verwendet das verteilte Modell von Apache Spark™, das sowohl horizontale als auch vertikale Skalierung über große Datensätze unterstützt.

Databricks arbeitet auch nativ mit Delta Lake und Apache Iceberg zusammen, spaltenbasierten Speicherformaten, die für hochperformante, groß angelegte Analysen optimiert sind. Diese Formate unterstützen Funktionen wie ACID-Transaktionen, Schema-Entwicklung und Time Travel, die für den Aufbau robuster und skalierbarer Pipelines unerlässlich sind.

Schritte vor der Migration (gemeinsam für alle Data Warehouse-Migrationen)

Unabhängig von Ihrem Quellsystem beginnt eine erfolgreiche Migration mit einigen kritischen Schritten:

- Inventarisieren Sie Ihre Umgebung: Beginnen Sie mit der Katalogisierung aller Datenbankobjekte, Abhängigkeiten, Nutzungsmuster und ETL- oder Datenintegrationsworkflows. Dies bildet die Grundlage für das Verständnis von Umfang und Komplexität.

- Analysieren Sie Workflow-Muster: Identifizieren Sie, wie Daten durch Ihr aktuelles System fließen. Dies umfasst Batch- vs. Streaming-Workloads, Workload-Abhängigkeiten und plattformspezifische Logik, die möglicherweise neu gestaltet werden muss.

- Priorisieren und phasen Sie Ihre Migration: Vermeiden Sie einen „Big Bang“-Ansatz. Brechen Sie Ihre Migration stattdessen in überschaubare Phasen auf, basierend auf Risiko, Geschäftsauswirkung und Bereitschaft. Arbeiten Sie mit Databricks-Teams und zertifizierten Integrationspartnern zusammen, um einen realistischen, risikoarmen Plan zu erstellen, der Ihren Zielen und Zeitplänen entspricht.

Datenmigrationsstrategien

Eine erfolgreiche Datenmigration erfordert einen durchdachten Ansatz, der sowohl die technischen Unterschiede zwischen den Plattformen als auch die einzigartigen Merkmale Ihrer Datenressourcen berücksichtigt. Die folgenden Strategien helfen Ihnen, einen effizienten Migrationsprozess zu planen und durchzuführen und gleichzeitig die Vorteile der Databricks-Architektur zu maximieren.

Schema-Übersetzung und -Optimierung

Vermeiden Sie es, Oracle-Schemata direkt zu kopieren, ohne ihr Design für Databricks zu überdenken. Zum Beispiel unterstützt der NUMBER-Datentyp von Oracle eine höhere Präzision als das, was Databricks zulässt (maximale Präzision und Skalierung von 38). In solchen Fällen kann es angebrachter sein, DOUBLE-Typen zu verwenden, anstatt zu versuchen, exakte Übereinstimmungen beizubehalten.

Die durchdachte Übersetzung von Schemata gewährleistet Kompatibilität und vermeidet Leistungsprobleme oder Probleme mit der Datenintegrität zu einem späteren Zeitpunkt.

Weitere Details finden Sie im Oracle to Databricks Migration Guide.

Datenextraktions- und Ladeansätze

Oracle-Migrationen beinhalten oft die Übertragung von Daten von lokalen Datenbanken zu Databricks, wo Bandbreite und Extraktionszeit zu Engpässen werden können. Ihre Extraktionsstrategie sollte mit dem Datenvolumen, der Aktualisierungshäufigkeit und der Ausfalltoleranz übereinstimmen.

Gängige Optionen sind:

- JDBC-Verbindungen – nützlich für kleinere Datensätze oder Transfers mit geringem Volumen

- Lakehouse Federation – zum Replizieren von Data Marts direkt nach Databricks

- Azure Data Factory oder AWS Database Migration Services – für orchestrierte Datenbewegung im großen Maßstab

- Oracle-native Export-Tools:

- DBMS_CLOUD.EXPORT_DATA (verfügbar in Oracle Cloud)

- SQL Developer Unload (für On-Premises oder lokale Nutzung)

- Manuelle Einrichtung von DBMS_CLOUD auf On-Premises-Installationen von Oracle 19.9+

- Optionen für Massentransfers – wie AWS Snowball oder Microsoft Data Box, um große historische Tabellen in die Cloud zu verschieben

Die Wahl des richtigen Tools hängt von Ihrer Datengröße, Ihren Konnektivitätsbeschränkungen und Ihren Wiederherstellungsanforderungen ab.

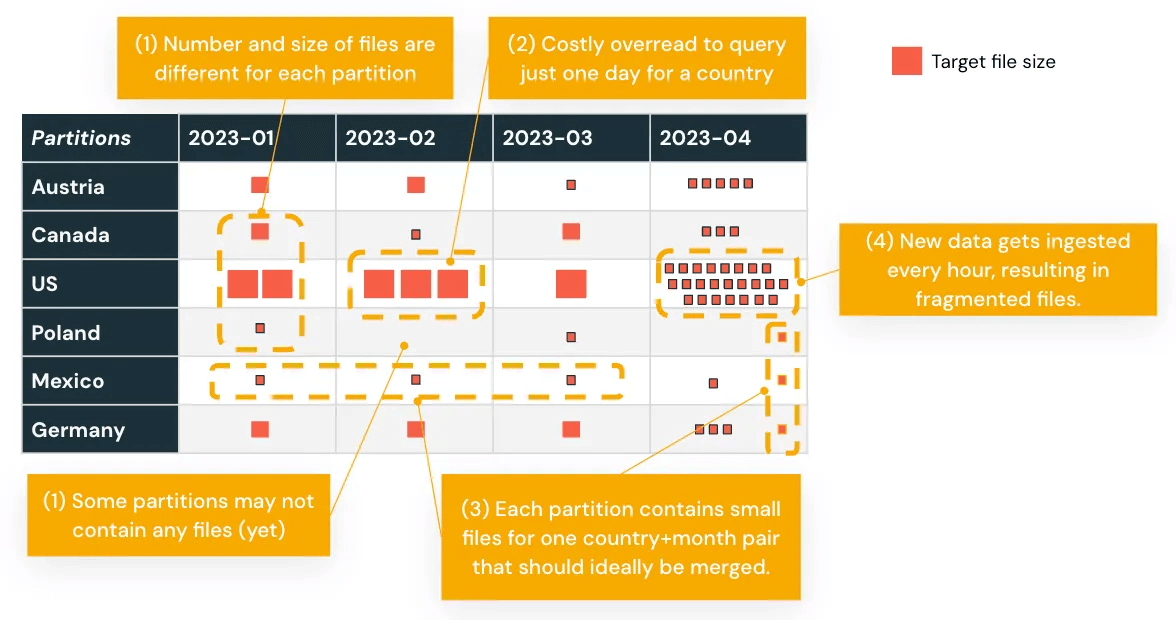

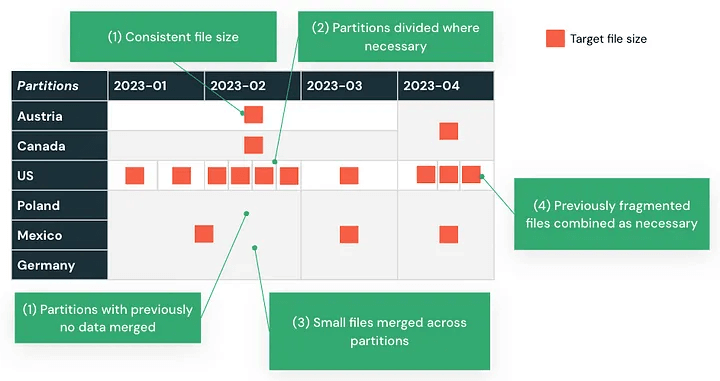

Leistungsoptimierung

Migrierte Daten müssen oft neu strukturiert werden, um in Databricks gut zu funktionieren. Dies beginnt damit, die Datenpartitionierung zu überdenken.

Wenn Ihr Oracle Data Warehouse statische oder unausgeglichene Partitionen verwendete, lassen sich diese Strategien möglicherweise nicht gut übertragen. Analysieren Sie Ihre Abfragemuster und strukturieren Sie die Partitionen entsprechend neu. Databricks bietet verschiedene Techniken zur Leistungsverbesserung:

- Automatic Liquid Clustering für kontinuierliche Optimierung ohne manuelle Abstimmung

- Z-Ordering für Clustering auf häufig gefilterten Spalten

- Liquid Clustering zur dynamischen Organisation von Daten

Zusätzlich gilt:

- Kompression kleiner Dateien zur Reduzierung des Overheads

- Trennung von heißen und kalten Daten zur Optimierung von Kosten und Speichereffizienz

- Vermeidung von Überpartitionierung, die Scans verlangsamen und den Metadaten-Overhead erhöhen kann

Beispielsweise kann eine Partitionierung basierend auf Transaktionsdaten, die zu einer ungleichen Datenverteilung führt, mithilfe von Automatic Liquid Clustering neu ausbalanciert werden, was die Leistung für zeitbasierte Abfragen verbessert.

Das Design unter Berücksichtigung des Verarbeitungsmodells von Databricks stellt sicher, dass Ihre Workloads effizient skalieren und nach der Migration wartbar bleiben.

Migration von Code und Logik

Während die Datenmigration die Grundlage Ihres Übergangs bildet, stellt die Übertragung Ihrer Anwendungslogik und SQL-Codes einen der komplexesten Aspekte der Oracle-zu-Databricks-Migration dar. Dieser Prozess umfasst die Übersetzung von Syntax und die Anpassung an unterschiedliche Programmierparadigmen und Optimierungstechniken, die mit dem verteilten Verarbeitungsmodell von Databricks übereinstimmen.

Strategien zur SQL-Übersetzung

Konvertieren Sie Oracle SQL in Databricks SQL mit einem strukturierten Ansatz. Automatisierte Tools wie BladeBridge (jetzt Teil von Databricks) können die Codekomplexität analysieren und Massenübersetzungen durchführen. Abhängig von der Codebasis liegen die typischen Konversionsraten bei etwa 75 % oder höher.

Diese Tools helfen, den manuellen Aufwand zu reduzieren und Bereiche zu identifizieren, die nach der Migration Nacharbeit oder architektonische Änderungen erfordern.

Migration von Stored Procedures

Vermeiden Sie den Versuch, exakte Eins-zu-eins-Ersetzungen für Oracle PL/SQL-Konstrukte zu finden. Pakete wie DBMS_X, UTL_X und CTX_X existieren in Databricks nicht und erfordern eine Neufassung der Logik, um auf die Plattform zu passen.

Für gängige Konstrukte wie:

- Cursor

- Ausnahmebehandlung

- Schleifen und Kontrollflussanweisungen

Databricks bietet jetzt SQL Scripting, das prozedurales SQL in Notebooks unterstützt. Alternativ können Sie diese Workflows in Python oder Scala innerhalb von Databricks Workflows oder DLT-Pipelines konvertieren, die mehr Flexibilität und Integration mit verteilten Verarbeitungen bieten.

BladeBridge kann bei der Übersetzung dieser Logik in Databricks SQL- oder PySpark-Notebooks als Teil der Migration unterstützen.

Transformation von ETL-Workflows

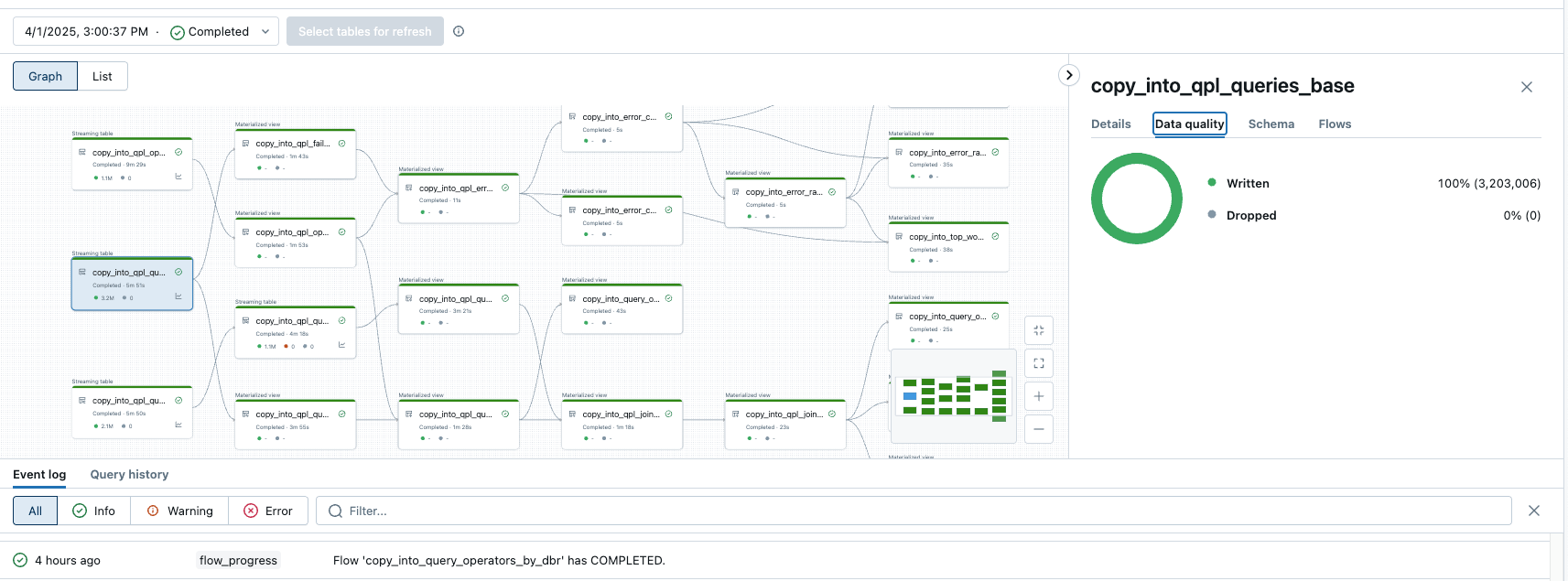

Databricks bietet mehrere Ansätze zum Erstellen von ETL-Prozessen, die Legacy-Oracle-ETL vereinfachen:

- Databricks Notebooks mit Parametern – für einfache, modulare ETL-Aufgaben

- DLT – zur deklarativen Definition von Pipelines mit Unterstützung für Batch und Streaming, inkrementelle Verarbeitung und integrierte Datenqualitätsprüfungen

- Databricks Workflows – zur Planung und Orchestrierung innerhalb der Plattform

Diese Optionen geben Teams Flexibilität beim Refactoring und Betrieb von Post-Migration-ETL, während sie mit modernen Data-Engineering-Mustern übereinstimmen.

Nach der Migration: Validierung, Optimierung und Übernahme

Validierung mit technischen und geschäftlichen Tests

Nach der Migration eines Anwendungsfalls ist es entscheidend zu validieren, dass alles wie erwartet funktioniert, sowohl technisch als auch funktional.

- Technische Validierung sollte Folgendes umfassen:

- Abgleich von Zeilenanzahl und Aggregaten zwischen Systemen

- Prüfung auf Vollständigkeit und Qualität der Daten

- Vergleich von Abfrageergebnissen zwischen Quell- und Zielplattformen

- Geschäftliche Validierung beinhaltet den parallelen Betrieb beider Systeme und die Bestätigung durch Stakeholder, dass die Ergebnisse vor der Umstellung den Erwartungen entsprechen.

Optimierung für Kosten und Leistung

Nach der Validierung wird die Umgebung basierend auf den tatsächlichen Workloads bewertet und optimiert. Schwerpunkte sind:

- Strategien für Partitionierung und Clustering (z. B. Z-Ordering, Liquid Clustering)

- Optimierung von Dateigröße und -format

- Konfiguration der Ressourcen und Skalierungsrichtlinien. Diese Anpassungen helfen, die Infrastruktur an Leistungsziele und Kostenziele anzupassen.

Wissenstransfer und organisatorische Bereitschaft

Eine erfolgreiche Migration endet nicht mit der technischen Implementierung. Sicherzustellen, dass Teams die neue Plattform effektiv nutzen können, ist ebenso wichtig.

- Planen Sie praktische Schulungen und Dokumentationen

- Befähigen Sie Teams, neue Arbeitsabläufe zu übernehmen, einschließlich kollaborativer Entwicklung, Notebook-basierter Logik und deklarativer Pipelines

- Weisen Sie die Verantwortung für Datenqualität, Governance und Leistungsüberwachung im neuen System zu

Migration ist mehr als ein technischer Wandel

Die Migration von Oracle zu Databricks ist nicht nur ein Plattformwechsel – es ist eine Veränderung der Art und Weise, wie Daten verwaltet, verarbeitet und genutzt werden.

Umfassende Planung, schrittweise Ausführung und enge Koordination zwischen technischen Teams und Business-Stakeholdern sind unerlässlich, um Risiken zu reduzieren und einen reibungslosen Übergang zu gewährleisten.

Ebenso wichtig ist es, Ihre Organisation auf eine veränderte Arbeitsweise vorzubereiten: die Übernahme neuer Tools, neuer Prozesse und einer neuen Denkweise rund um Analytics oder KI. Mit einem ausgewogenen Fokus auf Implementierung und Übernahme kann Ihr Team den vollen Wert einer modernen Lakehouse-Architektur erschließen.

Praktische Tipps von Deloitte

Deloitte teilte einige praktische Tipps zur Migration von einem Legacy-Data-Warehouse zu Databricks in diesem Webinar. Schauen Sie es sich an, um zu erfahren, wie die Migration bei einem globalen Automobilfinanzierer ablief! Highlights sind:

- Implementierung und Modernisierung der Cloud-Analytics-Plattform mit Cyber- und PII-Datenschutz-Kontrollen

- Nutzung des metadatengetriebenen Frameworks von Databricks Unity Catalog zur Konfiguration der ELT-Pipelines zur Speicherung der Daten im Lakehouse

- Integration von Databricks Workflows mit ServiceNow zur einfachen Überwachung und Fehlerbehandlung

Was als Nächstes zu tun ist

Migration ist selten unkompliziert. Kompromisse, Verzögerungen und unerwartete Herausforderungen sind Teil des Prozesses, insbesondere wenn Menschen, Prozesse und Technologie aufeinander abgestimmt werden müssen.

Deshalb ist es wichtig, mit Teams zusammenzuarbeiten, die dies bereits getan haben. Databricks Professional Services und unsere zertifizierten Migrationspartner bringen tiefgreifende Erfahrung in der Lieferung hochwertiger Migrationen pünktlich und in großem Umfang mit. Kontaktieren Sie uns, um Ihre Migrationsbewertung zu starten.

Benötigen Sie weitere Anleitungen? Laden Sie den vollständigen Oracle zu Databricks Migrationsleitfaden für praktische Schritte, Einblicke in Tools und Planungsvorlagen herunter, die Ihnen helfen, mit Zuversicht umzuziehen.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.