Predictive Optimization at Scale: Ein Jahr der Innovation und ein Ausblick

Schnellere Abfragen, geringere Speicherkosten und vollständige Automatisierung für von Unity Catalog verwaltete Tabellen

von Jeffrey Gong und Kelly Albano

- Predictive Optimization wird jetzt standardmäßig für neue, von Unity Catalog verwaltete Tabellen ausgeführt und arbeitet in großem Scale

- Neue Funktionen im Jahr 2025 ermöglichten schnellere Queries, eine günstigere Speicherwartung und erweiterte Funktionen

- Im Jahr 2026 wird Predictive Optimization um die Automatisierung des Datenlebenszyklus und tiefere Einblicke erweitert

Einführung

Das leistungsstärkste und kostengünstigste Lakehouse ist eines, das sich bei der Weiterentwicklung von Datenvolumen, Abfragemustern und der organisatorischen Nutzung selbst optimiert. Predictive Optimization (PO) im Unity Catalog ermöglicht dieses Verhalten, indem kontinuierlich analysiert wird, wie Daten geschrieben und abgefragt (Query) werden, und dann automatisch die entsprechenden Wartungsmaßnahmen angewendet werden, ohne dass manuelle Arbeit von Benutzern oder Plattformteams erforderlich ist. Im Jahr 2025 wurde Predictive Optimization von einer optionalen Automatisierungs-Feature zum defaultmäßigen Plattformverhalten, das die Performance und Speichereffizienz für Millionen von Produktionstabellen verwaltet und gleichzeitig den operativen Aufwand, der traditionell mit der Tabellenoptimierung verbunden ist, beseitigt. Hier ist ein Überblick über die Meilensteine, die uns hierher gebracht haben, und was uns 2026 erwartet.

Adoption auf Scale im gesamten Lakehouse

Im Laufe des Jahres 2025 wurde Predictive Optimization auf der gesamten Databricks-Plattform schnell angenommen, da die Kunden zunehmend auf autonome Wartung zur Verwaltung eines wachsenden Datenbestands setzten. Predictive Optimization ist im letzten Jahr schnell gewachsen:

- Exabytes an nicht referenzierten Daten wurden per VACUUM bereinigt, was zu Einsparungen bei den Speicherkosten in Höhe von mehreren zehn Millionen Dollar führte.

- Hunderte von Petabyte an Daten wurden komprimiert und geclustert, um die Abfrageleistung und die Effizienz des File Pruning zu verbessern.

- Millionen von Tabellen nutzen Automatic Liquid Clustering für autonomes Datenlayout-Management.

Aufgrund der bei diesem Maßstab beobachteten konsistenten Leistungsverbesserungen ist Predictive Optimization jetzt standardmäßig für alle neuen von Unity Catalog verwalteten Tabellen, Workspaces und Konten aktiviert.

Wie die prädiktive Optimierung funktioniert

Predictive Optimization (PO) fungiert als Intelligence-Schicht der Plattform für das Lakehouse, indem es kontinuierlich Ihr Datenlayout optimiert, den Speicherbedarf reduziert und die präzisen Dateistatistiken pflegt, die für eine effiziente Abfrageplanung auf UC-verwalteten Tabellen erforderlich sind.

Auf Grundlage der beobachteten Nutzungsmuster bestimmt PO automatisch, wann und wie Befehle ausgeführt werden, z. B.:

- OPTIMIZE, das kleine Dateien komprimiert und die Datenlokalität für einen effizienten Zugriff verbessert

- VACUUM, das nicht referenzierte Dateien löscht, um die Speicherkosten zu kontrollieren

- CLUSTER BY`, das optimale Clustering-Spalten für Tabellen mit ` Automatic Liquid Clustering` auswählt

- ANALYZE, das genaue Statistiken für die Abfrageplanung und das Data Skipping pflegt

Alle Optimierungsentscheidungen sind workload-gesteuert und adaptiv, wodurch die Notwendigkeit entfällt, Schedules zu verwalten, Parameter abzustimmen oder Optimierungsstrategien zu überarbeiten, wenn sich Abfragemuster ändern.

Wichtige Fortschritte bei Predictive Optimization im Jahr 2025

Automatische Statistiken für 22 % schnellere Abfragen

Genaue Statistiken sind für die Erstellung effizienter Abfragepläne von entscheidender Bedeutung, doch die manuelle Verwaltung von Statistiken wird mit zunehmendem Datenvolumen und wachsender Abfragevielfalt immer unpraktischer.

Mit Automatic Statistics (jetzt allgemein verfügbar) bestimmt Predictive Optimization anhand des beobachteten Abfrageverhaltens, welche Spalten wichtig sind, und stellt sicher, dass die Statistiken ohne manuelle ANALYZE-Befehle auf dem neuesten Stand bleiben.

Statistiken werden durch zwei sich ergänzende Mechanismen gepflegt:

- Stats-on-write erfasst Statistiken, während Daten mit minimalem Overhead geschrieben werden. Diese Methode ist 7- bis 10-mal leistungsfähiger als die Ausführung von ANALYZE TABLE.

- Die Hintergrundaktualisierung aktualisiert Statistiken, wenn diese aufgrund von Datenänderungen oder sich ändernden Abfragemustern veraltet sind

Bei echten Produktions-Workloads von Kunden lieferte dieser Ansatz bis zu 22 % schnellere Abfragen und eliminierte gleichzeitig die Betriebskosten für die manuelle Verwaltung von Statistiken.

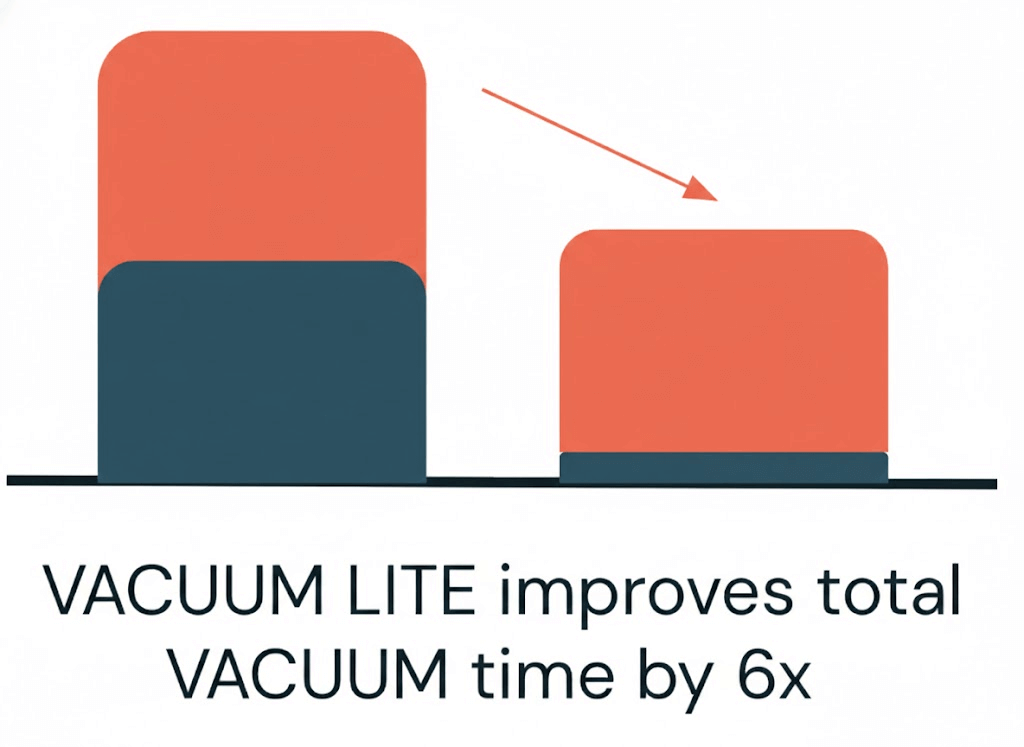

6x schnellere und 4x günstigere VACUUMs

VACUUM spielt eine entscheidende Rolle bei der Verwaltung von Speicherkosten und Compliance, indem es nicht referenzierte Datendateien löscht. Das standardmäßige Vacuuming erfordert das Auflisten aller Dateien in einem Tabellenverzeichnis, um zu entfernende Kandidaten zu identifizieren – ein Betrieb, der bei Tabellen mit 10 Millionen Dateien über 40 Minuten dauern kann.

Predictive Optimization wendet jetzt einen optimierten VACUUM-Ausführungspfad an, der das Delta-Transaktionsprotokoll nutzt, um zu entfernende Dateien direkt zu identifizieren und kostspielige Verzeichnisauflistungen nach Möglichkeit zu vermeiden.

Im großen Stil führte dies zu:

- Bis zu 6-mal schnellere VACUUM-Ausführung

- Bis zu 4x geringere compute-Kosten im Vergleich zu Standardansätzen

Die Engine bestimmt dynamisch, wann dieser Logs-basierte Ansatz verwendet und wann ein vollständiger Verzeichnisscan durchgeführt werden soll, um Fragmente von abgebrochenen Transaktionen zu bereinigen.

Automatisches Liquid Clustering

Automatic Liquid Clustering erreichte 2025 die allgemeine Verfügbarkeit und optimiert bereits Millionen von Tabellen im Produktivbetrieb.

Der Prozess ist vollständig arbeitslastgesteuert:

- Zuerst analysiert PO Telemetriedaten von allen Abfragen in Ihrer Tabelle und beobachtet dabei Key Metriken wie Prädikatspalten, Filterausdrücke sowie die Anzahl und Größe der gelesenen und bereinigten Dateien.

- Als Nächstes führt es eine Workload-Modellierung durch, identifiziert und testet dabei verschiedene Kandidatenkombinationen für den Clustering-Schlüssel (z. B. geclustert nach Datum, customer_id oder beidem).

- Schließlich führt PO eine Kosten-Nutzen-Analyse durch, um die beste Clustering-Strategie auszuwählen, die das Query Pruning maximiert und die gescannten Daten reduziert, und stellt dabei sogar fest, ob die bestehende Einfügereihenfolge der Tabelle bereits ausreichend ist.

Sie erhalten schnellere Abfragen ohne manuelles Tuning. Indem PO automatisch Workloads analysiert und das optimale Datenlayout anwendet, beseitigt es die komplexe Task der Auswahl von Clustering-Schlüsseln und stellt sicher, dass Ihre Tabellen auch bei sich ändernden Abfragemustern hochleistungsfähig bleiben.

Plattformweite Abdeckung

Predictive Optimization wurde über herkömmliche Tabellen hinaus erweitert, um ein breiteres Spektrum der Databricks-Plattform zu unterstützen.

- PO lässt sich jetzt nativ in Lakeflow Spark Declarative Pipelines (SDP) integrieren und ermöglicht so eine autonome Hintergrundwartung für materialisierte Ansichten und Streaming-Tabellen.

- PO funktioniert sowohl auf verwalteten Delta - als auch auf Iceberg -Tabellen

- PO ist standardmäßig für alle neuen, von Unity Catalog verwalteten Tabellen, Workspaces und Konten aktiviert.

Dies gewährleistet eine autonome Wartung für Ihre gesamte Datenlandschaft anstelle einer isolierten Optimierung einzelner Tabellen.

Was kommt als Nächstes im Jahr 2026?

Wir haben uns verpflichtet, Features bereitzustellen, die die manuelle Tabellenoptimierung durch eine automatisierte Wartung ersetzen. Parallel dazu planen wir, über den Zustand physischer Tabellen hinauszugehen, um die gesamte Intelligenz des Datenlebenszykluszu berücksichtigen – automatisierte Speicherkosteneinsparungen, Datenlebenszyklus-Management und Zeilenlöschung. Wir priorisieren außerdem eine verbesserte Beobachtbarkeit, indem wir Einblicke aus der prädiktiven Optimierung in gängige Tabellen-Betriebe und den Governance Hub integrieren, um eine klarere Sichtbarkeit der PO-Betriebe und ihres ROI zu gewährleisten.

Auto-TTL (Automatische Zeilenlöschung)

Die Verwaltung der Datenaufbewahrung oder die Kontrolle der Speicherkosten ist eine wichtige, aber oft manuelle Task. Wir freuen uns, Auto-TTL vorzustellen, eine neue Funktion von Predictive Optimization, die das Löschen von Zeilen vollständig automatisiert. Mit diesem Feature können Sie eine einfache Time-to-Live-Richtlinie mit einem Befehl wie dem folgenden direkt für jede UC-verwaltete Tabelle festlegen:

Sobald die Richtlinie festgelegt ist, kümmert sich Predictive Optimization um den Rest. Es automatisiert den gesamten zweistufigen Prozess: Zuerst wird ein DELETE-Vorgang ausgeführt, um die abgelaufenen Zeilen vorläufig zu löschen, und anschließend werden sie mit einem VACUUM-Befehl endgültig aus dem physischen Speicher entfernt.

Wenden Sie sich noch heute an Ihr Account-Team, um dies in der Private Preview auszuprobieren!

Verbesserte Beobachtbarkeit

Verbesserte Beobachtbarkeit von Predictive Optimization

Sie können die direkten Auswirkungen und den ROI von Predictive Optimization im neuen Data Governance Hub verfolgen. Dieses Observability-Dashboard wird standardmäßig mit einer zentralen Ansicht des PO-Betriebs bereitgestellt und zeigt Key Metriken an, die seinen Wert quantifizieren.

Nutzen Sie dies, um genau zu sehen, was PO im Hintergrund tut, mit übersichtlichen Visualisierungen für komprimierte Bytes, durch Liquid geclusterte Bytes, per VACUUM bereinigte Bytes und analysierte Bytes. Am wichtigsten ist, dass der Hub diese Aktionen in einen direkten Geschäftswert umwandelt, indem er Ihre geschätzten Einsparungen bei den Speicherkosten anzeigt. Dadurch wird es einfacher als je zuvor, die positiven Auswirkungen von PO sowohl auf Ihre Speicherkosten als auch auf die Abfrage-Performance zu verstehen und zu kommunizieren.

In DESCRIBED EXTENDED können Sie auch die Gründe sehen, warum Predictive Optimization die Optimierung übersprungen hat (z. B. Tabelle bereits gut geclustert, Tabelle zu klein, um von der Komprimierung zu profitieren, usw.).

Darüber hinaus haben wir die Möglichkeit hinzugefügt, die Spaltenauswahl für Data Skipping und Auto Liquid in der PO-Systemtabelle anzuzeigen.

Wenden Sie sich noch heute an Ihr Account-Team, um den Data Governance Hub in der Private Previewauszuprobieren!

Verbesserte Beobachtbarkeit des Speichers auf Tabellenebene

Um mehr Klarheit über Ihren Speicherbedarf zu schaffen, werden wir erweiterte Observability-Features für Predictive Optimization einführen. Sie können den Zustand und die Entwicklung Ihrer Tabellen anhand von allgemeinen Metriken wie Dateianzahl und Speicherwachstum überwachen. Indem wir diese Einblicke direkt sichtbar machen, vereinfachen wir es, die Auswirkungen der automatisierten Wartung zu visualisieren, neue Möglichkeiten zur Kostensenkung zu identifizieren und Ihre Datenlandschaft zu optimieren.

Erste Schritte mit Predictive Optimization

Predictive Optimization ist ab sofort für von Unity Catalog verwaltete Tabellen verfügbar und default für neue Workloads aktiviert.

Wenn aktiviert, profitieren Kunden automatisch von einer schnelleren VACUUM-Ausführung, Workload-gesteuerten Automatic Statistics und einem autonomen Datenlayout durch Automatic Liquid Clustering.

Sie können auch Auto TTL und die Observability von Predictive Optimization (Data Governance Hub) im Rahmen einer Private Preview erkunden, indem Sie sich an Ihr Account-Team wenden.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.