Nouveautés : Lakeflow Jobs offre une orchestration de données plus efficace

Lakeflow Jobs est désormais doté d'un nouvel ensemble de fonctionnalités et de mises à jour de conception conçues pour améliorer l'orchestration des flux de travail et l'efficacité des pipelines.

- Découvrez les dernières améliorations de l'interface utilisateur pour les tâches Lakeflow qui offrent aux utilisateurs une apparence plus épurée et intuitive, améliorant ainsi leur expérience globale.

- Apprenez-en davantage sur les dernières fonctionnalités ajoutées qui offrent plus de flexibilité et de contrôle sur les flux de travail.

- Découvrez Lakeflow Connect dans Jobs, une nouvelle méthode plus centralisée pour ingérer des données dans votre pipeline.

Au cours des derniers mois, nous avons introduit des mises à jour passionnantes pour Lakeflow Jobs (anciennement connu sous le nom de Databricks Workflows) afin d'améliorer l'orchestration des données et d'optimiser les performances des flux de travail.

Pour les nouveaux venus, Lakeflow Jobs est l'orchestrateur intégré pour Lakeflow, une solution unifiée et intelligente pour l'ingénierie des données avec un développement et des opérations ETL rationalisés, basés sur la Data Intelligence Platform. Lakeflow Jobs est l'orchestrateur le plus fiable pour le Lakehouse et les charges de travail de niveau production, avec plus de 14 600 clients, 187 000 utilisateurs hebdomadaires et 100 millions de jobs exécutés chaque semaine.

Des améliorations de l'interface utilisateur à un contrôle de flux de travail plus avancé, découvrez les dernières nouveautés de la solution d'orchestration de données native de Databricks et découvrez comment les ingénieurs de données peuvent rationaliser leur expérience de pipeline de données de bout en bout.

Interface utilisateur rafraîchie pour une expérience utilisateur plus ciblée

Nous avons repensé notre interface pour donner à Lakeflow Jobs un look frais et moderne. La nouvelle disposition compacte permet un parcours d'orchestration plus intuitif. Les utilisateurs apprécieront une palette de tâches qui offre désormais des raccourcis et un bouton de recherche pour les aider à trouver et accéder plus facilement à leurs tâches, qu'il s'agisse d'un pipeline Lakeflow, d'un tableau de bord IA/BI, d'un notebook, de SQL, ou plus encore.

Pour le suivi, les clients peuvent désormais trouver facilement des informations sur les temps d'exécution de leurs jobs dans le panneau de droite sous les détails d'exécution du job et des tâches, ce qui leur permet de surveiller facilement les temps de traitement et d'identifier rapidement tout problème de pipeline de données.

Nous avons également amélioré la barre latérale en permettant aux utilisateurs de choisir quelles sections (détails du job, planifications et déclencheurs, paramètres du job, etc.) masquer ou laisser ouvertes, rendant leur interface d'orchestration plus propre et plus pertinente.

Dans l'ensemble, les utilisateurs de Lakeflow Jobs peuvent s'attendre à un flux de travail d'orchestration plus rationalisé, ciblé et simplifié. La nouvelle disposition est actuellement disponible pour les utilisateurs qui ont opté pour la préversion et activé le commutateur sur la page Jobs.

Flux de données plus contrôlés et efficaces

Notre orchestrateur est constamment amélioré avec de nouvelles fonctionnalités. La dernière mise à jour introduit des contrôles avancés pour l'orchestration des pipelines de données, donnant aux utilisateurs un plus grand contrôle sur leurs flux de travail pour plus d'efficacité et des performances optimisées.

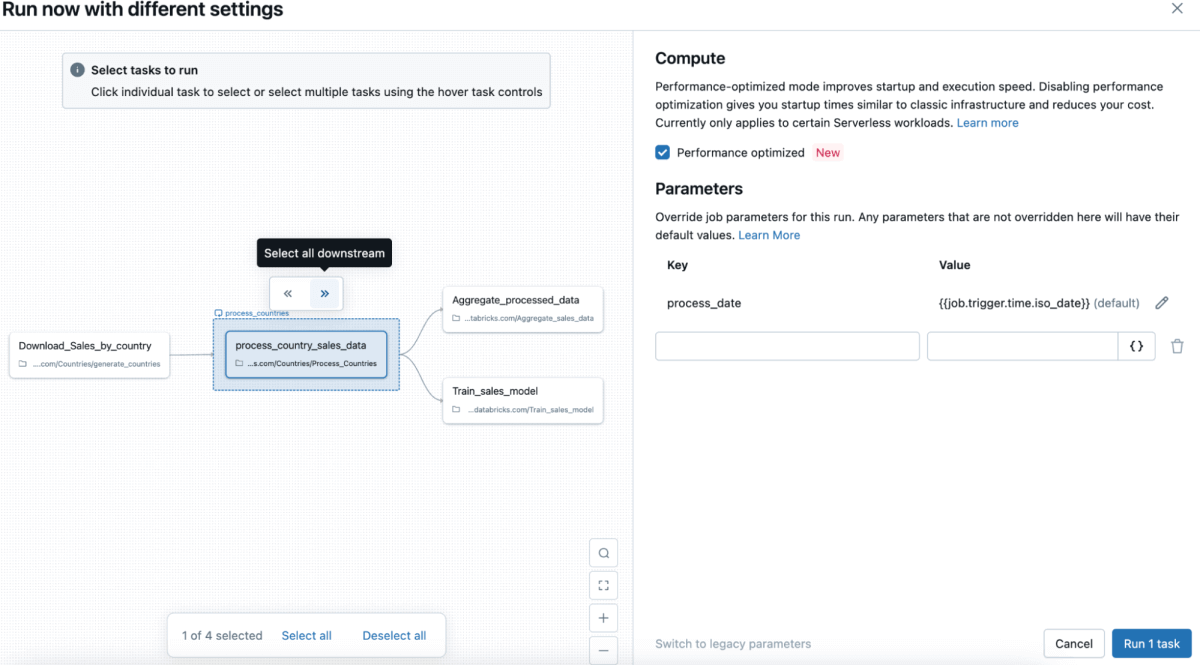

Les exécutions partielles permettent aux utilisateurs de sélectionner les tâches à exécuter sans affecter les autres. Auparavant, le test des tâches individuelles nécessitait l'exécution de l'ensemble du job, ce qui pouvait être gourmand en calcul, lent et coûteux. Désormais, sur la page Jobs & Pipelines, les utilisateurs peuvent sélectionner "Exécuter maintenant avec des paramètres différents" et choisir des tâches spécifiques à exécuter sans impacter les autres, évitant ainsi le gaspillage de calcul et les coûts élevés. De même, les réparations partielles permettent un débogage plus rapide en permettant aux utilisateurs de corriger des tâches individuelles échouées sans réexécuter l'ensemble du job.

Avec plus de contrôle sur leurs flux d'exécution et de réparation, les clients peuvent accélérer les cycles de développement, améliorer la disponibilité des jobs et réduire les coûts de calcul. Les exécutions et réparations partielles sont généralement disponibles dans l'interface utilisateur et l'API Jobs API.

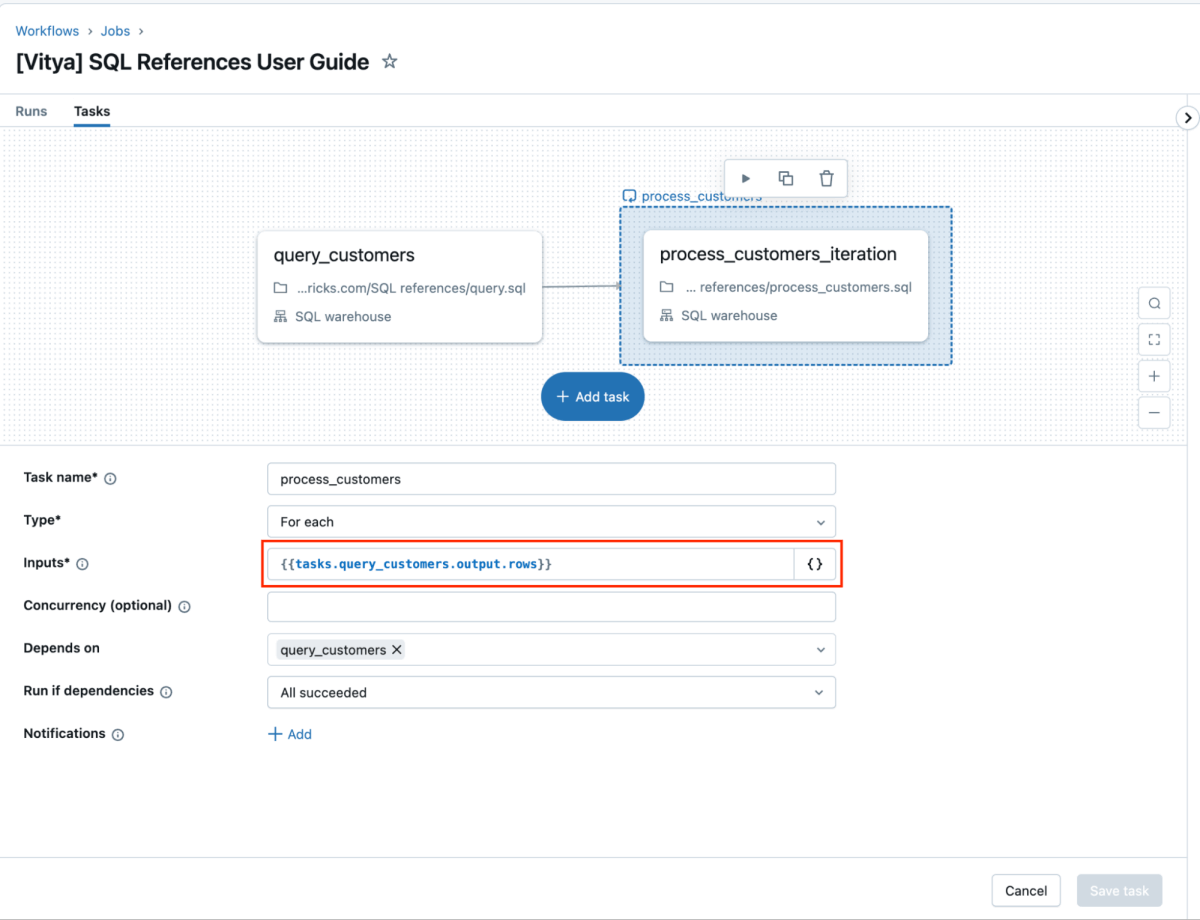

Pour tous les fans de SQL, nous avons d'excellentes nouvelles ! Dans cette dernière série de mises à jour, les clients pourront utiliser les sorties des requêtes SQL comme paramètres dans Lakeflow Jobs pour orchestrer leurs données. Cela permet aux développeurs SQL de transmettre plus facilement des paramètres entre les tâches et de partager le contexte au sein d'un job, ce qui se traduit par une orchestration de pipeline de données plus cohérente et unifiée. Cette fonctionnalité est également généralement disponible.

Démarrage rapide avec Lakeflow Connect dans Jobs

En plus de ces améliorations, nous facilitons et accélérons l'ingestion de données dans Lakeflow Jobs en intégrant plus étroitement Jobs avec Lakeflow Connect, la solution d'ingestion de données gérée et fiable de Databricks, avec des connecteurs intégrés.

Les clients peuvent déjà orchestrer des pipelines d'ingestion Lakeflow Connect qui proviennent de Lakeflow Connect, en utilisant l'un des connecteurs entièrement gérés (par exemple, Salesforce, Workday, etc.) ou directement depuis des notebooks. Désormais, avec Lakeflow Connect dans Jobs, les clients peuvent facilement créer un pipeline d'ingestion directement à partir de deux points d'entrée dans leur interface Jobs, le tout dans un environnement point-and-click. L'ingestion étant souvent la première étape de l'ETL, cette nouvelle intégration transparente avec Lakeflow Connect permet aux clients de consolider et de rationaliser leur expérience d'ingénierie des données, de bout en bout.

Lakeflow Connect dans Jobs est maintenant généralement disponible pour les clients. En savoir plus sur cette mise à jour et d'autres annonces récentes de Lakeflow Connect.

Une orchestration unique pour toutes vos charges de travail

Nous innovons constamment sur Lakeflow Jobs pour offrir à nos clients une expérience d'orchestration moderne et centralisée pour tous leurs besoins en données au sein de l'organisation. D'autres fonctionnalités arrivent dans Jobs - nous dévoilerons bientôt un moyen pour les utilisateurs de déclencher des jobs en fonction des mises à jour de tables, de fournir un support pour les tables système et d'étendre nos capacités d'observabilité, alors restez à l'écoute !

Pour ceux qui souhaitent continuer à en apprendre davantage sur Lakeflow Jobs, consultez nos sessions à la demande de notre Data+AI Summit et explorez Lakeflow dans une variété de cas d'utilisation, de démonstrations et plus encore !

- En savoir plus sur Lakeflow Jobs

- Créez votre premier job avec notre Guide de démarrage rapide

- Activez la nouvelle interface utilisateur en utilisant le commutateur dans la page Jobs & Pipelines (clients en préversion uniquement)

- Vous n'avez pas pu assister au Data+AI Summit ? Regardez les sessions Lakeflow Jobs à la demande

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.