Un approccio AI-first all'ingegneria dei dati con Lakeflow e Agent Bricks

Come Lakeflow e Agent Bricks introducono l'automazione potenziata dall'IA in ogni fase della tua pipeline ETL

- Lakeflow offre una piattaforma di data engineering AI-first che consente loro di sfruttare e rendere disponibili per la produzione modelli di IA nel loro ETL con le funzioni di IA di Agent Bricks

- I data engineer possono orchestrare facilmente i loro modelli di IA su larga scala con Lakeflow Jobs, automatizzando la loro pipeline ETL nel loro contesto aziendale

- Dal fuzzy matching all'estrazione e alla riepilogazione dei dati, gli utenti di Lakeflow Jobs possono sbloccare casi d'uso della pipeline ed estrarre nuove informazioni dettagliate chiave che possono alimentare i loro casi d'uso di analisi a valle, BI e ML.

I Data Engineers sono sempre più concentrati su un problema centrale: usare l'AI per migliorare l'ETL e creare pipeline affidabili e di livello produttivo senza introdurre nuova complessità. Hanno bisogno di un'IA che offra risultati concreti, semplificando i flussi di lavoro senza aggiungere strumenti scollegati o eliminare il contesto.

Databricks Lakeflow offre una piattaforma di ingegneria dei dati unificata con IA integrata e sicura che automatizza l'intera elaborazione dei dati, sblocca più informazioni dettagliate e supporta una gamma più ampia di problemi aziendali. Che si tratti di codice di pipeline generato dall'IA o di orchestrazione di carichi di lavoro di IA, gli ingegneri dei dati che sfruttano Lakeflow possono evitare di dedicare ore al lavoro manuale di integrazione e concentrarsi invece su modelli strategici e di maggior valore che generano un impatto reale per la loro azienda.

In questo blog, esploreremo come puoi produttivizzare e scalare i tuoi modelli di IA implementandoli nella tua pipeline di dati per sbloccare automaticamente informazioni dettagliate di business.

Estrai facilmente più informazioni dettagliate dai tuoi dati su larga scala

I team di dati sono sommersi da input non strutturati, che si tratti di contratti, fatture, trascrizioni o recensioni. La loro elaborazione spesso significa destreggiarsi tra fragili modelli NLP, regole rigide o una pulizia manuale. Il risultato: output inaffidabili, tempi di consegna lenti e informazioni dettagliate preziose bloccate nei documenti, mentre gli ingegneri sprecano tempo in attività di parsing ripetitive invece di concentrarsi su attività di maggior impatto.

Con Databricks Lakeflow, puoi risolvere questo problema incorporando senza problemi le trasformazioni basate sull'IA nei tuoi flussi di lavoro esistenti tramite le AI Functions di Databricks Agent Bricks. Queste funzioni ti consentono di integrare un'IA di alta qualità direttamente nel tuo processo ETL, automatizzando l'estrazione, la trasformazione e la classificazione di dati sia non strutturati che strutturati su larga scala.

Esistono diversi tipi di funzioni di IA in Agent Bricks tra cui puoi scegliere. Alcune di queste non richiedono prompt e sono specifiche per determinate attività, come ad esempio:

ai_extract: estrae entità specifiche dal testo di input in base alle etichette fornite. Ad esempio, persona, luogo, organizzazioneai_classify: classifica il testo di input in base alle etichette fornite. Ad esempio, "urgente" o "non urgente" o categorie di argomenti.ai_translate: Traduci il testo in una lingua di destinazione specifica.

Siamo particolarmente entusiasti della nostra funzione di IA lanciata di recente, ai_parse_document, che può essere utilizzata per trasformare qualsiasi dato non strutturato nei formati strutturati necessari. Utilizzando modelli di base multimodali, ai_parse_doc consente di eseguire il parsing del testo, estrarre tabelle, ragionare sulle cifre e trasformare le immagini in descrizioni generate dall'IA. Questa funzione apre nuove possibilità per l'elaborazione di dati che in precedenza erano quasi impossibili da analizzare. Scopri di più qui

Offriamo anche una funzione più generale chiamata ai_query(), basata sulla nostra piattaforma di inferenza batch serverless. Questa funzione consente di eseguire trasformazioni basate sull'AI su set di dati di grandi dimensioni utilizzando qualsiasi LLM a scelta in un'unica operazione.

Per massimizzare le prestazioni su milioni di righe, il nostro motore di inferenza batch serverless effettua automaticamente il provisioning e la scalabilità delle risorse di compute ed esegue i carichi di lavoro in parallelo. Questo rimuove l'overhead per richiesta e offre un'elaborazione significativamente più rapida, riducendo i tempi di esecuzione da ore a minuti e migliorando al contempo l'efficienza dei costi per i carichi di lavoro di IA ad alto volume.

Con Lakeflow, puoi facilmente mettere in produzione i tuoi modelli di IA e orchestrarli in modo nativo nella tua soluzione di ingegneria dei dati utilizzando Lakeflow Jobs. Con le funzioni di IA, puoi rendere più efficiente la tua orchestrazione e sbloccare più casi d'uso, come ad esempio:

- Genera nuovi dati. Usa l'IA per scrivere riepiloghi sulle informazioni dettagliate dei clienti per accelerare la reportistica o per prevedere i ricavi futuri.

- Struttura e organizza i dati in categorie specifiche e significative per il business. Esegui l'analisi del sentiment su milioni di recensioni multilingue o automatizza la segmentazione dei clienti utilizzando prompt in linguaggio naturale su larga scala.

- Migliora la qualità dei dati. Usa il fuzzy matching e la risoluzione delle entità per correggere duplicati e incongruenze su larga scala.

La combinazione di Lakeflow e Agent Bricks ti consente di eseguire i tuoi modelli di IA su un'unica piattaforma dati unificata e governata, in modo che la tua IA, e le informazioni dettagliate che estrae, abbiano il giusto contesto aziendale e d'impresa.

Casi d'uso pratici delle funzioni di IA e di Lakeflow

Esempio 1: trasformare le trascrizioni grezze delle chiamate in informazioni dettagliate aziendali

Immagina che il tuo team di vendita abbia bisogno di un modo affidabile per trasformare trascrizioni di chiamate lunghe e non strutturate in riassunti chiari e utilizzabili. Con centinaia di chiamate al giorno, molte delle quali durano dai 45 ai 60 minuti, la revisione manuale diventa rapidamente impossibile.

Con Databricks, puoi sfruttare le funzioni di AI integrate per analizzare facilmente e rapidamente tutte quelle trascrizioni, estrarre informazioni dettagliate e generare consigli di follow-up.

Invece di creare un servizio di AI separato o gestire agenti personalizzati, puoi semplicemente scrivere una query ed eseguirla come parte del tuo orchestratore con Lakeflow Jobs. Il tuo modello di AI viene quindi implementato direttamente in una piattaforma di data ingegneria unificata e governata, in cui ottieni un'elaborazione batch scalabile che rimane completamente integrata con i flussi di lavoro della tua pipeline di vendite esistente, pur restando nel giusto contesto di business e aziendale.

Vediamo come funziona in pratica. Dopo aver inserito le trascrizioni delle chiamate nella tua pipeline, puoi applicare le funzioni di IA per convertire il testo non strutturato in segnali utilizzabili:

ai_analyze_sentimentper far emergere il sentiment generale della chiamata (positivo, negativo, neutro)ai_extractper estrarre informazioni chiave dalle chiamate, inclusi nome del cliente, nome dell'azienda, posizione lavorativa, numero di telefono, ecc.ai_classifyper classificare il tipo di chiamata (urgenza, argomento, ecc.)

Questo fornisce una base strutturata per le analitiche e l'automazione a valle.

Successivamente, usa ai_query per riassumere ogni chiamata usando il modello di IA di tua scelta (nel nostro esempio, usiamo un LLM "databricks-meta-llama-3-3-70b-instruct"):

Questa query produce riepiloghi coerenti e di alta qualità che i team di vendita e i team account possono consultare rapidamente.

Puoi quindi generare follow-up personalizzati nello stesso flusso di lavoro:

Queste note possono quindi essere inviate direttamente al tuo CRM o agli strumenti di vendita su larga scala, in modo che i tuoi team sappiano esattamente la giusta linea d'azione da intraprendere poco dopo la fine della chiamata. Potresti anche condividere queste note con il tuo team di BI per scoprire le lacune e contribuire a migliorare l'esperienza complessiva del servizio clienti.

Esempio 2: Snellimento dell'elaborazione delle richieste di risarcimento

Immagina di creare una pipeline di elaborazione delle richieste di risarcimento per una compagnia di assicurazioni che ha bisogno di approvazioni più rapide e coerenti. Oggi, le richieste arrivano spesso via e-mail con allegati non strutturati, come documenti scansionati, foto e PDF, il che le rende difficili da inserire ed elaborare su larga scala.

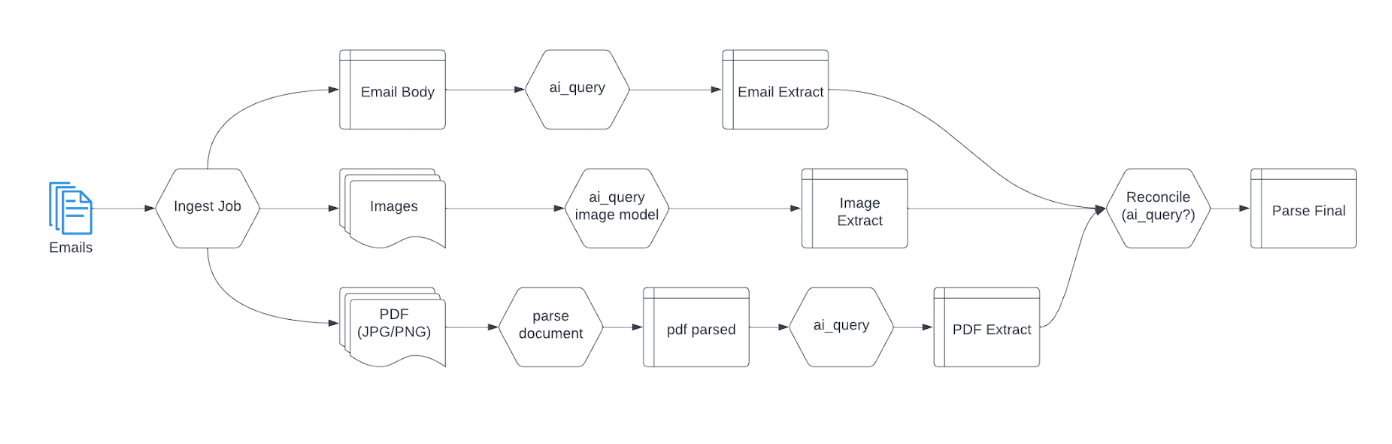

Con Agent Bricks e Lakeflow, i Data Engineer possono usare ai_parse_document e ai_query per estrarre, normalizzare e consolidare automaticamente i dati dalle email in arrivo come parte delle loro pipeline ETL. Ciò consente un'automazione affidabile end-to-end che riduce la revisione manuale, accelera le decisioni e si integra perfettamente nei flussi di lavoro di dati esistenti.

Ecco come funzionerebbe:

Utilizzando Lakeflow e Agent Bricks, puoi inserire i tuoi file e-mail nel tuo lakehouse e quindi estrarre i dati di cui hai bisogno con:

ai_queryper leggere il corpo dell'email ed estrarre le informazioni chiave (ad esempio: nome, data di nascita, indirizzo, codice fiscale)ai_querycon un modello in grado di leggere in modo specifico il tipo di immagine in arrivo. Questa funzione AI genererà un testo che descrive l'immagine allegata ed estrarrà i relativi metadati. Di seguito è riportato un esempio di query SQL di tale funzione:

- e

ai_parse_documentper leggere qualsiasi PDF (jpg o png) allegato all'email

Una volta estratti i dati, puoi utilizzare nuovamente ai_query per consolidare tutte le informazioni in un file che può essere riutilizzato in un altro flusso di lavoro o condiviso direttamente con un team a valle (analista di BI, team di AI/ML, ecc.), a seconda del tuo caso d'uso.

Di seguito è riportato un esempio di DAG di come apparirebbe tale flusso di lavoro in Lakeflow Jobs:

C'è molto altro che puoi fare combinando Lakeflow e Agent Bricks - dai un'occhiata a questo video per scoprire come puoi trasformare dati di vendita disordinati in campagne di marketing basate sull'AI.

Applicazioni reali dell'IA in Databricks

Molti clienti e Data Engineer di Databricks hanno risolto con successo vari problemi aziendali (come i prezzi, il successo dei clienti e il marketing) utilizzando l'AI e Lakeflow per ottenere informazioni dettagliate e aumentare la produttività.

Kard, un'azienda fintech con sede a New York, utilizza le funzioni di IA di Agent Bricks per alimentare un sistema di categorizzazione delle transazioni scalabile e accurato che sostituisce i metodi legacy manuali e incoerenti. Questo approccio moderno consente a Kard di elaborare in modo efficiente miliardi di transazioni, offrire premi personalizzati e fornire informazioni dettagliate che promuovono la fedeltà e il valore aziendale.

Il team di ingegneria dei dati di Banco Bradesco, una delle più grandi banche dell'America Latina, ha riscontrato colli di bottiglia nella produttività a causa di lunghi processi di codifica, debug e documentazione. Adottando Databricks Assistant, hanno ridotto i tempi di codifica del 50% e hanno permesso agli utenti sia tecnici che non tecnici di generare e risolvere i problemi del codice utilizzando il linguaggio naturale, democratizzando l'accesso ai dati, riducendo i costi e accelerando le decisioni basate su dati.

Locala, una piattaforma pubblicitaria omnicanale globale, ha usato i Job di Lakeflow per orchestrare complesse pipeline di addestramento di LLM, che il suo precedente scheduler, Airflow, non era in grado di gestire. Semplificando l'ETL, l'addestramento e la sperimentazione dei modelli e la selezione delle risorse di calcolo, i Job di Lakeflow hanno eliminato l'onere operativo della gestione di flussi di lavoro complessi, consentendo a un singolo data scientist di creare un Assistente GenAI che è diventato una funzionalità di vendita chiave per l'azienda ad-tech.

Con Lakeflow, puoi integrare facilmente le funzionalità di IA nella tua piattaforma di ingegneria dei dati e orchestrare i flussi di lavoro di IA, rendendo i tuoi processi di dati più efficienti, basati sugli insight e accessibili. E ci sono altre novità in arrivo! Presto potrai usare Databricks Genie per potenziare la tua piattaforma di ingegneria dei dati per la creazione e il debug di pipeline usando l'elaborazione del linguaggio naturale.

- Inizia con Databricks Free Edition

- Consulta la documentazione del prodotto per le Databricks AI functions

- Scopri di più su Databricks Genie

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.