Announcing the Databricks AI Security Framework 2.0

Guida comprovata per mitigare il rischio dei modelli di AI su larga scala

- La seconda edizione del Databricks AI Security Framework è progettata per abilitare implementazioni di AI sicure e di impatto.

- Nel DASF 2.0, abbiamo identificato 62 rischi tecnici di sicurezza e li abbiamo mappati ai controlli raccomandati.

- In risposta al feedback degli utenti, abbiamo rilasciato il documento compendio DASF, progettato per aiutare gli utenti a operazionalizzare il DASF.

Siamo entusiasti di annunciare la seconda edizione del Databricks AI Security Framework (DASF 2.0—scarica ora)! Le organizzazioni che corrono per sfruttare il potenziale dell'AI hanno bisogno sia dell''acceleratore' dell'innovazione che dei 'freni' della governance e della gestione del rischio. Il DASF colma questo divario, consentendo distribuzioni di AI sicure e di impatto per la tua organizzazione fungendo da guida completa sulla gestione del rischio dell'AI.

Questo blog fornirà una panoramica del DASF, esplorerà le principali intuizioni acquisite dal rilascio della versione originale, introdurrà nuove risorse per approfondire la tua comprensione della sicurezza dell'AI e fornirà aggiornamenti sui nostri contributori del settore.

Cos'è il Databricks AI Security Framework e cosa c'è di nuovo nella versione 2.0?

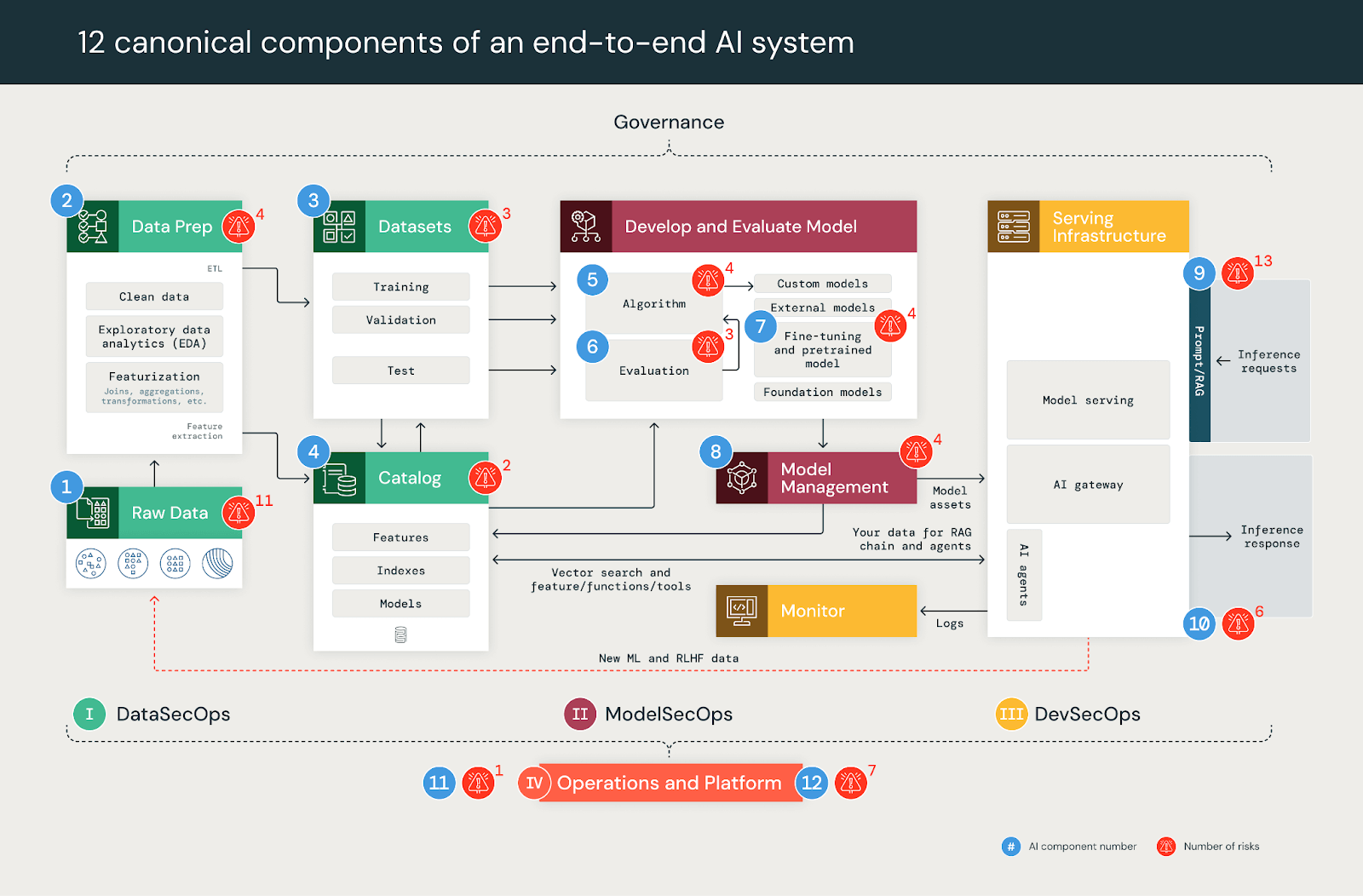

Il DASF è un framework e un whitepaper per la gestione dei rischi di sicurezza e governance dell'AI. Elenca i 12 componenti canonici dei sistemi di AI, i loro rispettivi rischi e i controlli attuabili per mitigare ciascun rischio. Creato dai team di Sicurezza e ML di Databricks in collaborazione con esperti del settore, colma il divario tra i team aziendali, dei dati, di governance e di sicurezza con strumenti pratici e strategie attuabili per demistificare l'AI, promuovere la collaborazione e garantire un'implementazione efficace.

A differenza di altri framework, il DASF 2.0 si basa sugli standard esistenti per fornire un profilo di rischio end-to-end per le distribuzioni di AI. Offre controlli di difesa in profondità per semplificare la gestione del rischio dell'AI per la tua organizzazione da operationalizzare e può essere applicato alla tua piattaforma dati e AI scelta.

Nel DASF 2.0, abbiamo identificato 62 rischi di sicurezza tecnica e li abbiamo mappati a 64 controlli raccomandati per la gestione del rischio dei modelli di AI. Abbiamo anche ampliato le mappature ai principali framework e standard di rischio dell'AI del settore, tra cui MITRE ATLAS, OWASP LLM & ML Top 10, NIST 800-53, NIST CSF, HITRUST, ENISA’s Securing ML Algorithms, ISO 42001, ISO 27001:2022, e l'EU AI Act.

Operationalizzazione del DASF - dai un'occhiata al nuovo compendio e al video tutorial di accompagnamento!

Abbiamo ricevuto feedback preziosi mentre condividiamo il DASF a eventi di settore, workshop e incontri con i clienti. Molti di voi hanno chiesto maggiori risorse per facilitare la navigazione del DASF, la sua operationalizzazione e la mappatura efficace dei propri controlli.

In risposta, siamo entusiasti di annunciare il rilascio del documento compendio DASF (Google sheet, Excel). Questa risorsa è progettata per aiutare a operationalizzare il DASF organizzando e applicando i suoi rischi, minacce, controlli e mappature agli standard riconosciuti dal settore di organizzazioni come MITRE, OWASP, NIST, ISO, HITRUST e altre. Abbiamo anche creato un video tutorial di accompagnamento che fornisce una guida passo passo del DASF e del suo compendio.

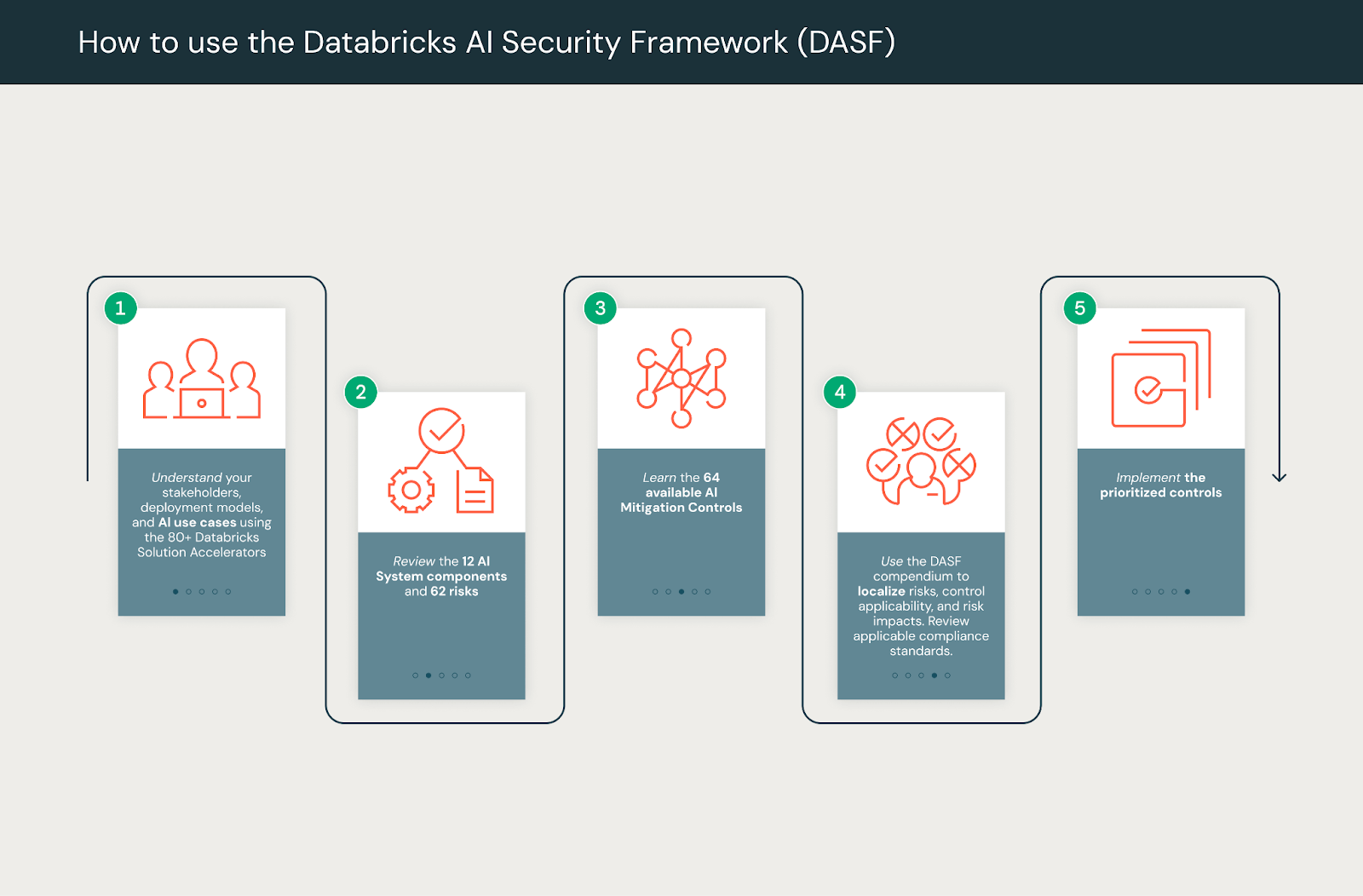

Il nostro obiettivo con questi aggiornamenti è rendere il DASF più facile da adottare, consentendo alle organizzazioni di implementare sistemi di AI in modo sicuro e fiducioso. Se sei desideroso di iniziare, il nostro team raccomanda il seguente approccio:

- Comprendi i tuoi stakeholder, i modelli di deployment e i casi d'uso dell'IA: Inizia con un caso d'uso aziendale, sfruttando il whitepaper DASF per identificare il modello di deployment dell'IA più adatto. Scegli tra oltre 80 Databricks Solution Accelerators per guidare il tuo percorso. I modelli di deployment includono Modelli ML Predittivi, API di Modelli Fondazionali, LLM Fine-tuned e Pre-trained, RAG, Agenti IA con LLM e Modelli Esterni. Assicurati chiarezza sullo sviluppo dell'IA all'interno della tua organizzazione, inclusi casi d'uso, set di dati, requisiti di conformità, processi, applicazioni e stakeholder responsabili.

- Rivedi i 12 componenti del sistema IA e i 62 rischi: Comprendi i 12 componenti dei sistemi IA, i rischi di cybersecurity tradizionali e i nuovi rischi di sicurezza IA associati a ciascun componente, e gli stakeholder responsabili (ad es. data engineer, data scientist, responsabili della governance e team di sicurezza). Utilizza il DASF per favorire la collaborazione tra questi gruppi durante tutto il ciclo di vita dell'IA.

- Rivedi i 64 controlli di mitigazione disponibili: Ogni rischio è mappato a controlli di mitigazione prioritari, iniziando dalla sicurezza perimetrale e dei dati. Questi rischi e controlli sono ulteriormente allineati a 10 standard di settore, fornendo dettagli e chiarezza aggiuntivi.

- Utilizza il compendio DASF per localizzare rischi, applicabilità dei controlli e impatti dei rischi: Inizia utilizzando la scheda "DASF Risk Applicability" per identificare i rischi pertinenti al tuo caso d'uso selezionando uno o più modelli di deployment dell'IA. Successivamente, rivedi gli impatti dei rischi associati, i requisiti di conformità e i controlli di mitigazione. Infine, documenta i dettagli chiave per il tuo caso d'uso, inclusa la descrizione del caso d'uso dell'IA, i set di dati, gli stakeholder, le considerazioni sulla conformità e le applicazioni.

- Implementa i controlli prioritari: Utilizza la scheda "DASF Control Applicability" del compendio per rivedere i controlli DASF applicabili e implementare i controlli di mitigazione sulla tua piattaforma dati attraverso i 12 componenti IA. Se stai utilizzando Databricks, abbiamo incluso link con istruzioni dettagliate su come distribuire ciascun controllo sulla nostra piattaforma.

Implementa il DASF nella tua organizzazione con nuove risorse di upskilling IA da Databricks

Secondo un recente studio di Economist Impact, i leader dei dati e dell'IA intervistati hanno identificato l'upskilling e la promozione di una mentalità di crescita come priorità chiave per guidare l'adozione dell'IA nel 2025. Come parte del lancio di DASF 2.0, disponiamo di risorse per aiutarti a comprendere i concetti di IA e ML e ad applicare le best practice di sicurezza dell'IA alla tua organizzazione.

- Formazione Databricks Academy: Consigliamo di seguire il nuovo corso AI Security Fundamentals, ora disponibile su Databricks Academy. Prima di approfondire il whitepaper, questo corso di 1 ora è un'ottima introduzione agli argomenti di sicurezza dell'IA evidenziati nel DASF. Riceverai anche un accreditamento per il tuo profilo LinkedIn al completamento. Se sei nuovo ai concetti di IA e ML, inizia con il nostro corso Generative AI Fundamentals.

- Video How-to: Abbiamo registrato video di panoramica e how-to del DASF per un rapido consumo. Puoi trovare questi video sul nostro canale YouTube Security Best Practices.

- Workshop in presenza o virtuale: Il nostro team offre un AI Risk Workshop come walkthrough live dei concetti delineati nel DASF, concentrandosi sul superamento degli ostacoli all'operativizzazione della gestione del rischio IA. Questo evento di mezza giornata si rivolge a leader di livello Director+ nei settori governance, dati, privacy, legale, IT e sicurezza.

- Supporto al deployment: Lo Strumento di Analisi della Sicurezza (SAT) monitora l'adesione alle best practice di sicurezza negli workspace Databricks su base continuativa. Abbiamo recentemente aggiornato il SAT per semplificare la configurazione e migliorare i controlli, allineandoli al DASF per una migliore copertura dei rischi di sicurezza dell'IA.

- Assistente IA DASF: I clienti Databricks possono configurare l'assistente IA Databricks AI Security Framework (DASF) direttamente nel proprio workspace senza competenze pregresse di Databricks, interagire con i contenuti DASF in un semplice linguaggio umano e ottenere risposte.

Costruire una community con gruppi di settore IA, clienti e partner

Garantire che il DASF si evolva in linea con l'attuale ambiente normativo dell'IA e il panorama delle minacce emergenti è una priorità assoluta. Dal lancio della versione 1.0, abbiamo formato un gruppo di lavoro sull'IA composto da colleghi del settore, clienti e partner per rimanere strettamente allineati a questi sviluppi. Vogliamo ringraziare i nostri colleghi del gruppo di lavoro e i nostri pre-reviewer come Complyleft, The FAIR Institute, Ethriva Inc, Arhasi AI, Carnegie Mellon University e Rakesh Patil di JPMC. Puoi trovare l'elenco completo dei contributori nella sezione ringraziamenti del DASF. Se desideri partecipare al Gruppo di Lavoro IA DASF, contatta il nostro team all'indirizzo [email protected].

Ecco cosa dicono alcuni dei nostri principali sostenitori:

"L'IA sta rivoluzionando l'erogazione sanitaria attraverso innovazioni come la pipeline CLEVER GenAI, che elabora oltre 1,5 milioni di note cliniche al giorno per classificare i determinanti sociali chiave e influenzare la cura dei veterani. Questa pipeline è costruita con una solida base di sicurezza, incorporando i controlli NIST 800-53 e sfruttando il Databricks AI Security Framework per garantire la conformità e mitigare i rischi. Guardando al futuro, stiamo esplorando modi per espandere queste capacità attraverso l'Infrastructure as Code e strategie di containerizzazione sicure, consentendo agli agenti di essere distribuiti e scalati dinamicamente dai repository mantenendo rigorosi standard di sicurezza." - Joseph Raetano, Artificial Intelligence Lead, Summit Data Analytics & AI Platform, U.S. Department of Veteran Affairs

“DASF è lo strumento essenziale per trasformare la quantificazione del rischio AI in una realtà operativa. Con l'approccio FAIR-AI Risk ora al suo secondo anno, DASF 2.0 consente ai CISO di colmare il divario tra la strategia di cybersecurity e quella aziendale, parlando un linguaggio comune basato sull'impatto finanziario misurabile.” - Jacqueline Lebo, Founder AI Workgroup, The FAIR Institute and Risk Advisory Manager, Safe Security

“Poiché l'IA continua a trasformare i settori, la protezione di questi sistemi da attacchi informatici sofisticati e unici è più critica che mai. Il Databricks AI Security Framework è una grande risorsa per le aziende che vogliono essere all'avanguardia sia nell'innovazione che nella sicurezza. Con il DASF, le aziende sono attrezzate per comprendere meglio i rischi dell'IA e trovare gli strumenti e le risorse per mitigarli mentre continuano a innovare.” - Ian Swanson, CEO, Protect AI

“Con il Databricks AI Security Framework, siamo in grado di mitigare i rischi dell'IA in modo ponderato e trasparente, il che è inestimabile per costruire la fiducia del consiglio di amministrazione e dei dipendenti. È un punto di svolta che ci consente di portare l'IA nel business ed essere tra il 15% delle organizzazioni che portano i carichi di lavoro AI in produzione in modo sicuro e con fiducia.” — Coastal Community Bank

"Nel contesto dei dati e dell'IA, le conversazioni sulla sicurezza sono poche. Il Databricks AI Security Framework affronta il lato spesso trascurato del lavoro AI e ML, fungendo sia da guida di prim'ordine per comprendere i rischi della sicurezza dell'IA, sia su come mitigarli." - Josue A. Bogran, Architect at Kythera Labs & Advisor to SunnyData.ai

“Abbiamo utilizzato il Databricks AI Security Framework per migliorare la postura di sicurezza della nostra organizzazione nella gestione dei rischi di sicurezza di ML e AI. Con il Databricks AI Security Framework, ora siamo più fiduciosi nell'esplorare possibilità con l'IA e l'analisi dei dati, garantendo al contempo di disporre delle adeguate misure di governance dei dati e di sicurezza in atto." - Muhammad Shami, Vice President, Jackson National Life Insurance Company

Scarica oggi stesso il Databricks AI Security Framework 2.0!

Il Databricks AI Security Framework 2.0 e il suo compendio (foglio Google, Excel) sono ora disponibili per il download. Per saperne di più sui prossimi workshop sui rischi dell'IA o per richiedere un workshop dedicato in presenza o virtuale per la tua organizzazione, contattaci all'indirizzo [email protected] o al tuo team di account. Abbiamo anche ulteriori contenuti di leadership di pensiero in arrivo per fornire ulteriori approfondimenti sulla gestione della governance dell'IA. Per ulteriori approfondimenti su come gestire i rischi della sicurezza dell'IA, visita il Databricks Security and Trust Center.

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.