Come le aziende tecnologiche leader stanno eliminando la tassa del costruttore con Lakebase

Le app native per l'IA richiedono che i dati operativi e le analisi convivano: ecco come i team stanno rimuovendo la barriera.

- Riduci gli strati di spostamento dei dati: Le organizzazioni leader utilizzano Databricks Lakebase, eliminando ETL e reverse ETL unificando dati operativi e analitici su una singola piattaforma governata.

- Abilita l'intelligenza in tempo reale: Le app e i sistemi di intelligenza artificiale operano direttamente su dati freschi a bassa latenza senza ritardi di sincronizzazione.

- Produci sistemi di intelligenza artificiale: Un'architettura unificata riduce l'overhead operativo e abilita cicli di apprendimento continui su larga scala.

Il costo nascosto che blocca la roadmap delle tue app AI

Tra le principali organizzazioni tecnologiche che sviluppano app AI-native, il vincolo principale è passato dalla capacità del modello all'architettura dati sottostante, e in particolare alle pipeline dati. I requisiti dei sistemi AI per accedere a un contesto stateful in tempo reale per gli agenti e a costi marginali bassi per uno sviluppo rapido e sperimentale hanno esposto il difetto critico nelle architetture dati tradizionali e separate.

I carichi di lavoro operativi vengono tipicamente eseguiti su database transazionali cloud (ad es. motori Postgres/MySQL gestiti), mentre l'analisi, le pipeline ML e l'ingegneria delle feature risiedono nel lakehouse. La sincronizzazione tra questi livelli si basa su una complessa rete di pipeline CDC, job ETL/ELT e framework ETL inverso. Ciò si traduce in inefficienze sistemiche:

- Data staleness: i sistemi AI operano su snapshot in ritardo anziché sullo stato in tempo reale

- Frammentazione architetturale: governance, lineage e controllo degli accessi sono duplicati tra i sistemi

- Overhead operativo: lo sforzo ingegneristico si sposta dallo sviluppo del prodotto all'orchestrazione delle pipeline e alla gestione dei fallimenti

Chiamiamo questo il tax del builder: un'inefficienza strutturale derivante da stack operativi e analitici disaccoppiati. Per le persone all'interno delle aziende tecnologiche che costruiscono le piattaforme, i prodotti SaaS e gli strumenti per sviluppatori su cui tutti gli altri si basano, questo tax è particolarmente dannoso. Ogni nuova funzionalità AI genera un altro database, un'altra pipeline, un altro trimestre di ritardo.

Cambiamento architetturale: co-locazione di app e dati

Per rompere questo schema, le principali aziende tecnologiche stanno ridisegnando l'architettura, andando oltre l'adozione di un altro strumento specializzato. Le vediamo eseguire app e AI direttamente sulla stessa base governata delle loro analisi.

Questa base è Lakebase: un motore Postgres serverless completamente gestito e nativamente integrato nella Databricks Platform.

- Le app leggono e scrivono direttamente sui dati gestiti dal lakehouse

- La governance è centralizzata tramite Unity Catalog su tutti i carichi di lavoro

- Dati operativi affidabili con snapshot automatizzati e recupero guasti integrato

Ciò stabilisce una Base Applicativa Interoperabile: un unico livello governato in cui app, AI e analisi condividono lo stesso store operativo.

Scenario reale

Amey Banarse ha presentato “From Transactions to Agents: PostgreSQL in Modern AI Applications” a PostgresConf 2026 [Slide]. Amey illustra una dimostrazione live di un'app di gestione sinistri healthtech costruita interamente su Lakebase + l'AI DevKit, mostrando come l'intelligenza del lakehouse, le informazioni operative e un ciclo di apprendimento continuo funzionino su un'unica base Databricks.

Le organizzazioni entrano tipicamente in questa architettura attraverso tre vettori principali:

- Eliminazione delle pipeline ETL inverse: i set di dati analitici (tabelle di livello gold) vengono sincronizzati direttamente in Lakebase tramite integrazione nativa. Ciò rimuove la dipendenza da strumenti esterni e riduce la fragilità delle pipeline.

- App AI-native e strumenti interni: esegui Databricks Apps + Lakebase come stack unico e serverless con model serving, feature store e analytics. Nessuna infrastruttura aggiuntiva da provisionare.

- Memoria e stato agentivo: Lakebase con pgvector per la ricerca semantica diventa il livello di memoria operativa per gli agenti costruiti con Agent Bricks, insieme ai dati su cui ragionano.

Cosa vedono effettivamente le aziende tecnologiche

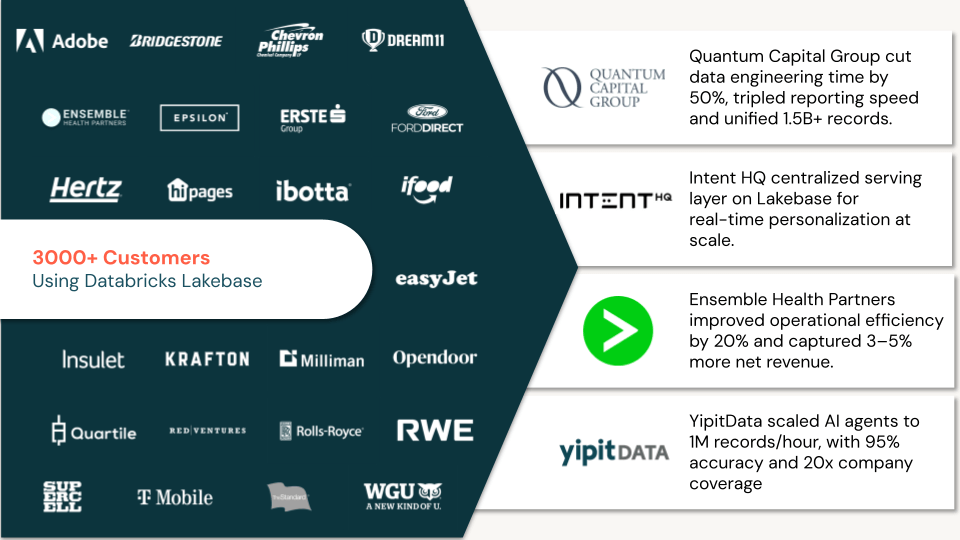

I risultati seguenti provengono da aziende tecnologiche che sono passate a un'architettura Lakebase:

YipitData ha scalato la propria pipeline di agenti AI per elaborare 1 milione di record all'ora, ottenendo un'accuratezza di tagging del 92-95% e una copertura aziendale 20 volte superiore. Utilizzando Lakebase come sistema relazionale di registrazione all'interno di Unity Catalog, i loro agenti operano con uno stato duraturo e governato — nessun store esterno fragile, nessun ritardo di sincronizzazione.

Quantum Capital Group gestiva oltre 1,5 miliardi di record su sei fonti dati frammentate. Dopo essersi consolidati su Lakebase, hanno eliminato oltre 100 tabelle ridondanti, ridotto del 50% il tempo di data engineering e triplicato la velocità di reporting — i team ora lavorano da un unico set di dati affidabile invece di combattere la proliferazione delle versioni.

Ensemble Health Partners ha unificato oltre 15 sistemi SQL Server frammentati. Con Lakebase come livello transazionale, hanno implementato flussi di lavoro basati sull'AI per il ciclo di vita dei ricavi che hanno migliorato l'efficienza operativa del 20% e hanno aiutato i clienti a catturare un ulteriore 3-5% di ricavi netti anno su anno.

Replit, la cui piattaforma supporta milioni di sviluppatori nella creazione e distribuzione di software, utilizza Lakebase + l'AI DevKit di Databricks per aiutare i clienti a lanciare AI di generazione di codice in produzione in 3 settimane con una velocità di sviluppo 10 volte superiore, eliminando il divario tra sistemi operativi e analitici fin dal primo giorno.

IntentHQ, una piattaforma di intelligenza dei consumatori, ha centralizzato il proprio livello di serving su Lakebase per alimentare la personalizzazione in tempo reale su larga scala — fornendo ai modelli AI uno store operativo a bassa latenza che rimane sincronizzato con i dati del suo lakehouse senza pipeline personalizzate.

Il modello architetturale alla base dei risultati

Nonostante i diversi casi d'uso — dagli agenti AI e motori di personalizzazione ai flussi di lavoro sanitari e piattaforme per sviluppatori — queste organizzazioni non stanno ottenendo successo attraverso ottimizzazioni isolate. Stanno convergendo su un modello architetturale fondamentalmente diverso.

Al suo nucleo, questo modello architetturale elimina la separazione tradizionale tra sistemi transazionali, piattaforme analitiche e pipeline AI, sostituendola con una base dati condivisa e interoperabile.

Questo pattern include costantemente tre livelli strettamente integrati:

Livello di intelligenza del Lakehouse

Una base governata e scalabile dove operano carichi di lavoro batch e streaming, feature engineering e carichi di lavoro AI/ML. Questo livello fornisce il sistema di insight, abilitando l'elaborazione su larga scala, l'addestramento dei modelli e l'analisi su dati unificati.

Livello dati operativi

Un'interfaccia transazionale a bassa latenza (Lakebase) che funge da sistema di esecuzione per applicazioni e agenti. Questo livello abilita letture/scritture in tempo reale, gestione dello stato e logica applicativa direttamente sui dati governati — senza overhead di replica o sincronizzazione.

Ciclo di apprendimento continuo

Un sistema di feedback chiuso in cui le interazioni delle applicazioni, gli output degli agenti e i segnali degli utenti vengono catturati e reintegrati nelle pipeline dei modelli. Ciò stabilisce un sistema di miglioramento continuo, consentendo alle capacità AI di evolvere in base all'uso nel mondo reale.

Quando questi tre livelli condividono una base, i sistemi AI passano da carichi di lavoro isolati a sistemi di produzione in continuo miglioramento.

Eliminare il tax del builder

Il tax del builder non è inevitabile. È una conseguenza della costruzione di AI su un'infrastruttura progettata per un'era diversa — quando i database erano monolitici, le app stateless e l'intelligenza un progetto separato.

Lakebase cambia le regole del gioco! Le app vengono eseguite dove risiedono i dati. Gli agenti hanno il contesto di cui hanno bisogno. E il tempo di ingegneria che il tuo team ha dedicato alle pipeline torna alla distribuzione.

Guarda la sessione di Amey Banarse al PostgresConf 2026, “Da Transazioni ad Agenti: PostgreSQL nelle Moderne Applicazioni AI” [Slide] per vedere un'app completa nativa per l'AI costruita su Lakebase in azione.

Databricks Lakebase è un Postgres serverless costruito per agenti e app. Scopri di più su databricks.com/product/lakebase.

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.