Data Lakehouse とは何ですか?

データ ウェアハウスとデータ レイクの機能を ACID トランザクション、スキーマの適用、分析と AI のガバナンスと統合した最新のアーキテクチャ

によって Databricks Staff による投稿

- 生の非構造化データを保存できるデータレイクの柔軟性と、データウェアハウスの信頼性を組み合わせ、ACIDトランザク�ション、スキーマ適用、タイムトラベル、一貫性のある読み取りを実現し、エンタープライズ分析とレポート作成を実現します。

- Delta Lakeなどの最適化されたフォーマットを通じて、データレイクファイルへの直接SQLクエリとBIツール接続を可能にし、ETLの遅延や、別々のウェアハウスとレイクシステム間のデータ重複を排除します。

- すべてのデータ資産にわたるきめ細かなアクセス制御、データリネージ追跡、監査ログによる統合ガバナンスをサポートし、データエンジニア、アナリスト、データサイエンティストが同一プラットフォーム上で安全にコラボレーションできるようにします。

データレイクハウス (Data Lakehouse)とは?

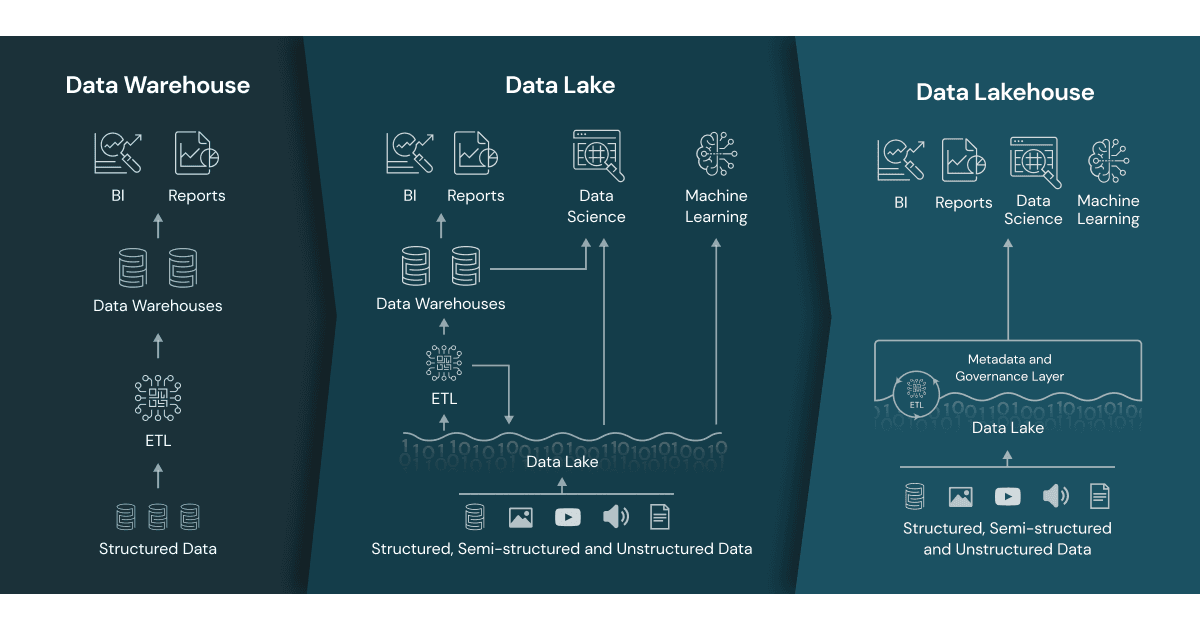

データレイクハウスとは、データレイクの柔軟性、経済性、スケーラビリティ (Scalability)とデータウェアハウス (DWH)のデータ管理や ACID トランザクションの機能を取り入れたオープンで新たなデータ管理アーキテクチャで、あらゆるデータにおけるビジネスインテリジェンス(BI)と機械学習(ML)を可能にします。

シンプル、柔軟で低コストなデータレイクハウス

データレイクハウスは新たなオープンシステムデザインによって構築されており、データウェアハウス (DWH)と類似のデータ構造とデータ管理機能を、データレイクに使用される低コストのストレージに直接実装しています。データレイクとデータウェアハウス (DWH)を単一のシステムに統合することで、データ部門が複数のシステムにアクセスする必要がなくなり、データ処理が迅速化します。さらに、データレイクハウスは、データサイエンス、機械学習、ビジネスアナリティクスのプロジェクトに利用できる、有用で最新のデータを組織に提供します。

データレイクハウスを実現する主要テクノロジー

次のような主要な技術の向上により、データレイクハウスは実現しました。

- データレイクのためのメタデータレイヤー

- データレイクで高性能な SQL 実行を可能にする新たなクエリエンジン設計

- データサイエンスと機械学習ツールへの最適化されたアクセス

メタデータレイヤーは、オープンソースの Delta Lake のように、Parquet ファイルなどのオープンなファイル形式上に配置され、異なるテーブルバージョンに含まれるファイルを追跡して、ACID 準拠のトランザクションなどの豊富な管理機能を提供します。メタデータレイヤーにより、ストリーミングの I/O サポート(Kafka のようなメッセージパスは不要)、古いテーブルバージョンへのタイムトラベル、スキーマの適用と展開、データの検証など、データレイクハウスでの一般的な機能が有効になります。性能は、データウェアハウス (DWH)が 2 層アーキテクチャで存在する重要な理由の 1 つであり、データレイクハウスを企業の主要なデータアーキテクチャにするための鍵です。低コストのオブジェクトストアを��使用するデータレイクでは、これまでアクセスに時間がかかっていましたが、レイクハウスは新たなクエリエンジンの設計により、高性能な SQL 分析が可能になります。これらの最適化には、RAM/SSD でのホットデータのキャッシュ(より効率的な形式にトランスコードされる可能性があります)、クラスタの同時アクセスデータのデータレイアウトの最適化、統計やインデックスなどの補助的なデータ構造、最新 CPU でのベクトル化された実行が含まれます。データレイクハウスは、これらの技術が統合されることにより、一般的なデータウェアハウス (DWH)に匹敵する性能(TPC-DS 基準)を実現します。データレイクハウスで使用されるオープンなデータ形式(Parquet など)により、 レイクハウスのデータへのアクセスが容易になります。データサイエンティストや機械学習エンジニアは、Parquet や ORC などのソースにすでにアクセスがある pandas、TensorFlow、PyTorch、その他の DS/ML エコシステムにおける一般的なツールを使用できます。Spark DataFrames は、これらのオープンフォーマットに対応した宣言型のインターフェイスを提供し、さらなる I/O の最適化を可能にします。その他、データレイクハウスには、監査履歴やタイムトラブルなどの機械学習の再現性を高める機能も備わっています。データレイクハウスへの移行を支えるテクノロジーの進化については、CIDR レポート「レイクハウス:データウェアハウス (DWH)と高度な分析を統合する新世代のオープンプラットフォーム」、またはリサーチペーパー「Delta Lake︓クラウドオブジェクトストアによる高性能ACID テーブルストレージ」で詳細をお読みいただけます。

データアーキテクチャの歴史

データウェアハウス (DWH)の背景

データウェアハウス (DWH)はこれまで、意思決定支援や BI(ビジネスインテリジェンス)アプリケーションにおいて広く利用されてきており、これには長い歴史があります。しかし、データウェアハウス (DWH)には、構造化データの処理には適しているが、非構造化・半構造化データの処理には適していないという問題があり、高速で多様なデータの大規模処理やコスト効率に課題がありました。

データレイクの誕生

そこで、データサイエンスや機械学習用の安価なストレージで多様な形式の生データに対応するデータレイクが構築されました。データレイクはデータの格納には適していましたが、重要な機能が欠けており、トランザクションのサポートやデータ品質の保証がありません。一貫性と分離性の欠如により、アペンドと読み取り、バッチとストリーミングジョブを混在させることはほぼ不可能です。

一般的な 2 層データアーキテクチャ

そのため、データ部門はデータレイクとデータウェアハウス (DWH)のデータで BI や ML を実行可能にするために、これらのシステムをつなぎ合わせる必要がありました。しかしその結果、重複データ、余分なインフラコスト、セキュリティ�上の課題、大きな運用コストが発生します。 2 層データアーキテクチャでは、まず、データは運用データベースからデータレイクに ETL されます。このデータレイクは、企業のデータを低コストのオブジェクトストレージに格納します。データは一般的な機械学習ツールと互換性のある形式で保存されますが、適切に整理、維持されていない場合がほとんどです。次に、重要なビジネスデータの小さなセグメントで ETL をもう一度実行し、BI やデータ分析のためにデータウェアハウス (DWH)にロードします。 2 層アーキテクチャでは、ETL ステップが複数あるため、定期的なメンテナンスを必要とし、データが古くて使えない場合もあります。データアナリストとデータサイエンティストはこの問題に大きな懸念を抱いていることが、 KaggleとFivetran による最近の調査でわかっています。 2 層アーキテクチャの問題点 の詳細は、こちらのブログで解説しています。

エンタープライズ向けエージェントAIプレイブック

FAQ

1. データレイクハウスとは具体的にどのような技術ですか?

データレイクハウスは、データレイクの柔軟性とコスト効率、そしてデータウェアハウスの厳格なデータ管理とACIDトランザクションの特性を組み合わせたデータアーキテクチャです。

2. データレイクハウスの主な利点は何ですか?

データレイクハウスは、低コストのストレージにデータウェアハウスのデータ管理機能を実装することで、データ処理の迅速化とコスト削減を実現します。

3. データレイクハウスで使用される技術やツールにはどのようなものがありますか?

データレイクハウスでは、メタデータレイヤーや新たなクエリエンジン設計、データサイエンスと機械学習ツールへの最適化されたアクセスなどが可能です。特に、Delta LakeやParquetファイル形式などのオープンなファイル形式を利用し、高性能なSQL実行やデータの検証を行うことができます。

関連資料

- データレイクハウスとは-ブログ

- データレイクハウスのアーキテクチャ:ビジョンからリアルへ

- レイクハウスと SQL アナリティクスの概要

- レイクハウス: データウェアハウス (DWH)と高度な分析を統合する新世代のオープンプラットフォーム

- オンデマンド動画:Delta Lake ― レイクハウスの基盤

- Databricks のレイクハウスプラットフォーム

- データブリュー Vidcast: データレイクハウス シーズン1

- レイクハウスパラダイムの誕生

- データレイクハウスの構築(Bill Inmon 著)

- The Data Lakehouse Platform for Dummies(初心者のためのデータレイクハウスプラットフォーム)

最新の投稿を受信トレイで受け取る

ブログを購読して、最新の投稿を受信トレイにお届けします。