Ein KI-First-Ansatz für Data Engineering mit Lakeflow und Agent Bricks

Wie Lakeflow und Agent Bricks KI-gestützte Automatisierung in jede Phase Ihrer ETL-Pipeline bringen

von Joanna Zouhour

- Lakeflow bietet eine KI-zentrierte Daten-Engineering-Plattform, die es ihnen ermöglicht, KI-Modelle in ihrem ETL mit den KI-Funktionen von Agent Bricks zu nutzen und zu produktionalisieren

- Data Engineer können mit Lakeflow Jobs ihre KI-Modelle einfach in großem Scale orchestrieren und so ihre ETL-Pipeline im Kontext ihres Unternehmens automatisieren

- Von Fuzzy-Matching über Datenextraktion bis hin zur Zusammenfassung können Benutzer von Lakeflow Jobs Pipeline-Anwendungsfälle erschließen und neue Key Insights gewinnen, die ihre nachgelagerten Analytics-, BI- und ML-Anwendungsfälle unterstützen.

Data Engineers konzentrieren sich zunehmend auf ein zentrales Problem: den Einsatz von KI, um ETL zu verbessern und zuverlässige, produktionsreife Pipelines zu erstellen, ohne neue Komplexität einzuführen. Sie benötigen eine KI, die tatsächlich Ergebnisse liefert und Arbeitsabläufe rationalisiert, ohne getrennte Tools hinzuzufügen oder den Kontext zu entfernen.

Databricks Lakeflow bietet eine einheitliche Data-Engineering-Plattform mit integrierter und sicherer KI, die Ihre gesamte Datenverarbeitung automatisiert, tiefere Einblicke ermöglicht und ein breiteres Spektrum an Geschäftsproblemen unterstützt. Ob durch KI-generierten Pipeline-Code oder die Orchestrierung von KI-Workloads – Data Engineers, die Lakeflow nutzen, müssen keine Stunden mehr mit manueller Integrationsarbeit verbringen und können sich stattdessen auf strategische und höherwertige Muster konzentrieren, die einen echten Mehrwert für ihr Unternehmen schaffen.

In diesem Blog erfahren Sie, wie Sie Ihre KI-Modelle produktisieren und skalieren können, indem Sie sie in Ihre Datenpipeline implementieren, um automatisch Geschäftseinblicke zu gewinnen.

Gewinnen Sie mühelos mehr Erkenntnisse aus Ihren Daten in großem Umfang

Datenteams ertrinken in unstrukturierten Eingaben, seien es Verträge, Rechnungen, Transkripte oder Bewertungen. Ihre Verarbeitung bedeutet oft das Jonglieren mit fehleranfälligen NLP-Modellen, starren Regeln oder manueller Bereinigung. Das Ergebnis: unzuverlässige Ausgaben, langsame Bearbeitungszeiten und wertvolle Erkenntnisse, die in Dokumenten eingeschlossen bleiben, während Ingenieure Zeit mit repetitivem Parsen verschwenden, anstatt Mehrwert zu schaffen.

Mit Databricks Lakeflow können Sie dieses Problem lösen, indem Sie KI-gestützte Transformationen über Databricks Agent Bricks AI Functions nahtlos in Ihre bestehenden Workflows integrieren. Mit diesen Funktionen können Sie hochwertige KI direkt in Ihren ETL-Prozess integrieren und so die Extraktion, Transformation und Klassifizierung von sowohl unstrukturierten als auch strukturierten Daten auf Scale automatisieren.

Es gibt verschiedene Arten von KI-Funktionen in Agent Bricks, aus denen Sie wählen können. Einige davon erfordern keine Prompts und sind aufgabenspezifisch, wie zum Beispiel:

ai_extract: Extrahiert bestimmte Entitäten aus dem Eingabetext basierend auf den von Ihnen bereitgestellten Labels. Zum Beispiel: Person, Ort, Organisationai_classify: Klassifiziert Eingabetext anhand der von Ihnen bereitgestellten Labels. Zum Beispiel „dringend“ vs. „nicht dringend“ oder Themenkategorien.ai_translate: Text in eine angegebene Zielsprache übersetzen.

Wir freuen uns besonders über unsere neu eingeführte KI-Funktion ai_parse_document, mit der sich beliebige unstrukturierte Daten in die erforderlichen strukturierten Formate umwandeln lassen. Mithilfe multimodaler Foundation Models können Sie mit ai_parse_doc Text parsen, Tabellen extrahieren, Abbildungen interpretieren und Bilder in KI-generierte Beschreibungen umwandeln. Diese Funktion eröffnet neue Möglichkeiten für die Verarbeitung von Daten, deren Analyse bisher kaum möglich war. Hier erfahren Sie mehr

Wir bieten auch eine allgemeinere Funktion namens ai_query() an, die auf unserer serverlosen Batch-Inferenz -Plattform basiert. Mit dieser Funktion können Sie KI-gesteuerte Transformationen für große Datensätze mit einem LLM Ihrer Wahl in einem einzigen Durchgang ausführen.

Um die Performance über Millionen von Zeilen hinweg zu maximieren, stellt unsere serverless Batch-Inferenz-Engine automatisch compute Ressourcen bereit, skaliert diese und führt Workloads parallel aus. Dadurch wird der Overhead pro Anfrage reduziert und eine deutlich schnellere Verarbeitung ermöglicht, wodurch die Laufzeiten von Stunden auf Minuten verkürzt und gleichzeitig die Kosteneffizienz für KI-Workloads mit hohem Volumen verbessert werden.

Mit Lakeflow können Sie Ihre KI-Modelle einfach in die Produktion überführen und sie mithilfe von Lakeflow Jobs nativ in Ihrer Data-Engineering-Lösung orchestrieren. Mit KI-Funktionen können Sie Ihre Orchestrierung effizienter gestalten und weitere Anwendungsfälle erschließen, wie zum Beispiel:

- Neue Daten generieren. Nutzen Sie KI, um Zusammenfassungen von Kundeneinblicken zu erstellen, um das Reporting zu beschleunigen oder zukünftige Umsätze zu prognostizieren.

- Strukturieren und organisieren Sie Daten in bestimmte, geschäftsrelevante Kategorien. Führen Sie Stimmungsanalysen für Millionen von mehrsprachigen Bewertungen durch oder automatisieren Sie die Kundensegmentierung mithilfe von Prompts in natürlicher Sprache im großen Scale.

- Verbessern Sie die Datenqualität. Nutzen Sie Fuzzy-Matching und Entitätsauflösung, um Duplikate und Inkonsistenzen in großem Umfang zu beheben.

Durch die Kombination von Lakeflow und Agent Bricks können Sie Ihre KI-Modelle auf einer einzigen, einheitlichen und verwalteten Datenplattform ausführen, sodass Ihre KI – und die daraus gewonnenen Erkenntnisse – den richtigen Geschäfts- und Unternehmenskontext haben.

Praktische Anwendungsfälle von KI-Funktionen und Lakeflow

Beispiel 1: Umwandlung von Roh-Anruftranskripten in Geschäftseinblicke

Stellen Sie sich vor, Ihr Vertriebsteam benötigt eine zuverlässige Methode, um lange, unstrukturierte Anruftranskripte in klare, umsetzbare Zusammenfassungen umzuwandeln. Bei Hunderten von Anrufen pro Tag, von denen viele 45 bis 60 Minuten dauern, wird eine manuelle Überprüfung schnell unmöglich.

Mit Databricks können Sie integrierte KI-Funktionen nutzen, um all diese Transkripte einfach und schnell zu analysieren, wichtige Erkenntnisse zu extrahieren und Folgeempfehlungen zu generieren.

Anstatt einen separaten KI-Dienst zu erstellen oder benutzerdefinierte Agents zu verwalten, können Sie einfach eine Abfrage schreiben und sie mit Lakeflow Jobs als Teil Ihres Orchestrators ausführen. Ihr KI-Modell wird dann direkt in einer verwalteten und einheitlichen Data-Engineering-Plattform implementiert, wo Sie eine skalierbare Batch-Verarbeitung erhalten, die vollständig in Ihre bestehenden Vertriebs-Pipeline-Workflows integriert bleibt und dabei den richtigen Geschäfts- und Unternehmenskontext beibehält.

Sehen wir uns an, wie das in der Praxis funktioniert. Nach der Erfassung von Anruftranskripten in Ihrer Pipeline können Sie KI-Funktionen anwenden, um unstrukturierten Text in nutzbare Signale umzuwandeln:

ai_analyze_sentiment, um die allgemeine Stimmung des Anrufs (positiv, negativ, neutral) zu ermittelnai_extract, um wichtige Informationen aus den Anrufen zu extrahieren, einschließlich Kundenname, Firmenname, Berufsbezeichnung, Telefonnummer usw.ai_classifyzur Kategorisierung des Anruftyps (Dringlichkeit, Thema usw.)

Dies gibt Ihnen eine strukturierte Grundlage für nachgelagerte Analytics und Automatisierung.

Verwenden Sie als Nächstes ai_query, um jeden Anruf mit dem KI-Modell Ihrer Wahl zusammenzufassen (in unserem Beispiel verwenden wir ein „databricks-meta-llama-3-3-70b-instruct“-LLM):

Diese Abfrage erzeugt konsistente, hochwertige Zusammenfassungen, die Vertriebs- und Account-Teams auf einen Blick einsehen können.

Anschließend können Sie im selben Workflow personalisierte Follow-ups generieren:

Diese Notizen können dann in Scale direkt in Ihre CRM- oder Vertriebstools übertragen werden, damit Ihre Teams kurz nach Ende des Anrufs genau wissen, welche Maßnahmen zu ergreifen sind. Sie könnten diese Notizen auch mit Ihrem BI-Team teilen, um Lücken aufzudecken und das allgemeine Kundendiensterlebnis zu verbessern.

Beispiel 2: Optimierung der Bearbeitung von Versicherungsansprüchen

Stellen Sie sich vor, Sie erstellen eine Pipeline zur Schadensbearbeitung für einen Versicherungsanbieter, der schnellere und konsistentere Genehmigungen benötigt. Heutzutage gehen Ansprüche oft per E-Mail mit unstrukturierten Anhängen wie gescannten Dokumenten, Fotos und PDFs ein, was ihre Erfassung und Verarbeitung auf Scale erschwert.

Mit Agent Bricks und Lakeflow können Dateningenieure ai_parse_document und ai_query verwenden, um Daten aus eingehenden E-Mails als Teil ihrer ETL-Pipelines automatisch zu extrahieren, zu normalisieren und zu konsolidieren. Dies ermöglicht eine zuverlässige End-to-End-Automatisierung, die die manuelle Überprüfung reduziert, Entscheidungen beschleunigt und sich nahtlos in bestehende Daten-Workflows integriert.

So funktioniert das:

Mit Lakeflow und Agent Bricks können Sie Ihre E-Mail-Dateien in Ihr Lakehouse aufnehmen und dann die benötigten Daten extrahieren mit:

ai_query, um den E-Mail-Text zu lesen und wichtige Informationen zu extrahieren (zum Beispiel: Name, Geburtsdatum, Adresse, Sozialversicherungsnummer)ai_querymit einem Modell, das speziell den Typ des eingehenden Bildes lesen kann. Diese KI-Funktion generiert Text, der das angehängte Bild beschreibt, und extrahiert dessen Metadaten. Nachfolgend finden Sie ein SQL-Abfragebeispiel für diese Funktion:

- und

ai_parse_document, um alle an die E-Mail angehängten PDFs (JPG oder PNG) zu lesen

Sobald die Daten extrahiert sind, können Sie ai_query erneut verwenden, um alle Informationen in einer Datei zu konsolidieren, die je nach Anwendungsfall entweder in einem anderen Workflow wiederverwendet oder direkt für ein nachgelagertes Team (BI-Analysten, KI/ML-Team usw.) freigegeben werden kann.

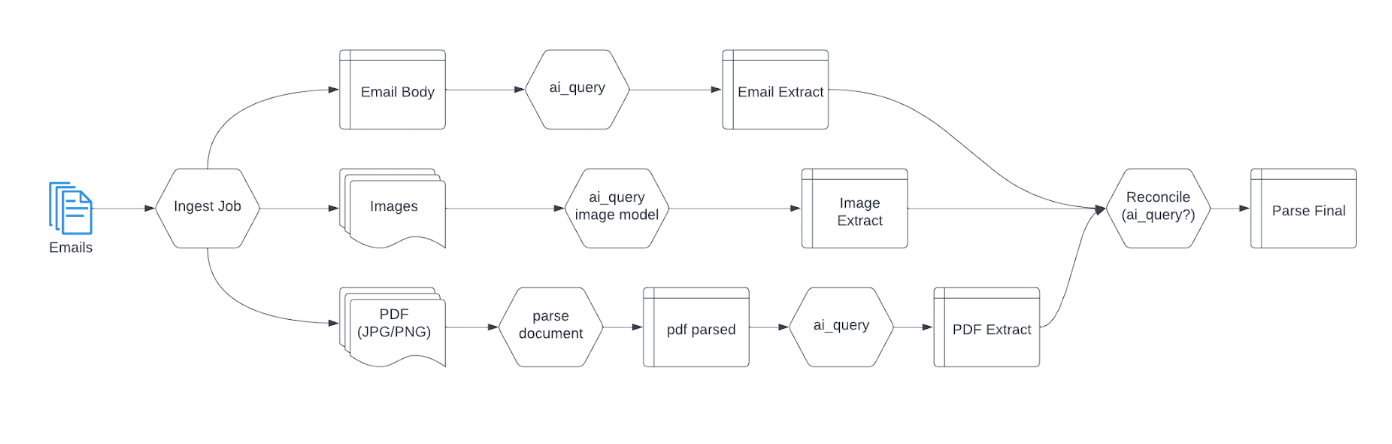

Nachfolgend finden Sie ein DAG-Beispiel dafür, wie dieser Workflow in Lakeflow Jobs aussehen würde:

Mit der Kombination von Lakeflow und Agent Bricks können Sie noch so viel mehr tun – sehen Sie sich dieses Video an, um zu erfahren, wie Sie unübersichtliche Vertriebsdaten in KI-gesteuerte Marketingkampagnen umwandeln können.

Praxisanwendungen von KI in Databricks

Viele Databricks-Kunden und Data Engineers haben erfolgreich verschiedene geschäftliche Herausforderungen – Preise, Kundenerfolg und Marketing – mithilfe von KI und Lakeflow bewältigt, um Einblicke zu gewinnen und die Produktivität zu steigern.

Kard, ein Fintech-Unternehmen mit Sitz in New York, verwendet Agent Bricks KI-Funktionen, um ein skalierbares, genaues System zur Transaktionskategorisierung zu betreiben, das manuelle und inkonsistente alte Methoden ersetzt. Dieser moderne Ansatz ermöglicht es Kard, Milliarden von Transaktionen effizient zu verarbeiten, personalisierte Prämien bereitzustellen und umfassendere Einblicke zu gewinnen, die die Kundenbindung und den Geschäftswert steigern.

Das Data-Engineering-Team der Banco Bradesco, einer der größten Banken Lateinamerikas, hatte mit Produktivitätsengpässen zu kämpfen, die auf langwierige Programmier-, Debugging- und Dokumentationsprozesse zurückzuführen waren. Durch die Einführung von Databricks Assistant konnten sie die Programmierzeit um 50 % reduzieren und sowohl technische als auch nicht-technische Benutzer in die Lage versetzen, Code in natürlicher Sprache zu generieren und Fehler zu beheben. Dies demokratisiert den Datenzugriff, senkt Kosten und beschleunigt datengesteuerte Entscheidungen.

Locala, eine globale Omnichannel-Werbeplattform, nutzte Lakeflow Jobs zur Orchestrierung komplexer LLM-Trainingspipelines, die ihr bisheriger Scheduler, Airflow, nicht bewältigen konnte. Durch die Optimierung von ETL, Modelltraining und -experimenten sowie der Auswahl der Rechenleistung reduzierte Lakeflow Jobs den operativen Aufwand für die Verwaltung komplexer Workflows, sodass ein einzelner Data Scientist einen GenAI-Assistenten entwickeln konnte, der zu einem Key Vertriebsmerkmal für das Ad-Tech-Unternehmen wurde.

Mit Lakeflow können Sie KI-Funktionen einfach in Ihre Data-Engineering-Plattform integrieren und KI-Workflows orchestrieren. So werden Ihre Datenprozesse effizienter, erkenntnisgesteuerter und zugänglicher. Und es kommt noch mehr! Bald können Sie Databricks Genie nutzen, um Ihre Data-Engineering-Plattform für die Erstellung und das Debugging von Pipelines mithilfe der Verarbeitung natürlicher Sprache zu unterstützen.

- Starten Sie mit der Databricks Free Edition

- Lesen Sie unsere Produktdokumentation zu den Databricks AI functions.

- Erfahren Sie mehr über Databricks Genie

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.