Ankündigung des Databricks AI Security Framework 2.0

Bewährte Anleitungen zur Risikominderung für KI-Modelle im großen Maßstab

von Kelly Albano, Omar Khawaja und Arun Pamulapati

- Die zweite Ausgabe des Databricks AI Security Frameworks wurde entwickelt, um sichere und wirkungsvolle KI-Implementierungen zu ermöglichen.

- Im DASF 2.0 haben wir 62 technische Sicherheitsrisiken identifiziert und sie den empfohlenen Kontrollen zugeordnet.

- Als Reaktion auf das Nutzerfeedback haben wir das DASF-Kompendium veröffentlicht, das Nutzern helfen soll, das DASF zu operationalisieren.

Wir freuen uns, die zweite Ausgabe des Databricks AI Security Framework (DASF 2.0 – jetzt herunterladen)! Organisationen, die das Potenzial von KI nutzen wollen, benötigen sowohl das „Gas“ der Innovation als auch die „Bremsen“ der Governance und des Risikomanagements. Das DASF schließt diese Lücke und ermöglicht sichere und wirkungsvolle KI-Implementierungen für Ihr Unternehmen, indem es als umfassender Leitfaden für das KI-Risikomanagement dient.

Dieser Blog bietet einen Überblick über das DASF, beleuchtet wichtige Erkenntnisse seit der Veröffentlichung der ursprünglichen Version, stellt neue Ressourcen zur Vertiefung Ihres Verständnisses der KI-Sicherheit vor und informiert über unsere Branchenbeitragenden.

Was ist das Databricks AI Security Framework und was ist neu in Version 2.0?

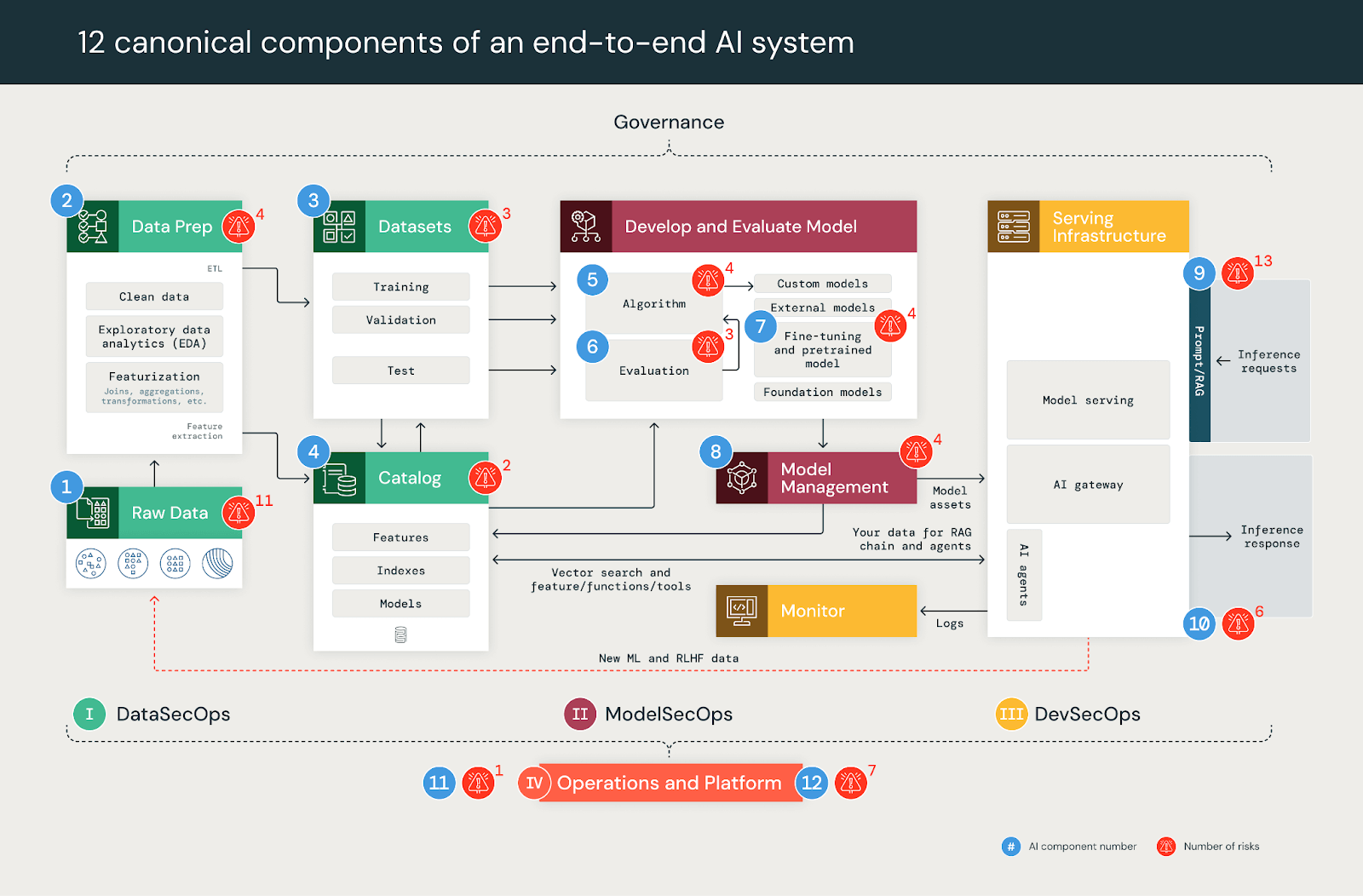

Das DASF ist ein Framework und Whitepaper für die Verwaltung von KI-Sicherheits- und Governance-Risiken. Es listet die 12 kanonischen KI-Systemkomponenten, ihre jeweiligen Risiken und umsetzbare Kontrollen zur Minderung jedes Risikos auf. Es wurde vom Databricks Security- und ML-Team in Zusammenarbeit mit Branchenexperten entwickelt und schließt die Lücke zwischen Geschäfts-, Daten-, Governance- und Sicherheitsteams mit praktischen Werkzeugen und umsetzbaren Strategien, um KI zu entmystifizieren, die Zusammenarbeit zu fördern und eine effektive Implementierung zu gewährleisten.

Im Gegensatz zu anderen Frameworks baut das DASF 2.0 auf bestehenden Standards auf, um ein End-to-End-Risikoprofil für KI-Implementierungen zu erstellen. Es bietet umfassende Sicherheitskontrollen, um das KI-Risikomanagement für Ihr Unternehmen zu vereinfachen und zu operationalisieren, und kann auf Ihre gewählte Daten- und KI-Plattform angewendet werden.

Im DASF 2.0 haben wir 62 technische Sicherheitsrisiken identifiziert und sie mit 64 empfohlenen Kontrollen für das Risikomanagement von KI-Modellen abgeglichen. Wir haben auch die Zuordnungen zu führenden branchenüblichen KI-Risiko-Frameworks und -Standards erweitert, darunter MITRE ATLAS, OWASP LLM & ML Top 10, NIST 800-53, NIST CSF, HITRUST, ENISAs Securing ML Algorithms, ISO 42001, ISO 27001:2022 und der EU AI Act.

Operationalisierung des DASF – schauen Sie sich das neue Kompendium und das begleitende Anleitungsvideo an!

Wir haben wertvolles Feedback erhalten, als wir das DASF auf Branchenveranstaltungen, Workshops und Kundentreffen vorgestellt haben. Viele von Ihnen haben nach weiteren Ressourcen gefragt, um die Navigation im DASF zu erleichtern, es zu operationalisieren und Ihre Kontrollen effektiv abzubilden.

Als Reaktion darauf freuen wir uns, die Veröffentlichung des DASF-Kompendiums bekannt zu geben (Google Sheet, Excel). Diese Ressource soll helfen, das DASF zu operationalisieren, indem sie seine Risiken, Bedrohungen, Kontrollen und Zuordnungen zu branchenweit anerkannten Standards von Organisationen wie MITRE, OWASP, NIST, ISO, HITRUST und anderen organisiert und anwendet. Wir haben auch ein begleitendes Anleitungsvideo erstellt, das eine geführte Tour durch das DASF und sein Kompendium bietet.

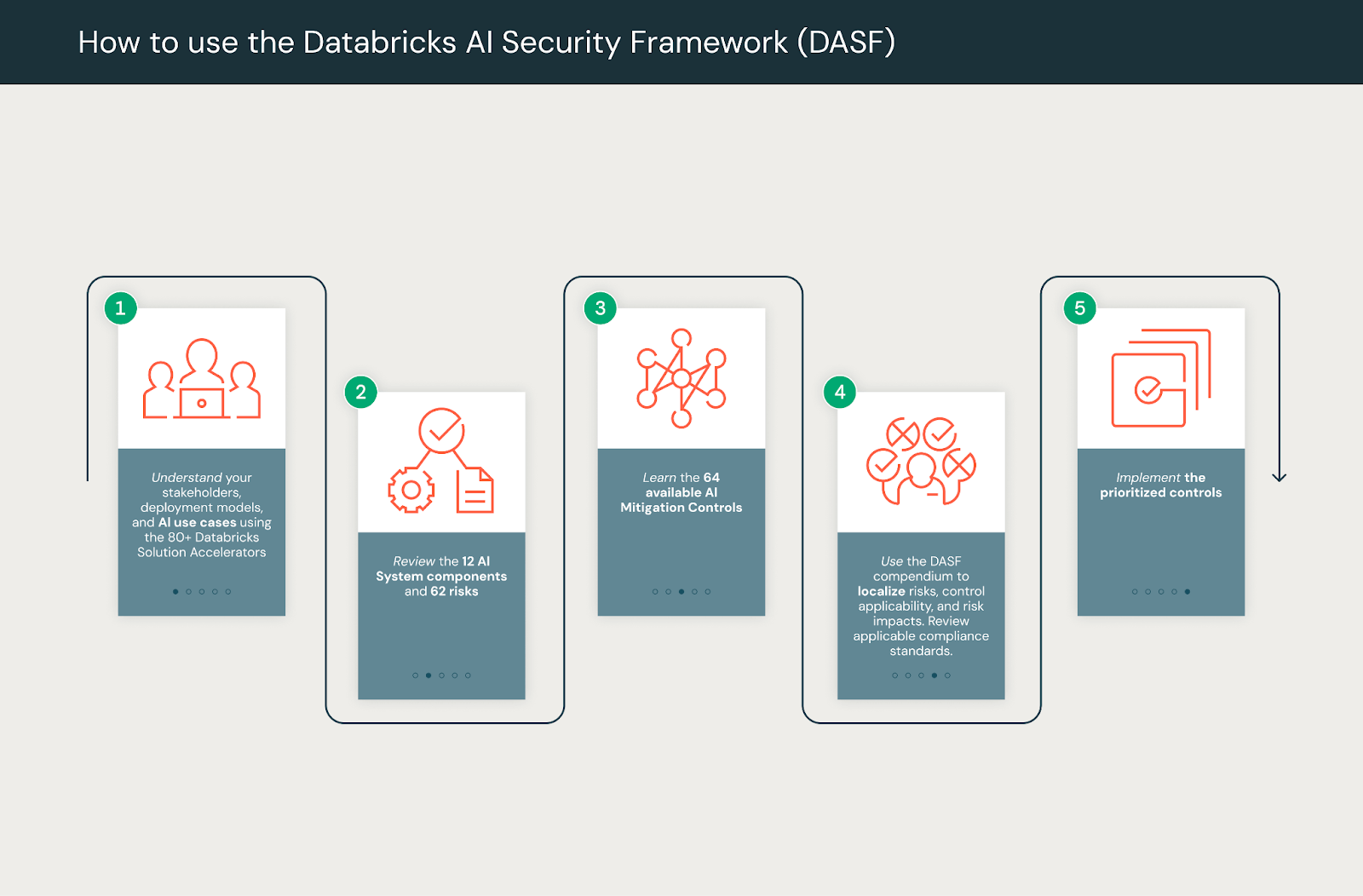

Unser Ziel mit diesen Aktualisierungen ist es, die Übernahme des DASF zu erleichtern und Unternehmen zu befähigen, KI-Systeme sicher und vertrauensvoll zu implementieren. Wenn Sie sich darauf freuen, loszulegen, empfiehlt unser Team den folgenden Ansatz:

- Verstehen Sie Ihre Stakeholder, Bereitstellungsmodelle und KI-Anwendungsfälle: Beginnen Sie mit einem geschäftlichen Anwendungsfall und nutzen Sie das DASF-Whitepaper, um das am besten geeignete KI-Bereitstellungsmodell zu identifizieren. Wählen Sie aus über 80 Databricks Solution Accelerators, um Ihre Reise zu leiten. Zu den Bereitstellungsmodellen gehören Predictive ML Models, Foundation Model APIs, Fine-tuned und Pre-trained LLMs, RAG, AI Agents mit LLMs und externe Modelle. Stellen Sie Klarheit über die KI-Entwicklung in Ihrer Organisation sicher, einschließlich Anwendungsfällen, Datensätzen, Compliance-Anforderungen, Prozessen, Anwendungen und verantwortlichen Stakeholdern.

- Überprüfen Sie die 12 KI-Systemkomponenten und 62 Risiken: Verstehen Sie die 12 KI-Systemkomponenten, die traditionellen Cybersicherheits- und neuartigen KI-Sicherheitsrisiken, die mit jeder Komponente verbunden sind, und die verantwortlichen Stakeholder (z. B. Daten-Ingenieure, Wissenschaftler, Governance-Beauftragte und Sicherheitsteams). Nutzen Sie das DASF, um die Zusammenarbeit zwischen diesen Gruppen während des gesamten KI-Lebenszyklus zu fördern.

- Überprüfen Sie die 64 verfügbaren Minderungssteuerungen: Jedes Risiko ist mit priorisierten Minderungssteuerungen verknüpft, beginnend mit Perimeter- und Datensicherheit. Diese Risiken und Steuerungen sind mit 10 Industriestandards abgeglichen, was zusätzliche Details und Klarheit bietet.

- Verwenden Sie das DASF-Compendium, um Risiken, Kontrollanwendbarkeit und Risikobedeutungen zu lokalisieren: Beginnen Sie mit der Registerkarte „DASF Risk Applicability“, um für Ihren Anwendungsfall relevante Risiken zu identifizieren, indem Sie ein oder mehrere KI-Bereitstellungsmodelle auswählen. Überprüfen Sie anschließend die damit verbundenen Risikobedeutungen, Compliance-Anforderungen und Minderungssteuerungen. Dokumentieren Sie schließlich wichtige Details für Ihren Anwendungsfall, einschließlich der Beschreibung des KI-Anwendungsfalls, der Datensätze, der Stakeholder, der Compliance-Überlegungen und der Anwendungen.

- Implementieren Sie die priorisierten Steuerungen: Verwenden Sie die Registerkarte „DASF Control Applicability“ des Compendiums, um die anwendbaren DASF-Steuerungen zu überprüfen und die Minderungssteuerungen auf Ihrer Datenplattform über 12 KI-Komponenten hinweg zu implementieren. Wenn Sie Databricks verwenden, haben wir Links mit detaillierten Anweisungen zur Bereitstellung jeder Steuerung auf unserer Plattform beigefügt.

Implementieren Sie das DASF in Ihrer Organisation mit neuen KI-Upskilling-Ressourcen von Databricks

Laut einer aktuellen Economist Impact-Studie haben befragte Daten- und KI-Führungskräfte Upskilling und die Förderung einer Growth Mindset als Schlüsselprioritäten für die Steigerung der KI-Adoption im Jahr 2025 identifiziert. Als Teil der DASF 2.0-Einführung bieten wir Ressourcen, die Ihnen helfen, KI- und ML-Konzepte zu verstehen und KI-Sicherheitsbest Practices in Ihrem Unternehmen anzuwenden.

- Databricks Academy Training: Wir empfehlen den neuen Kurs AI Security Fundamentals, der jetzt in der Databricks Academy verfügbar ist. Bevor Sie sich mit dem Whitepaper befassen, ist dieser 1-stündige Kurs eine großartige Einführung in die im DASF hervorgehobenen KI-Sicherheitsthemen. Nach Abschluss erhalten Sie auch eine Akkreditierung für Ihr LinkedIn-Profil. Wenn Sie neu in den KI- und ML-Konzepten sind, beginnen Sie mit unserem Kurs Generative AI Fundamentals.

- Anleitungs-Videos: Wir haben Übersichtsvideos und Anleitungs-Videos zum DASF für schnellen Konsum aufgezeichnet. Sie finden diese Videos auf unserem YouTube-Kanal für Security Best Practices.

- Präsenz- oder virtueller Workshop: Unser Team bietet einen KI-Risiko-Workshop als Live-Durchlauf der im DASF beschriebenen Konzepte an, mit Schwerpunkt auf der Überwindung von Hindernissen bei der Operationalisierung des KI-Risikomanagements. Diese halbtägige Veranstaltung richtet sich an Führungskräfte ab Director-Level in den Bereichen Governance, Daten, Datenschutz, Recht, IT und Sicherheit.

- Bereitstellungsunterstützung: Das Security Analysis Tool (SAT) überwacht kontinuierlich die Einhaltung von Best Practices für die Sicherheit in Databricks-Arbeitsbereichen. Wir haben das SAT kürzlich aktualisiert, um die Einrichtung zu optimieren und die Prüfungen zu verbessern, und es an das DASF angepasst, um die Abdeckung von KI-Sicherheitsrisiken zu verbessern.

- DASF KI-Assistent: Databricks-Kunden können den Databricks AI Security Framework (DASF) KI-Assistent direkt in ihrem eigenen Arbeitsbereich ohne Vorkenntnisse in Databricks konfigurieren, mit DASF-Inhalten in einfacher menschlicher Sprache interagieren und Antworten erhalten.

Aufbau einer Community mit KI-Branchengruppen, Kunden und Partnern

Die Sicherstellung, dass sich das DASF im Einklang mit dem aktuellen KI-Regulierungsumfeld und der sich entwickelnden Bedrohungslandschaft weiterentwickelt, hat oberste Priorität. Seit der Einführung von 1.0 haben wir eine KI-Arbeitsgruppe aus Branchenkollegen, Kunden und Partnern gebildet, um eng mit diesen Entwicklungen Schritt zu halten. Wir möchten unseren Kollegen in der Arbeitsgruppe und unseren Vorprüfern wie Complyleft, The FAIR Institute, Ethriva Inc, Arhasi AI, Carnegie Mellon University und Rakesh Patil von JPMC danken. Die vollständige Liste der Mitwirkenden finden Sie im Danksagungsabschnitt des DASF. Wenn Sie an der DASF AI Working Group teilnehmen möchten, kontaktieren Sie bitte unser Team unter [email protected].

Hier sind einige Stimmen unserer Top-Befürworter:

"KI revolutioniert die Gesundheitsversorgung durch Innovationen wie die CLEVER GenAI-Pipeline, die täglich über 1,5 Millionen klinische Notizen verarbeitet, um wichtige soziale Determinanten zu klassifizieren und die Versorgung von Veteranen zu beeinflussen. Diese Pipeline basiert auf einer starken Sicherheitsgrundlage, integriert NIST 800-53-Kontrollen und nutzt das Databricks AI Security Framework, um die Einhaltung von Vorschriften zu gewährleisten und Risiken zu mindern. Wir prüfen derzeit Möglichkeiten, diese Fähigkeiten durch Infrastructure as Code und sichere Containerisierungsstrategien zu erweitern, um Agenten dynamisch aus Repositories bereitzustellen und zu skalieren und dabei strenge Sicherheitsstandards einzuhalten." - Joseph Raetano, Artificial Intelligence Lead, Summit Data Analytics & AI Platform, U.S. Department of Veteran Affairs

„DASF ist das wesentliche Werkzeug, um die Quantifizierung von KI-Risiken in die operative Realität umzusetzen. Mit dem FAIR-AI Risk-Ansatz, der sich nun im zweiten Jahr befindet, ermöglicht DASF 2.0 CISOs, die Lücke zwischen Cybersicherheit und Geschäftsstrategie zu schließen – und dabei eine gemeinsame Sprache zu sprechen, die auf messbaren finanziellen Auswirkungen basiert.“ - Jacqueline Lebo, Gründerin AI Workgroup, The FAIR Institute und Risk Advisory Manager, Safe Security

„Da KI weiterhin Branchen verändert, ist die Absicherung dieser Systeme gegen hochentwickelte und einzigartige Cyberangriffe wichtiger denn je. Das Databricks AI Security Framework ist ein großer Vorteil für Unternehmen, um sowohl bei Innovation als auch bei der Sicherheit führend zu sein. Mit dem DASF sind Unternehmen besser gerüstet, um KI-Risiken zu verstehen und die Werkzeuge und Ressourcen zu finden, um diese Risiken bei fortlaufender Innovation zu mindern.“ - Ian Swanson, CEO, Protect AI

„Mit dem Databricks AI Security Framework können wir KI-Risiken durchdacht und transparent mindern, was für den Aufbau von Vertrauen bei Vorstand und Mitarbeitern von unschätzbarem Wert ist. Es ist ein Game Changer, der es uns ermöglicht, KI sicher und mit Zuversicht in das Geschäft zu integrieren und zu den 15 % der Organisationen zu gehören, die KI-Workloads sicher und mit Zuversicht in die Produktion bringen.“ — Coastal Community Bank

„Im Kontext von Daten und KI gibt es wenige Gespräche über Sicherheit. Das Databricks AI Security Framework adressiert die oft vernachlässigte Seite von KI- und ML-Arbeiten und dient als erstklassiger Leitfaden, um nicht nur KI-Sicherheitsrisiken zu verstehen, sondern auch wie man sie mindert.“ - Josue A. Bogran, Architect bei Kythera Labs & Berater für SunnyData.ai

„Wir haben das Databricks AI Security Framework genutzt, um die Sicherheitshaltung unserer Organisation bei der Bewältigung von ML- und KI-Sicherheitsrisiken zu verbessern. Mit dem Databricks AI Security Framework sind wir nun zuversichtlicher, Möglichkeiten mit KI und Datenanalysen zu erkunden und gleichzeitig sicherzustellen, dass wir die richtigen Data Governance- und Sicherheitsmaßnahmen implementiert haben.“ - Muhammad Shami, Vice President, Jackson National Life Insurance Company

Laden Sie das Databricks AI Security Framework 2.0 noch heute herunter!

Das Databricks AI Security Framework 2.0 und sein Kompendium (Google Sheet, Excel) stehen jetzt zum Download bereit. Um mehr über bevorstehende KI-Risiko-Workshops zu erfahren oder einen dedizierten Workshop vor Ort oder virtuell für Ihre Organisation anzufordern, kontaktieren Sie uns unter [email protected] oder Ihr Account-Team. Wir haben auch weitere Thought-Leadership-Inhalte in Kürze verfügbar, um weitere Einblicke in die Verwaltung von KI-Governance zu geben. Für weitere Einblicke, wie KI-Sicherheitsrisiken verwaltet werden können, besuchen Sie das Databricks Security and Trust Center.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.