Vorstellung des Databricks AI Security Framework (DASF)

Ein umsetzbarer Rahmen für die Verwaltung der KI-Sicherheit

von Omar Khawaja, Arun Pamulapati, Kelly Albano und Erika Ehrli

Wir freuen uns, die Veröffentlichung des Whitepapers Databricks AI Security Framework (DASF) Version 1.0 bekannt zu geben! Das Framework wurde entwickelt, um die Zusammenarbeit zwischen Geschäfts-, IT-, Daten-, KI- und Sicherheitsgruppen zu verbessern. Es vereinfacht KI- und ML-Konzepte, indem es die Wissensbasis von KI-Sicherheitsrisiken basierend auf realen Angriffsbeobachtungen katalogisiert, einen Defense-in-Depth-Ansatz für die KI-Sicherheit bietet und praktische Ratschläge für die sofortige Anwendung gibt.

Machine Learning (ML) und generative KI (GenAI) verändern die Zukunft der Arbeit, indem sie Innovation, Wettbewerbsfähigkeit und Mitarbeiterproduktivität steigern. Organisationen stehen jedoch vor der doppelten Herausforderung, künstliche Intelligenz (KI)-Technologien für Chancen zu nutzen und gleichzeitig potenzielle Sicherheits- und Datenschutzrisiken wie Datenpannen und Nichteinhaltung von Vorschriften zu managen.

Dieser Blog gibt einen Überblick über das DASF, wie Sie es zur Sicherung der KI-Initiativen Ihrer Organisation nutzen können, teilt ein Update zu unserer externen Dynamik und leitet sicher die Einführung von KI in Ihrer Organisation an.

Grundlagen des Databricks AI Security Framework aufbauen

KI beeinflusst jede Branche und verändert die Art und Weise, wie wir arbeiten. Mehr denn je wollen Führungskräfte Daten und KI nutzen, um ihre Organisationen zu transformieren. KI-Sicherheit und Governance sind entscheidend für den Aufbau von Vertrauen in die KI-Ziele Ihrer Organisation. Laut Gartner ist das Management von KI-Vertrauen, -Risiken und -Sicherheit der Top-Trend Nr. 1 im Jahr 2024, der Geschäfts- und Technologieentscheidungen beeinflusst, und bis 2026 werden KI-Modelle von Organisationen, die KI-Transparenz, -Vertrauen und -Sicherheit operationalisieren, eine Steigerung der Akzeptanz, der Geschäftsziele und der Benutzerakzeptanz um 50 % erzielen.

Anfang dieses Jahres kündigten wir die Übernahme von MosaicML durch Databricks an und teilten mehr über unser Engagement für Responsible AI mit. In den letzten Monaten haben wir unser Engagement und unsere Dynamik als Branchenführer im Bereich KI durch neue Partnerschaften weiter vorangetrieben. Um diese Investitionen zu ergänzen, veranstaltet das Databricks Security Team jetzt KI-Sicherheitsworkshops für CISOs, um Organisationen zu schulen, wie sie ihre KI-Reise risikobewusst erfolgreich gestalten können. Wir haben von unseren Kunden gelernt, dass Sicherheits- und Governance-Teams Schwierigkeiten haben, zuverlässiges Material zu finden, das erklärt, was KI ist, wie sie funktioniert und welche Sicherheitsrisiken bei der Einführung dieser Technologien entstehen können.

Wir haben diese Erkenntnisse genutzt, um das DASF-Framework zu entwickeln, das Geschäfts-, IT-, Daten-, KI- und Sicherheitsteams bei der Bereitstellung von KI unter den folgenden Prinzipien besser zusammenarbeiten lässt:

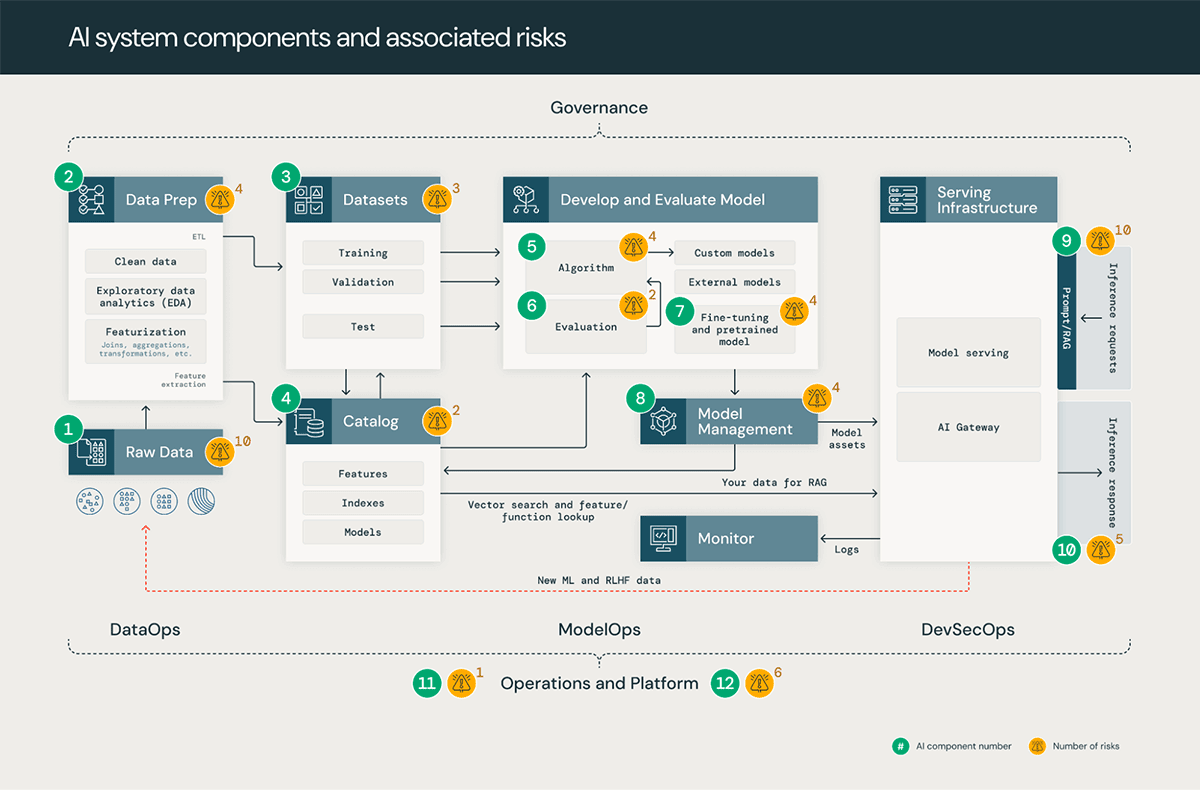

- KI und ML entmystifizieren: Das DASF zerlegt die 12 Komponenten eines KI-Systems, die Arten von KI-Modellen und wie sie zusammenarbeiten. Dies hilft den Teams, durch die Definition einer gemeinsamen Nomenklatur der beteiligten KI-Systeme, Prozesse und Personas besser zusammenzuarbeiten.

- Einen Defense-in-Depth-Ansatz zur Sicherung von KI bieten: In unseren Gesprächen mit Sicherheitsverantwortlichen besteht Bedarf an Klarheit darüber, ob KI-Sicherheit ein Cybersicherheitsproblem, ein Problem des adversarial machine learning oder etwas völlig Neues ist. Die Realität ist, dass es all das ist. Das DASF bietet einen Rahmen, um die 55 Sicherheitsrisiken über die drei Phasen jedes KI-Systems basierend auf Ihren spezifischen KI-Anwendungsfällen und Bereitstellungsmodellen zu verstehen. Wir ordnen die Risiken auch gängigen KI-Sicherheitsframeworks wie MITRE ATLAS, OWASP Top 10 für LLMs und der NIST AML Taxonomy zu.

- Umsetzbare Empfehlungen liefern: Viele bestehende Frameworks tun sich hervor, die Risiken im Zusammenhang mit KI darzulegen, aber sie legen nicht klar die notwendigen Kontrollen zur Minderung dieser Risiken dar. Das DASF empfiehlt 53 Kontrollen, die für jede von Ihnen verwendete Daten- und KI-Plattform anwendbar sind. Wenn Sie ein Databricks-Kunde sind, gehen wir noch einen Schritt weiter: Wir haben Links zur Databricks-Dokumentation (nach Cloud) aufgenommen, um spezifische Anweisungen zur Implementierung jeder Abhilfekontrolle zu geben!

Erste Schritte mit dem Databricks AI Security Framework

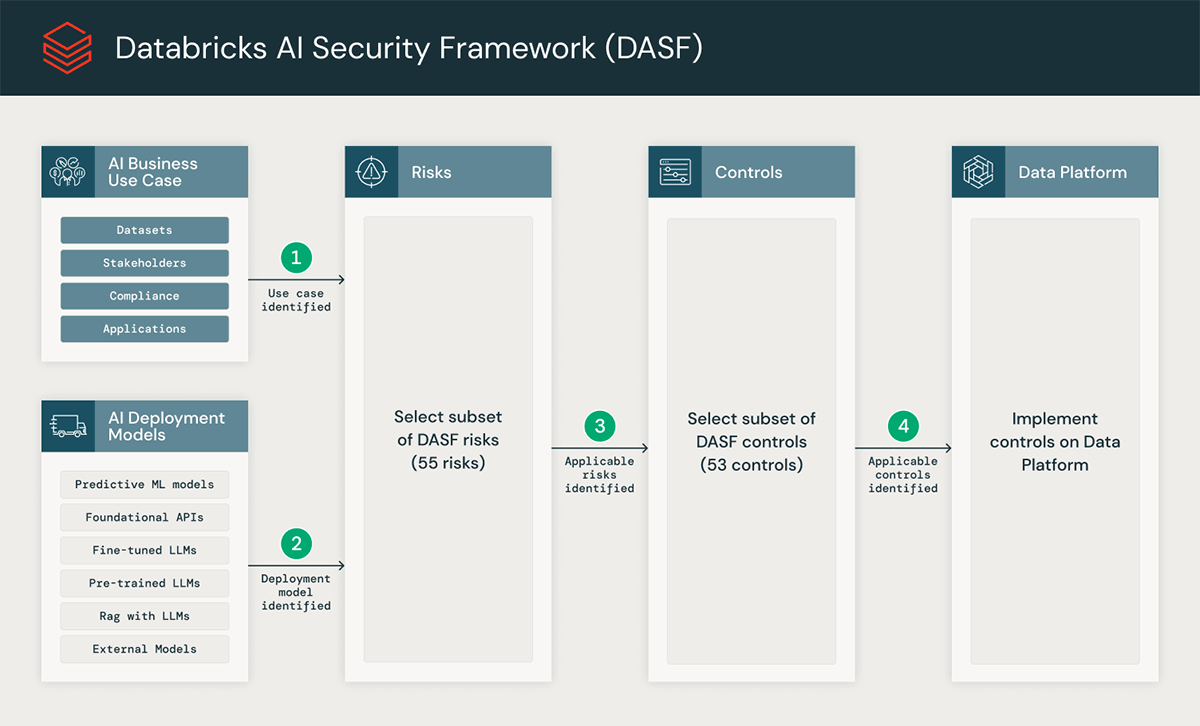

Das DASF wurde so konzipiert, dass Sie, unabhängig von der von Ihnen verwendeten Daten- und KI-Plattform, ein End-to-End-Risikoprofil für die KI-Bereitstellungsanforderungen Ihrer Organisation mit einem konkreten Satz von Kontrollen erhalten, die Sie implementieren sollten. Um mit dem DASF zu beginnen, empfehlen wir den folgenden Ansatz, wie in der Abbildung unten dargestellt:

Schritt 1 - Identifizieren Sie den KI-Geschäftsanwendungsfall: Arbeiten Sie mit Ihren Stakeholdern zusammen, egal ob bereits implementiert oder in der Planungsphase, an den KI-Anwendungsfällen Ihrer Organisation. Wir empfehlen die Nutzung von Databricks Solution Accelerators, die speziell entwickelte Anleitungen sind, um Ergebnisse für Ihre häufigsten und wirkungsvollsten KI- und ML-Anwendungsfälle zu beschleunigen. Überprüfen Sie, welche Datensätze verwendet werden, welche Compliance-Anforderungen gelten könnten und welche Anwendungen diese KI-Systeme beeinflussen, um die erforderlichen Basisfunktionen Ihrer Daten- und KI-Plattform zu ermitteln.

Schritt 2 - Bestimmen Sie das KI-Bereitstellungsmodell: Wählen Sie ein geeignetes Bereitstellungsmodell wie prädiktive ML-Modelle, RAG-LLMs, feinabgestimmte LLMs, vortrainierte LLMs, Foundation Models und externe Modelle. Jedes Bereitstellungsmodell hat eine unterschiedliche Aufteilung der gemeinsamen Verantwortung über die 12 KI-Systemkomponenten und zwischen Ihrer Organisation, Ihrer Daten- und KI-Plattform und allen beteiligten Partnern.

Schritt 3 - Wählen Sie die relevantesten Risiken aus: Identifizieren Sie aus unserer dokumentierten Liste von 55 Sicherheitsrisiken die relevantesten für Ihre Organisation, basierend auf dem Anwendungsfall und dem Bereitstellungsmodell, das Ihre Organisation implementiert. Für die meisten Anwendungsfälle muss nur ein kleiner Teil der 55 Risiken angegangen werden.

Schritt 4 - Wählen und implementieren Sie Kontrollen: Wählen Sie Kontrollen aus, die mit der Risikobereitschaft Ihrer Organisation übereinstimmen. Diese Kontrollen sind generisch definiert, um mit jeder Daten- und KI-Plattform kompatibel zu sein. Unser Framework bietet auch Anleitungen zur spezifischen Anpassung dieser Kontrollen für die Databricks Data Intelligence Platform mit spezifischen Databricks-Implementierungsanleitungen pro Cloud. Sie verwenden diese Kontrollen neben den Richtlinien Ihrer Organisation und haben die richtige Zusicherung.

Wenn Ihnen das immer noch viel erscheint, werden wir weiterhin unsere KI-Sicherheitsworkshops für diejenigen veranstalten, die eine interaktive Erfahrung wünschen.

Förderung der KI-Sicherheit durch Branchenverbündete, Partner und Kunden

In der Sicherheitsbranche ist die Förderung der Zusammenarbeit zwischen Kollegen unerlässlich, um kollektive Sicherheit und Erfolg zu gewährleisten. Wir könnten heute kein Dokument wie das DASF veröffentlichen, ohne die Standards, Frameworks und Tools von Drittanbietern, die uns vorausgehen, wie die Guidelines for Secure AI System Development, das NIST AI Risk Management Framework und das Multilayer Framework for Good Cybersecurity Practices for AI. Viele weitere sind im DASF referenziert und können im Abschnitt Ressourcen eingesehen werden.

Während wir unzählige interne Überprüfungen mit unseren KI-, ML- und Sicherheitsexperten bei Databricks durchgeführt haben, haben wir uns auch mit 15 Branchenführern im Bereich KI-Sicherheit getroffen, darunter Vertreter von HITRUST, der Carnegie Mellon University, Capital One, Protect AI und Barracuda (und weitere unten zitiert!). Wir danken ihnen für ihre Zeit, ihre Einblicke und ihr Feedback, wie wir das DASF für unsere Kollegen am praktischsten gestalten können. Eine vollständige Liste der Gutachter finden Sie in unserem Danksagungsabschnitt des DASF.

"Wenn ich darüber nachdenke, was einen guten Beschleuniger ausmacht, geht es darum, Dinge reibungsloser und effizienter zu gestalten und Innovationen zu fördern. Das DASF ist ein bewährtes und effektives Werkzeug für Sicherheitsteams, um ihren Partnern zu helfen, das Beste aus KI herauszuholen. Außerdem stimmt es mit etablierten Risikorahmen wie NIST überein, sodass es nicht nur die Dinge beschleunigt – es schafft eine solide Grundlage für Sicherheitsarbeit." — Riyaz Poonawala, Vice President of Information Security, Navy Federal Credit Union

"Unternehmen müssen keine Abstriche bei der Sicherheit für KI-Innovationen machen. Das Databricks AI Security Framework ist ein umfassendes Werkzeug, um die KI-Einführung sicher zu ermöglichen. Es ordnet KI-Sicherheitsbedenken nicht nur der KI-Entwicklungspipeline zu, sondern macht sie für Databricks-Kunden mit praktischen Kontrollen umsetzbar. Wir freuen uns, zur Entwicklung dieser wertvollen Community-Ressource beigetragen zu haben." — Hyrum Anderson, CTO, Robust Intelligence

"Das DASF ist ein großartiges Beispiel für die Führungsrolle von Databricks im Bereich KI und ein wertvoller Beitrag zur Branche zu einer kritischen Zeit. Wir wissen, dass das größte Risiko, das mit künstlicher Intelligenz in absehbarer Zukunft verbunden ist, böswillige Akteure sind, und dieses Framework bietet ein wirksames Gegengewicht zu diesen Cyberkriminellen. Das DASF ist eine pragmatische, operative und effiziente Methode, um Ihre Organisation zu sichern." — Chris "Tito" Sestito, CEO und Mitbegründer von HiddenLayer

Machen Sie den ersten Schritt zur Erweiterung einer starken KI-Sicherheitsgrundlage – laden Sie das Databricks AI Security Framework herunter und treten Sie mit unserem Team in Kontakt

Das Whitepaper zum Databricks AI Security Framework ist im Databricks Security and Trust Center zum Download verfügbar. Wir haben uns bemüht, die Genauigkeit sicherzustellen, und unser Team freut sich auf Ihr Feedback. Wenn Sie Feedback oder Fragen haben, erreichen Sie uns per E-Mail unter dasf@databricks.com. Über diesen Alias können Sie auch weitere Informationen anfordern, um an einem bevorstehenden KI-Sicherheitsworkshop teilzunehmen oder einen speziellen Workshop für Ihre Organisation zu planen. Auf unserer neuen KI-Sicherheitsseite finden Sie detaillierte Ressourcen zu KI- und ML-Sicherheit.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.