Sicherheits- und Vertrauenscenter

Ihre Datensicherheit ist unsere Priorität

KI-Sicherheit

Best Practices zur Minderung der mit KI-Modellen verbundenen Risiken

Unter KI-Sicherheit versteht man die Praktiken, Maßnahmen und Strategien, die zum Schutz von Systemen, Modellen und Daten der künstlichen Intelligenz vor unbefugtem Zugriff, Manipulation oder böswilligen Aktivitäten umgesetzt werden. Unternehmen müssen robuste Sicherheitsprotokolle, Verschlüsselungsmethoden, Zugriffskontrollen und Monitoring-Mechanismen implementieren, um KI-Assets zu schützen und die mit ihrer Nutzung verbundenen potenziellen Risiken zu mindern.

In enger Zusammenarbeit mit unseren Kunden sorgt unser Databricks-Sicherheitsteam dafür, dass KI und maschinelles Lernen sicher und mit allen Funktionen, die den Architekturanforderungen der Kunden entsprechen, auf Databricks implementiert werden. Wir arbeiten auch intern bei Databricks und in der größeren ML- und GenAI-Community mit Dutzenden von Experten zusammen, um Sicherheitsrisiken für KI-Systeme zu identifizieren und die zur Minderung dieser Risiken erforderlichen Kontrollen zu definieren.

KI-Systeme verstehen

Aus welchen Komponenten besteht ein KI-System und wie arbeiten sie zusammen?

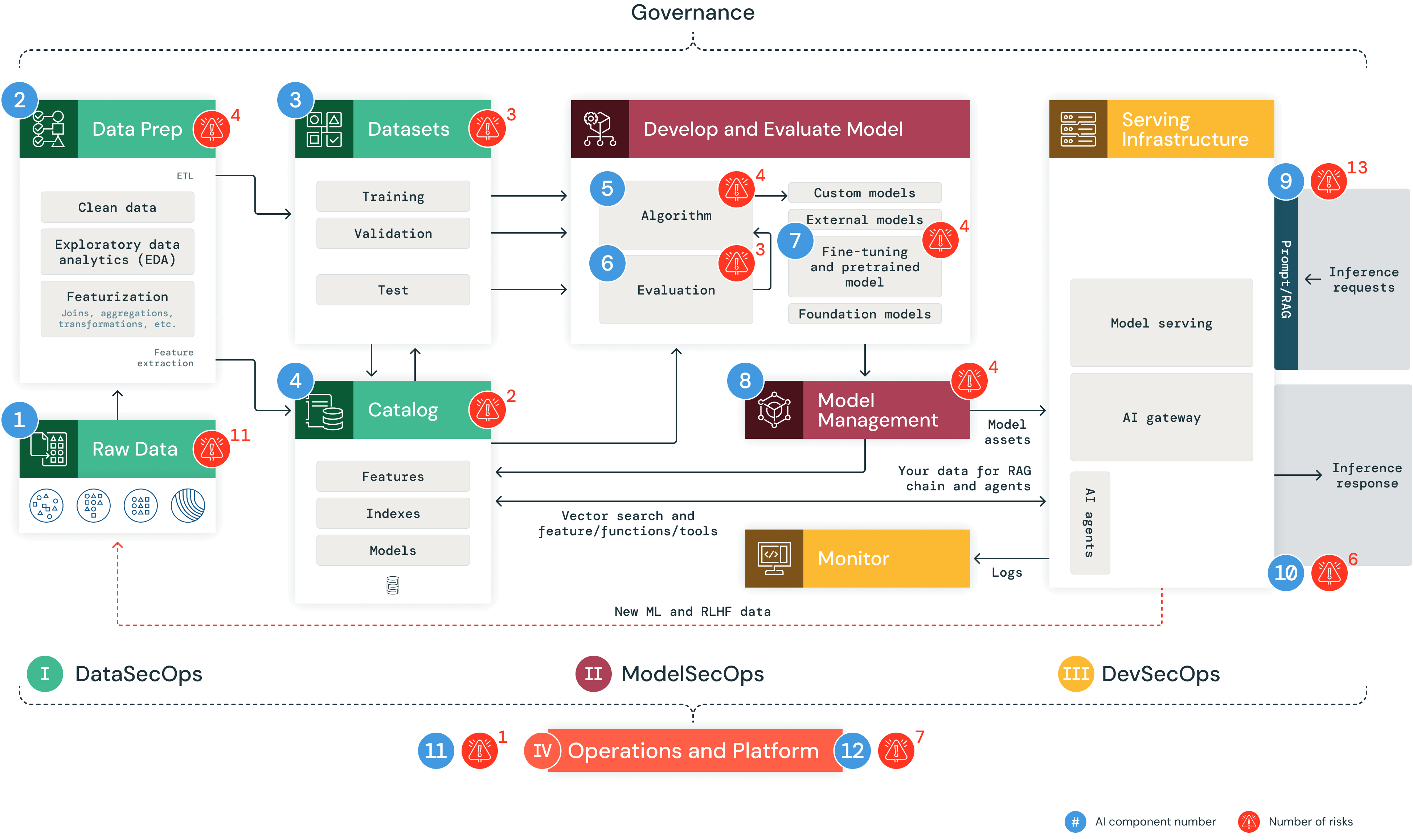

KI-Systeme bestehen aus Daten, Code und Modellen. Ein typisches End-to-End-KI-System hat 12 grundlegende Architekturkomponenten, die grob in vier Hauptphasen eingeteilt werden:

- Datenvorgänge umfassen die Aufnahme und Transformation von Daten sowie die Gewährleistung von Datensicherheit und Governance. Gute ML-Modelle sind von zuverlässigen Datenpipelines und einer sicheren Infrastruktur abhängig.

- Modellbetrieb umfasst das Erstellen benutzerdefinierter Modelle, den Erwerb von Modellen von einem Modellmarktplatz oder die Verwendung von Software-as-a-Service (SaaS) Large Language Models (LLMs) wie OpenAI. Die Entwicklung eines Modells erfordert eine Reihe von Experimenten und eine Möglichkeit, die Bedingungen und Ergebnisse dieser Experimente zu verfolgen und zu vergleichen.

- Modellimplementierung und -bereitstellung besteht aus der sicheren Erstellung von Modell-Images, der Isolierung und sicheren Bereitstellung von Modellen, der automatisierten Skalierung, der Ratenbegrenzung und dem Monitoring von bereitgestellten Modellen.

- Betrieb und Plattform umfassen das Schwachstellenmanagement und Patching der Plattform, die Modellisolierung und Kontrollen für das System sowie den autorisierten Zugriff auf Modelle mit Sicherheit in der Architektur. Dazu gehören auch betriebliche Tools für CI/CD. Dadurch wird sichergestellt, dass der gesamte Lebenszyklus die erforderlichen Standards erfüllt, indem die verschiedenen Ausführungsumgebungen – Entwicklung, Staging und Produktion – für MLOps sicher gehalten werden.

Die nachstehende Abbildung zeigt die 12 Komponenten und wie sie in einem KI-System interagieren.

KI-Sicherheitsrisiken verstehen

Welche Sicherheitsbedrohungen können bei der Einführung von KI auftreten?

In unserer Analyse von KI-Systemen haben wir 62 technische Sicherheitsrisiken in den 12 grundlegenden Architekturkomponenten identifiziert. In der nachstehenden Tabelle skizzieren wir diese grundlegenden Komponenten, die den Schritten in jedem KI-System entsprechen, und heben einige Beispiele für Sicherheitsrisiken hervor. Die vollständige Liste der 62 technischen Sicherheitsrisiken finden Sie im Databricks AI Security Framework.

Phase des KI-Systems | KI-Systemkomponenten | Potenzielle Sicherheitsrisiken |

|---|---|---|

Datenvorgänge | 1. Rohdaten 2. Datenvorbereitung 3. Datasets 4. Katalog und Governance | 20 spezifische Risiken wie:

|

Modellbetrieb | 5. ML-Algorithmus 6. Evaluierung 7. Modellerstellung 8. Modellmanagement | 15 spezifische Risiken wie:

|

Modellimplementierung und -bereitstellung | 9. Model Serving – Inferenzanfragen 10. Model Serving – Inferenzantworten | 19 spezifische Risiken wie:

|

Betrieb und Plattform | 11. ML-Betrieb 12. ML-Plattform | 8 spezifische Risiken wie:

|

Welche Kontrollen gibt es, um KI-Sicherheitsrisiken zu mindern?

Es gibt 64 präskriptive Kontrollen zur Minderung der identifizierten 62 KI-Sicherheitsrisiken. Zu diesen Kontrollen gehören:

- Best Practices für Cybersicherheit wie Single Sign-On, Verschlüsselungstechniken, Kontrollen für Bibliotheken und Quellcode sowie Netzwerkzugriffskontrollen mit einem Defense-in-Depth-Ansatz zum Risikomanagement

- Spezifische Kontrollen für die Daten- und KI-Governance wie Datenklassifizierung, Data Lineage, Datenversionierung, Modellverfolgung, Berechtigungen für Daten- und Modell-Assets sowie Modell-Governance

- KI-spezifische Kontrollen wie die Isolierung der Modellbereitstellung, Prompt-Tools, Überprüfung und Monitoring von Modellen, MLOps und LLMOps, zentrales LLM-Management, Feinabstimmung und Vortraining Ihrer Modelle

Wenn Sie an einem detaillierten Überblick über die mit KI-Systemen verbundenen Sicherheitsrisiken und die für jedes Risiko zu implementierenden Kontrollen interessiert sind, laden wir Sie ein, unser Databricks AI Security Whitepaper herunterzuladen.

Best Practices zur Absicherung von KI- und ML-Modellen

Daten- und Sicherheitsteams müssen aktiv zusammenarbeiten, um ihr Ziel, die Sicherheit von KI-Systemen zu verbessern, zu verfolgen. Unabhängig davon, ob Sie herkömmliche Machine-Learning-Lösungen oder LLM-gesteuerte Anwendungen implementieren, empfiehlt Databricks die folgenden Schritte, wie im Databricks AI Security Whitepaper beschrieben.

FAQs

Ressourcen zur KI-Sicherheit

Databricks AI Security Framework (DASF)

Das Databricks-Sicherheitsteam hat das Databricks AI Security Framework (DASF) entwickelt, um auf sich entwickelnde Schwachstellen in KI-Systemen mit einem ganzheitlichen Ansatz zur Risikominderung über die Modellsicherheit hinaus zu reagieren.

Databricks AI Risk Workshop

Das Databricks-Sicherheitsteam veranstaltet KI-Risiko-Workshops, um Führungskräften zu helfen, KI-Systeme, deren Risiken und Eindämmungsstrategien zu verstehen.

Grundlagentraining zur KI-Sicherheit

Dieser Kurs behandelt in fünf umfassenden Modulen die Grundlagen der Sicherheit in KI-Systemen auf der Databricks Data Intelligence Platform.

Veranstaltungen und Webinare zur KI-Sicherheit

Die Sicherheitsverantwortlichen von Databricks tauschen auf Veranstaltungen regelmäßig ihr Fachwissen mit Branchenführern, Unternehmen, Behörden und Anbietern aus.