SQL Server-zu-Databricks-Migration meistern: Tipps für einen reibungslosen Übergang

Strategien, Werkzeuge und Best Practices für den Übergang zur Lakehouse-Architektur

von Ina Felsheim und Nikhil Gupta

- Entdecken Sie, wie Sie komplexe T-SQL-Logik mit 90%iger Automatisierung in verteiltes Spark SQL umwandeln.

- Implementieren Sie Zero-Downtime-Migrationen mithilfe von CDC-Replikation und parallelen Validierungs-Frameworks.

- Optimieren Sie Legacy-SSIS-Pakete für die Verarbeitung im Petabyte-Maßstab in Databricks Workflows.

Der Imperativ zur Modernisierung

Herkömmliche Datenbanklösungen wie SQL Server haben Schwierigkeiten, mit den Anforderungen moderner Daten-Workloads Schritt zu halten, da ihnen die Unterstützung für KI/ML, Streaming-Funktionen und hohe Kosten fehlen. Unternehmen setzen zunehmend auf Cloud-native Lösungen wie Databricks, um Flexibilität, Skalierbarkeit und Kosteneffizienz zu erzielen und gleichzeitig fortschrittliche Analyseanwendungsfälle zu ermöglichen.

Hauptvorteile von Databricks gegenüber SQL Server

- Einheitliche Plattform: Kombiniert die Verarbeitung strukturierter und unstrukturierter Daten mit KI/ML-Funktionen. Darüber hinaus bietet Unity Catalog eine umfassende Daten-Governance für alle Datenbestände.

- Skalierbarkeit: Databricks kann über seine Cloud-native Infrastruktur Ressourcen elastisch entsprechend den Workload-Anforderungen skalieren. Diese Architektur ermöglicht die Verarbeitung großer, komplexer Workloads mit verbesserter Abfrageleistung und reduzierter Latenz.

- Kosteneffizienz: Pay-as-you-go Cloud-Preismodelle reduzieren die Kosten für Infrastruktur-Hardware. Geringere Verwaltungskosten und eine verbesserte Ressourcenauslastung reduzieren auch die Gesamtbetriebskosten (TCO) erheblich.

- Erweiterte Analysen: Databricks bietet integrierte Funktionen für erweiterte Analyseanwendungsfälle wie KI/ML, GenAI und Echtzeit-Streaming. Mit Databricks SQL können Benutzer ihre bevorzugten BI-Tools integrieren und so komplexe Analysen effizienter durchführen.

Architektonischer Deep Dive

Die Migration von SQL Server zu Databricks erfordert ein Umdenken Ihrer Datenarchitektur, um die Stärken des Lakehouse-Modells zu nutzen. Das Verständnis der Hauptunterschiede zwischen den beiden Plattformen ist entscheidend für die Entwicklung einer effektiven Migrationsstrategie. Hauptunterschiede zwischen SQL Server und Databricks:

|

Funktion |

SQL Server |

Databricks |

|---|---|---|

|

Architektur |

Monolithisches RDBMS |

Offenes Lakehouse |

|

Skalierbarkeit |

Vertikale Skalierung |

Horizontale Skalierung über Cluster |

|

KI/ML-Unterstützung |

Minimal |

Integrierte Unterstützung für KI/ML |

|

Echtzeit-Streaming |

Begrenzt |

Vollständig unterstützt |

Enterprise-Datenmigration

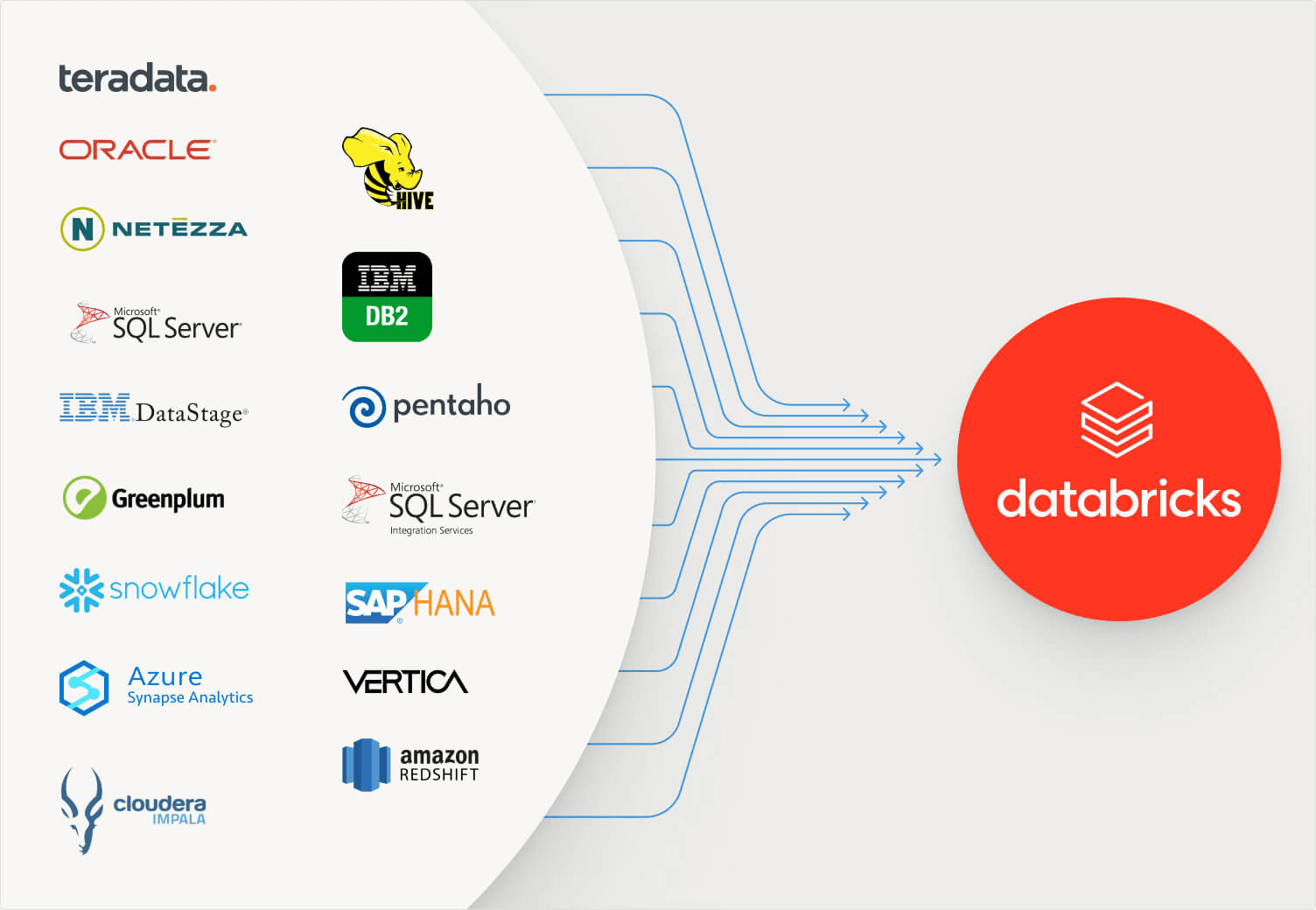

Die Migration von Daten von lokalen SQL Servern zu cloudbasierten Databricks erfordert die Auswahl der richtigen Tools und Strategien basierend auf der Größe und Komplexität des Workloads.

Empfohlene Ansätze für die Datenmigration:

- Databricks Lakeflow Connect: Lakeflow Connect bietet einen vollständig verwalteten SQL Server-Konnektor für die nahtlose Datenaufnahme von SQL Server in das Databricks Lakehouse. Weitere Informationen finden Sie unter Daten von SQL Server aufnehmen.

- Nutzung von Databricks Lakehouse Federation: Databricks Lakehouse Federation ermöglicht föderierte Abfragen über verschiedene Datenquellen, einschließlich SQL Server.

- ISV-Partner: Databricks ISV-Partner wie Qlik und Fivetran können Daten von SQL Server in die Databricks Delta-Tabelle replizieren.

Code-Migration

Die Migration von T-SQL zu Databricks SQL erfordert die Refaktorierung von SQL-Skripten, gespeicherten Prozeduren und ETL-Workflows in Databricks-kompatible Formate und die Optimierung der Leistung. Databricks verfügt über ausgereifte Code-Konverter und Migrationstools, um diesen Prozess reibungsloser und hochgradig automatisiert zu gestalten.

Der Databricks Code Converter (erworben von BladeBridge) kann die Logik automatisch in Databricks SQL- oder PySpark-Notebooks konvertieren. Das BladeBridge-Konvertierungstool unterstützt die Schema-Konvertierung (Tabellen und Ansichten) und SQL-Abfragen (SELECT-Anweisungen, Ausdrücke, Funktionen, benutzerdefinierte Funktionen usw.). Darüber hinaus können gespeicherte Prozeduren in modulare Databricks Workflows, SQL Scripting oder DLT Pipelines konvertiert werden.

Modernisierung von ETL-Workflows

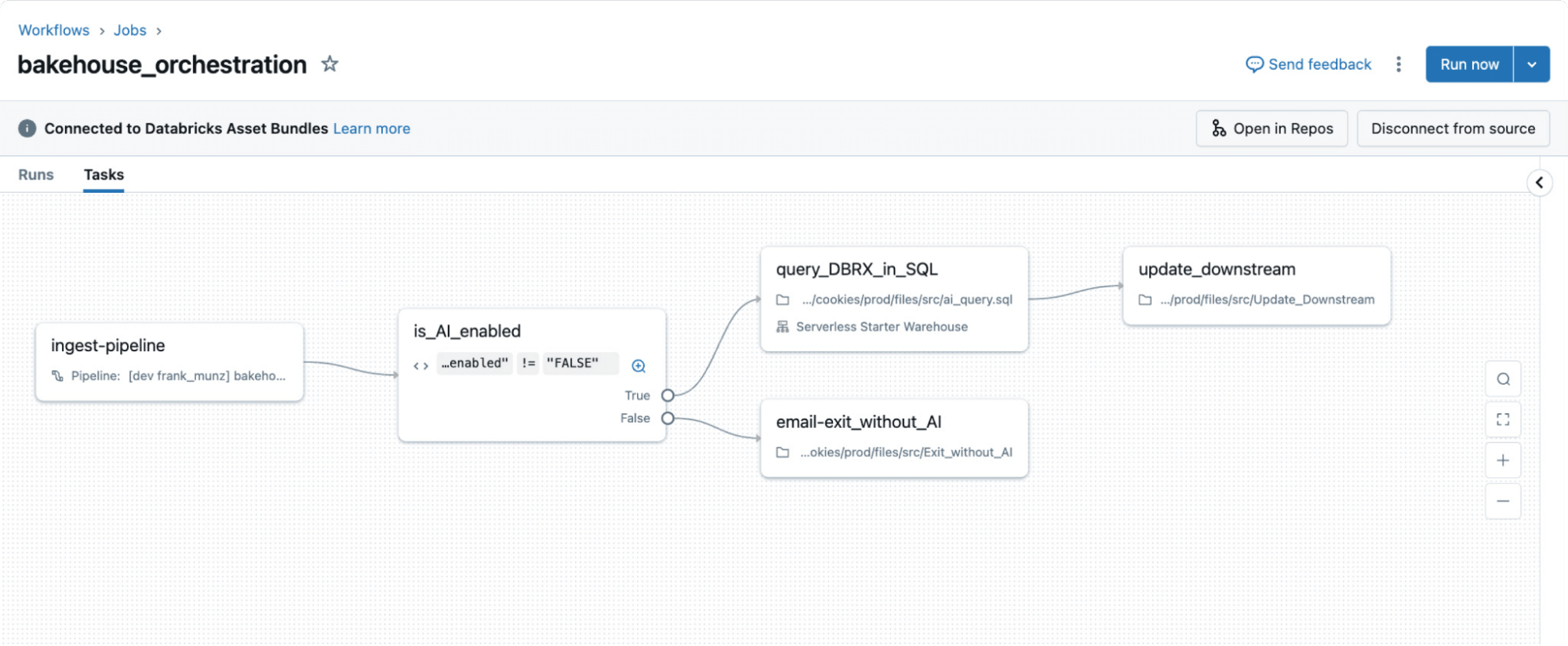

Databricks bietet mehrere Optionen zur Modernisierung von ETL-Pipelines und vereinfacht komplexe Workflows, die traditionell von SSIS oder SQL Agent verwaltet werden.

Optionen für die ETL-Orchestrierung auf Databricks:

- Databricks Workflows: Natives Orchestrierungstool, das Python-Skripte, Notebooks, dbt-Transformationen usw. unterstützt.

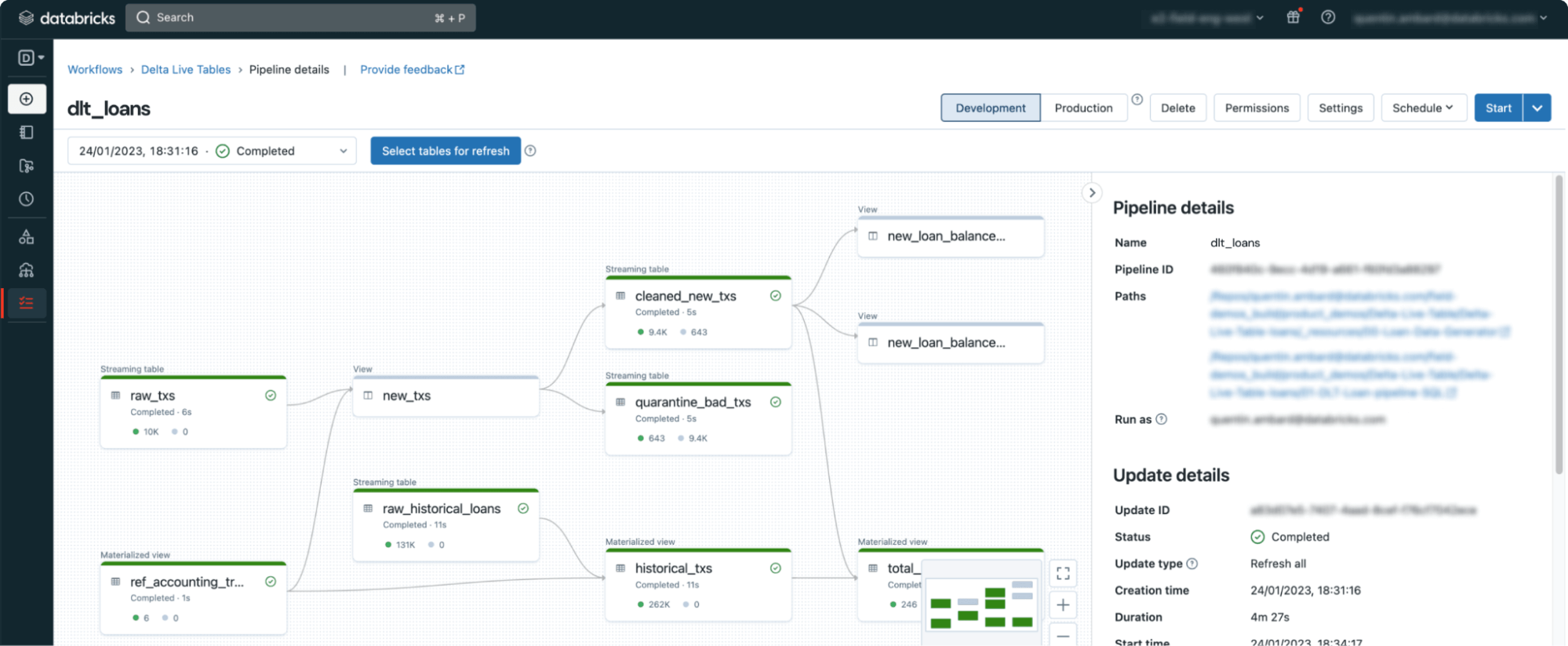

- DLT (DLT): Deklarative Pipelines mit integrierten Datenqualitätsprüfungen.

Integration von BI- und Analysetools

Databricks SQL ermöglicht es Unternehmen, ihre Data-Warehousing-Anforderungen zu erfüllen und nachgelagerte Anwendungen sowie BI-Dashboards zu unterstützen. Das Umstellen von BI-Tools wie Power BI oder Tableau ist nach der Migration von Datenpipelines entscheidend, um die Geschäftskontinuität sicherzustellen.

Microsoft Power BI, eine häufig eingesetzte nachgelagerte Anwendung in verschiedenen Kundenumgebungen, läuft typischerweise auf der Serving-Schicht von SQL Server.

Best Practices für die Power BI-Integration

- Verwenden Sie den DirectQuery-Modus für Echtzeitanalysen auf Delta-Tabellen. DirectQuery ist 2- bis 5-mal schneller mit Databricks im Vergleich zu SQL Server.

- Nutzen Sie materialisierte Sichten in Databricks SQL Warehouse für schnellere Dashboards durch Aggregationen.

- Verwenden Sie SQL Serverless Warehouse für die beste Leistung bei Workloads mit hoher Nebenläufigkeit und geringer Latenz.

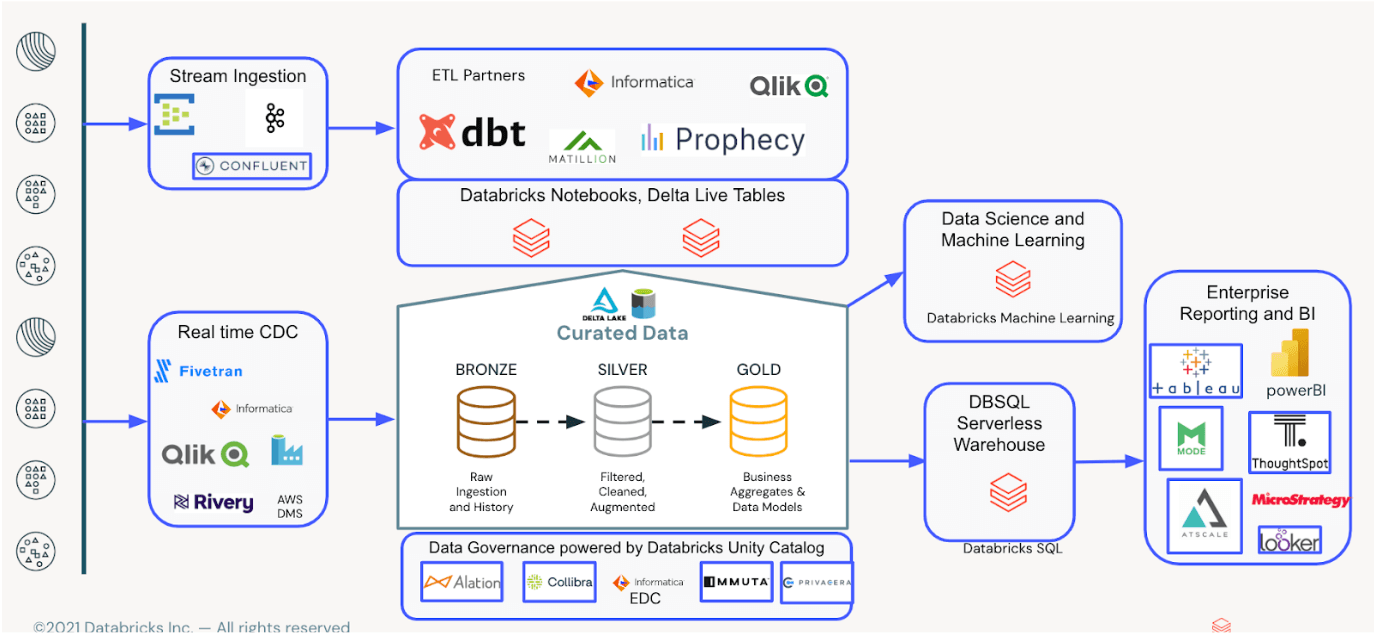

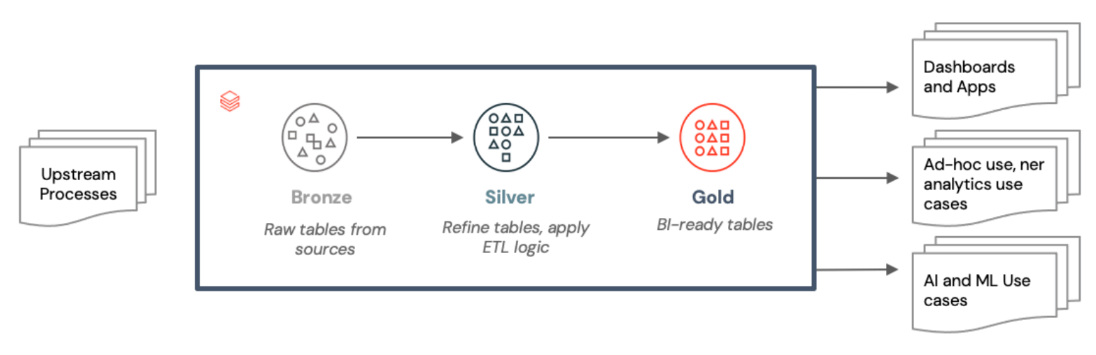

Im Folgenden sehen Sie eine zukünftige Architektur, die sich gut für die Optimierung von BI-Modellen und semantischen Schichten eignet, um sie an die Geschäftsanforderungen anzupassen. Sie umfasst eine Bronze-, Silber- und Goldschicht zur Versorgung von Dashboards, Anwendungen sowie KI- und ML-Anwendungsfällen.

Validierungs-Framework

Die Validierung stellt sicher, dass migrierte Datensätze über Plattformen hinweg korrekt und konsistent bleiben. Empfohlene Validierungsschritte:

- Führen Sie Schemavergleiche zwischen der Quelle (Netezza) und dem Ziel (Databricks) durch.

- Vergleichen Sie Zeilenzahlen und aggregierte Werte mithilfe automatisierter Tools wie Remorph Reconcile oder DataCompy.

- Führen Sie während einer Übergangsphase parallele Pipelines aus, um die Abfrageergebnisse zu überprüfen.

Wissenstransfer und organisatorische Bereitschaft

Die Weiterbildung von Teams in Databricks-Konzepten, Delta Lake-Architektur, Databricks SQL und Leistungsoptimierung ist entscheidend für den langfristigen Erfolg. Schulungsempfehlungen:

- Schulen Sie Analysten in den Funktionen von Databricks SQL Warehouse.

- Bieten Sie praktische Labs für Ingenieure an, die von SSIS zu DLT-Pipelines wechseln.

- Dokumentieren Sie Migrationsmuster und Playbooks zur Fehlerbehebung.

Vorhersehbare, risikoarme Migrationen

Die Migration von SQL Server zu Databricks stellt nicht nur einen technologischen, sondern auch einen grundlegenden Wandel in der Herangehensweise an Datenmanagement und -analyse dar. Durch sorgfältige Planung, Berücksichtigung der wesentlichen Unterschiede zwischen den Plattformen und Nutzung der einzigartigen Fähigkeiten von Databricks können Unternehmen eine erfolgreiche Migration erreichen, die verbesserte Leistung, Skalierbarkeit und Kosteneffizienz liefert.

Die Migrationsreise ist eine Gelegenheit, zu modernisieren, wo Ihre Daten liegen und wie Sie damit arbeiten. Indem Sie diesen Tipps folgen und häufige Fallstricke vermeiden, kann Ihr Unternehmen reibungslos auf die Databricks-Plattform umsteigen und neue Möglichkeiten für datengesteuerte Entscheidungen erschließen.

Denken Sie daran, dass neben den technischen Aspekten der Migration auch der organisatorischen Bereitschaft, dem Wissenstransfer und den Einführungsstrategien gleiche Aufmerksamkeit geschenkt werden sollte, um den langfristigen Erfolg zu gewährleisten.

Praktische Tipps von Capgemini

Capgemini teilte einige praktische Tipps für die Migration von SQL Server zu Databricks in diesem Webinar. Schauen Sie es sich an, um zu erfahren, wie die Migration in einem Life-Sciences-Unternehmen funktioniert hat! Highlights sind:

- Beginnen Sie klein mit schrittweisen Migrationen.

- Automatisieren Sie die Coding- und Testphasen.

- Binden Sie frühe Benutzer frühzeitig in den Migrationsprozess ein.

- Gezielte Optimierung mit Funktionen wie Data Skipping, Z-Order und VACUUM.

- Nutzen Sie das Lakehouse voll aus, indem Sie die gesamte Plattform nutzen.

Was als Nächstes zu tun ist

Migration kann eine Herausforderung sein. Es wird immer Kompromisse geben, die abgewogen werden müssen, und unerwartete Probleme und Verzögerungen zu bewältigen. Sie benötigen bewährte Partner und Lösungen für die personellen, prozessualen und technologischen Aspekte der Migration. Wir empfehlen, den Experten von Databricks Professional Services und unseren zertifizierten Migrationspartnern zu vertrauen, die über umfassende Erfahrung in der schnellen Bereitstellung hochwertiger Migrationslösungen verfügen. Kontaktieren Sie uns, um Ihre Migrationsbewertung zu starten.

Sie sollten sich auch das E-Book "Modernisieren Sie Ihre Datenlandschaft durch Migration zu Azure Databricks" ansehen.

Wir haben auch einen vollständigen Leitfaden zur Migration von SQL Server zu Databricks – erhalten Sie hier Ihr kostenloses Exemplar.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.