Ein praktisches Framework für KI-Governance für Unternehmen

Ein umfassender Leitfaden für die verantwortungsvolle und effektive Implementierung von Tools und Programmen zur KI-Governance.

- Für Organisationen, die eine rigorose KI-Governance entwickeln und dokumentieren möchten, haben wir ein KI-Governance-Framework entwickelt, das einen strukturierten Ansatz für eine verantwortungsvolle KI-Entwicklung beschreibt.

- Best Practices für die KI-Governance, einschließlich Risikomanagement, Compliance, ethischer Aufsicht und operatives Monitoring, sind der Key zur Unterstützung transparenter, rechenschaftspflichtiger KI-Systeme.

- Das KI-Governance-Framework soll Unternehmen dabei helfen, KI-Programme zu skalieren und gleichzeitig regulatorische Erwartungen zu managen, Risiken zu reduzieren und das Vertrauen der Stakeholder zu erhalten.

Da Unternehmen KI im großen Stil einsetzen, wächst der Bedarf an formeller Governance. Unternehmen müssen die KI-Entwicklung an den Geschäftszielen ausrichten, rechtliche Verpflichtungen erfüllen und ethische Risiken berücksichtigen.

Wir haben das Databricks AI Governance Framework eingeführt, um einen strukturierten und praktischen Ansatz für die Steuerung der KI-Einführung im gesamten Unternehmen zu bieten. Dieses Framework wurde entwickelt, um die Entwicklung, Bereitstellung und kontinuierliche Verbesserung von KI-Governance-Programmen zu unterstützen.

Einführung in die KI-Governance

Der Begriff "KI-Governance" bezieht sich auf die Strukturen, Prozesse und Aufsichtsmechanismen, die für eine verantwortungsvolle Entwicklung und den Einsatz von KI-Systemen in einem gesamten Unternehmen erforderlich sind. Wenn Unternehmen generative KI skalieren, wird Governance zu einem grundlegenden Prinzip für Themen wie die Abstimmung von KI-Initiativen auf Geschäftsziele, die Verwaltung ethischer und regulatorischer Verpflichtungen und die Sicherstellung, dass sich Modelle im Produktivbetrieb konsistent und vorhersagbar verhalten.

Darüber hinaus hat KI-Governance einen erheblichen Einfluss auf den ROI von KI. Ohne klare Zuständigkeiten, Richtlinien und Risikokontrollen können KI-Programme häufig ins Stocken geraten, auf vermeidbare Sicherheitsvorfälle stoßen oder das Vertrauen der Stakeholder gar nicht erst gewinnen. Branchenstudien zeigen, dass Governance-Herausforderungen ein Haupthindernis für die Skalierung von KI sind, während mehr als die Hälfte der Führungskräfte unklare Zuständigkeiten, unzureichende Risikokontrollen oder mangelnde Compliance als Hauptursachen für gescheiterte KI-Projekte anführen. Darüber hinaus haben Probleme wie Modellverzerrungen, Datenlecks und nicht autorisiertes Modellverhalten zugenommen, was die Notwendigkeit strengerer Governance-Praktiken unterstreicht. Diese Zahlen verdeutlichen, dass Governance eine entscheidende Voraussetzung für den Wert von KI ist und nicht nur ein nachträglicher Gedanke.

Es ist auch wichtig, Governance von Sicherheit zu unterscheiden. Während sich die Sicherheit auf den Schutz von Daten, Modellen und Infrastruktur vor Bedrohungen konzentriert, legt die Governance stattdessen fest, wie Entscheidungen über die Entwicklung und Nutzung von KI getroffen werden.

Dazu gehören Aspekte wie die Festlegung von Verantwortlichkeiten, die Definition von Richtlinien, die Bewertung von Risiken und die Gewährleistung eines ethischen und transparenten Betriebs. Zusammen bilden Governance und Sicherheit die Grundlage für eine sichere, skalierbare KI. Mit dem Databricks AI Governance Framework erhalten Unternehmen einen strukturierten Ansatz zum Aufbau dieser Fähigkeiten, bevor sie KI über Produkte und Workflows hinweg skalieren.

Warum KI-Governance nicht warten kann

Laut einer von Economist Impact durchgeführten globalen Umfrage aus dem Jahr 2024 unter 1.100 Führungskräften und Ingenieuren aus der Technologiebranche waren 40 % der Befragten der Meinung, dass das KI-Governance-Programm ihrer Organisation unzureichend sei, um die Sicherheit und Compliance ihrer KI-Assets und Anwendungsfälle zu gewährleisten. Darüber hinaus waren Datenschutz- und Sicherheitsverletzungen für 53 % der Enterprise Architects das Hauptanliegen, während Sicherheit und Governance für Ingenieure die schwierigsten Aspekte des Data Engineering sind.

Darüber hinaus ist laut Gartner das Management von KI-Vertrauen, -Risiko und -Sicherheit der Top-Strategietrend Nr. 1 im Jahr 2024, der Geschäfts- und Technologieentscheidungen beeinflussen wird. Bis 2026 werden KI-Modelle von Organisationen, die KI-Transparenz, Vertrauen und Sicherheit operationalisieren, eine 50-prozentige Steigerung in Bezug auf Einführung, Geschäftsziele und Nutzerakzeptanz erzielen.

Es ist offensichtlich, dass das Fehlen von KI-Governance-Programmen auf Unternehmensebene schnell zu einem Schlüsselhindernis für die Wertschöpfung aus KI-Investitionen und die KI-Einführung insgesamt wird.

Daher haben wir ein umfassendes Leitlinien-Framework entwickelt, das Unternehmen für den Aufbau effektiver KI-Governance-Programme nutzen können.

Ein strukturierter Ansatz zur KI-Governance

Bewährte Vorgehensweisen für die Implementierung von KI-Governance erfordern eine strukturierte, wiederholbare Methodik, die Menschen, Prozesse und Technologien im gesamten Unternehmen aufeinander abstimmt. Das Databricks AI-Governance-Framework verfolgt einen ganzheitlichen Ansatz, der mit der Festlegung klarer Geschäftsziele, der Definition von Zuständigkeiten und der Erstellung von Governance-Modellen beginnt, die sich nahtlos in bestehende Unternehmensstrukturen integrieren lassen. Governance-Programme sind erfolgreich, wenn sie als Erweiterungen bestehender Unternehmensstrategien, Risikopraktiken und Datenverwaltungsprozesse behandelt werden.

Ein zentraler Aspekt dieses Ansatzes ist die Verankerung von Governance-Verantwortlichkeiten in allen Teams, anstatt sie in einer einzigen Gruppe zu zentralisieren. Führungskräfte geben die strategische Richtung vor, indem sie KI-Ziele formulieren, akzeptable Risikoniveaus definieren und die Übereinstimmung mit den Unternehmensprioritäten sicherstellen.

Teams wie Data Engineering, Data Science und ML Engineering setzen diese Richtlinien um, indem sie Standards für Datenqualität, Modelldokumentation, Lineage, Reproduzierbarkeit und Zugriffskontrollen implementieren. Rechts-, Compliance- und Sicherheitsteams spielen eine zusätzliche, parallele Rolle, um die Einhaltung gesetzlicher Vorschriften, die Einhaltung von Richtlinien und den Schutz von Daten und Modell-Vermögenswerten während des gesamten Lebenszyklus zu gewährleisten.

Die Integration von Governance in operative Systeme sorgt für Konsistenz und Skalierbarkeit. Beispielsweise können einheitliche Data-Governance-Lösungen wie Unity Catalog Zugriffsrichtlinien standardisieren, die Datenherkunft (Lineage) sicherstellen und Metadaten für die Risikobewertung und Auditierbarkeit zentralisieren. Gleichzeitig stellen solide Data-Engineering-Praktiken sicher, dass KI-Programme auf zuverlässigen, gut verwalteten Datengrundlagen aufbauen, mit reproduzierbaren Pipelines und transparenten Transformationen, die im Laufe der Zeit überwacht werden können.

Effektive KI-Governance ist keine einmalige Angelegenheit. Kontinuierliche Monitoring- und Evaluierungsprozesse sind erforderlich, um die Modell-Performance zu verfolgen, Datendrift zu bewerten, Bias zu erkennen, die Richtlinien-Compliance zu bestätigen und aufkommende Risiken zu identifizieren. Diese kontinuierliche Feedbackschleife stellt sicher, dass die Modelle auch bei sich ändernden Bedingungen den geschäftlichen Expectations und regulatorischen Anforderungen entsprechen. Regelmäßige Überprüfungen durch funktionsübergreifende Teams helfen Unternehmen auch dabei, Richtlinien proaktiv anzupassen, Modelle neu zu trainieren und Governance-Prozesse zu verfeinern.

Durch einen strukturierten, kollaborativen und lebenszyklusorientierten Ansatz können Unternehmen Governance-Programme aufbauen, die zuverlässig skalieren, Risiken reduzieren und die sichere Einführung von KI im gesamten Unternehmen beschleunigen.

Die fünf Grundpfeiler der KI-Governance

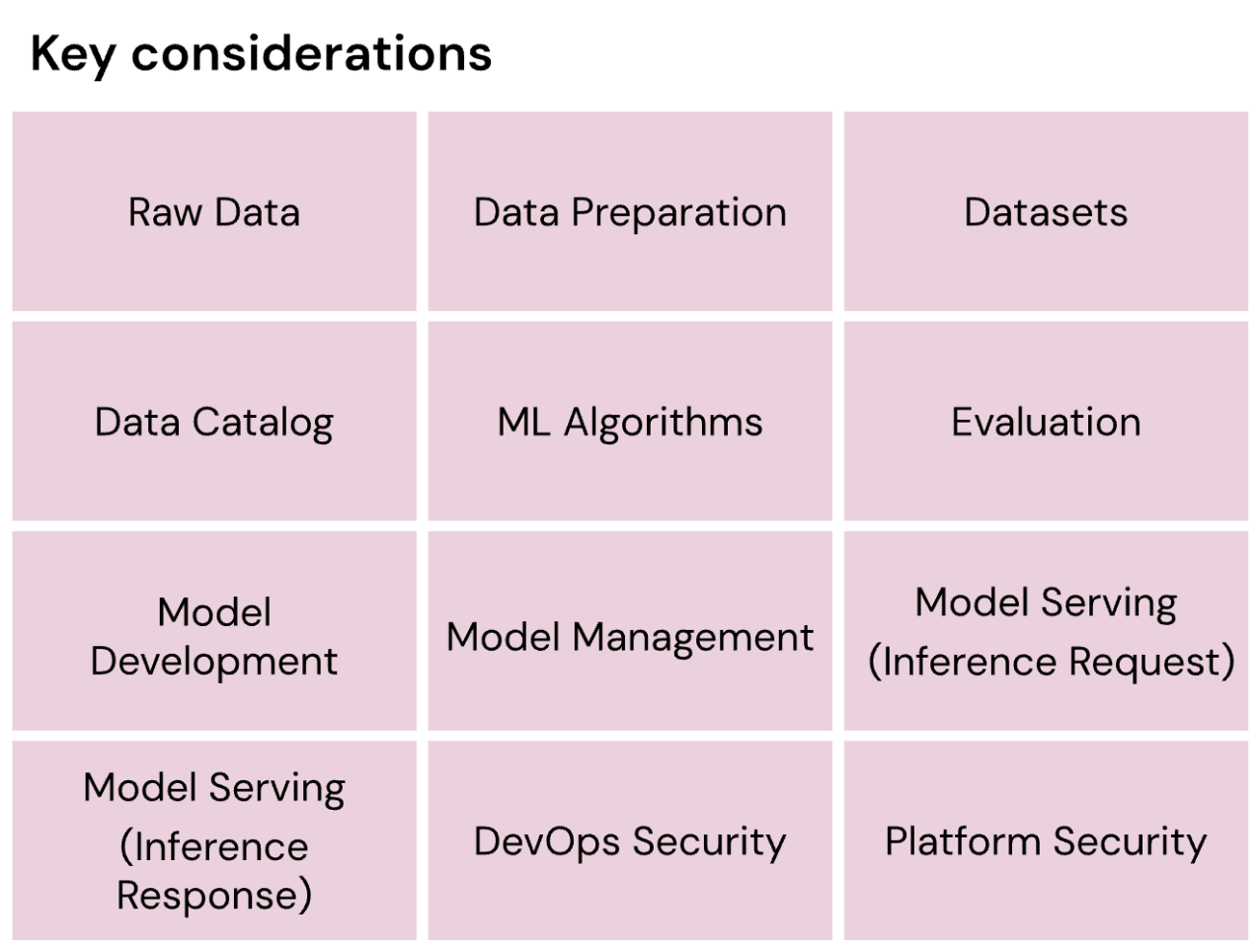

In diesem Rahmenwerk stellen wir 43 zentrale Aspekte vor, die jedes Unternehmen verstehen (und gegebenenfalls umsetzen) sollte, um seine KI-Initiativen effektiv zu steuern.

Die Key-Aspekte der KI-Governance sind logisch in fünf Grundpfeilern zusammengefasst, die so konzipiert und angeordnet sind, dass sie typische Unternehmensstrukturen und Personas widerspiegeln.

- KI-Organisation

- Rechtliche und regulatorische Compliance

- Ethik, Transparenz und Interpretierbarkeit

- Daten, KI-Ops und Infrastruktur

- KI-Sicherheit

Ein Framework für die KI-Governance

KI-Organisation

Die KI-Organisation bettet die KI-Governance in die übergeordnete Governance-Strategie des Unternehmens ein. Es unterstreicht die Grundlage für ein effektives KI-Programm durch Best Practices wie klar definierte Geschäftsziele und die Integration geeigneter Governance-Praktiken, die die Mitarbeiter, Prozesse, Technologien und Daten des Unternehmens überwachen. Es erklärt, wie Unternehmen die erforderliche Aufsicht schaffen können, um ihre strategischen Ziele zu erreichen und gleichzeitig das Risiko zu reduzieren.

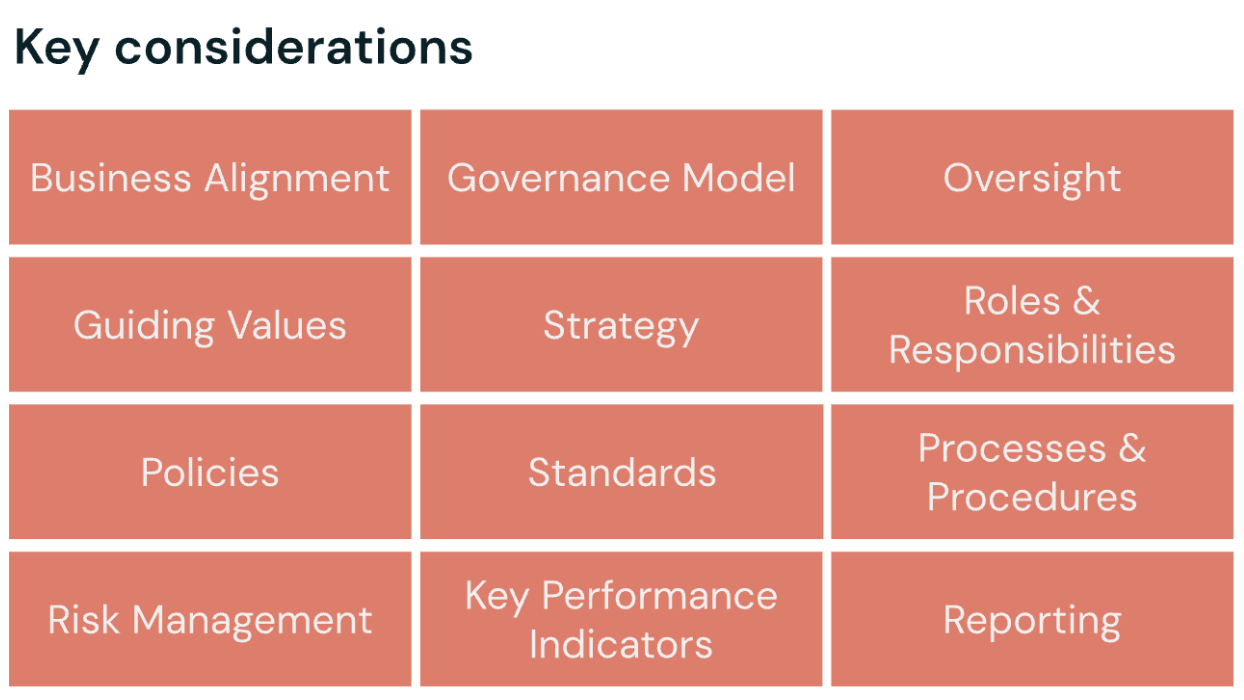

Wichtige Überlegungen für eine effektive KI-Governance-Organisation

- Geschäftliche Ausrichtung

- Governance-Modell

- Aufsicht

- Leitwerte

- Strategie

- Rollen & Verantwortlichkeiten

- Richtlinien

- Standard

- Prozesse & Verfahren

- Risikomanagement

- Leistungskennzahlen

- Berichterstattung

Laden Sie das KI Governance Framework herunter, um die Schritte für den Einstieg zu erhalten.

Rechtliche und regulatorische Compliance von KI-Initiativen

Die Säule der rechtlichen und regulatorischen Compliance hilft Unternehmen dabei, KI-Initiativen mit den geltenden Gesetzen und Vorschriften in Einklang zu bringen. Sie bietet eine Anleitung für das Management rechtlicher Risiken, die Auslegung branchenspezifischer Anforderungen und die Anpassung von Compliance-Strategien als Reaktion auf sich entwickelnde regulatorische Rahmenbedingungen. Das Ergebnis ist, dass KI-Programme innerhalb eines soliden rechtlichen und regulatorischen Rahmens entwickelt und angewendet werden.

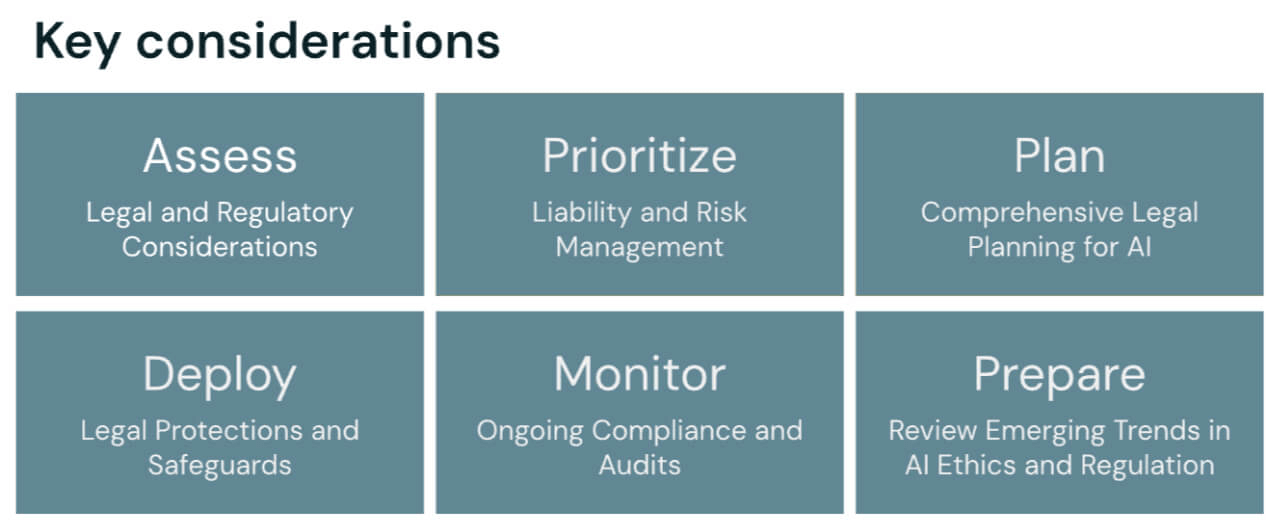

Schritte zur Abstimmung von KI-Initiativen mit Gesetzen und Vorschriften

- Rechtliche und regulatorische Aspekte bewerten

- Priorisierung von Haftung und Risikomanagement

- Planung einer umfassenden rechtlichen Überprüfung

- Rechtliche Schutz- und Sicherheitsmaßnahmen anwenden

- Überwachen Sie die laufende Compliance und führen Sie regelmäßige Audits durch

- Analysieren Sie aufkommende Trends in der KI-Ethik und -Regulierung.

Ethik, Transparenz und Interpretierbarkeit von KI-Programmen

In Organisationen, die vertrauenswürdige und verantwortungsvolle KI-Systeme entwickeln, ist es wichtig, ethische Grundsätze wie Fairness, Rechenschaftspflicht und menschliche Aufsicht einzuhalten und gleichzeitig Erklärbarkeit und die Einbindung von Stakeholdern zu fördern. Diese Säule im Framework für KI-Governance bietet Methoden, um Verantwortlichkeit und Struktur in Organisationsteams zu etablieren. Sie hilft sicherzustellen, dass KI-Entscheidungen interpretierbar sind, mit sich entwickelnden ethischen Standards im Einklang stehen und langfristiges Vertrauen sowie gesellschaftliche Akzeptanz fördern.

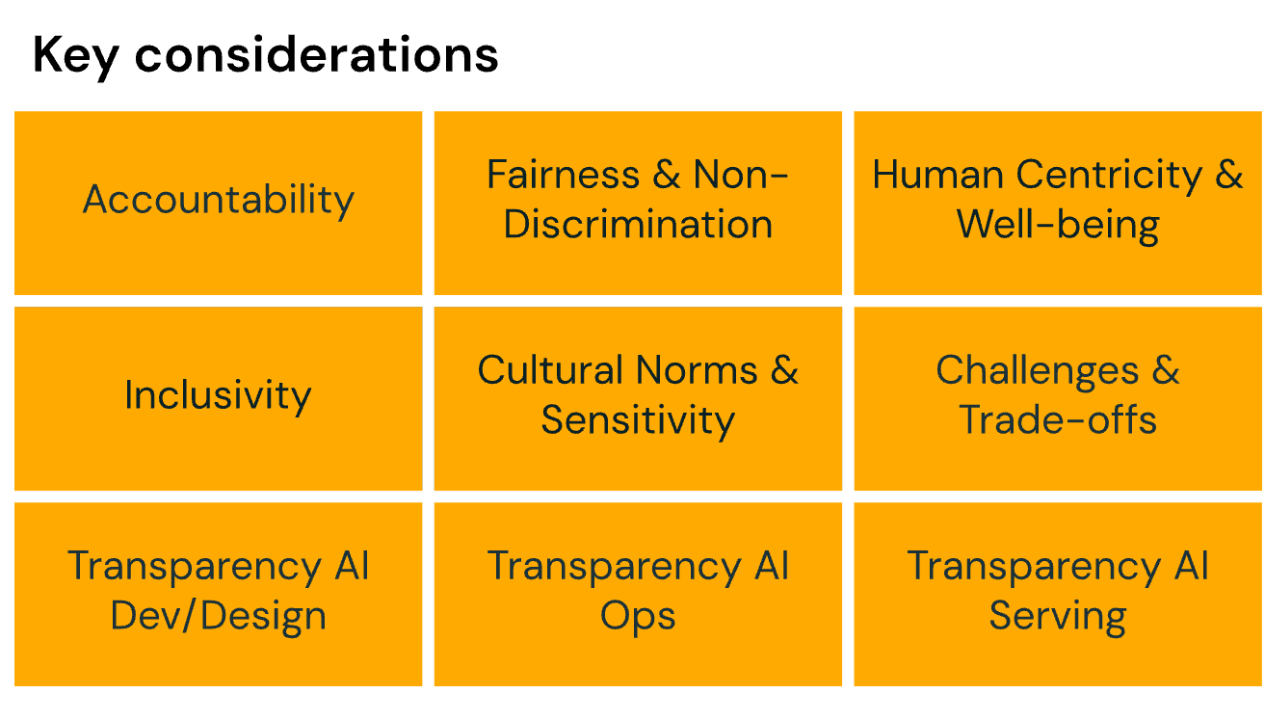

Berücksichtigen Sie bei der Konzeption von KI-Programmen und der Einführung von KI-Governance-Tools, wie Sie die folgenden Aspekte behandeln werden:

- Verantwortlichkeit

- Fairness und Nichtdiskriminierung

- Menschzentrierung und Wohlbefinden

- Inklusion

- Kulturelle Normen und Sensibilität

- Herausforderungen und Kompromisse bei all den oben genannten Punkten

- Transparenz in der KI-Entwicklung und im KI-Design

- Transparenz in KI Ops

- Transparenz beim KI-Serving

Daten, AI Ops und Infrastruktur für KI-Governance

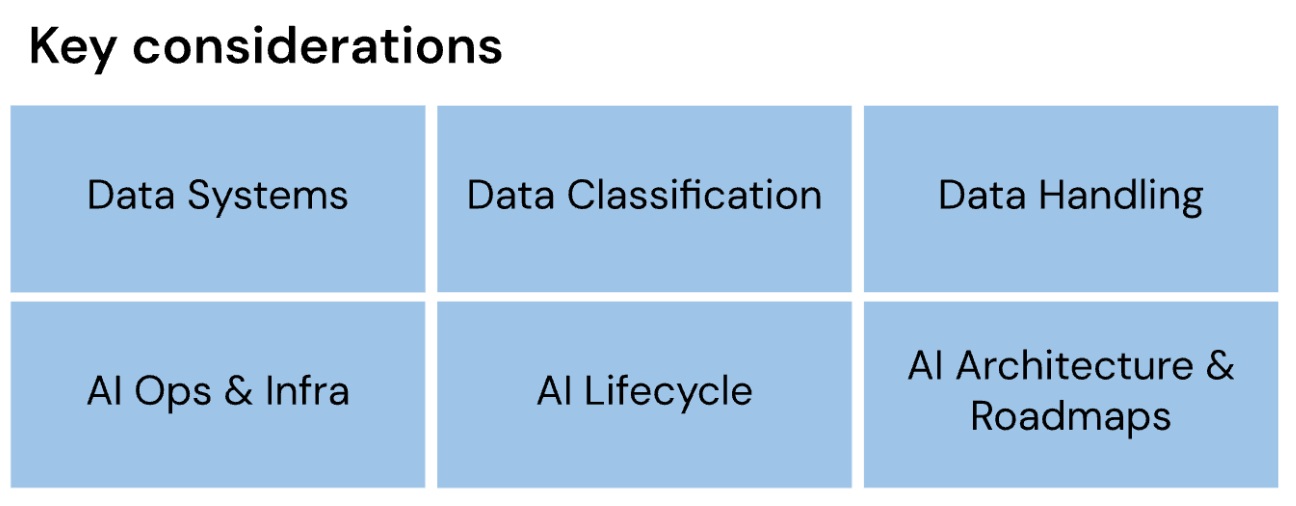

Die Säule „Daten, KI-Betrieb (AIOps) und Infrastruktur“ definiert die Grundlage, die Unternehmen bei der vollständigen Bereitstellung und Wartung von KI unterstützt. Sie benötigen Richtlinien für die Erstellung einer skalierbaren und zuverlässigen KI-Infrastruktur, die Verwaltung des Machine-Learning-Lebenszyklus und die Gewährleistung von Datenqualität, Sicherheit und Compliance. Diese Säule hebt auch Best Practices für den KI-Betrieb hervor, einschließlich Modelltraining, Evaluierung, Bereitstellung und Monitoring, damit KI-Systeme zuverlässig, effizient und auf die Geschäftsziele abgestimmt sind.

Säule V: KI-Sicherheit

Die Säule „KI-Sicherheit“ stellt das Databricks AI Security Framework (DASF) vor, ein umfassendes Framework zum Verständnis und zur Minderung von Sicherheitsrisiken über den gesamten KI-Lebenszyklus hinweg. Es deckt kritische Bereiche wie Datenschutz, Modellmanagement, sicheres Model-Serving und die Implementierung robuster Cybersicherheitsmaßnahmen zum Schutz von KI-Assets ab.

Zugehörig: Sehen Sie sich eine beispielhafte Vorgehensweise an, wie eine Organisation das Framework für KI-Governance nutzen kann, um klare Zuständigkeiten und eine einheitliche Ausrichtung über den gesamten Lebenszyklus des KI-Programms hinweg zu schaffen. Sehen Sie sich diese Präsentation an, die während des 2025 Data + AI Summit gehalten wurde.

KI Governance Framework

Das KI-Governance-Framework -Whitepaper steht Organisationen zur Verfügung, die ihre eigene KI-Governance entwickeln möchten.

Bitte kontaktieren Sie uns per E-Mail unter [email protected] wenn Sie Fragen haben oder Feedback geben möchten. Wenn Sie daran interessiert sind, zu zukünftigen Updates dieses Frameworks (und anderen kommenden Artefakten) beizutragen, indem Sie unserer Reviewer-Community beitreten, würden wir uns ebenfalls freuen, von Ihnen zu hören!

Schlüsselprinzipien für eine effektive KI-Governance

KI-Governance basiert auf einem einheitlichen Satz grundlegender Prinzipien, die in jeder Phase des KI-Lebenszyklus gelten. Diese Prinzipien stellen sicher, dass KI-Systeme verantwortungsvoll entwickelt und angewendet werden, und bieten gleichzeitig eine notwendige Struktur für Organisationen, um regulatorische Erwartungen zu erfüllen, das Vertrauen der Stakeholder zu wahren und Risiken bei zunehmender Nutzung zu mindern. Prinzipien wie Transparenz, Rechenschaftspflicht, Fairness und menschliche Aufsicht bilden den Kern jeder effektiven Strategie.

Transparenz beginnt mit einer klaren, zugänglichen Dokumentation von Datenquellen, Modellannahmen, Trainingsmethoden und Evaluierungsprozessen. Eine transparente Vorgehensweise erfordert die systematische Nachverfolgung von Herkunft, Versionierung und Modellverhalten, damit Teams nachvollziehen können, wie Entscheidungen getroffen werden, und die beitragenden Faktoren identifizieren können, wenn Probleme auftreten. Governance-Tools, die Metadaten, Audit-Trails und Zugriffsrichtlinien zentralisieren, unterstützen diese Arbeit, indem sie operative Details teamübergreifend sichtbar und überprüfbar machen.

Die KI-Governance sollte auch Maßnahmen zur Verantwortlichkeit priorisieren, sodass es für jedes KI-System klar definierte Verantwortliche gibt, die für die Ergebnisse, das Risikomanagement und die Einhaltung der Governance-Standards zuständig sind. Ein wirksames Rahmenwerk für die Verantwortlichkeit legt Rollen in den Bereichen Business, Technik, Recht und Compliance fest, verteilt Entscheidungsbefugnisse und schafft Eskalationsmechanismen für den Fall, dass unerwartetes Modellverhalten oder ethische Bedenken auftreten. Darüber hinaus kann die Erstellung von KPIs und Performance-Schwellenwerten Führungskräften messbare Benchmarks zur Bewertung von KI-Systemen im Zeitverlauf an die Hand geben.

Das Prinzip der Fairness erfordert die proaktive Identifizierung und Minderung von Bias während der Datenerfassung, des Modelltrainings und des Monitorings in der Produktion. Techniken wie die Disparate-Impact-Analyse, Metriken zur Bias-Erkennung und repräsentative Stichprobenstrategien können Teams helfen zu verstehen, wie die Modellausgaben zwischen verschiedenen Benutzergruppen variieren. Kontinuierliche Fairness-Bewertungen ermöglichen es Unternehmen, Drift oder Ungleichheiten zu erkennen, während sich die Nutzung in der realen Welt weiterentwickelt.

Schließlich hilft die menschliche Aufsicht dabei, KI-Systeme an organisatorischen Werten und regulatorischen Anforderungen auszurichten. Dieser Schritt umfasst die Festlegung, wo eine menschliche Überprüfung erforderlich ist, die Gestaltung klarer Fallback-Verfahren und die Sicherstellung, dass Fachexperten eingreifen können, wenn die Modellausgaben mehrdeutig, risikoreich oder sensibel sind. Aufsichtsmechanismen sollten sowohl in die Entwicklungs-Workflows als auch in den Produktionsbetrieb integriert werden, damit die Schutzmaßnahmen während des gesamten KI-Lebenszyklus aktiv bleiben.

Implementierung von verantwortungsvollen KI-Praktiken

Verantwortungsvolle KI -Praktiken sind die Leitplanken, die sicherstellen, dass KI-Systeme den Menschen, Unternehmen und der Gesellschaft auf eine Weise dienen, die sicher, fair und auf die Werte der Organisation abgestimmt ist. Die Umsetzung dieser Praktiken erfordert einen ganzheitlichen Ansatz über den gesamten KI-Lebenszyklus hinweg. Von der Datenbeschaffung und Modellentwicklung bis hin zur Bereitstellung, Monitoring und eventuellen Stilllegung ist jede Phase eine Gelegenheit, Schutzmaßnahmen zu verankern. Kurz gesagt ist es das Ziel jeder verantwortungsvollen KI-Praxis, Schäden zu reduzieren, das Vertrauen zu stärken und die Systemperformance im Laufe der Zeit zu verbessern.

Ein entscheidender Bestandteil von verantwortungsvoller KI ist die Ausrichtung des Systemverhaltens an menschlichen Werten und Unternehmensgrundsätzen. Dies beginnt mit der Definition des beabsichtigten Einsatzzwecks eines Modells – einschließlich sensibler oder besonders wirkungsvoller Szenarien – und der Festlegung von Anforderungen in Bezug auf Datenschutz, Fairness, Sicherheit und Erklärbarkeit. Es ist entscheidend, diese Kriterien frühzeitig in den Designprozess einzubeziehen, damit Teams sich explizit mit ethischen Überlegungen befassen, anstatt nur reaktiv zu handeln. Spezifische Techniken helfen KI-Systemen, konsistent mit den Erwartungen der Nutzer und gesellschaftlichen Normen zu agieren. Dazu gehören zum Beispiel Tools zur Modellinterpretierbarkeit, repräsentative Trainingsdatensätze und Human-in-the-Loop-Überprüfungsprozesse.

Zusätzlich sollten Risikoidentifizierung und -minderung direkt in die Entwicklungsworkflows integriert werden. Organisationen müssen Risiken wie Bias, Modelldrift, Halluzinationen, Datenlecks und unsichere Ausgaben bewerten und für jedes dieser Risiken Minderungsstrategien entwickeln. Diese Strategien können auch differenzielle Privatsphäre, die Filterung von Prompts und Ausgaben, adversariales Testen und Red-Teaming-Übungen umfassen, die auf domänenspezifische Risiken zugeschnitten sind. Im Verlauf dieser Tests sollten die Teams Risikobewertungen und Kontrollen dokumentieren, um Transparenz zu schaffen und die Anforderungen für regulatorische und interne Audits zu unterstützen.

Die Implementierung verantwortungsvoller KI-Praktiken ist ein fortlaufender Job. Selbst gut verwaltete Modelle können an Leistung verlieren, wenn sich Datenverteilungen verschieben oder neue Anforderungen entstehen. Teams sollten automatisierte Monitoring-Pipelines einrichten, um Performance-Metriken, Fairness-Indikatoren und die Richtlinien-Compliance in der Produktion zu verfolgen. Wenn Probleme auftreten, stellen Retraining-Verfahren, strukturierte Überprüfungen von Vorfällen und eine aktualisierte Dokumentation sicher, dass sich KI-Systeme verantwortungsvoll weiterentwickeln.

Für jedes Team ist es wichtig, Innovation und Vorsicht in Einklang zu bringen. Teams sollten Wege schaffen, die das Experimentieren ermöglichen, z. B. Sandbox-Umgebungen oder kontrollierte Pilotbereitstellungen, und gleichzeitig Leitplanken beibehalten, die unbeabsichtigten Schaden verhindern. Dieses Gleichgewicht befähigt Organisationen, neue generative KI-Fähigkeiten zu erkunden und dabei die Governance-Erwartungen und ethischen Standards einzuhalten.

Erste Schritte bei der Implementierung des DAGF

Die Implementierung des Databricks AI Governance Frameworks (DAGF) beginnt mit einer klaren, praktischen Roadmap, die Unternehmen von der frühen Planung bis zum Betrieb auf Unternehmensebene leitet. Der erste Schritt ist die Schaffung grundlegender Governance-Strukturen: die Definition von Rollen und Verantwortlichkeiten, die Dokumentation von KI-Anwendungsfällen und die Bewertung der organisatorischen Bereitschaft in Bezug auf Datenqualität, Praktiken der Modellentwicklung und Compliance-Anforderungen. Diese anfängliche Abstimmung stellt sicher, dass die Governance-Bemühungen die Geschäftsprioritäten und die Risikotoleranz direkt unterstützen.

Ein Reifegradmodell kann Unternehmen dabei helfen, zu bewerten, wo sie heute stehen, und die nächsten Schritte auf ihrem Weg zur Governance zu identifizieren. Zum Beispiel konzentrieren sich Programme in der Anfangsphase auf die Dokumentation von KI-Assets, die Zentralisierung von Zugriffskontrollen und die Festlegung grundlegender Richtlinien für die Datennutzung, Modellentwicklung und Überprüfung. Mit zunehmender Reife können Unternehmen beginnen, standardisierte Workflows, ein automatisiertes Lineage und Monitoring sowie funktionsübergreifende Ausschüsse einzuführen, die das KI Risiko und Compliance überwachen. Schließlich operationalisieren vollständig ausgereifte Programme die Governance über den gesamten Lebenszyklus hinweg, was reproduzierbare Pipelines, eine kontinuierliche Modellevaluierung und klar definierte Prozesse für Neutraining, Auditing und Incident Response umfasst.

Egal wie sorgfältig ein Governance-Framework implementiert wird, es gibt einige häufige Fallstricke, mit denen Organisationen konfrontiert sind. Zum Beispiel haben viele Schwierigkeiten, wenn Governance als nachträglicher Gedanke behandelt oder einem einzelnen Team ohne klare Verantwortlichkeit zugewiesen wird. Andere unterschätzen möglicherweise die Rolle hochwertiger Daten und versäumen es, einige grundlegende Praktiken wie die Schemaerzwingung, Nachverfolgung der Herkunft und den kontrollierten Zugriff zu implementieren. Diese Lücken mögen auf den ersten Blick geringfügig erscheinen, aber sie können nachgelagerte Herausforderungen in Bezug auf Transparenz, Reproduzierbarkeit und Prüfbarkeit schaffen. Die Etablierung einer gemeinsamen Verantwortung über Geschäfts-, Technik- und Compliance-Teams hinweg sowie die Verankerung der Governance in starken Data-Engineering-Praktiken können helfen, dieses Problem in einer Organisation zu verhindern.

Um den Erfolg zu messen, sollten Unternehmen den Fortschritt verfolgen und die Auswirkungen der Governance-Investitionen messen. Zu den Metriken können eine Verringerung von Modellvorfällen und Verzerrungsergebnissen, eine verbesserte Reproduzierbarkeit von Modellen, eine höhere Vollständigkeit der Dokumentation, verkürzte Überprüfungszyklen, schnellere Genehmigungen für neue KI-Anwendungsfälle und eine höhere Akzeptanz von standardisierten Pipelines und Tools gehören. Im Laufe der Zeit zeigen diese Indikatoren, wie Governance eine wesentliche Funktion für Zuverlässigkeit, Compliance und betriebliche Effizienz ist.

Die Implementierung von Governance sollte ein schrittweiser Ansatz sein, der Unternehmen dabei hilft, sich sorgfältig an ihren Ressourcen und Zielen auszurichten. Viele Unternehmen beginnen mit Anwendungsfällen mit großer Wirkung und wenden Governance-Kontrollen auf die sensibelsten oder geschäftskritischsten Modelle an, bevor sie zu umfassenderen Programmen übergehen. Ein iteratives Vorgehen und eine schrittweise Skalierung können Unternehmen jedoch dabei helfen, eine solide Governance-Grundlage zu schaffen, die eine sichere, transparente und vertrauenswürdige Einführung von KI im gesamten Unternehmen unterstützt.

Warum Databricks bei diesen Bemühungen führend ist

Als Branchenführer im Daten- und KI-Bereich mit über 15.000 Kunden in verschiedenen Regionen und Marktsegmenten hat Databricks sein Engagement für die Prinzipien der verantwortungsvollen Entwicklung und der Open-Source-Innovation weiterhin erfüllt. Wir sind diesen Verpflichtungen nachgekommen durch:

- Engagement bei Initiativen von Branchen und Regierung zur Förderung von Innovation und zur Befürwortung des Einsatzes von sicherer und vertrauenswürdiger KI

- Interaktive Workshops, um Unternehmen zu zeigen, wie sie ihre KI-Reise erfolgreich und risikobewusst gestalten können

- Open-Sourcing von Key Governance-Innovationen wie MLFlow und Unity Catalog, der branchenweit einzigen einheitlichen Lösung für Daten- und KI-Governance über Clouds, Datenformate und Datenplattformen hinweg.

Diese Programme haben uns einzigartige Einblicke in die praktischen Probleme ermöglicht, mit denen Unternehmen und Regulierungsbehörden heute im Bereich der KI-Governance konfrontiert sind. Im Rahmen unseres Engagements, jedem Unternehmen zum Erfolg zu verhelfen und seine Daten- und KI-Journey zu beschleunigen, haben wir uns entschieden, diese Einblicke zu nutzen, um ein umfassendes, strukturiertes und umsetzbares KI-Governance-Frameworkzu entwickeln (und kostenlos bereitzustellen).

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.