Novità: Zerobus e altri annunci migliorano l'ingestione dei dati per Lakeflow Connect

Lakeflow Connect espande la copertura delle origini dati e Zerobus introduce un'API di scrittura diretta ad alta produttività con bassa latenza

di Elise Georis, Peter Pogorski, Victoria Bukta e Giselle Goicochea

- Lakeflow Connect espande l'ampiezza delle origini dati di ingestione, inclusi nuovi connettori basati su query per database.

- Zerobus è un'API di scrittura diretta che semplifica l'ingestione per IoT, clickstream, telemetria e altri casi d'uso simili.

- Lakeflow Connect in Jobs fornisce un'integrazione fluida e intuitiva tra entrambi gli strumenti, aiutando gli utenti a risparmiare tempo con un'esperienza unificata end-to-end.

Tutto inizia con dati di qualità, quindi l'ingestione è spesso il primo passo per estrarre insight. Tuttavia, l'ingestione presenta delle sfide, come la necessità di acquisire familiarità con le complessità di ogni sorgente dati, tenere traccia di tali sorgenti al variare delle loro caratteristiche e governare tutto questo lungo il percorso.

Lakeflow Connect rende l'ingestione efficiente e semplice, con un'interfaccia utente point-and-click, un'API intuitiva e integrazioni profonde con la Data Intelligence Platform. L'anno scorso, oltre 2.000 clienti hanno utilizzato Lakeflow Connect per estrarre valore dai propri dati.

In questo blog, esamineremo le basi di Lakeflow Connect e riassumeremo gli ultimi annunci dal Data + AI Summit 2025.

Ingerisci tutti i tuoi dati in un unico posto con Lakeflow Connect

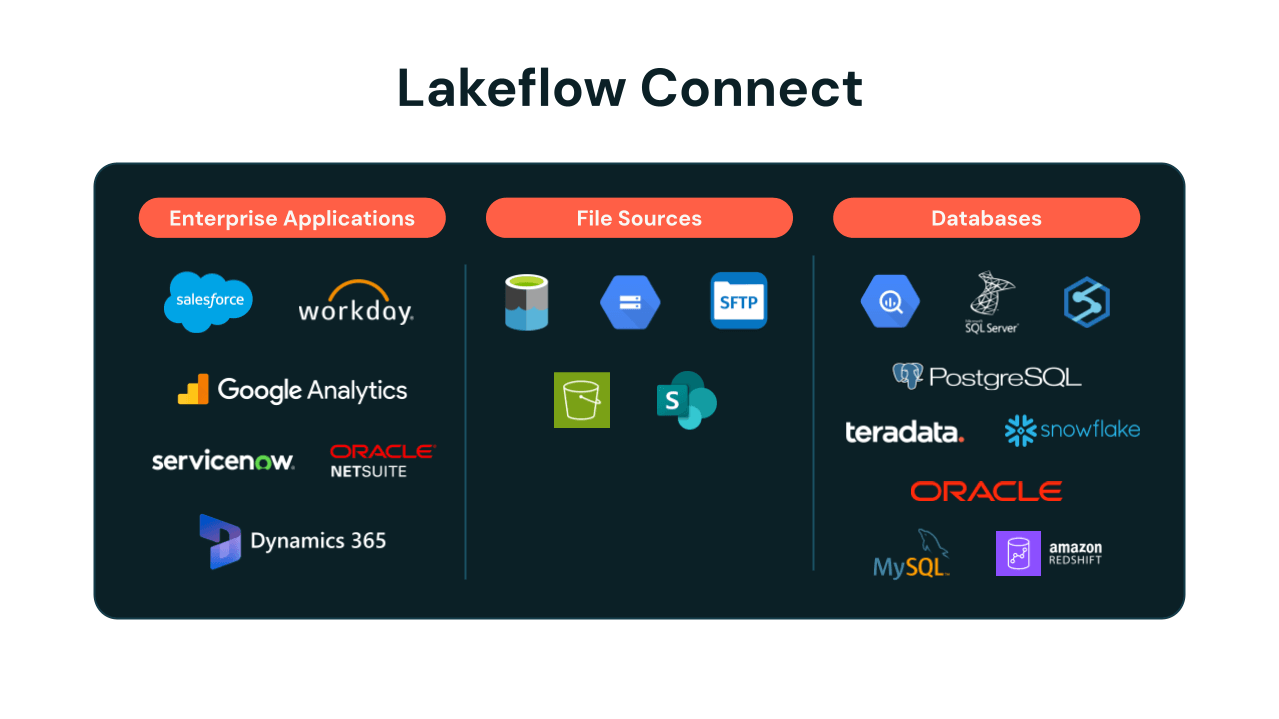

Lakeflow Connect offre connettori di ingestione semplici per applicazioni, database, cloud storage, message bus e altro ancora. Sotto il cofano, l'ingestione è efficiente, con aggiornamenti incrementali e un utilizzo ottimizzato dell'API. Mentre le tue pipeline gestite sono in esecuzione, ci occupiamo dell'evoluzione dello schema, degli aggiornamenti senza interruzioni delle API di terze parti e di un'osservabilità completa con avvisi integrati.

Annunci del Data + AI Summit 2025

Al Data + AI Summit di quest'anno, Databricks ha annunciato la disponibilità generale di Lakeflow, l'approccio unificato all'ingegneria dei dati che copre ingestione, trasformazione e orchestrazione. Come parte di ciò, Lakeflow Connect ha annunciato Zerobus, un'API di scrittura diretta che semplifica l'ingestione per casi d'uso IoT, clickstream, telemetria e simili. Abbiamo anche ampliato la gamma di sorgenti dati supportate con più connettori integrati per applicazioni enterprise, sorgenti file, database e data warehouse, oltre a dati da cloud object storage.

Zerobus: un nuovo modo per inviare dati di eventi direttamente al tuo lakehouse

Abbiamo fatto un annuncio entusiasmante introducendo Zerobus, un nuovo approccio innovativo per inviare dati di eventi direttamente al tuo lakehouse, avvicinandoti alla sorgente dati. Eliminando i passaggi intermedi dei dati e riducendo l'onere operativo, Zerobus è in grado di fornire scritture dirette ad alto throughput con bassa latenza, offrendo prestazioni quasi in tempo reale su larga scala.

In precedenza, alcune organizzazioni utilizzavano message bus come Kafka come strato di trasporto verso il Lakehouse. Kafka offre un modo duraturo e a bassa latenza per i produttori di dati di inviare dati, ed è una scelta popolare quando si scrive su più destinazioni. Tuttavia, aggiunge anche complessità e costi aggiuntivi, oltre all'onere di gestire un'ulteriore copia dei dati, rendendolo inefficiente quando la tua unica destinazione è il Lakehouse. Zerobus fornisce una soluzione semplice per questi casi.

Joby Aviation sta già utilizzando Zerobus per inviare dati di telemetria direttamente a Databricks.

Joby è in grado di utilizzare i nostri agenti di produzione con Zerobus per inviare gigabyte di dati di telemetria al minuto direttamente al nostro lakehouse, accelerando il tempo necessario per ottenere insight, il tutto con Databricks Lakeflow e la Data Intelligence Platform.” — Dominik Müller, Factory Systems Lead, Joby Aviation, Inc.

Come parte di Lakeflow Connect, Zerobus è inoltre unificato con la Databricks Platform, in modo da poter sfruttare immediatamente funzionalità analitiche e di AI più ampie. Zerobus è attualmente in Private Preview; contatta il tuo account team per l'accesso anticipato.

🎥 Guarda e scopri di più su Zerobus: Sessione breakout al Data + AI Summit, con Joby Aviation, "Lakeflow Connect: eliminare i passaggi intermedi nella tua architettura di streaming”

Lakeflow Connect espande le capacità di ingestione e le sorgenti dati

Nuovi connettori completamente gestiti continuano a essere rilasciati in vari stati di rilascio (vedi l'elenco completo di seguito), inclusi Google Analytics e ServiceNow, oltre a SQL Server – il primo connettore per database, tutti attualmente in Public Preview con disponibilità generale in arrivo a breve.

Abbiamo continuato a innovare anche per i clienti che desiderano maggiori opzioni di personalizzazione e utilizzano la nostra soluzione di ingestione esistente, Auto Loader. Elabora in modo incrementale ed efficiente i nuovi file di dati non appena arrivano nel cloud storage. Abbiamo rilasciato importanti miglioramenti di costo e prestazioni per Auto Loader, tra cui elencazioni di directory 3 volte più veloci e pulizia automatica con “CleanSource”, entrambi ora disponibili a livello generale, oltre a una scoperta dei file più intelligente ed economica utilizzando eventi di file. Abbiamo anche annunciato il supporto nativo per l'ingestione di file Excel e l'ingestione di dati da server SFTP, entrambi in Private Preview, disponibili su richiesta per l'accesso anticipato.

Sorgenti dati supportate:

- Applicazioni: Salesforce, Workday, ServiceNow, Google Analytics, Microsoft Dynamics 365, Oracle NetSuite

- Sorgenti file: S3, ADLS, GCS, SFTP, SharePoint

- Database: SQL Server, Oracle Database, MySQL, PostgreSQL

- Data warehouse: Snowflake, Amazon Redshift, Google BigQuery

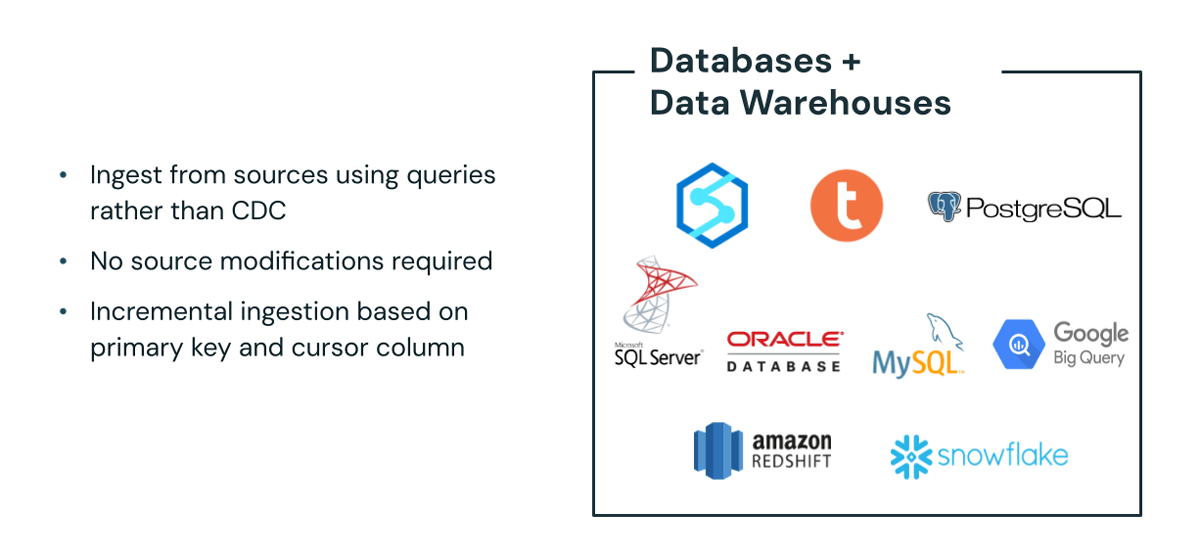

All'interno dell'offerta di connettori ampliata, stiamo introducendo connettori basati su query che semplificano l'ingestione dei dati. Questi nuovi connettori consentono di estrarre dati direttamente dai sistemi di origine senza modifiche al database e funzionano con repliche di lettura dove i log di change data capture (CDC) non sono disponibili. Questa funzionalità è attualmente in Private Preview; contatta il tuo account team per l'accesso anticipato.

🎥 Guarda e scopri di più su Lakeflow Connect: Sessione breakout al Data + AI Summit, “Introduzione a Lakeflow Connect”

🎥 Guarda e scopri di più sull'ingestione da applicazioni SaaS enterprise: Sessione breakout al Data + AI Summit con il cliente Databricks Porsche Holding, "Lakeflow Connect: Ingestione dati senza interruzioni da applicazioni enterprise"

🎥 Guarda e scopri di più sui connettori per database: Sessione breakout al Data + AI Summit, "Lakeflow Connect: Ingestione facile ed efficiente da database"

Lakeflow Connect in Jobs, ora disponibile a livello generale

Stiamo continuando a sviluppare funzionalità per semplificare l'utilizzo dei nostri connettori di ingestione durante la creazione di pipeline di dati, come parte dell'esperienza unificata di ingegneria dei dati di Lakeflow. Databricks ha recentemente annunciato Lakeflow Connect in Jobs, che consente di creare pipeline di ingestione all'interno di Lakeflow Jobs. Quindi, se i job sono al centro del tuo processo ETL, questa integrazione senza interruzioni offre un'esperienza più intuitiva e unificata per la gestione dell'ingestione.

I clienti possono definire e gestire i loro carichi di lavoro end-to-end, dall'ingestione alla trasformazione, tutto in un unico posto. Lakeflow Connect in Jobs è ora disponibile in generale.

🎥 Guarda e scopri di più su Lakeflow Jobs: Sessione plenaria al Data + AI Summit "Orchestrazione con Lakeflow Jobs" "Orchestrazione con Lakeflow Jobs"

Lakeflow Connect: altro in arrivo nel 2025 e oltre

Databricks comprende le esigenze degli ingegneri dei dati e delle organizzazioni che guidano l'innovazione con i loro dati utilizzando strumenti di analisi e AI. A tal fine, Lakeflow Connect ha continuato a sviluppare funzionalità di ingestione robuste ed efficienti con connettori completamente gestiti per funzionalità e API più personalizzabili.

Siamo solo all'inizio con Lakeflow Connect. Resta sintonizzato per ulteriori annunci più avanti quest'anno, o contatta il tuo team di account Databricks per unirti a un'anteprima per l'accesso anticipato.

Per provare Lakeflow Connect, puoi consultare la documentazione, o visitare il Demo Center.

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.