Erstellung hochwertiger und vertrauenswürdiger Datenprodukte mit Databricks

von Amr Ali, Bernhard Walter, Fran Medina Castro, Glenn Wiebe, Karthik Subbarao, Lexy Kassan, Magnus Pierre und Pawarit Laosunthara

Einleitung

Organisationen, die KI-gesteuert und datengetrieben werden wollen, müssen ihren internen Teams oft qualitativ hochwertige und vertrauenswürdige Datenprodukte zur Verfügung stellen. Der Aufbau solcher Datenprodukte stellt sicher, dass Organisationen Standards und eine vertrauenswürdige Grundlage für Geschäftsentscheidungen für ihre Daten- und KI-Ziele schaffen. Ein Ansatz, um Qualität und Benutzerfreundlichkeit in den Vordergrund zu stellen, ist die Nutzung des Data-Mesh-Paradigmas zur Demokratisierung des Eigentums und der Verwaltung von Datenbeständen. Unsere Blogbeiträge (Teil 1, Teil 2) bieten Anleitungen, wie Kunden Databricks in ihrem Unternehmen nutzen können, um die grundlegenden Säulen des Data Mesh anzugehen, von denen eine "Daten als Produkt" ist.

Obwohl die Idee, Daten als Produkte zu behandeln, mit dem Aufkommen des Data Mesh an Popularität gewonnen hat, haben wir festgestellt, dass die Anwendung von Produkt-Denken auch bei Kunden Anklang findet, die sich nicht für das Data Mesh entschieden haben. Unabhängig von der Organisationsstruktur oder Datenarchitektur bleibt die datengetriebene Entscheidungsfindung ein universelles Leitprinzip. Datenqualität und Benutzerfreundlichkeit sind von größter Bedeutung, um sicherzustellen, dass diese datengetriebenen Entscheidungen auf gültigen Informationen basieren. Dieser Blog beschreibt einige unserer Empfehlungen für den Aufbau von unternehmenstauglichen Datenprodukten, sowohl allgemein als auch speziell mit Databricks.

Datenprodukte liefern letztendlich Wert, wenn Benutzer und Anwendungen die richtigen Daten zur richtigen Zeit, mit der richtigen Qualität und im richtigen Format erhalten. Während dieser Wert traditionell in Form von effizienteren Abläufen durch geringere Kosten, schnellere Prozesse und geminderte Risiken realisiert wurde, können moderne Datenprodukte auch den Weg für neue wertschöpfende Angebote und Möglichkeiten zum Datenaustausch innerhalb der Branche oder des Partner-Ökosystems einer Organisation ebnen.

Datenprodukte

Während Datenprodukte auf verschiedene Weise definiert werden können, stimmen sie typischerweise mit der Definition in DJ Patils Data Jujitsu: The Art of Turning Data into Product: "Um zu beginnen, ..., ist eine gute Definition eines Datenprodukts ein Produkt, das durch die Nutzung von Daten ein Endziel erleichtert" überein. Als solche sind Datenprodukte nicht auf tabellarische Daten beschränkt; sie können auch ML-Modelle, Dashboards usw. sein. Um ein solches Produkt-Denken auf Daten anzuwenden, wird dringend empfohlen, dass jedes Datenprodukt einen Data Product Owner hat.

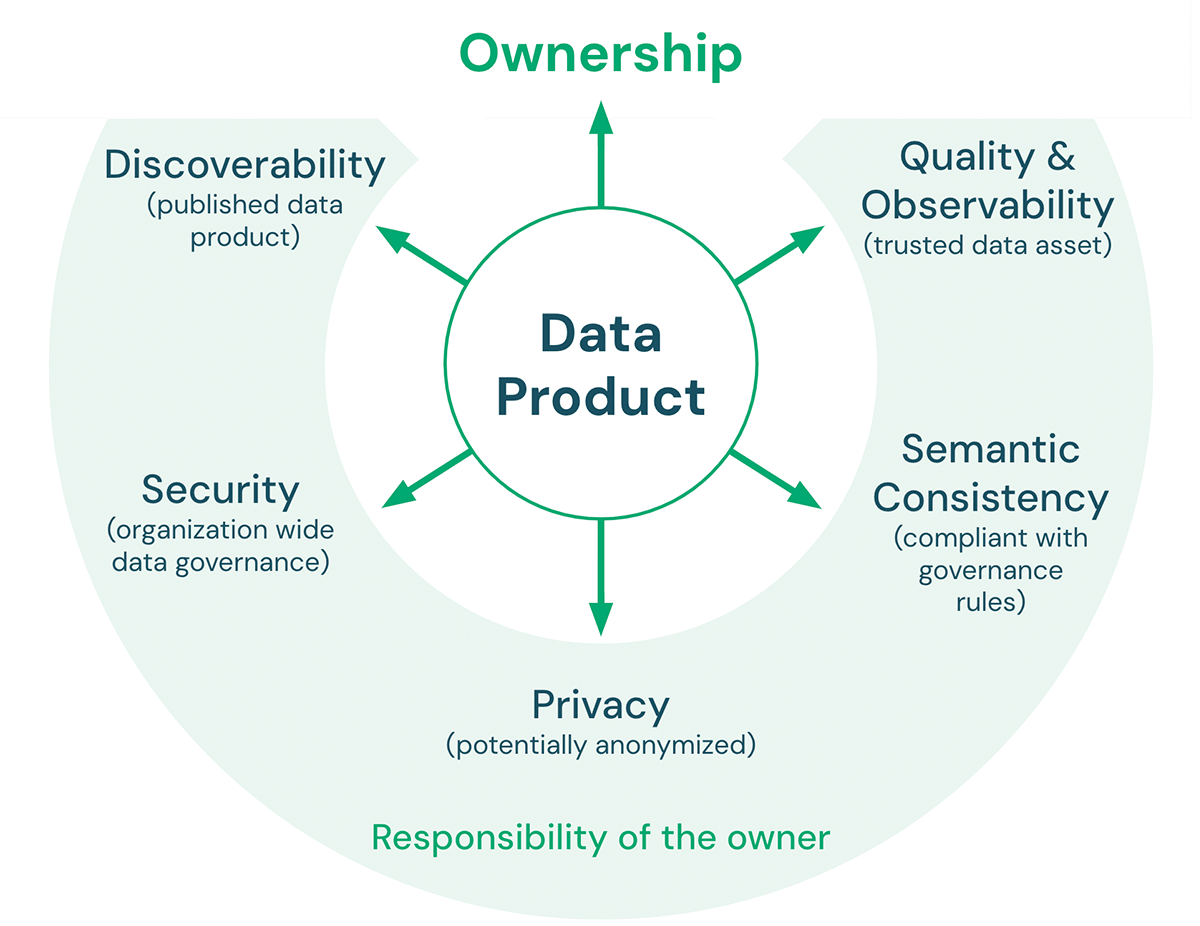

Data Product Owner verwalten die Entwicklung und überwachen die Nutzung und Leistung ihrer Datenprodukte. Dazu müssen sie das zugrunde liegende Geschäft verstehen und in der Lage sein, die Anforderungen der Datennutzer in ein Design für ein qualitativ hochwertiges, einfach zu bedienendes Datenprodukt zu übersetzen. Zusammen mit anderen in der Organisation schließen sie die Lücke zwischen Geschäfts- und technischen Kollegen wie Data Engineers. Der Data Product Owner ist dafür verantwortlich, dass die Produkte in seinem Portfolio die organisatorischen Standards über die Merkmale der Vertrauenswürdigkeit hinweg erfüllen.

Es gibt fünf Hauptmerkmale, die ein Datenprodukt erfüllen muss:

- Qualität und Beobachtbarkeit: Datenqualität umfasst Genauigkeit, Konsistenz, Zuverlässigkeit, Aktualität sowie Klarheit der Dokumentation. Definierte Qualitätsmetriken für das Datenprodukt können überwacht und offengelegt werden, um sicherzustellen, dass die erwartete Datenqualität über die Zeit aufrechterhalten wird. Das Gesamtziel ist es, das Datenprodukt zu einer vertrauenswürdigen Quelle für Datennutzer zu machen.

- Semantische Konsistenz: Ziel einer Lakehouse-Architektur ist es, die Arbeit mit Daten zu erleichtern. Daher sollten Datenprodukte, die zusammen verwendet werden sollen, semantisch konsistent sein. Mit anderen Worten, sie sollten die vereinbarten Governance-Regeln befolgen und gemeinsame Definitionen von Terminologie haben, damit Benutzer diese Datenprodukte sinnvoll und korrekt kombinieren können.

- Datenschutz: Datenschutz betrifft die Vertraulichkeit und Sicherheit von Informationen, einschließlich der Art und Weise, wie Daten gesammelt, geteilt und verwendet werden. Datenschutz wird typischerweise durch Vorschriften und Gesetze (z. B. DSGVO, CCPA) geregelt. Die Einhaltung von Datenschutzregeln kann Themen wie Anonymisierung, Verschlüsselung, Datenresidenz, Datenkennzeichnung (z. B. PII), Speicherung auf bestimmte Umgebungen beschränken und den Zugriff auf eine kleine Anzahl von Mitarbeitern minimieren umfassen.

- Sicherheit: Zusätzlich zur Einrichtung einer Infosec-genehmigten Datenplattform müssen Data Product Owner weiterhin beispielsweise Zugriffsrechte (wer auf die Daten zugreifen kann, mit welchen Partnern die Daten geteilt werden können usw.) und Richtlinien für die akzeptable Nutzung ihrer Datenprodukte definieren.

- Auffindbarkeit: Datenprodukte müssen so veröffentlicht werden, dass jeder in der Organisation sie finden kann. Dies kann Orte wie einen zentralen Datenkatalog oder einen internen Datenmarktplatz umfassen. Data Product Owner sollten mit dem veröffentlichten Produkt Assets bereitstellen, die das Verständnis der Daten und deren Kombination mit anderen Datenprodukten erleichtern (z. B. Beispiel-Notebooks, Dashboards usw.).

Datenproduktlebenszyklus

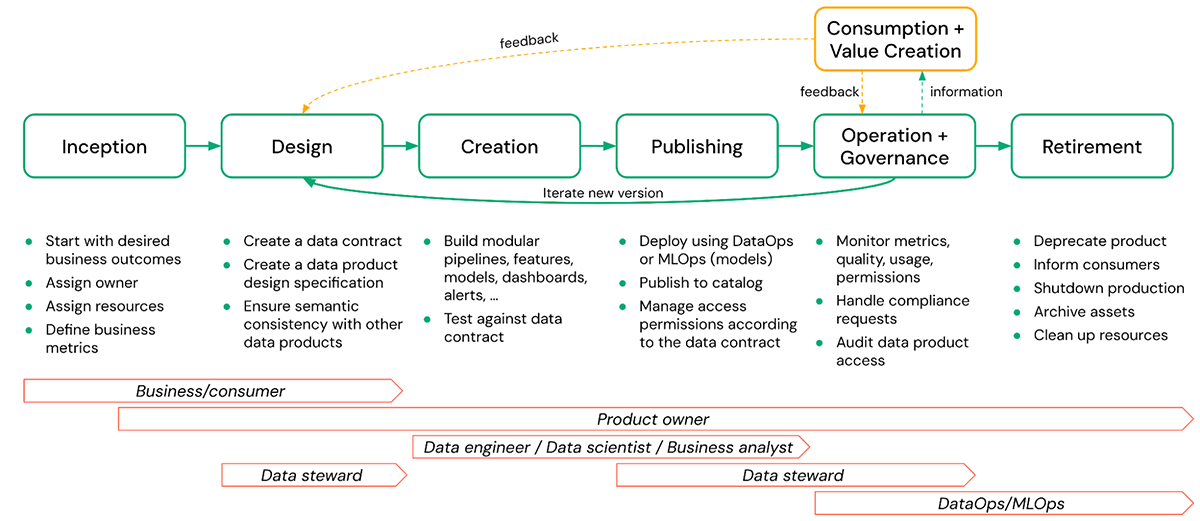

Ein typischer Datenproduktlebenszyklus besteht aus den folgenden Phasen:

- Konzeption – Hier wird der Geschäftswert für ein gewünschtes Datenprodukt definiert und ein Owner zugewiesen. Leistungs- und Qualitätsmetriken sollten ebenfalls für Überwachungszwecke definiert werden.

- Design – In dieser Phase werden konkrete Details wie die Designspezifikation und Datenverträge erstellt, um die Konsistenz mit anderen Datenprodukten zu gewährleisten.

- Erstellung – Die Erstellung des eigentlichen Datenprodukts kann Schemas, Tabellen, Ansichten, Modelle, beliebige Dateien (Volumes), Dashboards usw. sowie die Pipelines, die sie erstellen, umfassen. Diese Phase beinhaltet auch das Testen des resultierenden Datenprodukts anhand des definierten Datenvertrags.

- Veröffentlichung – Die Erstellung und Veröffentlichung eines Datenprodukts werden oft als gleich behandelt, aber sie sind recht unterschiedlich. Diese Phase umfasst Aktivitäten wie die Bereitstellung von Modellen, die Veröffentlichung eines Schemas in einem gemeinsamen Katalog, die Verwaltung von Zugriffsrechten gemäß dem Datenvertrag usw. Die Veröffentlichung sollte ein Release-Management für Versionen von veröffentlichten Datenprodukten beinhalten.

- Betrieb und Governance – Der Betrieb umfasst fortlaufende Aktivitäten wie die Überwachung der Qualitäts-, Zugriffs- und Nutzungsmetriken. Der Governance-Teil umfasst die Bearbeitung von Compliance-bezogenen Anfragen und die Überprüfung des Datenproduktzugriffs usw.

- Nutzung und Wertschöpfung – Das Datenprodukt wird im Geschäft verwendet, um eine Vielzahl von Problemen zu lösen. Benutzer können dem Data Product Owner Feedback basierend auf ihrer Erfahrung mit dem Produkt geben und Verbesserungen empfehlen, die zukünftig weitere Wertschöpfung ermöglichen könnten.

- Außerbetriebnahme – Es kann mehrere Gründe für die Außerbetriebnahme eines Datenprodukts geben, z. B. mangelnde Nutzung, Nichteinhaltung von Vorschriften usw. In jedem Fall sollte das Datenprodukt ordnungsgemäß außer Betrieb genommen werden. Das bedeutet, das Produkt zu deklarieren, die Benutzer zu informieren, Assets zu archivieren und Ressourcen zu bereinigen. Hier ist die Transparenz über nachgelagerte Nutzungen oft wichtig und wird erheblich erleichtert, wenn die Datenherkunft automatisch erfasst wird.

In der obigen Abbildung ist der Data Product Owner für alle Phasen verantwortlich, beginnend mit der Konzeption bis zur Außerbetriebnahme eines Datenprodukts. Nichtsdestotrotz kann die Verantwortung für einzelne Aufgaben mit anderen Stakeholdern wie Data Stewards, Data Engineers usw. geteilt werden.

Best Practices für die Implementierung von Datenprodukten

Die Implementierung hochwertiger Datenprodukte mit Databricks erfordert einen durchdachten Ansatz, der über die reine technische Ausführung hinausgeht. Beginnen Sie mit der Festlegung klarer Verantwortlichkeiten, mit engagierten Data Product Ownern, die sowohl Geschäftsbedürfnisse als auch technische Anforderungen verstehen. Definieren Sie im Voraus umfassende Datenverträge, die Qualitätsmetriken, Schema-Definitionen, Nutzungsrichtlinien und Sicherheitsparameter enthalten, um die Abstimmung zwischen Produzenten und Konsumenten zu gewährleisten.

Nutzen Sie beim Erstellen von Pipelines Delta Live Tables (DLT) mit Qualitätskontrollen, die direkt in Ihrem Code implementiert sind, und verwenden Sie integrierte Erwartungen und Einschränkungen, um Daten in jeder Phase zu validieren. Implementieren Sie einen gestaffelten Entwicklungsansatz mit separaten Entwicklungs-, Test- und Produktionsumgebungen, um die Qualität vor der Veröffentlichung sicherzustellen. Automatisieren Sie die Überwachung mit Lakehouse Monitoring und richten Sie Warnmeldungen für Qualitätsmetrik-Schwellenwerte ein, um Probleme frühzeitig zu erkennen.

Dokumentieren Sie umfassend innerhalb von Unity Catalog, indem Sie sowohl technische Spezifikationen als auch Geschäftskontexte verwenden, um Benutzern das Verständnis und die korrekte Nutzung Ihrer Datenprodukte zu erleichtern. Zur Effizienz der Governance standardisieren Sie Namenskonventionen und Metadaten über Datenprodukte hinweg, um die Auffindbarkeit und Interoperabilität zu verbessern. Implementieren Sie schließlich eine formelle Feedbackschleife mit den Konsumenten, um Ihre Datenprodukte basierend auf tatsächlichen Nutzungsmustern und Benutzerbedürfnissen kontinuierlich zu verbessern.

Die Databricks Data Intelligence Platform kann für mehrere Aktivitäten im Datenproduktlebenszyklus genutzt werden:

- ETL-Pipelines – Delta Live Tables (DLT) können zum Erstellen robuster und qualitätskontrollierter Datenpipelines verwendet werden. Auto Loader und Streaming-Tabellen können verwendet werden, um Daten inkrementell in die Bronze-Schicht für DLT-Pipelines oder Databricks SQL-Abfragen zu laden.

- Governance – Databricks Unity Catalog ist funktionsreich und wurde entwickelt, um eine einfache und einheitliche Governance im gesamten Unternehmen zu ermöglichen. Catalog Explorer kann für die Datenentdeckung verwendet werden, und Zugriffskontrollmechanismen erleichtern die Veröffentlichung der Datenprodukte für die vorgesehenen Konsumenten. Lineage und System Tables werden automatisch verfolgt und sind für die operative Governance unerlässlich.

- Monitoring – Lakehouse Monitoring bietet eine einzige und einheitliche Lösung zur Überwachung der Qualität von Daten- und KI-Assets. Ein solcher proaktiver Ansatz ist notwendig, um die Bedingungen des Datenvertrags zu erfüllen.

Für einige Aktivitäten des Datenproduktlebenszyklus, wie z. B. das Design des Datenprodukts und des Datenvertrags, bietet Databricks derzeit keine Funktionen zur Unterstützung. Diese Prozesse sollten außerhalb der Databricks-Plattform durchgeführt und die Ergebnisse dann in Unity Catalog dokumentiert werden, sobald das Datenprodukt veröffentlicht wurde.

Datenverträge

Ein Datenvertrag ist ein formeller Weg, um Domänen abzustimmen und föderierte Governance zu implementieren. Der Datenproduzent sollte ihn bereitstellen; er sollte jedoch mit Blick auf den Konsumenten entworfen werden. Der Vertrag sollte so formuliert sein, dass er für alle Arten von Benutzern verständlich ist.

Ein typischer Datenvertrag hat die folgenden Attribute:

- Datenbeschreibung (Name, Beschreibung, Quellsysteme, Attributauswahl, …)

- Datenschema (Tabellen, Spalten, Informationen zur Anonymisierung und Verschlüsselung, Filter, Masken, …) und Datenformate (semi-strukturierte und unstrukturierte Daten)

- Nutzungsrichtlinien (Tags, PII, Richtlinien, Datenresidenz, …)

- Datenqualität (angewendete Qualitätsprüfungen und -beschränkungen, Qualitätsmetriken, …)

- Sicherheit (wer darf das Datenprodukt nutzen)

- Daten-SLAs (letzte Aktualisierung, Ablaufdaten, Aufbewahrungszeit, …)

- Verantwortlichkeiten (Eigentümer, Betreuer, Eskalationskontakt, Änderungsprozess, …)

Darüber hinaus können unterstützende Assets wie Notebooks, Dashboards usw. bereitgestellt werden, um dem Konsumenten das Verständnis und die Analyse des Datenprodukts zu erleichtern und somit die Akzeptanz zu fördern.

Data Governance Team

Ein Data Governance Team in einem Unternehmen besteht in der Regel aus Vertretern verschiedener Gruppen wie Business Owner, Compliance- und Sicherheitsexperten sowie Datenexperten. Dieses Team sollte als Center of Excellence (CoE) für Compliance- und Datensicherheitsthemen fungieren und den Data Product Owner unterstützen, der für das Datenprodukt verantwortlich ist. Sie spielen eine entscheidende Rolle bei der Ausgestaltung des Datenvertrags, indem sie die Nutzungsrichtlinien erweitern und die Entscheidung beeinflussen, wer das Datenprodukt nutzen darf. Für große Organisationen kann ein solches Team bei der Steuerung und Standardisierung des Prozesses zur Ausgestaltung von Datenverträgen im Einklang mit globalen Funktionen wie einem Datenmanagementbüro helfen.

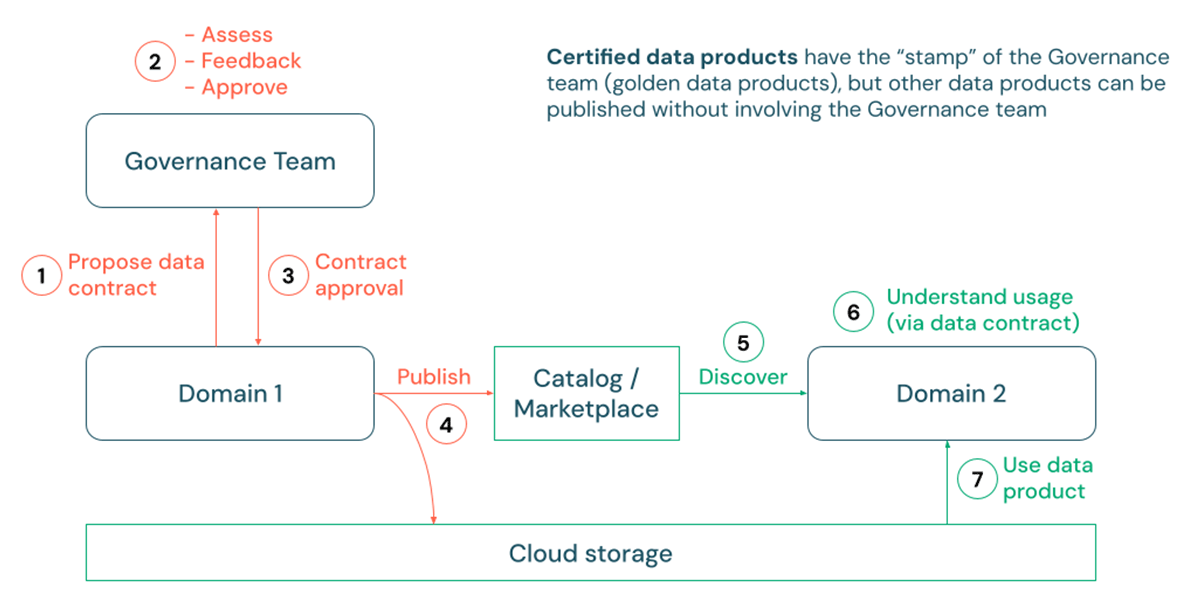

Veröffentlichung und Zertifizierung

Trotz etablierter Datenverträge bleibt die Governance von Datenprodukten ein breites Thema, das Aspekte wie Zugriffskontrollen, Klassifizierung von persönlich identifizierbaren Informationen (PII) und verschiedene Nutzungsrichtlinien umfasst, die zwischen Organisationen variieren können. Ein konsistenter Trend, den wir beobachtet haben, betrifft jedoch die Veröffentlichung von Datenprodukten. Da Konsumenten eine wachsende Anzahl von Datensätzen vorfinden, benötigen sie oft die Zusicherung, dass die Daten kuratiert, standardisiert und offiziell zur Nutzung freigegeben sind. Beispielsweise kann ein Reporting- oder Master-Data-Management-Anwendungsfall innerhalb einer großen Organisation ein hohes Maß an semantischer Konsistenz und Interoperabilität zwischen verschiedenen Datenassets im Unternehmen erfordern.

Hier kann das Konzept der Datenprodukt-'Zertifizierung' für bestimmte Datenprodukte wertvoll werden. Bei diesem Prozess können Datenproduzenten zunächst eine Datenvertragsspezifikation vorschlagen, die in der Regel von einem Data Governance Steward oder Team geprüft wird. Nach der Genehmigung können Continuous Integration/Continuous Deployment (CI/CD)-Prozesse ausgeführt werden, um Produktionspipelines bereitzustellen, die Daten physisch in die Cloud-Speicherkonten des Kunden schreiben. Diese Daten können dann veröffentlicht und einfach über Unity Catalog-Tabellen, -Ansichten oder sogar Volumes für nicht-tabellarische Daten entdeckt werden. In diesem Zusammenhang unterstützt Unity Catalog die Verwendung von Tags sowie Markdown, um den Zertifizierungsstatus und die Details eines Datenprodukts anzugeben.

Einige Kunden entscheiden sich möglicherweise sogar dafür, ihre zertifizierten Datenprodukte zu bewerben, indem sie ein entsprechendes privates Angebot im Databricks Marketplace mit umfassenden Anleitungen und Anwendungsbeispielen veröffentlichen. Darüber hinaus erleichtern die REST-APIs von Databricks und Integrationen mit Enterprise-Kataloglösungen wie Alation, Atlan und Collibra die einfache Auffindbarkeit zertifizierter Datenprodukte über mehrere Kanäle, auch außerhalb von Databricks.

Anwendungsfälle und Erfolgsgeschichten

Automobil: Rivians Vehicle Intelligence Platform

Rivian, der Hersteller von Elektrofahrzeugen, nutzt Databricks zur Verarbeitung von IoT-Sensordaten von über 25.000 Fahrzeugen auf der Straße, die täglich Terabytes an Daten generieren. Ihr ADAS-Team (Advanced Driver-Assistance Systems) nutzt diese Plattform zur Analyse von Telemetriedaten, einschließlich Informationen über Neigung, Rollen, Geschwindigkeit, Federung und Airbag-Aktivität, was Rivian hilft, die Fahrzeugleistung und Fahrverhalten zu verstehen. Durch die Nutzung der Databricks Lakehouse Platform haben sie eine Steigerung der Laufzeitleistung um 30 % bis 50 % erzielt, was zu schnelleren Erkenntnissen und verbesserter Modellgenauigkeit führt. Dieser datengesteuerte Ansatz ermöglicht es Rivian, vorausschauende Wartung zu implementieren, die Zuverlässigkeit von Komponenten zu optimieren und das Kundenerlebnis kontinuierlich zu verbessern.

Gesundheitswesen: Walgreens' Personalisierung von Rezepten

Walgreens, eine der größten Apothekenketten Amerikas, hat sein Patientenerlebnis mit Databricks transformiert, um Verschreibungsdaten in massivem Umfang zu verarbeiten. Mit über 825 Millionen jährlich ausgefüllten Rezepten in fast 9.000 Filialen hat Walgreens seine Information, Data and Insights (IDI)-Plattform auf Databricks aufgebaut, um 40.000 Datenereignisse pro Sekunde zu verarbeiten. Dies hat seine Lieferkette optimiert, indem Lagerbestände richtig dimensioniert wurden, um Millionen von Dollar zu sparen, und die Produktivität der Apotheker um 20 % gesteigert wurde. Die Plattform ermöglicht es Apothekern, eine bessere Versorgung mit robusten Patientenprofilen zu bieten, die Wechselwirkungsalarme bei Medikamenten, Änderungen von Medikamentenprofilen und andere kritische Informationen für ein sichereres Verschreibungsmanagement enthalten.

Fertigung: Mahindras KI-gestützte Analysen

Mahindra & Mahindra Limited, ein globaler Fertigungskonglomerat, hat unternehmensweite KI-Lösungen mit Databricks implementiert, um die Abläufe in seinem gesamten Unternehmen zu verbessern. Ihr GenAI-Bot für Finanzanalysten hat zu einer Reduzierung der Zeit für Routineaufgaben um 70 % geführt, wodurch Teams sich auf strategische Initiativen mit höherem Wert konzentrieren können. Das Unternehmen nutzt die Databricks Data Intelligence Platform für mehrere Anwendungsfälle, darunter ein Voice-of-the-Customer-Chatbot, der mit dem Open-Source-LLM DBRX von Databricks erstellt wurde und sowohl interne Daten über Delta Lake als auch externe Daten von Websites und sozialen Medien integriert. Dieser umfassende Ansatz hilft Mahindra, Wachstum zu fördern, Kundenerlebnisse zu verbessern und die operative Effizienz zu optimieren.

Telekommunikation: T-Mobiles Data Mesh Architektur

T-Mobile hat erfolgreich eine Data Mesh Architektur mit Databricks implementiert, um den Datenzugriff zu demokratisieren und gleichzeitig Sicherheit und Governance zu gewährleisten. Der Telekommunikationsriese integrierte seinen Lakehouse in ein Data Mesh unter Verwendung von Unity Catalog und Delta Sharing, wodurch Teams im gesamten Unternehmen auf Daten zugreifen und diese nutzen können, während ein rationales und leicht verständliches Sicherheitsmodell beibehalten wird. Dieser Ansatz hat es den Domänenteams ermöglicht, ihre eigenen Datenprodukte zu erstellen und zu verwalten, während eine konsistente Governance sichergestellt wird, was die Analyseinitiativen im gesamten Unternehmen beschleunigt und die datengesteuerte Entscheidungsfindung verbessert.

Zukünftige Trends bei Datenprodukten

Die Zukunft von Datenprodukten wird von mehreren aufkommenden Trends geprägt, die beeinflussen werden, wie Organisationen Plattformen wie Databricks nutzen. Echtzeit-Datenprodukte gewinnen an Bedeutung, da Unternehmen zunehmend aktuelle Einblicke benötigen und Streaming-Architekturen zum Standard für kritische operative Datenprodukte werden. Wir beobachten auch den Aufstieg der Self-Service-Erstellung von Datenprodukten, bei denen Fachexperten aus den Geschäftsbereichen Low-Code/No-Code-Schnittstellen verwenden, um Datenprodukte zu definieren und zu erstellen, während Governance-Richtlinien eingehalten werden.

KI-gestützte Datenprodukte, die automatisch Machine-Learning-Funktionen und Erkenntnisse integrieren, werden immer häufiger, wodurch die Grenze zwischen traditionellen Daten und KI-Assets verschwimmt. Data-Mesh-Architekturen reifen, und Organisationen implementieren eine föderierte rechnergestützte Governance, die zentrale Standards mit Domänenautonomie in Einklang bringt. Domänenübergreifende Datenprodukte, die sicher Unternehmensgrenzen überschreiten, entstehen, wobei Data Clean Rooms und datenschutzfreundliche Berechnungen neue kollaborative Erkenntnisse ermöglichen.

Datenverträge entwickeln sich weiter, um anspruchsvollere Qualitätsgarantien, Datenschutzkontrollen und Nutzungsrechte einzuschließen und werden zu ausführbaren Spezifikationen anstelle von statischen Dokumentationen. Eingebettete Analysen innerhalb operativer Anwendungen nehmen zu, wobei Datenprodukte speziell dafür entwickelt werden, Einblicke innerhalb der App zu liefern, anstatt separate Analyseumgebungen zu nutzen. Schließlich werden nachhaltige Metriken in Datenprodukte integriert, die die Umweltauswirkungen neben traditionellen Geschäftskennzahlen verfolgen, um ESG-Berichterstattung und grüne Initiativen zu unterstützen.

Fazit

Die Formulierung von Datenprodukten und Datenverträgen kann in einem großen Unternehmensumfeld zu komplexen Aufgaben werden. Angesichts des Aufkommens neuer Technologien für die Schnittstellenverwaltung von Daten, gepaart mit modernen Geschäfts- und regulatorischen Anforderungen, entwickeln sich die Spezifikationen für Datenprodukte und Verträge ständig weiter. Heute dienen Databricks Marketplace und Unity Catalog als Kernkomponenten für die Datenentdeckung und das Onboarding von Datennutzern. Für Datenerzeuger bietet Unity Catalog wesentliche Unternehmens-Governance-Funktionen, einschließlich Lineage, Auditing und Zugriffskontrollen.

Da sich Datenprodukte über einfache Tabellen oder Dashboards hinaus auf KI-Modelle, Streams und mehr erstrecken, können Kunden von einer einheitlichen und konsistenten Governance-Erfahrung auf Databricks für alle wichtigen Benutzer-Personas profitieren.

Die wichtigsten Aspekte von Unternehmensdatenprodukten, die in diesem Blog hervorgehoben werden, können als Leitprinzipien dienen, wenn Sie sich dem Thema nähern. Um mehr über die Erstellung hochwertiger Datenprodukte mit der Databricks Data Intelligence Platform zu erfahren, wenden Sie sich an Ihren Databricks-Ansprechpartner.

FAQ

Was ist der Unterschied zwischen einem Datenprodukt und einem regulären Datensatz?

Ein Datenprodukt geht über die reine Bereitstellung von Daten hinaus; es wird mit Blick auf spezifische Benutzerbedürfnisse entwickelt, enthält Qualitätsgarantien, Dokumentation und Support-Elemente. Im Gegensatz zu einem regulären Datensatz hat ein Datenprodukt klare Verantwortlichkeiten, definierte SLAs und wird aktiv während seines gesamten Lebenszyklus verwaltet, um sicherzustellen, dass es weiterhin die Bedürfnisse der Nutzer erfüllt.

Wer sollte die Verantwortung für Datenprodukte in unserer Organisation übernehmen?

Datenprodukte sollten von Personen verantwortet werden, die sowohl die geschäftlichen Domänen als auch die technischen Aspekte der Daten verstehen. Diese Data-Product-Owner sind für Qualität, Benutzerfreundlichkeit und die Ausrichtung auf Geschäftsziele verantwortlich. Abhängig von Ihrer Organisationsstruktur können sie innerhalb der Geschäftsbereiche (in einem Data-Mesh-Ansatz) oder innerhalb eines zentralen Datenteams angesiedelt sein.

Wie messen wir den Erfolg unserer Datenprodukte?

Erfolgsmetriken sollten sowohl technische Aspekte (Qualität, Verfügbarkeit, Leistung) als auch Kennzahlen zur Geschäftsauswirkung umfassen. Verfolgen Sie Nutzungsmuster, Benutzerzufriedenheit, die Zeit bis zur Erkenntnisgewinnung für Nutzer und direkte Geschäftsergebnisse, die durch das Datenprodukt ermöglicht werden. Legen Sie Basiswerte vor der Implementierung fest und messen Sie Verbesserungen im Laufe der Zeit.

Welche Rolle spielt Unity Catalog bei der Verwaltung von Datenprodukten?

Unity Catalog dient als Grundlage für die Governance von Datenprodukten, indem es zentrales Metadatenmanagement, Zugriffskontrollen, Lineage-Tracking und Discovery-Funktionen bereitstellt. Es ermöglicht Ihnen, Datenverträge durch Funktionen wie Tagging, Kommentare und Schemadefinitionen zu implementieren und bietet gleichzeitig die für Unternehmensdatenprodukte erforderliche Auditierbarkeit und Compliance-Kontrollen.

Wie gehen wir mit Änderungen an veröffentlichten Datenprodukten um?

Implementieren Sie formale Versions- und Änderungsmanagementprozesse für Datenprodukte. Kommunizieren Sie Änderungen im Voraus an die Nutzer, behalten Sie nach Möglichkeit die Abwärtskompatibilität bei und stellen Sie Migrationspfade für Breaking Changes bereit. Nutzen Sie die Funktionen von Unity Catalog, um Versionen zu verfolgen und den Übergang zwischen ihnen zu verwalten.

Können wir Datenprodukte erstellen, ohne eine vollständige Data-Mesh-Architektur zu übernehmen?

Absolut. Während Data Mesh die Domänenverantwortung für Datenprodukte betont, können Sie Produktgedanken auf Ihre Datenassets anwenden, unabhängig von Ihrer Organisationsstruktur. Konzentrieren Sie sich auf die Benutzerbedürfnisse, die Qualität und die Benutzerfreundlichkeit Ihrer Daten und implementieren Sie klare Verantwortlichkeiten und Governance – diese Prinzipien schaffen Wert, auch ohne eine vollständige Data-Mesh-Implementierung.

Wie stellen wir sicher, dass unsere Datenprodukte mit sich entwickelnden Vorschriften konform bleiben?

Integrieren Sie Compliance in Ihren Datenproduktlebenszyklus mit regelmäßigen Überprüfungen durch Ihr Governance-Team. Implementieren Sie Metadaten-gesteuerte Kontrollen in Unity Catalog, um Richtlinien automatisch durchzusetzen, und nutzen Sie Lineage-Funktionen, um die Auswirkungen von regulatorischen Änderungen auf Ihre Datenprodukte zu verstehen. Dokumentieren Sie Compliance-Anforderungen in Ihren Datenverträgen und überwachen Sie die Einhaltung durch Audit-Protokolle.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.