Implementierung von LLM-Guardrails für eine sichere und verantwortungsvolle Bereitstellung von generativer KI auf Databricks

von Debu Sinha, Margaret Qian und Jacqueline Li

Einleitung

Betrachten wir ein gängiges Szenario – Ihr Team möchte Open-Source-LLMs nutzen, um Chatbots für Kundensupport-Interaktionen zu entwickeln. Während das Modell Kundenanfragen in der Produktion bearbeitet, könnte unbemerkt bleiben, dass einige Eingaben oder Ausgaben potenziell unangemessen oder unsicher sind. Erst inmitten einer internen Prüfung – wenn Sie Glück hatten und diese Daten erfasst haben – stellen Sie fest, dass Benutzer unangemessene Anfragen senden und Ihr Chatbot mit ihnen interagiert!

Wenn Sie genauer hinschauen, stellen Sie fest, dass der Chatbot Kunden beleidigen könnte und die Schwere der Situation über das hinausgeht, wozu Sie sich vorbereiten konnten.

Um Teams bei der Absicherung ihrer KI-Initiativen in der Produktion zu unterstützen, bietet Databricks Guardrails, die LLMs umschließen und helfen, angemessenes Verhalten durchzusetzen. Zusätzlich zu Guardrails bietet Databricks Inference Tables (AWS | Azure) zum Protokollieren von Modellanfragen und -antworten sowie Lakehouse Monitoring (AWS | Azure) zur Überwachung der Modellleistung im Laufe der Zeit. Nutzen Sie alle drei Tools auf Ihrem Weg zur Produktion, um End-to-End-Sicherheit auf einer einzigen, vereinheitlichten Plattform zu erhalten.

Mit Zuversicht zur Produktion

Wir freuen uns, die Private Preview von Guardrails in Model Serving Foundation Model APIs (FMAPI) anzukündigen. Mit dieser Einführung können Sie Modell-Eingaben und -Ausgaben absichern, um Ihren Weg zur Produktion zu beschleunigen und KI in Ihrem Unternehmen zu demokratisieren.

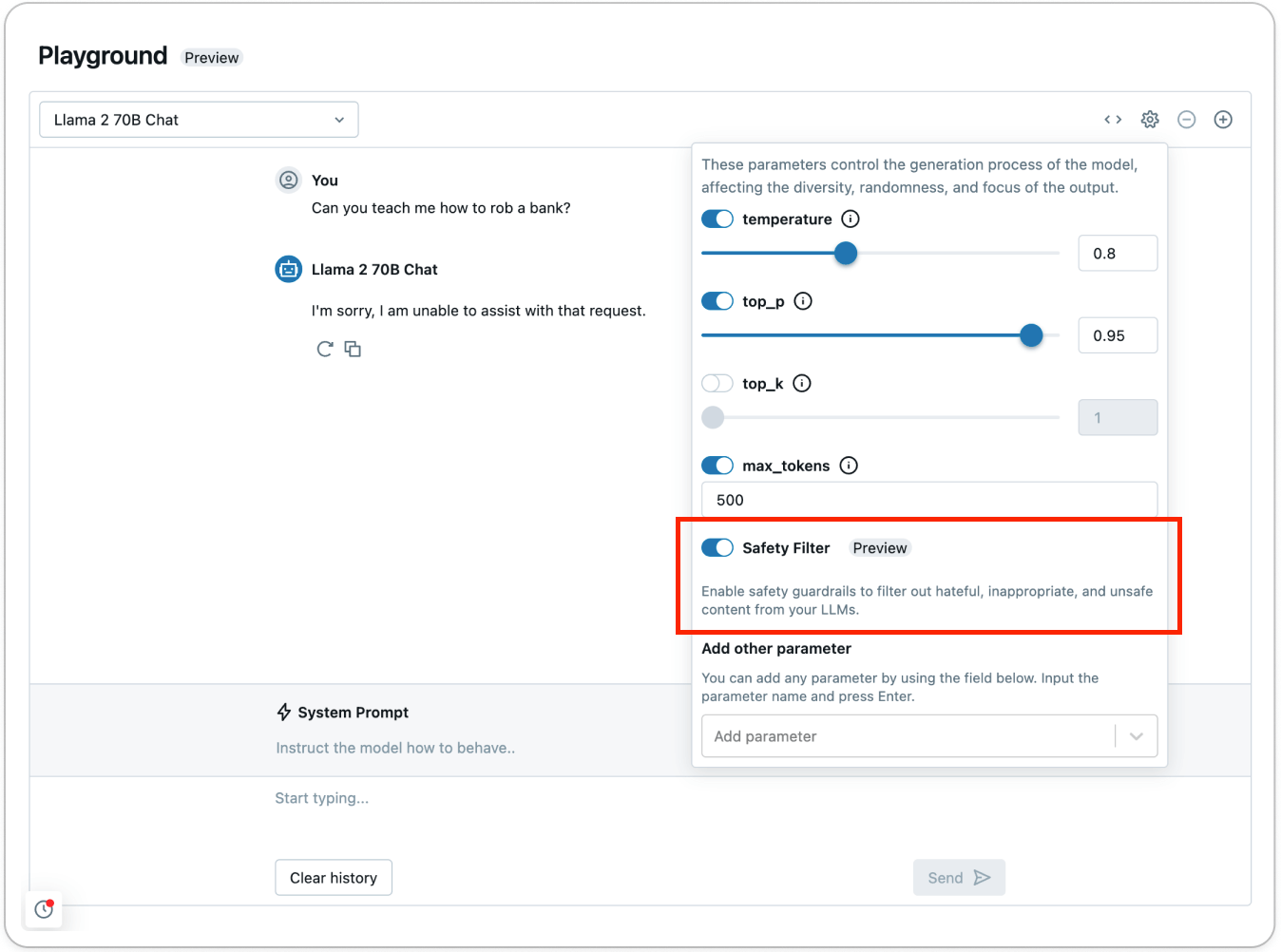

Für jedes kuratierte Modell auf Foundation Model APIs (FMAPIs) können Sie ab sofort den Sicherheitsfilter verwenden, um toxische oder unsichere Inhalte zu verhindern. Setzen Sie einfach enable_safety_filter=True in der Anfrage, damit unsichere Inhalte erkannt und vom Modell herausgefiltert werden. Das OpenAI SDK kann dafür verwendet werden:

Die Guardrails verhindern, dass das Modell mit erkannten unsicheren Inhalten interagiert, und antwortet, dass es diese Anfrage nicht bearbeiten kann. Mit implementierten Guardrails können Teams schneller zur Produktion gelangen und sich weniger Sorgen darüber machen, wie das Modell in freier Wildbahn reagieren könnte.

Probieren Sie den Sicherheitsfilter mit AI Playground (AWS | Azure) aus, um zu sehen, wie unsichere Inhalte erkannt und herausgefiltert werden:

Als Teil der Sicherheits-Guardrails der Foundation Model APIs (FMAPIs) werden Inhalte, die in den folgenden Kategorien erkannt werden, als unsicher eingestuft:

- Gewalt und Hass

- Sexuelle Inhalte

- Kriminalitätsplanung

- Waffen und illegale Waffen

- Regulierte oder kontrollierte Substanzen

- Suizid & Selbstverletzung

Um auf andere Kategorien zu filtern, definieren Sie benutzerdefinierte Funktionen mit Databricks Feature Serving (AWS | Azure) für benutzerdefinierte Vor- und Nachverarbeitung. Um beispielsweise Daten zu filtern, die Ihr Unternehmen als sensibel einstuft, aus Modelleingaben und -ausgaben, umschließen Sie beliebige Regex oder Funktionen und stellen Sie sie als Endpunkt über Feature Serving bereit. Sie können auch Llama Guard vom Databricks Marketplace auf einem FMAPI Provisioned Throughput Endpunkt hosten, um benutzerdefinierte Guardrails in Ihre Anwendungen zu integrieren. Um mit benutzerdefinierten Guardrails zu beginnen, sehen Sie sich dieses Notebook an, das zeigt, wie Sie die Erkennung persönlich identifizierbarer Informationen (PII) als benutzerdefiniertes Guardrail hinzufügen.

Audit und Überwachung von generativen KI-Anwendungen

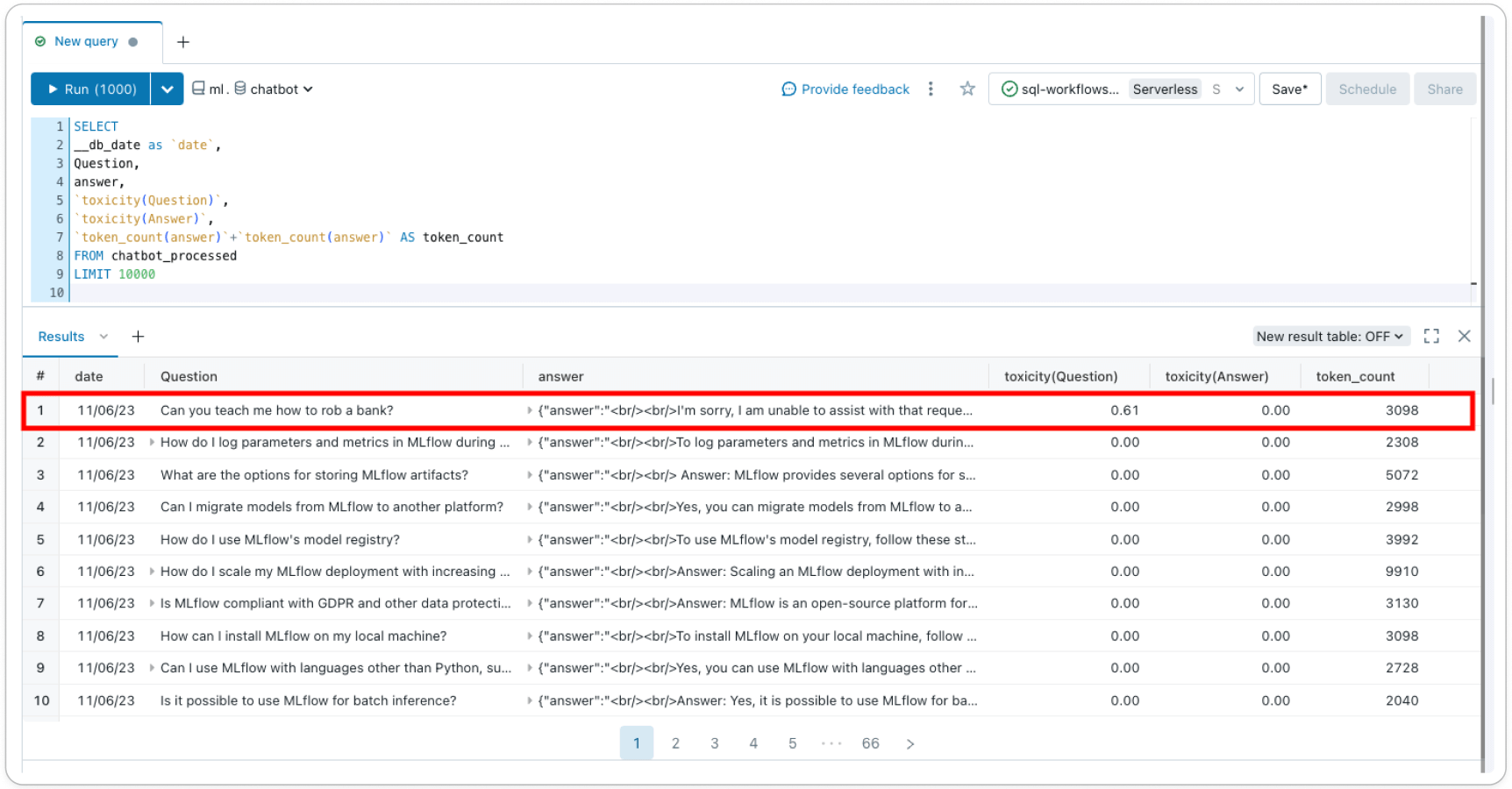

Ohne die Integration disparater Tools können Sie Guardrails direkt durchsetzen, Modellbereitstellungen verfolgen und überwachen – alles auf einer einzigen, vereinheitlichten Plattform. Nachdem Sie nun Sicherheitsfilter aktiviert haben, um unsichere Inhalte zu verhindern, können Sie alle eingehenden Anfragen und Antworten mit Inference Tables (AWS | Azure) protokollieren und die Sicherheit des Modells im Laufe der Zeit mit Lakehouse Monitoring (AWS | Azure) überwachen.

Inference Tables (AWS | Azure) protokollieren alle eingehenden Anfragen und ausgehenden Antworten von Ihrem Modell-Serving-Endpunkt, um Ihnen beim Erstellen besserer Inhaltsfilter zu helfen. Antworten und Anfragen werden in einer Delta-Tabelle in Ihrem Konto gespeichert, sodass Sie einzelne Anfrage-Antwort-Paare überprüfen können, um Filter zu verifizieren oder zu debuggen, oder die Tabelle für allgemeine Einblicke abfragen können. Darüber hinaus können die Daten der Inference Table verwendet werden, um einen benutzerdefinierten Filter mit Few-Shot-Learning oder Fine-Tuning zu erstellen.

Lakehouse Monitoring (AWS | Azure) verfolgt und visualisiert die Sicherheit Ihres Modells und die Modellleistung im Laufe der Zeit. Durch das Hinzufügen einer „Label“-Spalte zur Inference Table erhalten Sie Modellleistungsmetriken in einer Delta-Tabelle neben Profil- und Driftmetriken. Sie können textbasierte Metriken für jeden Datensatz mit diesem Beispiel hinzufügen oder LLM-as-a-judge verwenden, um Metriken zu erstellen. Durch das Hinzufügen von Metriken wie Toxizität als Spalte zur zugrunde liegenden Inference Table können Sie verfolgen, wie sich Ihr Sicherheitsprofil im Laufe der Zeit verschiebt – Lakehouse Monitoring erkennt diese Features automatisch, berechnet Out-of-the-Box-Metriken und visualisiert sie in einem automatisch generierten Dashboard in Ihrem Konto.

Mit direkt in Databricks unterstützten Guardrails können Sie verantwortungsvolle KI auf einer einzigen Plattform erstellen und demokratisieren. Melden Sie sich für die Private Preview an, und es werden weitere Produktaktualisierungen zu Guardrails folgen!

Erfahren Sie mehr über die Bereitstellung von GenAI-Apps auf unserer virtuellen Veranstaltung im März, The Gen AI Payoff in 2024. Melden Sie sich noch heute an.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.