Costruisci velocemente applicazioni AI di nuova generazione con le nuove funzionalità di Foundation Model

Accedi, governa e monitora qualsiasi modello di base con il Model Serving di Databricks

di Ahmed Bilal, Asfandyar Qureshi, Margaret Qian, Jianwei Xie, Sue Ann Hong, Vladimir Kolovski, Mingyu Li e Ankit Mathur

Sulla scia degli annunci della scorsa settimana sulla Retrieval Augmented Generation (RAG), siamo entusiasti di annunciare importanti aggiornamenti a Model Serving. Il Model Serving di Databricks ora offre una interfaccia unificata, semplificando la sperimentazione, la personalizzazione e la messa in produzione dei modelli di base su tutti i cloud e i provider. Ciò significa che è possibile creare app GenAI di alta qualità utilizzando il modello migliore per il proprio caso d'uso, sfruttando in modo sicuro i dati esclusivi della propria organizzazione.

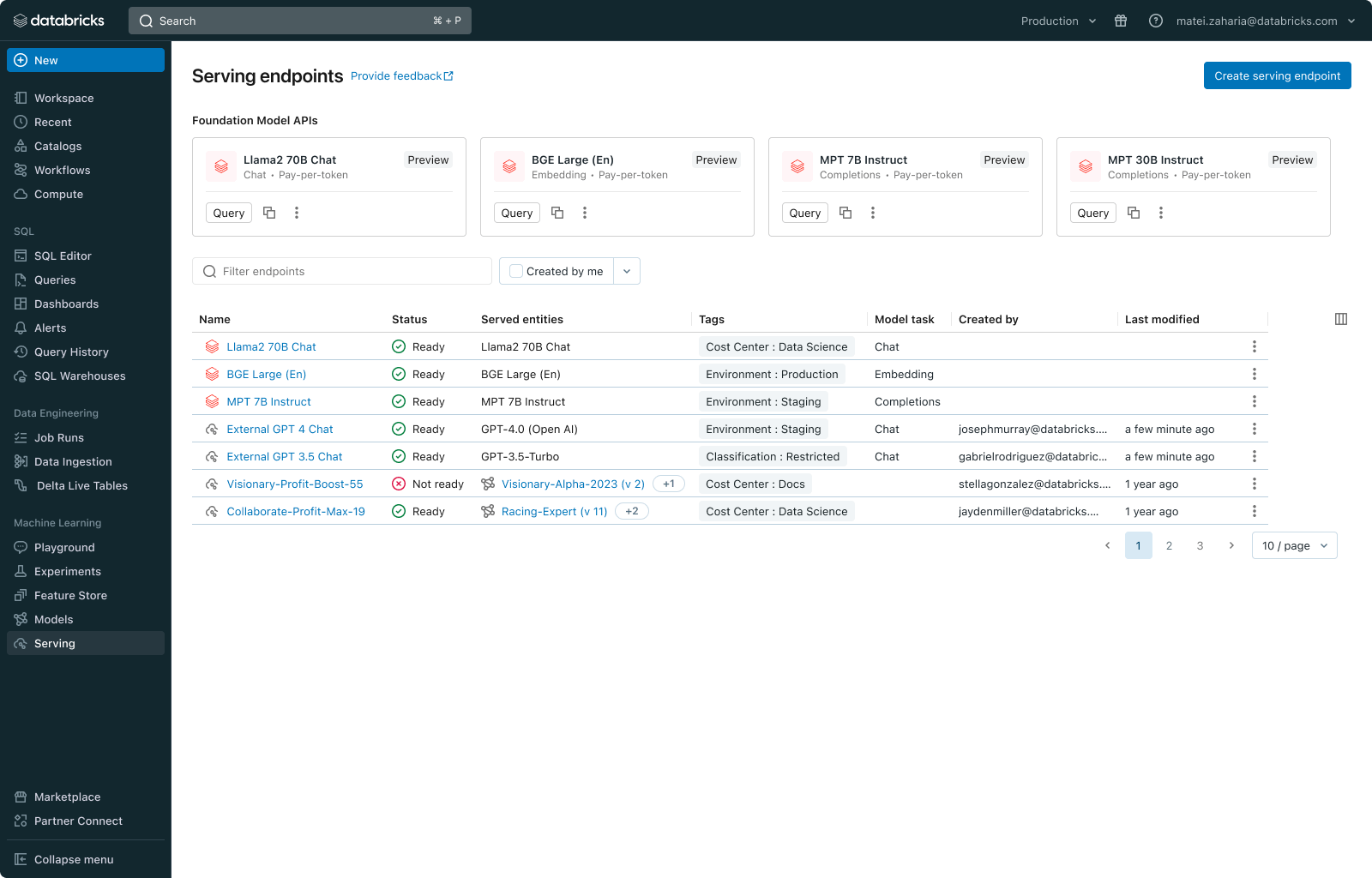

La nuova interfaccia unificata consente di gestire tutti i modelli in un unico posto ed eseguire query su di essi con una singola API, indipendentemente dal fatto che si trovino su Databricks o siano ospitati esternamente. Inoltre, stiamo rilasciando le API dei Foundation Model che forniscono accesso immediato ai modelli linguistici di grandi dimensioni (LLM) più diffusi, come i modelli Llama2 e MPT, direttamente da Databricks. Queste API offrono opzioni di prezzi on-demand, come il pagamento per token o il throughput con provisioning, riducendo i costi e aumentando la flessibilità.

Start a creare app GenAI oggi stesso! Visita il Databricks AI Playground per provare rapidamente i modelli di IA generativa direttamente dal tuo workspace.

Sfide legate alla messa in produzione dei modelli di base

Il software ha rivoluzionato ogni settore industriale e crediamo che l'IA trasformerà presto il software esistente per renderlo più intelligente. Le implicazioni sono ampie e variegate, con un impatto su tutto, dall'assistenza clienti alla sanità e all'istruzione. Sebbene molti dei nostri clienti abbiano già iniziato a integrare l'IA nei loro prodotti, il passaggio alla produzione su larga scala presenta ancora diverse sfide:

- Sperimentazione su più modelli: ogni caso d'uso richiede una sperimentazione per identificare il modello migliore tra le diverse opzioni open source e proprietarie. Le aziende devono poter sperimentare rapidamente su più modelli, il che include la gestione di credenziali, limiti di velocità, autorizzazioni e sintassi delle query di diversi fornitori di modelli.

- Mancanza di contesto aziendale: i modelli di base hanno una conoscenza ampia, ma mancano di informazioni interne e di competenze specifiche del settore. Usati così come sono, non soddisfano pienamente i requisiti aziendali unici.

- Operativizzazione dei modelli: le richieste e le risposte del modello devono essere monitorate costantemente per motivi di qualità, debugging e sicurezza. Le differenze tra le interfacce dei modelli rendono difficili la governance e l'integrazione.

Model Serving di Databricks: serving unificato per qualsiasi Foundation Model

Databricks Model Serving è già utilizzato in produzione da centinaia di aziende per un'ampia gamma di casi d'uso, tra cui modelli linguistici di grandi dimensioni e applicazioni di visione artificiale. Con l'ultimo aggiornamento, stiamo semplificando notevolmente la query, la gestione e il monitoraggio di qualsiasi modello di base.

“Con Databricks Model Serving, siamo in grado di integrare l'AI generativa nei nostri processi per migliorare l'esperienza del cliente e aumentare l'efficienza operativa. Model Serving ci consente di implementare modelli LLM mantenendo il pieno controllo sui nostri dati e modelli.” — Ben Dias, Direttore di Data Science e analitiche di easyJet

Accedi a qualsiasi modello di base

Model Serving di Databricks supporta qualsiasi Foundation Model, che si tratti di un modello completamente personalizzato, di un modello gestito da Databricks o di un Foundation Model di terze parti. Questa flessibilità consente di scegliere il modello giusto per il job giusto, mantenendo un vantaggio rispetto ai futuri progressi nella gamma di modelli disponibili. Per realizzare questa visione, oggi presentiamo due nuove funzionalità:

- APIs Foundation Model: le APIs Foundation Model forniscono accesso immediato ai modelli di base più diffusi su Databricks. Queste API eliminano del tutto la complessità di ospitare e distribuire i modelli di base, garantendo al contempo che i dati rimangano al sicuro all'interno del perimetro di sicurezza di Databricks. È possibile iniziare a utilizzare le API Foundation Model su base pay-per-token, il che riduce in modo significativo i costi operativi. In alternativa, per i carichi di lavoro che richiedono modelli perfezionati o garanzie sulle prestazioni, è possibile passare a Provisioned Throughput (precedentemente noto come Optimized LLM Serving). Le API attualmente supportano vari modelli, tra cui chat (llama-2-70b-chat), completamento (mpt-30B-instruct & mpt-7B-instruct) e modelli di embedding (bge-large-en-v1.5). Amplieremo l'offerta di modelli nel tempo.

- Modelli esterni: i modelli esterni (precedentemente AI Gateway) consentono di aggiungere endpoint per accedere a modelli ospitati al di fuori di Databricks, come i modelli GPT di Azure OpenAI, i modelli Claude di Anthropic o i modelli Bedrock di AWS. Una volta aggiunti, questi modelli possono essere gestiti dall'interno di Databricks.

Inoltre, abbiamo aggiunto un elenco di foundation model selezionati al Databricks Marketplace, un marketplace aperto per asset di dati e IA, che possono essere sottoposti a fine tuning e distribuiti su Model Serving.

“Con le API di Databricks Foundation Model possiamo interrogare modelli aperti allo stato dell'arte con un solo clic, per concentrarci sui nostri clienti invece che sull'elaborazione di dati non organizzati. Utilizziamo molti modelli sulla piattaforma e siamo molto soddisfatti della stabilità e dell'affidabilità riscontrate finora, oltre che dell'assistenza ricevuta ogni volta che abbiamo avuto un problema." — Sidd Seethepalli, CTO e fondatore, Vellum

"Il prodotto APIs per Foundation Model di Databricks è stato estremamente facile da configurare e utilizzare fin da subito, rendendo i nostri flussi di lavoro RAG un gioco da ragazzi. Siamo rimasti entusiasti delle prestazioni, del throughput e dei prezzi di questo prodotto e siamo contenti di tutto il tempo che ci ha permesso di risparmiare!" - Ben Hills, CEO, HeyIris.AI"

Query i modelli tramite un'interfaccia unificata

Databricks Model Serving ora offre un'API e un SDK unificati compatibili con OpenAI per interrogare facilmente i Foundation Model. È anche possibile interrogare i modelli direttamente da SQL tramite le funzioni di IA, semplificando l'integrazione dell'IA nei flussi di lavoro di analitiche. Un'interfaccia standard consente una facile sperimentazione e confronto. Ad esempio, potresti iniziare con un modello proprietario e poi passare a un modello open ottimizzato per ridurre la latenza e i costi, come dimostrato dalla documentazione generata dall'IA di Databricks.

Gestione e monitoraggio di tutti i modelli

La nuova interfaccia utente e l'architettura di Databricks Model Serving consentono di gestire in un unico posto tutti gli endpoint dei modelli, compresi quelli ospitati esternamente. Ciò include la possibilità di gestire le autorizzazioni, tenere traccia dei limiti di utilizzo e monitorare la qualità di tutti i tipi di modelli. Ad esempio, gli amministratori possono configurare modelli esterni e concedere l'accesso a team e applicazioni, consentendo loro di eseguire query sui modelli tramite un'interfaccia standard senza esporre le credenziali. Questo approccio democratizza l'accesso a potenti LLM SaaS e aperti all'interno di un'organizzazione, fornendo al contempo i necessari meccanismi di protezione.

“Databricks Model Serving accelera i nostri progetti guidati da AI semplificando l'accesso sicuro e la gestione di numerosi modelli SaaS e aperti, inclusi quelli ospitati su Databricks o altrove. L'approccio centralizzato semplifica la gestione della sicurezza e dei costi, consentendo ai nostri team di gestione dei dati di concentrarsi più sull'innovazione e meno sulle attività amministrative." — Greg Rokita, AVP, Technology di Edmunds.com

Personalizza i modelli in modo sicuro con i tuoi dati privati

Basato su una Piattaforma di Data Intelligence, Databricks Model Serving semplifica l'estensione delle potenzialità dei modelli di base utilizzando tecniche come la generazione aumentata da recupero (RAG), il perfezionamento efficiente dei parametri (PEFT) o il perfezionamento standard. È possibile perfezionare i modelli di base con dati proprietari e distribuirli agevolmente su Model Serving. Il nuovo Databricks AI Search si integra perfettamente con Model Serving, consentendo di generare risposte aggiornate e contestualmente pertinenti.

“Utilizzando il Model Serving di Databricks, abbiamo implementato rapidamente un modello GenAI perfezionato per Stardog Voicebox, uno strumento di risposta alle domande e modellazione dei dati che democratizza le analitiche aziendali e riduce i costi per i grafi della conoscenza. La facilità d'uso, le opzioni di implementazione flessibili e l'ottimizzazione degli LLM fornite dal Model Serving di Databricks hanno accelerato il nostro processo di implementazione, consentendo al nostro team di concentrarsi sull'innovazione anziché sulla gestione dell'infrastruttura.” — Evren Sirin, CTO e cofondatore di Stardog

Inizia ora con Databricks AI Playground

Visita ora l'AI Playground e inizia subito a interagire con potenti modelli di base. Con AI Playground, puoi usare i prompt, confrontare e regolare impostazioni come il prompt di sistema e i parametri di inference, il tutto senza bisogno di competenze di programmazione.

Per maggiori informazioni:

- Esplora la documentazione di Foundation Model API e External Models.

- Scopri i foundation model nel Databricks Marketplace

- Iscriviti a un webinar sull'AI generativa di Databricks

- Vuoi risolvere i casi d'uso dell'AI generativa? Partecipa all'Hackathon sull'IA generativa di Databricks e AWS! Iscriviti qui

- Vai alla pagina web di Databricks Model Serving

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.