Novità: Lakeflow Jobs offre un'orchestrazione dei dati più efficiente

Lakeflow Jobs ora è dotato di un nuovo set di funzionalità e aggiornamenti di progettazione creati per migliorare l'orchestrazione del flusso di lavoro e l'efficienza della pipeline.

- Scopri i nuovi miglioramenti dell'interfaccia utente/UX per Lakeflow Jobs che offrono agli utenti un aspetto più pulito e intuitivo, migliorando la loro esperienza complessiva.

- Scopri le ultime funzionalità aggiunte che forniscono maggiore flessibilità e controllo sui flussi di lavoro.

- Scopri di più su Lakeflow Connect in Jobs, un modo nuovo e più centralizzato per ingerire dati nella tua pipeline.

Negli ultimi mesi, abbiamo introdotto aggiornamenti interessanti a Lakeflow Jobs (precedentemente noto come Databricks Workflows) per migliorare l'orchestrazione dei dati e ottimizzare le prestazioni dei workflow.

Per i nuovi arrivati, Lakeflow Jobs è l'orchestratore integrato per Lakeflow, una soluzione unificata e intelligente per l'ingegneria dei dati con sviluppo e operazioni ETL semplificati, basata sulla Data Intelligence Platform. Lakeflow Jobs è l'orchestratore più affidabile per il Lakehouse e i carichi di lavoro di livello production, con oltre 14.600 clienti, 187.000 utenti settimanali e 100 milioni di job eseguiti ogni settimana.

Dai miglioramenti dell'interfaccia utente a un controllo dei workflow più avanzato, scopri le ultime novità della soluzione di orchestrazione dati nativa di Databricks e scopri come gli ingegneri dei dati possono semplificare la loro esperienza di pipeline dati end-to-end.

Interfaccia utente rinnovata per un'esperienza utente più mirata

Abbiamo ridisegnato la nostra interfaccia per dare a Lakeflow Jobs un aspetto fresco e moderno. Il nuovo layout compatto consente un percorso di orchestrazione più intuitivo. Gli utenti apprezzeranno una palette di attività che ora offre scorciatoie e un pulsante di ricerca per aiutarli a trovare e accedere più facilmente alle loro attività, che si tratti di una Lakeflow Pipeline, di una dashboard AI/BI, di un notebook, di SQL o altro.

Per il monitoraggio, i clienti possono ora trovare facilmente informazioni sui tempi di esecuzione dei loro job nel pannello di destra sotto i dettagli di esecuzione del Job e dell'Attività, consentendo loro di monitorare facilmente i tempi di elaborazione e identificare rapidamente eventuali problemi della pipeline dati.

Abbiamo anche migliorato la barra laterale consentendo agli utenti di scegliere quali sezioni (Dettagli del Job, Pianificazioni e Trigger, Parametri del Job, ecc.) nascondere o mantenere aperte, rendendo la loro interfaccia di orchestrazione più pulita e pertinente.

Nel complesso, gli utenti di Lakeflow Jobs possono aspettarsi un flusso di lavoro di orchestrazione più semplificato, mirato e snello. Il nuovo layout è attualmente disponibile per gli utenti che hanno aderito all'anteprima e attivato l'interruttore nella pagina Jobs.

Flussi dati più controllati ed efficienti

Il nostro orchestratore viene costantemente migliorato con nuove funzionalità. L'ultimo aggiornamento introduce controlli avanzati per l'orchestrazione delle pipeline dati, offrendo agli utenti un maggiore comando sui loro workflow per una maggiore efficienza e prestazioni ottimizzate.

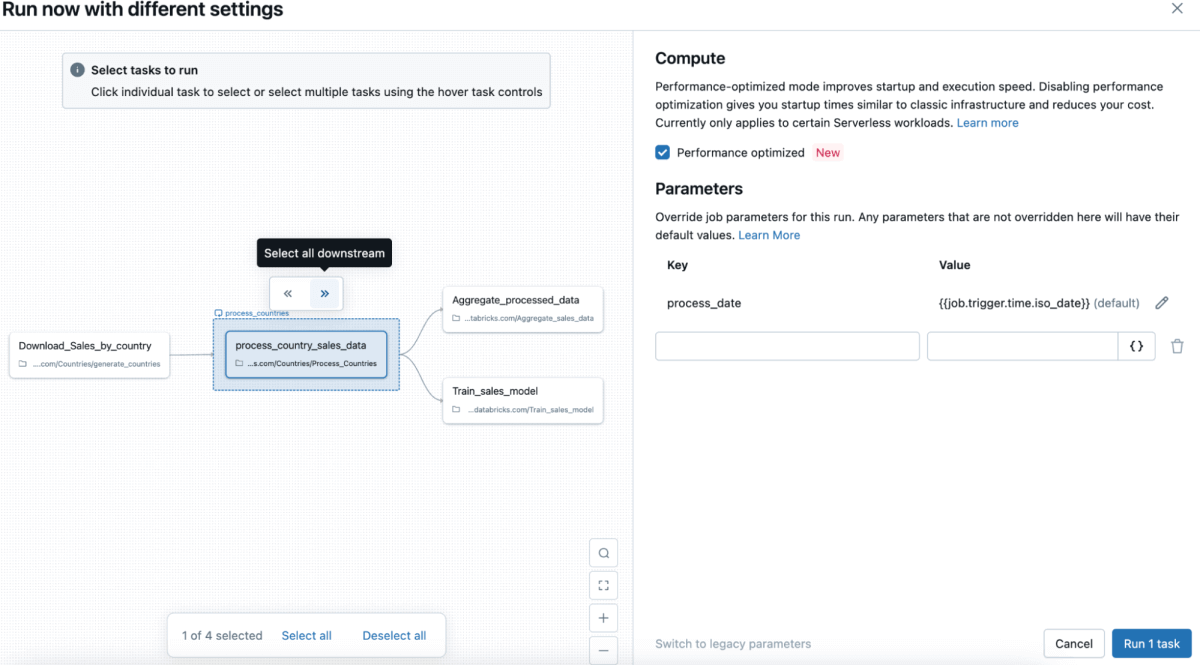

Esecuzioni parziali consentono agli utenti di selezionare quali attività eseguire senza influenzarne altre. In precedenza, il test delle singole attività richiedeva l'esecuzione dell'intero job, il che poteva essere computazionalmente intensivo, lento e costoso. Ora, nella pagina Jobs & Pipelines, gli utenti possono selezionare "Esegui ora con impostazioni diverse" e scegliere attività specifiche da eseguire senza influenzarne altre, evitando sprechi computazionali e costi elevati. Allo stesso modo, le riparazioni parziali consentono un debug più rapido permettendo agli utenti di correggere singole attività fallite senza rieseguire l'intero job.

Con un maggiore controllo sui loro flussi di esecuzione e riparazione, i clienti possono accelerare i cicli di sviluppo, migliorare l'uptime dei job e ridurre i costi di calcolo. Sia le esecuzioni parziali che le riparazioni parziali sono generalmente disponibili nell'interfaccia utente e nell'API dei Job.

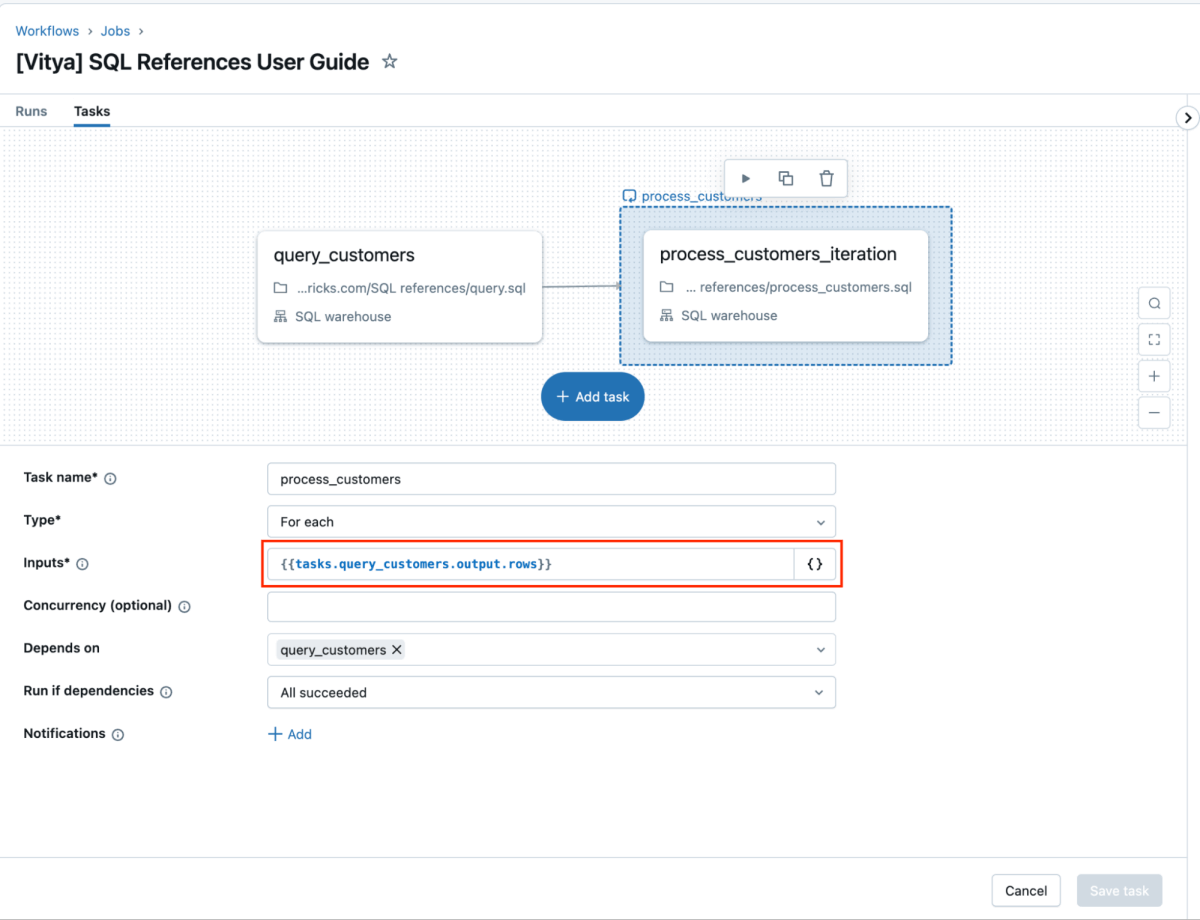

A tutti gli appassionati di SQL, abbiamo ottime notizie! In questo ultimo round di aggiornamenti, i clienti potranno utilizzare gli output delle query SQL come parametri in Lakeflow Jobs per orchestrare i loro dati. Ciò semplifica per gli sviluppatori SQL il passaggio di parametri tra attività e la condivisione del contesto all'interno di un job, risultando in un'orchestrazione di pipeline dati più coesa e unificata. Anche questa funzionalità è ora generalmente disponibile.

Avvio rapido con Lakeflow Connect in Jobs

Oltre a questi miglioramenti, stiamo anche rendendo veloce e facile l'ingestione di dati in Lakeflow Jobs integrando più strettamente Jobs con Lakeflow Connect, la soluzione di ingestione dati gestita e affidabile di Databricks Lakeflow, con connettori integrati.

I clienti possono già orchestrare pipeline di ingestione Lakeflow Connect che originano da Lakeflow Connect, utilizzando uno qualsiasi dei connettori completamente gestiti (ad es. Salesforce, Workday, ecc.) o direttamente dai notebook. Ora, con Lakeflow Connect in Jobs, i clienti possono creare facilmente una pipeline di ingestione direttamente da due punti di ingresso nella loro interfaccia Jobs, il tutto all'interno di un ambiente point-and-click. Poiché l'ingestione è spesso il primo passo nell'ETL, questa nuova integrazione fluida con Lakeflow Connect consente ai clienti di consolidare e semplificare la loro esperienza di ingegneria dei dati, dall'inizio alla fine.

Lakeflow Connect in Jobs è ora generalmente disponibile per i clienti. Scopri di più su questo e altri recenti rilasci di Lakeflow Connect.

Un'unica orchestrazione per tutti i tuoi carichi di lavoro

Stiamo innovando costantemente su Lakeflow Jobs per offrire ai nostri clienti un'esperienza di orchestrazione moderna e centralizzata per tutte le loro esigenze di dati in tutta l'organizzazione. Altre funzionalità sono in arrivo su Jobs: sveleremo presto un modo per gli utenti di attivare job in base agli aggiornamenti delle tabelle, forniremo supporto per le tabelle di sistema ed espanderemo le nostre capacità di osservabilità, quindi rimanete sintonizzati!

Per coloro che desiderano continuare ad approfondire Lakeflow Jobs, consulta le nostre sessioni on-demand dal nostro Data+AI Summit ed esplora Lakeflow in una varietà di casi d'uso, demo e altro ancora!

- Scopri di più su Lakeflow Jobs

- Crea il tuo primo job con la nostra Guida rapida

- Abilita la nuova interfaccia utente utilizzando l'interruttore nella pagina Jobs & Pipelines (solo clienti in anteprima)

- Non sei riuscito a partecipare al Data+AI Summit? Guarda le sessioni di Lakeflow Jobs on demand

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.