大規模言語モデル(LLM)

自己教師あり学習によって大規模なテキス�トコーパスで学習され、数十億のパラメータを持ち、NLPタスク向けに人間のようなテキストを生成できるニューラルネットワーク

によって Databricks Staff による投稿

- アーキテクチャは、シーケンスの並列処理を可能にするアテンションメカニズムを備えた Transformer モデルを採用し、大規模なコンピュートリソースと専用ハードウェア (GPU、TPU) を使用して、インターネット規模のテキストにおける次トークン予測を通じてトレーニングされます

- 機能には、サンプルから新しいタスクに適応するフューショット学習およびゼロショット学習、多言語理解、数千トークンにわたるコンテキストウィンドウでの推論、規模が拡大するにつれて現れる創発的能力などが含まれます

- 応用分野はチャットボット、コンテンツ作成、コード生成、研究支援、言語翻訳、文書要約、感情分析、企業のナレッジマネジメントに及びますが、バイアス、安全性、計算コストに対処する慎重なデプロイが求められます

大規模言語モデル(LLM)とは

言語モデルは、自然言語処理(NLP)を使用して人間の言語を理解し、生成する生成 AI(GenAI)の一種です。大規模言語モデル(LLM)は、これらの中で最も強力なものです。LLM は、高度な機械学習(ML)アルゴリズムを使用して大規模なデータセットでトレーニングされ、人間の言語のパターンと構造を学習し、書き込まれたプロンプトに対するテキスト応答を生成します。LLM の例には、BERT、Claude、Gemini、Llama、Generative Pretrained Transformer(GPT)ファミリーの LLM などがあります。

LLMは、様々な言語関連タスクにおいて、パフォーマンスと能力の点で従来のモデルを大幅に上回っています。複雑でニュアンスに富んだコンテンツを生成し、人間のような結果をもたらすタスクを自動化するその能力は、様々な分野で進歩を促進しています。LLM はビジネス界に広く統合されつつあり、サポートの自動化、知見の発見、パーソナライズされたコンテンツの生成など、さまざまな環境やビジネス用途でインパクトを与えています。

コア LLM AI と言語機能には次のものが含まれます。

- 自然言語理解: LLMは、文脈、セマンティクス、意図など、人間の言語のニュアンスを理解できます。

- マルチモーダル コンテンツ生成: LLM は、コーディングからクリエイティブ ライティングまで、さまざまな目的で人間のようなテキストを生成できるほか、画像や音声なども生成できます。

- 質問応答: LLM は自由形式の質問にインテリジェントに回答できます。

- スケーラビリティ: LLM は、グラフィックス プロセッシング ユニット(GPU)の能力を活用して、大規模な言語タスクを効率的に処理し、増大するビジネスニーズに適応できます。

LLM の機能

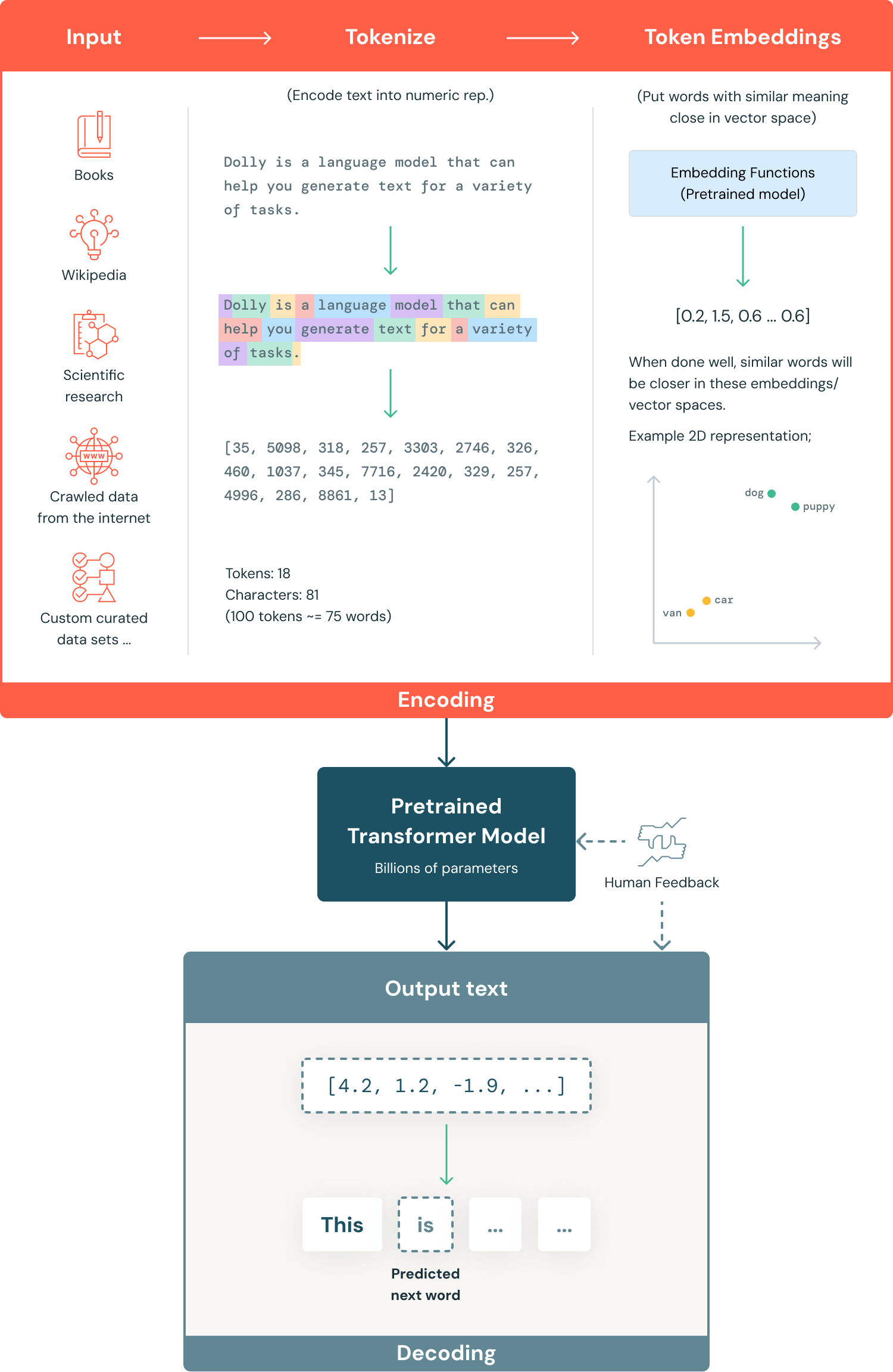

ほとんどのLLMは、Transformerアーキテクチャを使用して構築されています。これらは、入力テキストをトークン(サブワード単位)に分割し、それらのトークンを数値ベクトルにエンベディングし、アテンションメカニズムを使用して入力全体の関連性を理解することで機能します。そして、シーケンス内の次のトークンを予測することで、一貫性のある出力を��生成します。

LLM を事前学習するとはどういう意味ですか?

LLMモデルの事前学習とは、既存のモデルが持つ事前知識や重みを利用せずに、テキストやコードなどの大規模なデータでトレーニングを行うプロセスのことです。完全な事前トレーニングの出力は、直接使用したり、後工程のタスクにさらにファインチューニングすることもできるベースモデルです。

事前学習により、モデルの基礎知識がお客様の特定のドメインに合わせて調整されます。その結果、組織独自のデータによって差別化されたカスタムモデルが完成します。しかし、事前学習は通常、最も大規模でコストのかかる種類のトレーニングであり、ほとんどの組織にとって一般的なものではありません。

LLMのファインチューニングとは何ですか?

ファインチューニングとは、事前にトレーニングされた LLM を、個々のドメインやタスクに特化した比較的小規模なデータセットに適応させるプロセスです。ファインチューニングの過程では、モデル全体と比べて比較的少ない数の重みを調整することで、短時間のトレーニングを継続します。

ファインチューニングの最も一般的な形式は、次の2つです。

教師あり学習のファインチューニング:このアプローチでは、事前にトレーニングされた LLM を、入出力のトレーニング例のデータセットで継続的にトレーニングします。通常、数千のトレーニング例を使用します。

継続事前学習: このファインチューニング手法は、入力例と出力例に依存するのではなく、ドメイン固有の非構造化テキストを使用して、同じ事前学習プロセス(次のトークンの予測やマスクされた言語モデリングなど)を継続します。

ファインチューニングは、組織が基盤となるLLMを独自のデータでトレーニングし、自社のドメインやワークロードに合わせて精度を高め、カスタマイズできるようにするため重要です。これにより、トレーニングに使用するデータを管理できるようになり、責任を持って AI を使用していることを確認できます。

ニューラルネットワークとトランスフォーマーアーキテクチャ

LLMは、確率に基づいて大量のデータをプログラムに供給してトレーニングを行う、AIの一種であるディープラーニングを基盤としています。LLMは、大規模なデータセットに触れることで、明示的なプログラミングなしに言語のパターンや関係性を認識するようトレーニングされ、自己学習メカニズムによって継続的に精度を向上させることができます。

LLM の基盤は、人間の脳の構造から着想を得た人工ニューラルネットワークです。これらのネットワークは、入力層、出力層、その間にある1つ以上の層など、階層状に配置された相互接続ノードで構成されています。各ノードは、学習したパターンに基づいて情報を処理し、次の層に伝達します。

LLMは、transformerモデルと呼ばれるニューラルネットワークの一種を使用します。単語を順番に処理する古いモデルとは対照的に、これらの画期的なモデルは文全体を一度に見ることができます。これにより、言語をより速く、より効率的に理解できるようになります。Transformer モデルは自己注意(self-attention)と呼ば�れる数学的手法を使用しており、これは文中の各単語に異なる重要度を割り当てることで、モデルが意味のニュアンスを把握して文脈を理解するのを可能にします。位置エンコーディングは、言語を理解するうえで不可欠な、文中の語順の重要性をモデルが理解するのに役立ちます。Transformer モデルによって、LLM は膨大な量のデータを処理し、文脈に沿った関連情報を学習して、一貫性のあるコンテンツを生成できるようになります。

LLM のトレーニングプロセスを簡単に表すと、次のようになります。

全ての LLM の基盤であるトランスフォーマーについての詳細は、次の動画をご覧ください。

LLM のユースケース

LLM は、さまざまなユースケースや異なる産業においてビジネスに影響をもたらします。例えば、次のようなユースケースがあります。

- チャットボットとバーチャルアシスタント:LLM は、チャットボットに使用され、顧客と従業員が自由回答形式の会話をすることで、カスタマーサポート、Web サイトのリードフォローアップ、パーソナルアシスタントを支援します。

- コンテンツ作成: LLM は、記事、ブログ記事、ソーシャル メディアの更新など、さまざまな種類のコンテンツを生成できます。

- コード生成とデバッグ:LLM は、有用なコードスニペットを生成し、コード内のエラーを特定して修正し、入力指示に基づいてプログラムを完成させることができます。

- センチメント分析: LLM はテキストの感情を自動的に理解し、顧客満足度を把握することができます。

- テキストの分類とクラスタリング:LLM は、大量のデータを整理、分類、並べ替えをして共通のテーマや傾向を特定し、情報に基づいた意思決定を支援します。

- 言語翻訳: LLM は、ドキュメントやウェブページをさまざまな言語に翻訳して、さまざまな市場にリーチできます。

- 要約と言い換え:LLM は、論文、記事、顧客との電話や会議を要約し、最も重要なポイントを提示できます。

- セキュリティ: LLMはサイバーセキュリティで脅威のパターンを特定し、対応を自動化するために使用できます。

エンタープライズ向けエージェントAIプレイブック

LLM を効果的に導入されたお客さまの事例

ジェットブルー航空

ジェットブルー航空は、Databricks が提供する企業データによって補完されたオープンソースの生成 AI モデルを使用するチャットボット「BlueBot」を導入しました。このチャットボットは、ジェットブルー航空の全チームが使用でき、役割ごとに管理されたデータにアクセスできます。例えば、財務チームは SAP や規制当局への提出書類のデータを見ることができますが、オペレーションチームはメンテナンス情報しか見ることができません。

シェブロンフィリップス

Chevron Phillips は生成 AI ソリューションを活用し、Databricks の Dolly のようなオープンソースモデルによって、文書プロセスの自動化を効率化しています。これらのツールは、PDFやマニュアルの非構造化データを構造化された知見に変換し、業務やマーケットインテリジェンスのために、より高速で正確なデータ抽出を可能にします。ガバナンスポリシーは、トレーサビリティを維持しつつ、生産性とリスク管理を確保します。

Thrivent Financial

Thrivent Financialは生成AIを活用し、Databricksとあわせて、検索の高速化、より明確でアクセスしやすい知見の提供、およびエンジ�ニアリングの生産性向上を実現しています。ロールベースのガバナンスを備えた単一のプラットフォームにデータを集約することで、同社はチームがイノベーションを起こし、探索し、より効率的に作業できるセキュアな空間を作り出しています。

なぜLLMは、急に人気が高まっているのでしょうか?

LLM が脚光を浴びるようになったのは、最近の多くの技術的進歩によるものです。

- 機械学習技術の発展:LLMは、ML技術における多くの進歩を活用しています。最も注目すべきは、ほとんどの LLM モデルの基盤となるトランスフォーマーアーキテクチャです。

- アクセシビリティの向上:ChatGPTがリリースされたことで、インターネットにアクセスできる人なら誰でもシンプルなウェブインターフェースを通じて、最も先進的なLLMの1つと対話できるようになり、世界中の人々がLLMの力を理解できるようになりました。

- 計算能力の向上: グラフィックス プロセッシング ユニット(GPU)などのより強力なコンピューティング リソースや、より優れたデータ処理技術が利用できるようになったことで、研究者ははるかに大規模なモデルをトレーニングできるようになりました。

- トレーニングデータの量と質: 大規模なデータセットの可用性と、それらを処理する能力は、モデルの性能を劇的に向上させました。例えば、GPT-3 は、ビッグデータ(約 5,000 億トークン)で学習されました。これには、品質に重点を置いた公開されて��いる Web ページなどの WebText2 データセット(1,700 万の文書)のような高品質なサブセットが含まれています。

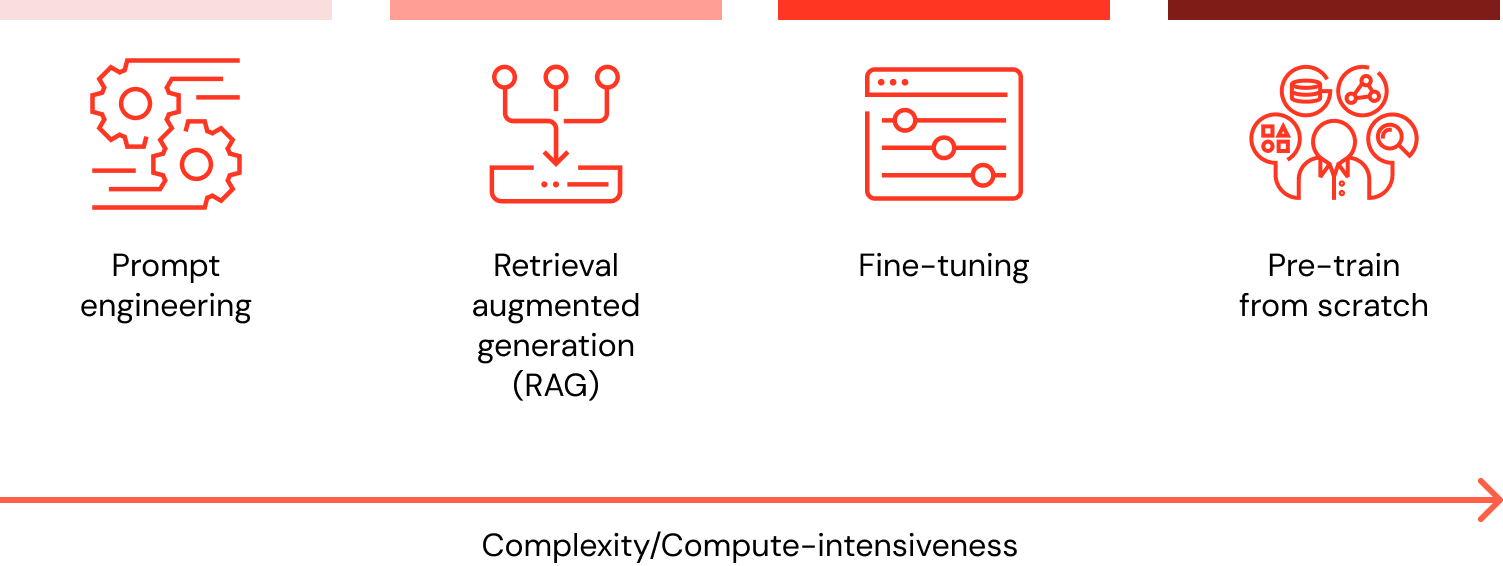

組織のデータを利用して LLM をカスタマイズする方法

組織のデータで LLM アプリケーションをカスタマイズする際に考慮すべきアーキテクチャパターンは、4 つあります。これらの手法の概要は、次のとおりです。また、これらは、相互に排他的なものではありません。むしろ、それぞれの長所を活かすために組み合わせることが可能であり、そうすべきです。

どのような手法を選択するかにかかわらず、適切に構造化され、モジュール化された方法でソリューションを構築することで、組織は反復し、適応するための準備を整えることができます。このアプローチなどについて詳しくは、The Big Book of 生成AI をご覧ください。

| 手法 | 定義 | 主なユースケース | データ要件 | 利点 | 考慮事項 |

|---|---|---|---|---|---|

| LLM の動作を導く専門的なプロンプトの作成 | 迅速なオンザフライモデルガイダンス | なし | 迅速、費用対効果、トレーニング不要 | ファインチューニングよりもコントロール性が劣る | |

| LLM と外部ナレッジ検索の組み合わせ | 動的データセットと外部ナレッジ | 外部ナレッジベース、またはデータベース(ベクトルデータベースなど) | 動的に更新されるコンテキスト、精度の向上 | プロンプトの長さと推論計算が増加 | |

| 事前トレーニングされた LLM を特定のデータセットやドメインに適応 | ドメイン、またはタスクの専門化 | 何千ものドメイン固有、またはインストラクションの例 | きめ細かなコントロール、高い専門性 | ラベル付きデータが必要、計算コスト | |

| ゼロからの LLM トレーニング | 独自のタスク、またはドメイン固有のコーパス | 大規模データセット(数十億~数兆のトークン) | 特定のニーズにあわせた最大限のコントロール | 極めて資源集約的 |

LLMにおけるプロンプトエンジニアリングとは、どういう意味ですか?

プロンプトエンジニアリングとは、LLM に与えられたテキストプロンプトを調整して、より正確で適切な回答を引き出すことです。プロンプトエンジニアリングはモデル固有のため、どの LLM モデルでも同じ品質の応答を生成するわけではありません。以下に、さまざまなモデルで役立つ一般的なヒントをいくつか紹介します。

- 明確で簡潔なプロンプトを使用します。これには、指示、コンテキスト(必要な場合)、ユーザークエリまたは入力、および希望する出力タイプやフォーマットの説明が含まれることがあります。

- プロンプトに例を提供する(フューショット学習)と、LLM があなたの意図を理解するのに役立ちます。

- 質問に答えられない場合は、それを認めるように指示するなど、モデルに行動を指示します。

- モデルに段階的な思考方法や推論の説明を指示します。

- プロンプトにユーザー入力が含まれる場合は、プロンプトのハッキングを防ぐためのテクニックを使用します。例えば、プ�ロンプトのどの部分が指示か、ユーザー入力かを明確にするといった方法があります。

LLMにおける検索拡張生成(RAG)とは何ですか?

検索拡張生成(RAG)は、カスタムデータを活用することで LLM アプリケーションの有効性を向上させるアーキテクチャ アプローチです。質問やタスクに関連するデータや文書を検索し、LLM のコンテキストとして提供することによって行われます。RAG は、最新の情報を維持したり、ドメイン固有の知識にアクセスする必要があるチャットボットや Q&A システムのサポートに活用されています。

RAG について詳しくは、こちらをご覧ください。

最も一般的な LLM とその違い

LLMの分野には数多くの選択肢があります。一般的には、LLM はプロプライエタリなサービスと、オープンソースモデルの 2 つに分類できます。

独自のモデル

プロプライエタリな LLM モデルは民間企業によって開発・所有されており、アクセスするには通常ライセンスが必要です。おそらく最も注目されているプロプライエタリなLLMは、2022年に鳴り物入りでリリースされたChatGPTの原動力であるGPT-4oです。ChatGPT は、ユーザーがプロンプトを送り、迅速かつ適切な応答を受け取れるフレンドリーな検索インターフェ��イスを提供します。開発者は ChatGPT API にアクセスすることで、LLM を自分のアプリケーションや製品、サービスに組み込むことができます。その他のプロプライエタリモデルには、Google の Gemini や Anthropic の Claude などがあります。

オープンソースモデル

もう 1 つの選択肢は、LLM を自己ホストすることです。オープンソースで商用利用可能なモデルを使用します。オープンソースコミュニティは、プロプライエタリなモデルの性能に急速に追いついています。人気のオープンソースLLMモデルには、MetaのLlama 4やMixtral 8x22Bなどがあります。

最良の選択を評価する方法

クローズドなサードパーティーベンダーの API を使用する場合と、独自のオープンソース(またはファインチューニングされた)LLM モデルを自己ホストする場合の最大の検討事項とアプローチの違いは、将来性、コスト管理、データを競争上の優位性として活用することです。プロプライエタリなモデルは、非推奨となり削除される可能性があります。既存のパイプラインやベクトルインデックスを壊す恐れがあります。一方、オープンソースモデルは、永久にアクセスが可能です。オープンソースやファインチューニングされたモデルは、アプリケーションにより適した選択肢を提供し、性能とコストのトレードオフをより良く実現できます。将来的に独自のモデルをファインチューニングする計画を立てることで、組織のデータを競争上の優位性として活用し、一般に公開されているモデルよりも優れたモデルを構築できます。プロプライエタリなモデルは、「ブラックボックス」としての LLM のトレー��ニングプロセスや重みの監視をあまり許さないため、ガバナンス上の懸念を引き起こす可能性があります。

独自のオープンソース LLM モデルをホストすることは、プロプライエタリな LLM を使用するよりも多くの作業を必要とします。Databricks の MLflow を使用すると、Python の経験があれば、トランスフォーマーモデルを取り込んで Python オブジェクトとして使用できます。

どのLLMを使用すればよいですか?

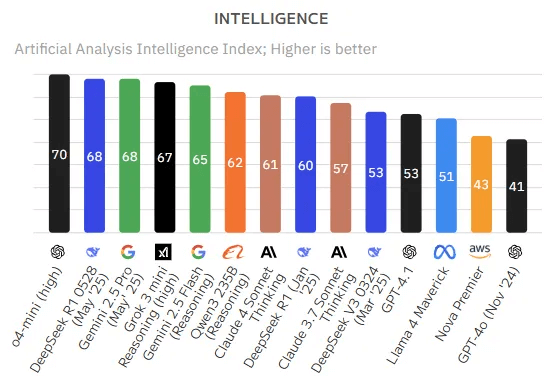

LLM の評価は、異なるタスク間での性能にばらつきが見られるため、難しく進化する分野です。LLM は、あるベンチマークでは優れているかもしれませんが、プロンプトや問題のわずかな違いが、そのパフォーマンスに大きく影響することがあります。

LLM の性能の評価に使用される主要なツールやベンチマークには、次のようなものがあります。

- MLflow

- モデル評価のための LLMOps ツールセットを提供します。

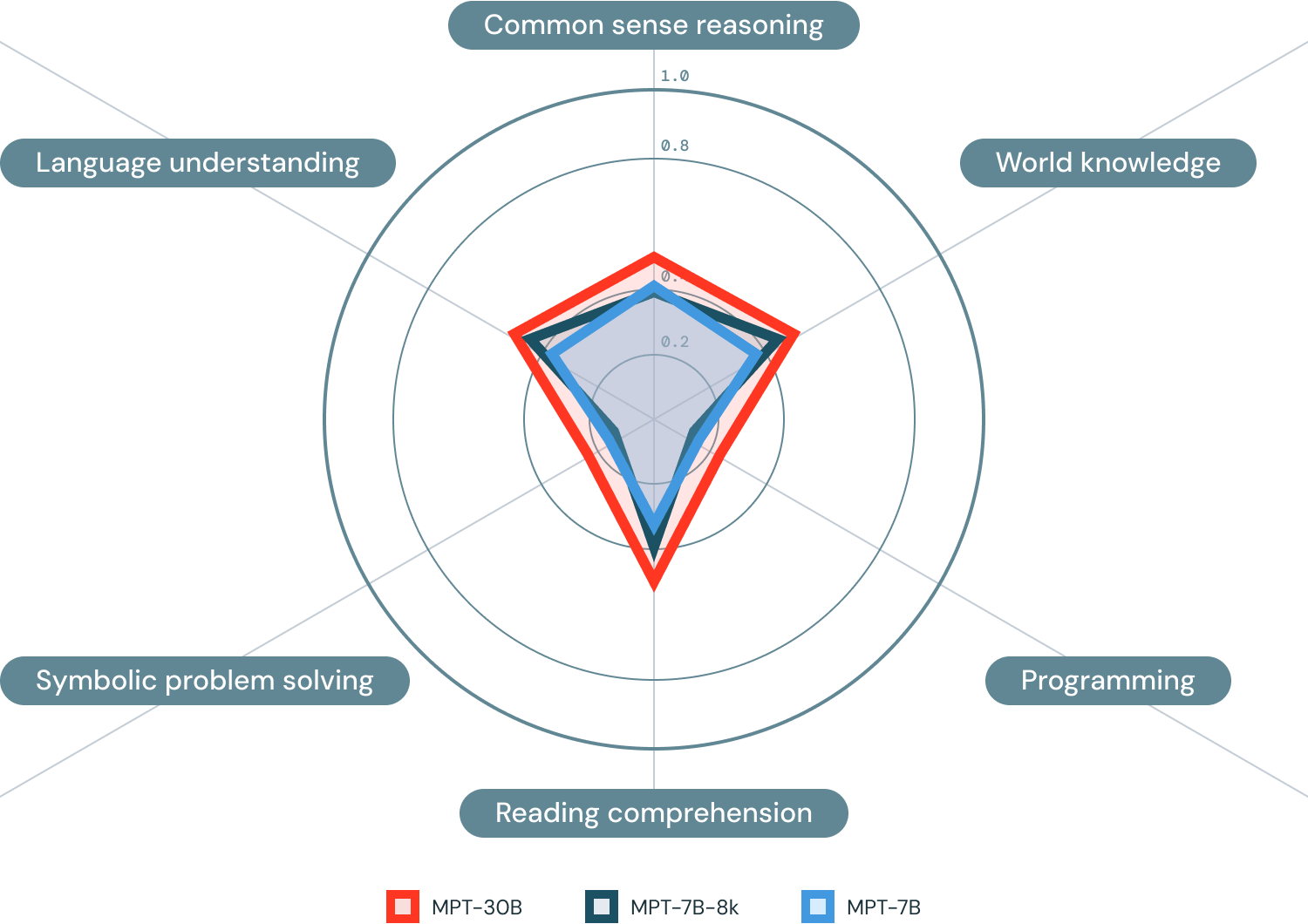

- Mosaic モデルガントレット

- 単一の一元的な指標にまとめるのではなく、モデルの能力を 6 つの広範な領域(下図)に分類する集約的な評価手法です。

- Hugging Face は、オープンな LLM コントリビューターから何十万ものモデルを収集しています。

- BIG-bench(Imitation Game - 模倣ゲームを超えたベンチマーク)

- 現在、200 以上のタスクをホストしている動的なベンチマークフレームワークで、将来の LLM の能力に適応することに重点を置いています。

- EleutherAI 言語モデル評価ハーネス

- BIG-bench や MMLU(大規模マルチタスク言語理解)のような評価を統合し、再現性と比較可能性を促進する、200 以上のタスクでモデルを評価する総合的なフレームワークです。

RAG アプリケーションにおける LLM 評価のベストプラクティスもご覧ください。

大規模言語モデル運用(LLM Ops)によって、LLMの管理をどのように軌道に乗せますか?

大規模言語モデル運用(LLMOps)には、運用環境における大規模言語モデルの運用管理に使用されるプラクティス、テクニック、ツールが含まれます。

LLMOps によって、LLM の効率的なデプロイ�、モニタリング、メンテナンスが可能になります。LLMOps は、従来の機械学習運用(MLOps)と同様に、データサイエンティスト、DevOps エンジニア、IT プロフェッショナルのコラボレーションを必要とします。LLMOps について詳しくは、こちらをご覧ください。

大規模言語モデル(LLM)に関する詳細情報

LLM に関する多くの資料がございます。ぜひご覧ください。

トレーニング

- LLM:基本から学ぶ基礎モデル(EDX と Databricks のトレーニング)— LLM の基礎モデルについて詳しく説明している Databricks が提供する無料トレーニング

- LLM:アプリケーションの本番運用(EDX と Databricks のトレーニング)— 最新かつ最も有名なフレームワークを使用して、LLM にフォーカスしたアプリケーションを構築する方法に重点を置いた Databricks が提供する無料のトレーニング

eBook

技術ブログ

- Databricks Data Intelligence Platform における Meta の Llama 4 のご紹介 | Databricks ブログ

- Databricks での Qwen モデルのサービング | Databricks ブログ

- RAG アプリケーションにおける LLM 評価のベストプラクティス

- MLflow AI Gateway と Llama 2 を使用して生成 AI アプリを構築する

- Mosaic AI エージェント フレームワークとエージェント評価、Model Servingとベクトル検索で高品質な RAG アプリを構築

- LLMOps:LLM を管理するための全てがここに

次のステップ

- 大規模言語モデル(LLM)プロジェクトについてのデモやご相談は、Databricks にお問い合わせください。

- Databricks の LLM 向けサービスについて読む

- 検索拡張生成(RAG)のユースケース(最も一般的な LLM アーキテクチャ)について詳しく読む

最新の投稿を受信トレイで受け取る

ブログを購読して、最新の投稿を受信トレイにお届けします。