セキュリティ& トラスト・センター

データ保護は Databricks の最優先事項です

AI セキュリティ

AIモデルに関連するリスクを軽減するためのベストプラクティス

AIセキュリティとは、人工知能システム、モデル、データを不正アクセス、改ざん、悪意のある活動から保護するために実施されるプラクティス、対策、戦略を指します。組織は、AI資産を保護し、その使用に伴う潜在的なリスクを軽減するために、堅牢なセキュリティプロトコル、暗号化方式、アクセス制御、モニタリングメカニズムを実装する必要があります。

Databricks セキュリティチームは、お客さまと協力し、お客さまのアーキテクチャ要件を満たす適切なセキュリティ機能を備えた AI と機械学習を Databricks 上にデプロイします。当社はまた、Databricks社内および、より広範な機械学習およびGenAIコミュニティの数十人の専門家と協力して、AIシステムのセキュリティリスクを特定し、それらのリスクを軽減するために必要な管理策を定義しています。

AI システムの理解

AIシステムはどのような構成要素から成り立っており、それらはどのように連携して機能するのでしょうか?

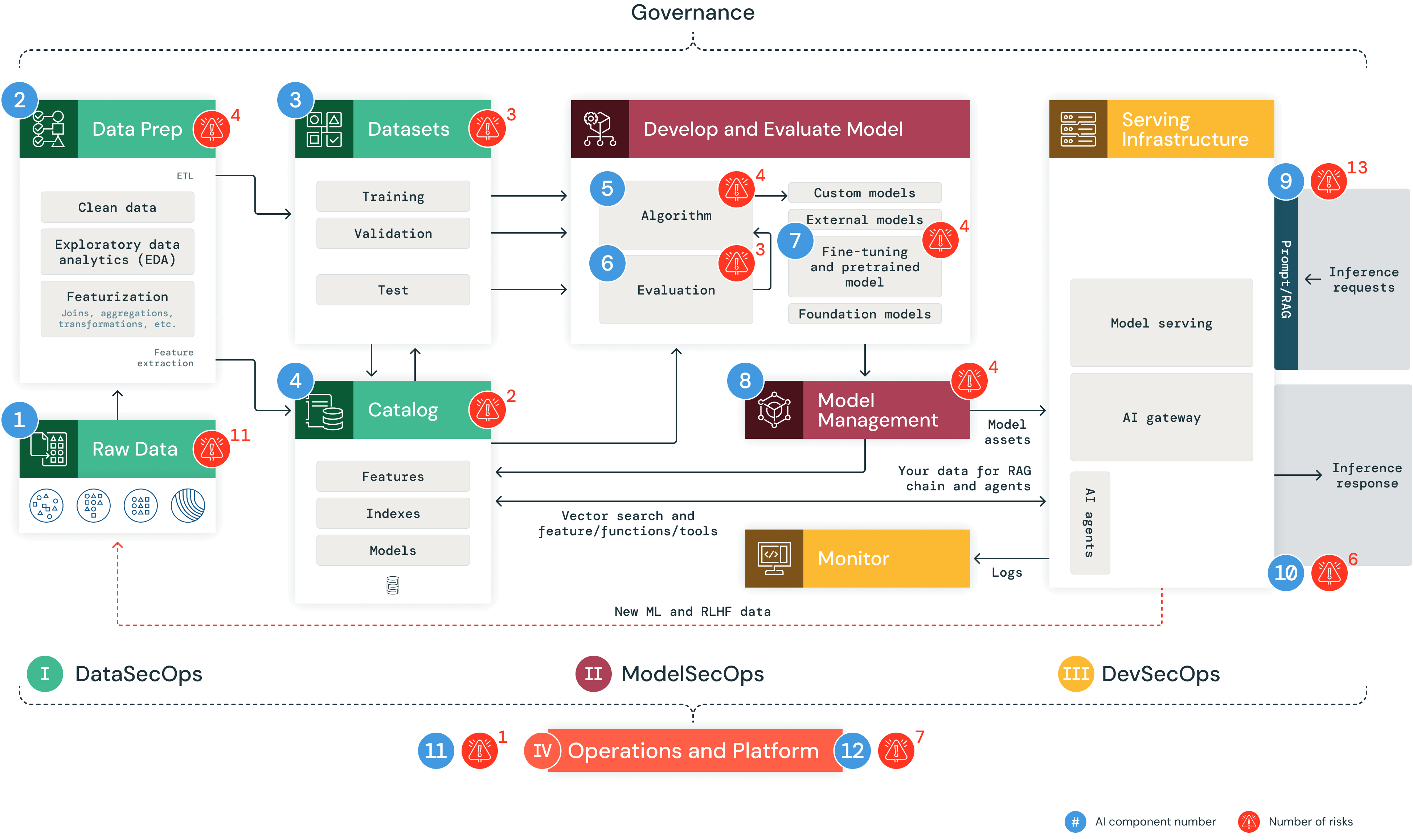

AIシステムは、データ、コード、モデルから構成されます。一般的なエンドツーエンドAIシステムには12個の基礎的なアーキテクチャコンポーネントがあり、これらは大きく4つの主要なステージに分類されます。

- データオペレーション には、データの取り込みと変換、データセキュリティとガバナンスの確保が含まれます。優れたMLモデルは、信頼性の高いデータパイプラインと安全なインフラストラクチャに依存します。

- モデル運用 には、カスタムモデルの構築、モデル マーケットプレイスからのモデルの取得、あるいは OpenAI などの Software-as-a-Service (SaaS) の大規模言語モデル (LLM) の使用が含まれます。モデルを開発するには、一連の**エクスペリメント**と、それらの**エクスペリメント**の条件や結果を追跡・比較する方法が必要です。

- モデルのデプロイとサービングは、モデル イメージの安全なビルド、モデルの分離と安全なサービング、自動スケーリング、レート制限、デプロイ済みモデルのモニタリングで構成されます。

- 運用とプラットフォームには、プラットフ�ォームの脆弱性管理とパッチ適用、モデルの分離とシステム制御、アーキテクチャのセキュリティに基づいたモデルへのアクセス認可が含まれます。CI/CD のための運用ツールも含まれています。MLOps のために、開発、ステージング、本番運用といった個別の実行環境を安全に保つことで、ライフサイクル全体が求められる基準を満たすことを保証します。

下の画像は、AI システム全体における 12 のコンポーネントと、それらがどのように相互作用するかを示しています。

AI セキュリティリスクの理解

AI導入時に生じる可能性のあるセキュリティ上の脅威とは何ですか?

AIシステムの分析において、12の基本的なアーキテクチャコンポーネントにわたる62の技術的なセキュリティリスクを特定しました。下の表では、あらゆるAIシステムのステップに対応するこれらの基本的なコンポーネントの概要を説明し、セキュリティリスクの例をいくつか紹介します。62の技術的なセキュリティリスクの全リストは、Databricks AI Security Frameworkでご覧いただけます。

AI システムの段階 | AI システムコンポーネント | 潜在的なセキュリティリスク |

|---|---|---|

データオペレーション | 1. 生データ 2. データ準備 3. データセット 4. カタログとガバナンス | 次のような 20 の特定のリスク:

|

モデル運用 | 5. 機械学習アルゴリズム 6. 評価 7. モデルのビルド 8. モデル管理 | 15 の特定のリスク(例:)

|

モデルのデプロイとサービング | 9. モデルサービング — 推論リクエスト 10. モデルサービング — 推論応答 | 次のような 19 の特定のリスク:

|

運用とプラットフォーム | 11. 機械学習オペレーション 12. 機械学習プラットフォーム | 以下のような8つの特定のリスク:

|

AI のセキュリティリスクを軽減するために、どのような制御が可能ですか?

特定された 62 の AI セキュリティリスクを軽減するために、64 の規範的な管理策があります。これらのコントロールには以下が含まれます。

- リスク管理のための多層防御アプロー��チを用いた、シングルサインオン、暗号化技術、ライブラリとソースコードの管理、ネットワークアクセス制御などのサイバーセキュリティのベストプラクティス

- データ分類、データリネージ、データバージョニング、モデル追跡、データおよびモデルのアセット権限、モデルガバナンスなどのデータとAIガバナンスに特化したコントロール

- モデルサービングの分離、プロンプトツール、モデルの監査とモニタリング、MLOps と LLMOps、LLM の一元管理、モデルのファインチューニングと事前トレーニングのようなAI に特化したコントロール

AIシステムに関連するセキュリティリスクの詳細な概要や、各リスクに対して実装すべき統制についてご興味がおありでしたら、Databricks AI Security Whitepaperをダウンロードしてください。

AI および ML モデルのセキュリティのベストプラクティ��ス

データチームとセキュリティチームは、AIシステムのセキュリティを向上させるという目標を追求するため、積極的に協力する必要があります。従来の機械学習ソリューションとLLM駆動型アプリケーションのどちらを実装する場合でも、DatabricksはDatabricks AIセキュリティホワイトペーパーで概説されている以下のステップを踏むことを推奨します。

FAQ

AI セキュリティ関連リソース

Databricks の AI セキュリティフレームワーク(DASF)

Databricks のセキュリティチームは、モデルのセキュリティを超えたリスクを軽減するための包括的なアプローチで AI システムにおける進化する脆弱性に対処するため、Databricks AI Security Framework(DASF)を作成しました。

Databricks AI リスク ワークショップ

Databricks のセキュリティチームは、リーダーが AI システム、そのリスク、および軽減戦略を理解できるよう、AI リスクに関するワークショップを開催しています。

AIセキュリティ基礎トレーニング

このコースでは、5つの包括的なモジュールを通じて、Databricksデータ インテリジェンス プラットフォームにおけるAIシステムのセキュリティの基礎を学びます。

AI セキュリティのイベントと Web セミナー

Databricksのセキュリティリーダーは、業界のリーダー、企業、政府機関、ベンダーが集まるイベントで定期的に専門知識を共有しています。