Neues: Lakeflow Jobs bietet effizientere Datenorchestrierung

Lakeflow Jobs verfügt jetzt über einen neuen Satz von Funktionen und Design-Updates, die darauf ausgelegt sind, die Workflow-Orchestrierung zu verbessern und die Pipeline-Effizienz zu steigern.

von Saad Ansari, Anthony Podgorsak und Joanna Zouhour

- Entdecken Sie die neuesten UI/UX-Verbesserungen für Lakeflow Jobs, die den Benutzern ein übersichtlicheres und intuitiveres Erscheinungsbild bieten und ihre Gesamterfahrung verbessern.

- Erfahren Sie mehr über die neuesten hinzugefügten Funktionen, die zusätzliche Flexibilität und Kontrolle über Workflows bieten.

- Erfahren Sie mehr über Lakeflow Connect in Jobs, eine neue und zentralere Methode zur Aufnahme von Daten in Ihre Pipeline.

In den letzten Monaten haben wir spannende Updates für Lakeflow Jobs (früher bekannt als Databricks Workflows) eingeführt, um die Datenorchestrierung zu verbessern und die Workflow-Leistung zu optimieren.

Für Neulinge: Lakeflow Jobs ist der integrierte Orchestrator für Lakeflow, eine einheitliche und intelligente Lösung für Data Engineering mit optimierter ETL-Entwicklung und -Betrieb, basierend auf der Data Intelligence Platform. Lakeflow Jobs ist der vertrauenswürdigste Orchestrator für den Lakehouse- und Produktionsumgebungen mit über 14.600 Kunden, 187.000 wöchentlichen Nutzern und 100 Millionen wöchentlich ausgeführten Jobs.

Von UI-Verbesserungen bis hin zu fortschrittlicherer Workflow-Steuerung – entdecken Sie die neuesten Funktionen der nativen Datenorchestrierungslösung von Databricks und erfahren Sie, wie Data Engineers ihre End-to-End-Datenpipeline-Erfahrung optimieren können.

Überarbeitete Benutzeroberfläche für eine fokussiertere Benutzererfahrung

Wir haben unsere Benutzeroberfläche neu gestaltet, um Lakeflow Jobs ein frisches und modernes Aussehen zu verleihen. Das neue kompakte Layout ermöglicht eine intuitivere Orchestrierungsreise. Benutzer werden eine Aufgabenpalette genießen, die jetzt Verknüpfungen und eine Suchschaltfläche bietet, um ihnen zu helfen, ihre Aufgaben leichter zu finden und aufzurufen, sei es eine Lakeflow Pipeline, ein KI/BI-Dashboard, ein Notebook, SQL oder mehr.

Für die Überwachung können Kunden nun leicht Informationen über die Ausführungszeiten ihrer Jobs im rechten Bereich unter „Job- und Task-Ausführungsdetails“ finden. Dies ermöglicht ihnen, Verarbeitungszeiten einfach zu überwachen und Probleme in der Datenpipeline schnell zu identifizieren.

Wir haben auch die Seitenleiste verbessert, indem wir Benutzern die Wahl lassen, welche Abschnitte (Jobdetails, Zeitpläne & Trigger, Jobparameter usw.) ausgeblendet oder geöffnet bleiben sollen, wodurch ihre Orchestrierungs-Oberfläche übersichtlicher und relevanter wird.

Insgesamt können sich Benutzer von Lakeflow Jobs auf einen optimierten, fokussierten und vereinfachten Orchestrierungs-Workflow freuen. Das neue Layout ist derzeit für Benutzer verfügbar, die sich für die Vorschau angemeldet und den Schalter auf der Jobs-Seite aktiviert haben.

Kontrolliertere und effizientere Datenflüsse

Unser Orchestrator wird ständig mit neuen Funktionen erweitert. Das neueste Update führt erweiterte Steuerelemente für die Datenpipeline-Orchestrierung ein, die den Benutzern mehr Kontrolle über ihre Workflows für mehr Effizienz und optimierte Leistung geben.

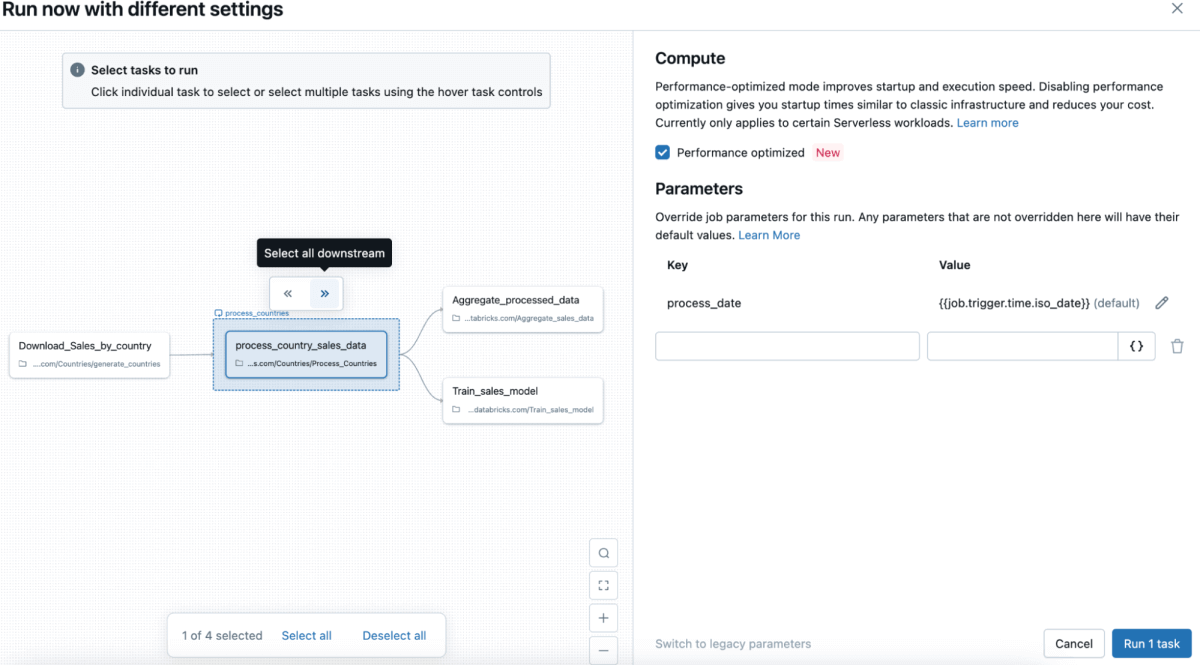

Teilweise Ausführungen ermöglichen es Benutzern, auszuwählen, welche Tasks ausgeführt werden sollen, ohne andere zu beeinträchtigen. Zuvor erforderte das Testen einzelner Tasks die Ausführung des gesamten Jobs, was rechenintensiv, langsam und kostspielig sein konnte. Jetzt können Benutzer auf der Seite „Jobs & Pipelines“ die Option „Jetzt mit anderen Einstellungen ausführen“ auswählen und bestimmte Tasks auswählen, die ohne Beeinträchtigung anderer ausgeführt werden sollen, wodurch Rechenverschwendung und hohe Kosten vermieden werden. Ebenso ermöglichen teilweise Reparaturen eine schnellere Fehlersuche, indem sie es Benutzern ermöglichen, einzelne fehlgeschlagene Tasks zu beheben, ohne den gesamten Job erneut ausführen zu müssen.

Mit mehr Kontrolle über ihre Ausführungs- und Reparaturflüsse können Kunden Entwicklungszyklen beschleunigen, die Job-Verfügbarkeit verbessern und Rechenkosten senken. Sowohl teilweise Ausführungen als auch Reparaturen sind in der Benutzeroberfläche und der Jobs API allgemein verfügbar.

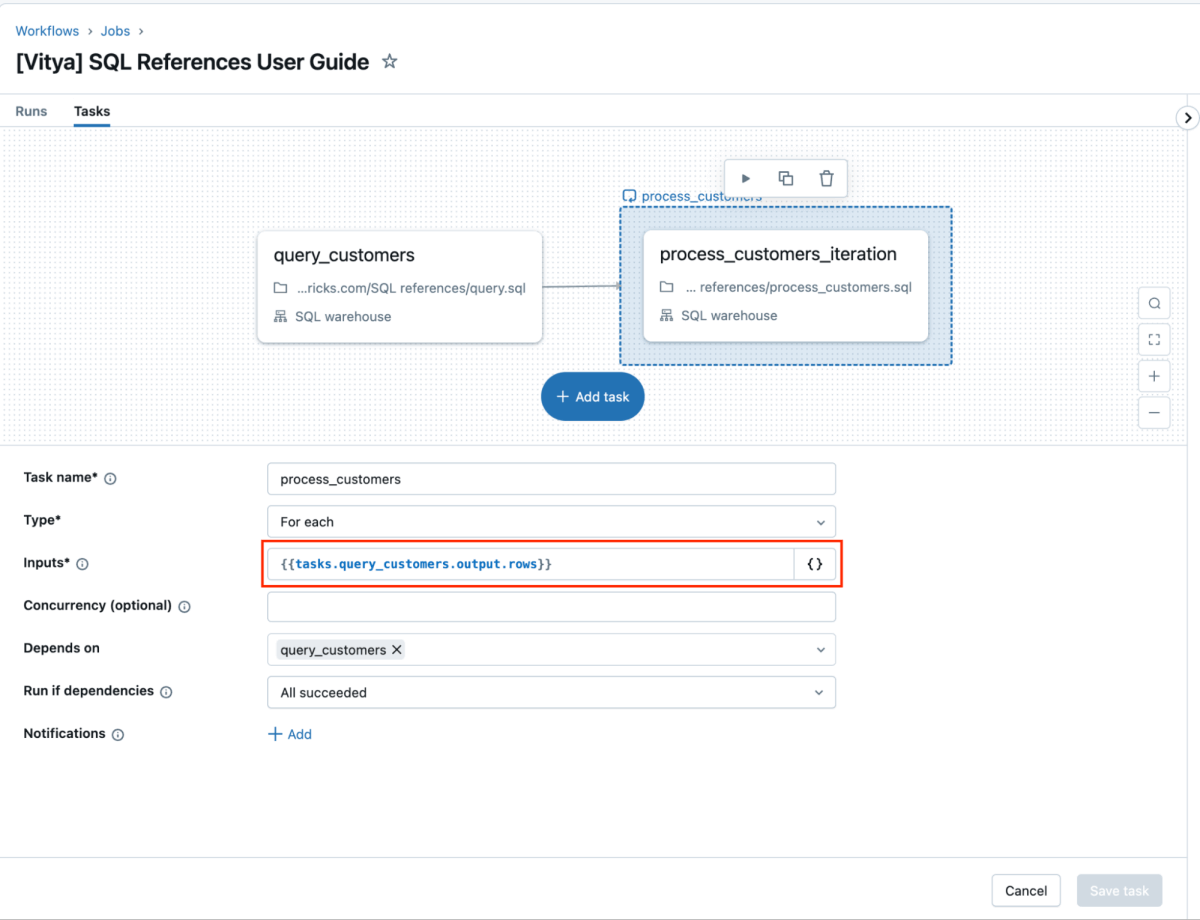

An alle SQL-Fans da draußen: Wir haben großartige Neuigkeiten für Sie! In dieser neuesten Update-Runde können Kunden SQL-Abfrageausgaben als Parameter in Lakeflow Jobs verwenden, um ihre Daten zu orchestrieren. Dies erleichtert SQL-Entwicklern die Übergabe von Parametern zwischen Tasks und den Austausch von Kontext innerhalb eines Jobs, was zu einer kohärenteren und einheitlicheren Datenpipeline-Orchestrierung führt. Diese Funktion ist ebenfalls jetzt allgemein verfügbar.

Schneller Einstieg mit Lakeflow Connect in Jobs

Zusätzlich zu diesen Verbesserungen machen wir es auch schnell und einfach, Daten in Lakeflow Jobs zu erfassen, indem wir Jobs enger mit Lakeflow Connect integrieren, der verwalteten und zuverlässigen Datenerfassungslösung von Databricks Lakeflow mit integrierten Konnektoren.

Kunden können bereits Lakeflow Connect-Erfassungspipelines orchestrieren, die von Lakeflow Connect ausgehen, unter Verwendung einer der vollständig verwalteten Konnektoren (z. B. Salesforce, Workday usw.) oder direkt aus Notebooks. Jetzt können Kunden mit Lakeflow Connect in Jobs einfach eine Erfassungspipeline direkt von zwei Einstiegspunkten in ihrer Jobs-Oberfläche erstellen, alles innerhalb einer Point-and-Click-Umgebung. Da die Datenerfassung oft der erste Schritt in ETL ist, ermöglicht diese neue nahtlose Integration mit Lakeflow Connect den Kunden, ihre Data Engineering-Erfahrung von Ende zu Ende zu konsolidieren und zu optimieren.

Lakeflow Connect in Jobs ist jetzt für Kunden allgemein verfügbar. Erfahren Sie mehr über diese und andere aktuelle Lakeflow Connect-Releases.

Eine einzige Orchestrierung für alle Ihre Workloads

Wir entwickeln Lakeflow Jobs kontinuierlich weiter, um unseren Kunden eine moderne und zentralisierte Orchestrierungs-Erfahrung für alle ihre Datenanforderungen im gesamten Unternehmen zu bieten. Es kommen weitere Funktionen für Jobs hinzu – wir werden bald eine Möglichkeit vorstellen, Jobs basierend auf Tabellenaktualisierungen auszulösen, Unterstützung für Systemtabellen anbieten und unsere Beobachtungsfähigkeiten erweitern, also bleiben Sie dran!

Für diejenigen, die mehr über Lakeflow Jobs erfahren möchten, schauen Sie sich unsere On-Demand-Sitzungen von unserem Data+AI Summit an und erkunden Sie Lakeflow in einer Vielzahl von Anwendungsfällen, Demos und mehr!

- Mehr über Lakeflow Jobs erfahren

- Erstellen Sie Ihren ersten Job mit unserer Schnellstartanleitung

- Aktivieren Sie die neue Benutzeroberfläche mit dem Schalter auf der Seite „Jobs & Pipelines“ (nur für Vorschaukunden)

- Konnten Sie nicht am Data+AI Summit teilnehmen? Sehen Sie sich Lakeflow Jobs-Sitzungen auf Abruf an

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.