Neues: Zerobus und weitere Ankündigungen verbessern die Datenaufnahme für Lakeflow Connect

Lakeflow Connect erweitert seine Abdeckung von Datenquellen und Zerobus führt eine High-Throughput-Direct-Write-API mit geringer Latenz ein

von Elise Georis, Peter Pogorski, Victoria Bukta und Giselle Goicochea

- Lakeflow Connect erweitert die Bandbreite der Datenquellen für die Datenaufnahme, einschließlich neuer abfragebasierter Konnektoren für Datenbanken.

- Zerobus ist eine direkte Schreib-API, die die Datenaufnahme für IoT, Clickstream, Telemetrie und ähnliche Anwendungsfälle vereinfacht.

- Lakeflow Connect in Jobs bietet eine nahtlose, intuitive Integration zwischen beiden Tools und hilft Benutzern, Zeit mit einer einheitlichen End-to-End-Erfahrung zu sparen.

Alles beginnt mit guten Daten, daher ist die Datenerfassung oft Ihr erster Schritt, um Erkenntnisse zu gewinnen. Die Datenerfassung birgt jedoch Herausforderungen, wie z. B. die Einarbeitung in die Komplexität jeder Datenquelle, die Überwachung dieser Quellen bei Änderungen und die durchgängige Verwaltung all dessen.

Lakeflow Connect erleichtert die effiziente Datenerfassung mit einer Point-and-Click-Benutzeroberfläche, einer einfachen API und tiefen Integrationen mit der Data Intelligence Platform. Letztes Jahr haben mehr als 2.000 Kunden Lakeflow Connect genutzt, um Werte aus ihren Daten zu schöpfen.

In diesem Blogbeitrag geben wir einen Überblick über die Grundlagen von Lakeflow Connect und fassen die neuesten Ankündigungen vom Data + AI Summit 2025 zusammen.

Erfassen Sie alle Ihre Daten an einem Ort mit Lakeflow Connect

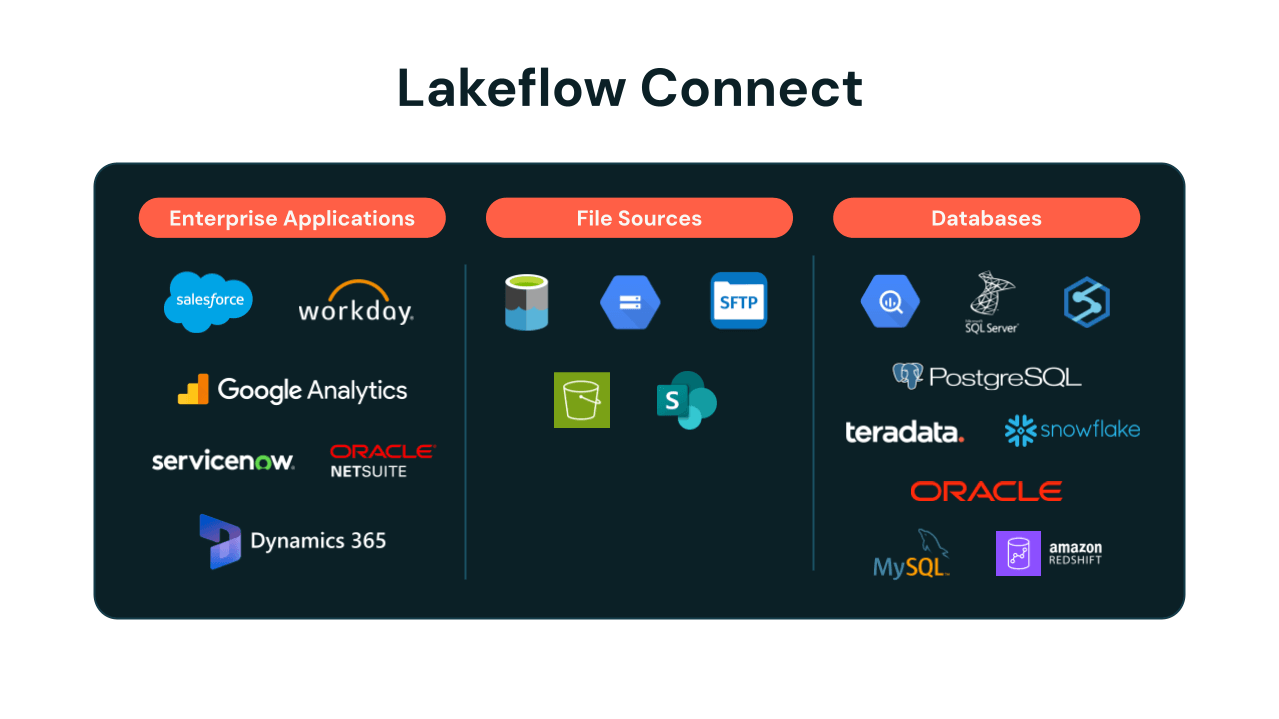

Lakeflow Connect bietet einfache Erfassungs-Konnektoren für Anwendungen, Datenbanken, Cloud-Speicher, Nachrichten-Busse und mehr. Unter der Haube ist die Datenerfassung effizient, mit inkrementellen Updates und optimierter API-Nutzung. Während Ihre verwalteten Pipelines laufen, kümmern wir uns um Schema-Entwicklung, nahtlose Upgrades von Drittanbieter-APIs und umfassende Beobachtbarkeit mit integrierten Benachrichtigungen.

Ankündigungen vom Data + AI Summit 2025

Auf dem diesjährigen Data + AI Summit kündigte Databricks die allgemeine Verfügbarkeit von Lakeflow an, dem einheitlichen Ansatz für Data Engineering über Datenerfassung, -transformation und -orchestrierung hinweg. Als Teil davon kündigte Lakeflow Connect Zerobus an, eine direkte Schreib-API, die die Datenerfassung für IoT, Clickstream, Telemetrie und ähnliche Anwendungsfälle vereinfacht. Wir haben auch die Bandbreite der unterstützten Datenquellen erweitert mit mehr integrierten Konnektoren für Unternehmensanwendungen, Dateiquellen, Datenbanken und Data Warehouses sowie Daten aus Cloud-Objektspeichern.

Zerobus: eine neue Methode, um Event-Daten direkt in Ihr Lakehouse zu pushen

Wir haben eine aufregende Ankündigung gemacht: Zerobus, ein neuer innovativer Ansatz zum direkten Pushen von Event-Daten in Ihr Lakehouse, der Sie näher an die Datenquelle bringt. Durch den Wegfall von Daten-Hops und die Reduzierung des operativen Aufwands ermöglicht Zerobus direkte Schreibvorgänge mit hohem Durchsatz und geringer Latenz, was eine nahezu Echtzeit-Performance im großen Maßstab liefert.

Zuvor nutzten einige Organisationen Nachrichten-Busse wie Kafka als Transportschichten zum Lakehouse. Kafka bietet eine robuste, latenzarme Möglichkeit für Datenproduzenten, Daten zu senden, und ist eine beliebte Wahl, wenn in mehrere Senken geschrieben wird. Es fügt jedoch zusätzliche Komplexität und Kosten hinzu, sowie den Aufwand, eine weitere Datenkopie zu verwalten – es ist also ineffizient, wenn Ihr einziges Ziel das Lakehouse ist. Zerobus bietet eine einfache Lösung für diese Fälle.

Joby Aviation nutzt Zerobus bereits, um Telemetriedaten direkt in Databricks zu pushen.

Joby kann unsere Fertigungsagenten mit Zerobus nutzen, um Gigabytes an Telemetriedaten pro Minute direkt in unser Lakehouse zu pushen, was die Zeit bis zu den Erkenntnissen beschleunigt – alles mit Databricks Lakeflow und der Data Intelligence Platform." — Dominik Müller, Factory Systems Lead, Joby Aviation, Inc.

Als Teil von Lakeflow Connect ist Zerobus auch mit der Databricks Platform vereinheitlicht, sodass Sie sofort breitere Analyse- und KI-Funktionen nutzen können. Zerobus befindet sich derzeit in der privaten Vorschau. Wenden Sie sich an Ihr Account-Team, um frühzeitigen Zugriff zu erhalten.

🎥 Sehen Sie sich an und erfahren Sie mehr über Zerobus: Breakout-Session auf dem Data + AI Summit mit Joby Aviation, „Lakeflow Connect: Hops in Ihrer Streaming-Architektur eliminieren“

Lakeflow Connect erweitert Erfassungsfunktionen und Datenquellen

Neue, vollständig verwaltete Konnektoren werden weiterhin über verschiedene Release-Zustände hinweg eingeführt (siehe vollständige Liste unten), darunter Google Analytics und ServiceNow sowie SQL Server – der erste Datenbank-Konnektor. Alle befinden sich derzeit in der öffentlichen Vorschau, die allgemeine Verfügbarkeit folgt in Kürze.

Wir haben auch weiterhin für Kunden innoviert, die mehr Anpassungsoptionen wünschen und unsere bestehende Erfassungslösung Auto Loader nutzen. Er verarbeitet inkrementell und effizient neue Datendateien, sobald sie im Cloud-Speicher eintreffen. Wir haben einige wichtige Kosten- und Leistungsverbesserungen für Auto Loader veröffentlicht, darunter 3x schnellere Verzeichnislisten und automatische Bereinigung mit „CleanSource“, die beide jetzt allgemein verfügbar sind, sowie intelligentere und kostengünstigere Dateierkennung mithilfe von Datei-Events. Wir haben auch native Unterstützung für die Erfassung von Excel-Dateien und die Erfassung von Daten von SFTP-Servern angekündigt, beide in der privaten Vorschau, verfügbar auf Anfrage für frühen Zugriff.

Unterstützte Datenquellen:

- Anwendungen: Salesforce, Workday, ServiceNow, Google Analytics, Microsoft Dynamics 365, Oracle NetSuite

- Dateiquellen: S3, ADLS, GCS, SFTP, SharePoint

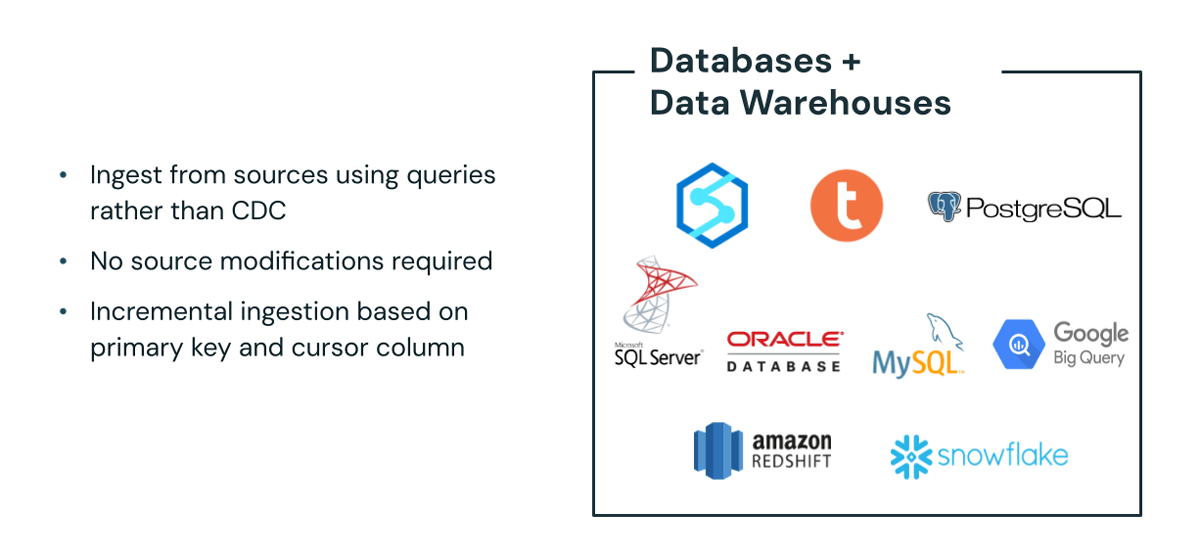

- Datenbanken: SQL Server, Oracle Database, MySQL, PostgreSQL

- Data Warehouses: Snowflake, Amazon Redshift, Google BigQuery

Innerhalb des erweiterten Konnektorangebots führen wir abfragebasierte Konnektoren ein, die die Datenerfassung vereinfachen. Diese neuen Konnektoren ermöglichen es Ihnen, Daten direkt aus Ihren Quellsystemen ohne Datenbankänderungen abzurufen und mit Read Replicas zu arbeiten, wenn Change Data Capture (CDC)-Protokolle nicht verfügbar sind. Dies befindet sich derzeit in der privaten Vorschau. Wenden Sie sich an Ihr Account-Team, um frühzeitigen Zugriff zu erhalten.

🎥 Sehen Sie sich an und erfahren Sie mehr über Lakeflow Connect: Breakout-Session auf dem Data + AI Summit, „Erste Schritte mit Lakeflow Connect“

🎥 Sehen Sie sich an und erfahren Sie mehr über die Erfassung aus Enterprise SaaS-Anwendungen: Breakout-Session auf dem Data + AI Summit mit Databricks-Kunde Porsche Holding, „Lakeflow Connect: Nahtlose Datenerfassung aus Unternehmensanwendungen“

🎥 Sehen Sie sich an und erfahren Sie mehr über Datenbank-Konnektoren: Breakout-Session auf dem Data + AI Summit, „Lakeflow Connect: Einfache, effiziente Erfassung aus Datenbanken“

Lakeflow Connect in Jobs, jetzt allgemein verfügbar

Wir entwickeln weiterhin Funktionen, um Ihnen die Nutzung unserer Erfassungs-Konnektoren beim Erstellen von Datenpipelines zu erleichtern, als Teil der einheitlichen Data-Engineering-Erfahrung von Lakeflow. Databricks hat kürzlich Lakeflow Connect in Jobs angekündigt, mit dem Sie Erfassungspipelines innerhalb von Lakeflow Jobs erstellen können. Wenn Jobs im Mittelpunkt Ihres ETL-Prozesses stehen, bietet diese nahtlose Integration eine intuitivere und einheitlichere Erfahrung für die Verwaltung der Datenerfassung.

Kunden können ihre End-to-End-Workloads – von der Erfassung bis zur Transformation – an einem Ort definieren und verwalten. Lakeflow Connect in Jobs ist jetzt allgemein verfügbar.

🎥 Schauen Sie sich die Breakout-Session auf dem Data + AI Summit an und erfahren Sie mehr über Lakeflow Jobs: „Orchestrierung mit Lakeflow Jobs“ „Orchestrierung mit Lakeflow Jobs“

Lakeflow Connect: Mehr kommt in 2025 und darüber hinaus

Databricks versteht die Bedürfnisse von Daten-Ingenieuren und Organisationen, die mit ihren Daten durch Analytik- und KI-Tools Innovationen vorantreiben. Zu diesem Zweck hat Lakeflow Connect robuste, effiziente Erfassungsfunktionen mit vollständig verwalteten Konnektoren für stärker anpassbare Funktionen und APIs weiter ausgebaut.

Wir fangen gerade erst mit Lakeflow Connect an. Bleiben Sie dran für weitere Ankündigungen später in diesem Jahr oder kontaktieren Sie Ihr Databricks Account Team, um an einer Vorschau für den frühen Zugriff teilzunehmen.

Um Lakeflow Connect auszuprobieren, können Sie die Dokumentation einsehen oder das Demo Center besuchen.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.