Databricks vs. Snowflake

Sparen Sie jedes Jahr mehr mit der Databricks Data Intelligence Platform

Vorteile

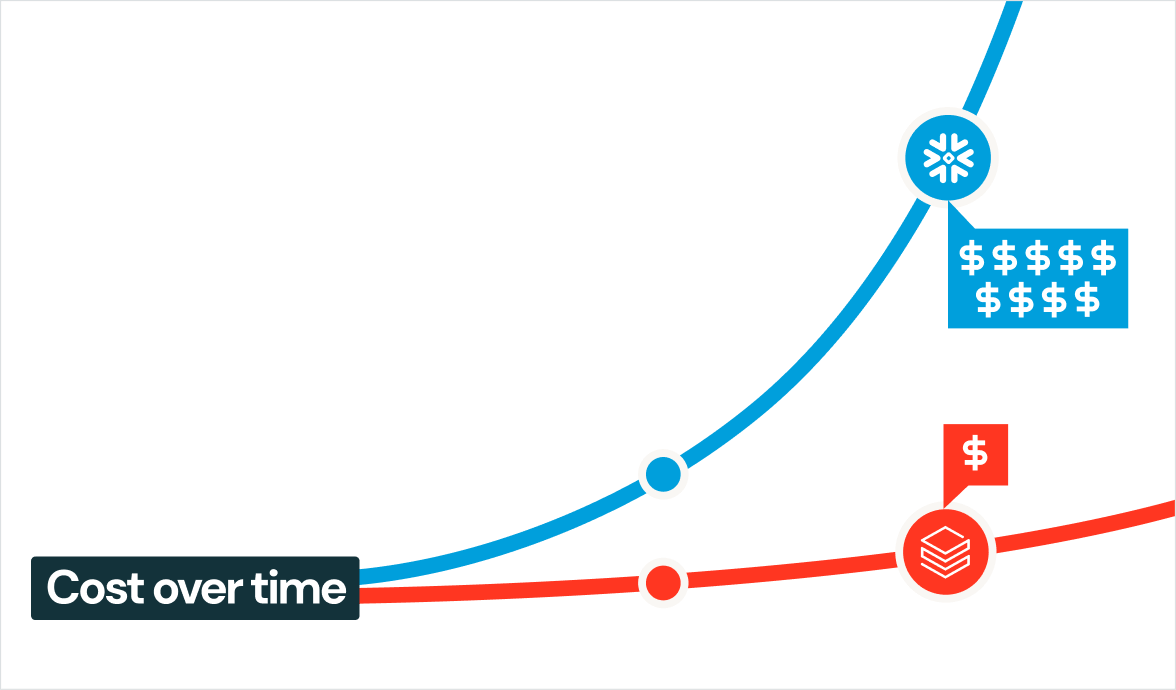

Geringere Gesamtbetriebskosten

Wählen Sie ein Cloud Data Warehouse für BI, ETL und KI/ML. ETL-Workloads machen in der Regel 50 % oder mehr der gesamten Datenkosten eines Unternehmens aus. Mit einer einzigen, vereinheitlichten Data Intelligence Platform und integrierten Funktionen für BI und Governance bietet Databricks einen hervorragenden Mehrwert und Einsparungen bei all diesen Anwendungsfällen.

Der schnelle Aufstieg von LLMs und anderen KI-Anwendungen zwingt Unternehmen zu prüfen, wie sie mit Databricks kosteneffizient skalieren können und die Leistung mit ihren Workloads skaliert. Wir bieten weiterhin marktführende TCO, was auch bei Skalierung gilt. Einen detaillierten Einblick in einen Databricks und Snowflake Performance Test erhalten Sie in diesem Video.

Der Databricks-Ansatz bietet Ihnen ultimative Flexibilität. Sie können wählen, ob ein Warehouse auf Geschwindigkeit oder Preis optimiert wird. Sie können sogar Ihre eigenen Cloud-Rabatte mitbringen, wenn Sie die Databricks SQL Classic-Version verwenden.

Zu den unterstützenden Funktionen gehören:

- Photon Engine für schnelle Abfragen und hohe Performance zu geringen Kosten

- Prädiktive Optimierung zur Optimierung von Tabellendatenlayouts, was zu schnelleren Abfragen und günstigerem Speicher führt

Kein Lock-in

Databricks basiert außerdem auf offenen Formaten, offenen Standards, Open Source, einem offenen Datenkatalog und Open Data Sharing. In Kombination mit der offenen Lakehouse-Architektur von Databricks entsteht keine Anbieterbindung für Ihre Daten. Sie können die Engine und das Format wählen, die für Sie am besten geeignet sind, und sind nicht an die Databricks-Compute-Ressourcen gebunden.

Der modulare Aufbau der Databricks-Plattform bedeutet auch, dass Sie beim Aufbau Ihrer eigenen Datenplattform nicht an jede Komponente gebunden sind. Sie können Anpassungen basierend auf Ihren spezifischen Geschäftsprioritäten und Unternehmensarchitekturen vornehmen.

Zu den unterstützenden Funktionen gehören:

- Volle Unterstützung für die Tabellenformate Delta und Apache Iceberg™

- ANSI-konformes SQL und Open Source in Apache Spark™

- Offenes Data Sharing mit Delta Sharing

- Prädiktive Optimierung für alle Engines

- Einheitliche Governance für Data Warehousing, BI und KI/ML in einem offenen Datenkatalog mit Unity Catalog

- KI-Funktionen, mit denen Sie Foundation-KI-Modelle direkt in Ihrem Data Warehouse nutzen können

- Leistungsisolation, sodass Verbraucher Daten über ihre eigene compute (SQL Warehouse oder Cluster) abfragen können, wodurch Konflikte mit Produzenten vermieden werden

Zero-Copy

Der Zero-Copy-Datenzugriff mit Unity Catalog beseitigt den traditionellen Kompromiss zwischen Kontrolle und Zusammenarbeit. Anstatt Daten über Warehouses, Regionen oder Teams hinweg zu duplizieren, definieren Organisationen einmalig Zugriffsrichtlinien und geben sichere Ansichten vertrauenswürdiger Daten überall dort frei, wo sie benötigt werden. Mit dieser Funktion können Sie die Entwicklung einer zentralisierten Metrikplattform ermöglichen, die viele Dashboarding-Anwendungsfälle über verschiedene Geschäftsbereiche (LOBs) hinweg bedient – alles aus einer einzigen, kontrollierten Quelle. Dies hilft Ihnen auch dabei, redundante BI-Pipelines zu reduzieren, indem Sie kontrollierte Datensätze direkt über Unity Catalog freigeben, was es den Geschäftsteams ermöglicht, Self-Service-Analysen durchzuführen, ohne Kopien pflegen zu müssen. Das Zero-Copy-Modell vereinfacht die Governance, stellt die Konsistenz sicher und reduziert die Kosten und die Komplexität des unternehmensweiten Datenaustauschs drastisch.

Zu den unterstützenden Funktionen gehören:

- Zentralisierte Governance mit Unity Catalog, um gemeinsam genutzte Daten auf einer einzigen Plattform zentral zu verwalten, zu steuern, zu prüfen und nachzuverfolgen

- Workspace- und regionenübergreifende Freigabe mit Lesezugriff auf Delta Lake-Tabellen

- Föderierte Zugriffssteuerung mit Unity Catalog zur Aufrechterhaltung der Trennung zwischen Produzent und Konsument

- Unterstützung für BI-Tools und SQL-Warehouses, sodass freigegebene Daten direkt über Databricks Lakehouse, Power BI, Tableau und andere Tools abgefragt werden können – ohne Extrakte oder Importe

- Native Delta Sharing -Integration zum Teilen verwalteter Daten über Clouds oder mit externen Partnern hinweg

- Effizientes Laden von Daten ohne Datenduplizierung, da die Daten in der nativen Cloud verbleiben

- Kosteneffizienz durch die Beseitigung doppelter Speicherung und die Reduzierung der Verschwendung von compute durch die Zentralisierung der Logik und die Minimierung der Datenbewegung

Einheitliche Governance

Sorgen Sie für eine unübertroffene Governance, indem Sie einen einzigen Katalog für alle Formate und Anwendungsfälle verwenden. Databricks vereinheitlicht die Governance mit Unity Catalog, der branchenweit einzigen einheitlichen und offenen Governance-Lösung für Daten und KI. Sie ermöglicht Data Scientists, Analysten und Engineers, vertrauenswürdige Daten und KI-Assets sicher zu entdecken, darauf zuzugreifen und daran zusammenzuarbeiten, was die Produktivität steigert und die Compliance gewährleistet.

Unity Catalog verbessert die Interoperabilität und vereinfacht Datenmanagementprozesse für Organisationen, die verschiedene Datasets und Modelle über verschiedene Umgebungen hinweg integrieren, einschließlich Cloud-Plattformen und externer Datenbanken.

Mit von Unity Catalog verwalteten Tabellen können Sie auch Abfragen um das bis zu 20-fache beschleunigen. Dies wird durch Features wie intelligentes Data Skipping und In-Memory-Caching von Transaktionsmetadaten ermöglicht, die die Performance der Abfrageplanung erheblich verbessern. Mit verwalteten Tabellen können Sie die Performance steigern und die Kosten um über 50 % senken, da sie Prozesse wie Clustering und die Erfassung von Statistiken automatisieren und dadurch den manuellen Aufwand und die Speicherkosten reduzieren.

Zu den unterstützenden Funktionen gehören:

- Einheitliche Governance über alle Plattformen hinweg mit einem einzigen Katalog

- Zugriffsverwaltung und Sicherheit

- Datenherkunft für eine umfassende Übersicht, wie Daten transformiert werden und fließen

- Erkennung und Beobachtbarkeit

- Offener Datenzugriff

- Interoperabilität und Zusammenarbeit

Intelligente Analytik für alle

Datenarchitekten und Datenanalysten müssen schnell an Informationen gelangen. Mit Databricks können Sie Erkenntnisse aus all Ihren Daten auf einer einzigen Plattform gewinnen – ohne dass Sie Daten replizieren oder Zugriffsrichtlinien über mehrere Plattformen hinweg verwalten müssen. AI/BI ist nativ in Databricks integriert und mit Databricks SQL und Unity Catalog vereinheitlicht. Es müssen keine separaten Lizenzen beschafft oder Shadow Data Warehouses verwaltet werden. Jetzt können Sie Business Intelligence mit Data Intelligence erleben. Die Agenten, die AI/BI steuern, verfügen über tiefgreifende Kenntnisse Ihrer Unternehmensdaten und Ihrer Geschäftssemantik. So wird sichergestellt, dass Sie genaue und auf Ihr Unternehmen zugeschnittene Antworten auf Fragen in natürlicher Sprache erhalten. Ihre Datenanalysten verfügen jetzt auch über intelligentere Self-Service-Funktionen. Über eine dialogorientierte Benutzeroberfläche liefert AI/BI Genie den Benutzern Antworten auf Fragen in natürlicher Sprache und verringert gleichzeitig ihre Abhängigkeit von Fachexperten.

Mit Streaming-Daten werden Ihre Echtzeit-Einblicke jetzt ganz einfach, sodass Sie die Genauigkeit und Umsetzbarkeit Ihrer Business Intelligence sofort verbessern können. Sie können Datensätze auch nahtlos direkt in Ihren bevorzugten BI-Tools (Power BI, Tableau, Looker, Excel, Google Sheets, Sigma, Qlick, ThoughtSpot und mehr) veröffentlichen, ohne ODBC/JDBC-Verbindungen verwalten zu müssen.

Zu den unterstützenden Funktionen gehören:

- KI/BI-Dashboards für KI-gestützte visuelle Einblicke

- AI/BI Genie, um Datenfragen in natürlicher Sprache zu stellen

- Streaming-Datenpipelines mit Lakeflow Spark Declarative Pipelines

- Integrierte BI-Tools, sodass Sie direkt aus Ihrem Data Warehouse in ihnen veröffentlichen können

- Geringe Latenz zur Verwaltung inkrementeller Daten refresh

Erweiterte KI/ML

Data Engineers und Data Scientists müssen Hand in Hand arbeiten, damit die richtigen Daten für die richtigen Modelle ordnungsgemäß aufbereitet werden. Databricks bietet eine einheitliche Plattform für Data Engineering und maschinelles Lernen, die eine Vielzahl von Datentypen (einschließlich unstrukturierter Daten) und Echtzeitverarbeitung unterstützt. Databricks hilft Ihnen auch dabei, eine Vielzahl von KI-Modellen zu nutzen, und bietet kostengünstige Inferenzlösungen.

Zu den unterstützenden Funktionen gehören:

- MLflow

- Echtzeit-KI-Inferenz -Anwendungsfälle

- Ausführen von verteilten KI/ML-Workloads und Notebooks

- LLMOps -Features zur Evaluierung und zum Monitoring von GenAI-Anwendungsfällen

Betriebs- und Analysedaten gemeinsam

Databricks Lakebase hilft, die Fragmentierung von operativen und analytischen Daten zu beheben, indem eine operative Datenbank eingeführt wird, die parallel zu Ihren bestehenden Analyse-Workflows in der Databricks Data Intelligence Platform ausgeführt wird. Lakebase basiert auf Open Source PostgreSQL mit getrennten Rechen- und Speicherressourcen und bietet vollständig verwaltete Transaktionsfunktionen, einschließlich Inserts, Updates und Deletes mit niedriger Latenz und schnellen Punktabfragen, und ist in Delta Lake und Unity Catalog integriert. Dies ermöglicht die skalierbare Ausführung von Echtzeitanwendungen parallel zu Dashboards und ML-Modellen ohne Datenduplizierung.

Lakebase modernisiert Transaktions-Workloads für das KI-Zeitalter, indem es die Latenz und den Betriebsaufwand bei der Synchronisierung von OLTP-Daten (Online-Transaktionsverarbeitung) mit dem Data Warehouse eliminiert. Teams können Apps, APIs und Echtzeit-Entscheidungsengines mit denselben verwalteten Datensätzen betreiben, denen Business Analysten und Data Scientists vertrauen. Dies ist ein grundlegender Wandel in der modernen Datenlandschaft.

Lakebase hilft bei der Vereinheitlichung von operativen und analytischen Anwendungsfällen, indem die Reibung zwischen Datenbanken und dem Lakehouse minimiert wird. Mit nativer Unterstützung für die Synchronisierung von Delta-Tabellen von und zu Lakebase können Teams Anwendungen erstellen, die mit denselben Datensätzen interagieren, die für Analysen und KI verwendet werden, ohne auf benutzerdefinierte Reverse-ETL-Pipelines angewiesen zu sein.

Perspektiven von führenden Systemintegratoren

Migrationsleitfaden von Snowflake zu Databricks

Die Implementierung von Machine Learning auf Snowflake erfordert die Verwaltung und den Betrieb zusätzlicher Tools, wenn Sie über einfache KI/ML-Anwendungsfälle hinausgehen. Im Laufe der Zeit wird Ihre Architektur komplexer werden. Die ETL-Kosten werden ebenfalls steigen. Mit der Databricks Data Intelligence Platform erhalten Sie dagegen eine leistungsstarke und wirtschaftliche ETL-Lösung mit nativer KI-Unterstützung.

Download this Migrationsleitfaden, um Folgendes zu erfahren:

- Fünf kritische Phasen Ihres Migrationsprojekts

- Best Practices zur Skalierung Ihres Lakehouse

- Ressourcen für Ihre Migrationsreise