GenAI-Architekturmuster

Generative KI in Produktionsqualität für jedes Architekturmuster erstellen

Entwickeln Sie jetzt Ihre GenAI-Lösung

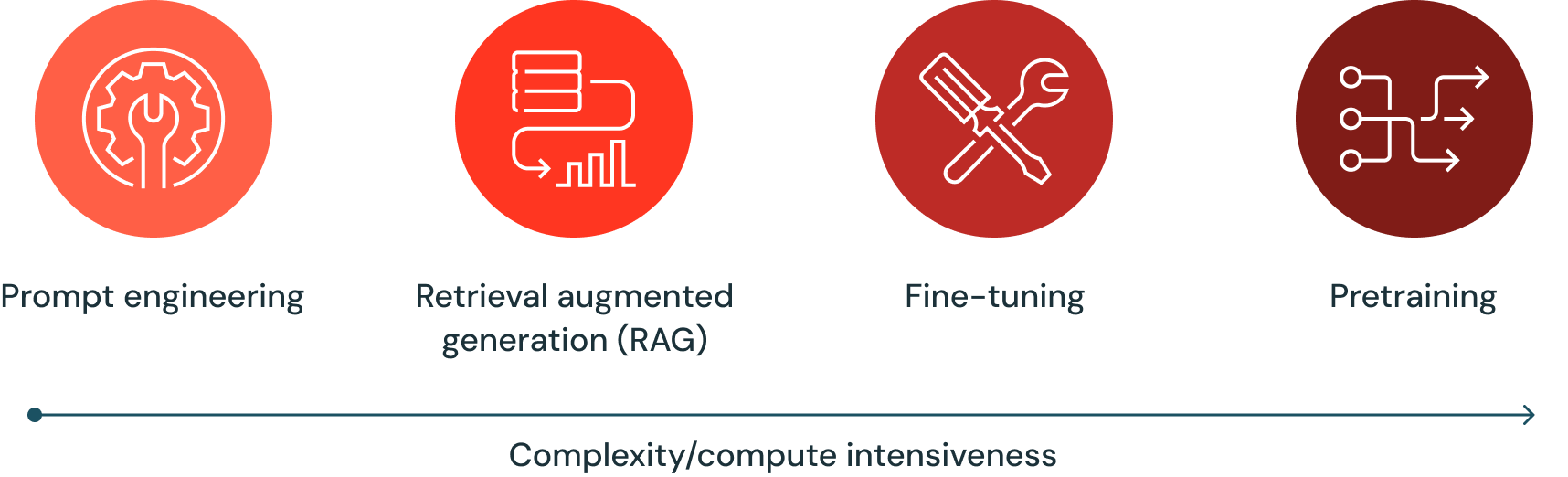

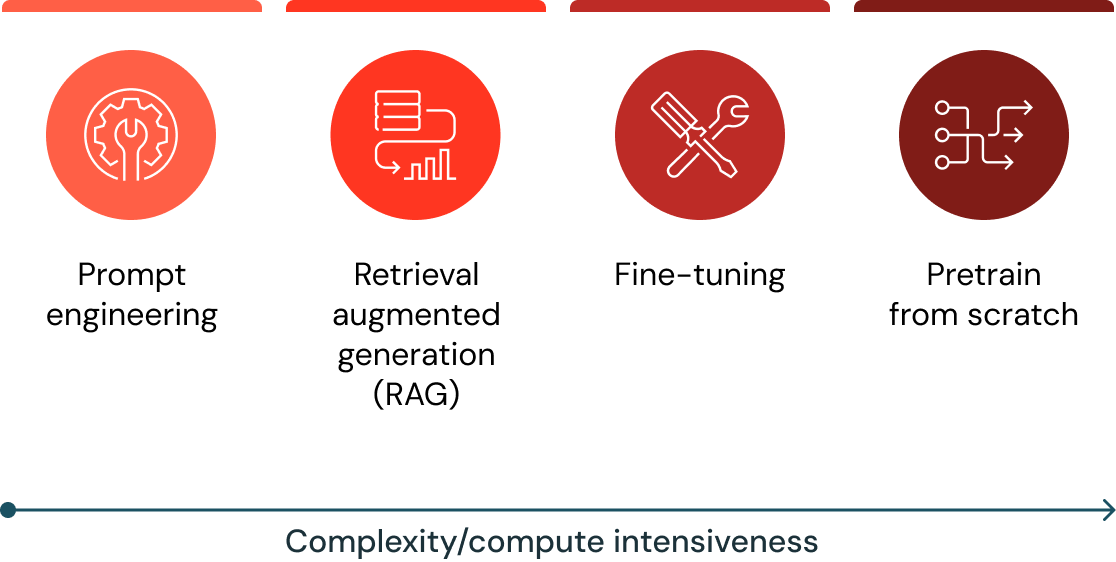

Beim Erstellen einer LLM-Lösung (Large Language Model) sind vier Architekturmuster zu berücksichtigen.

Databricks ist der einzige Anbieter, mit dem Sie kostengünstig hochwertige Lösungen für alle vier GenAI-Architekturmuster erstellen können:

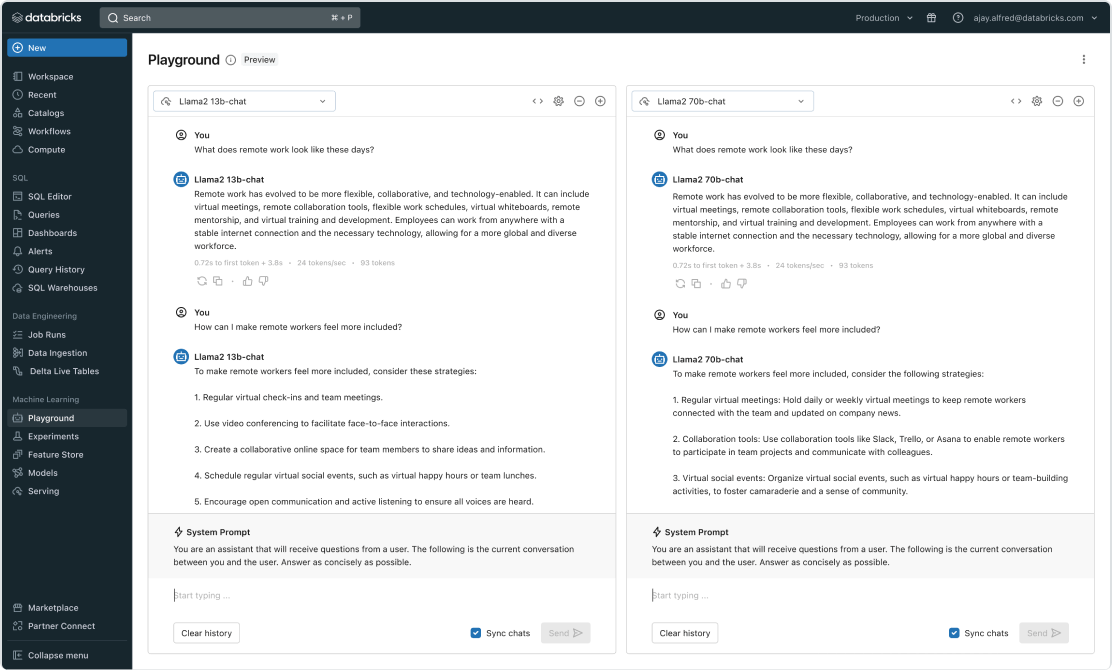

Prompt Engineering

Als „Prompt Engineering“ bezeichnet man die Anpassung von Prompts, um bessere Antworten zu erhalten, ohne das zugrunde liegende Modell zu ändern. Das Prompt Engineering ist in Databricks ganz unkompliziert: Sie suchen auf dem Marketplace nach verfügbaren Modellen (einschließlich beliebter Open-Source-Modelle wie Llama 2 und MPT), stellen Modelle hinter einem Endpoint in Model Serving bereit und werten Prompts auf einer benutzerfreundlichen Oberfläche mit Playground oder MLflow aus.

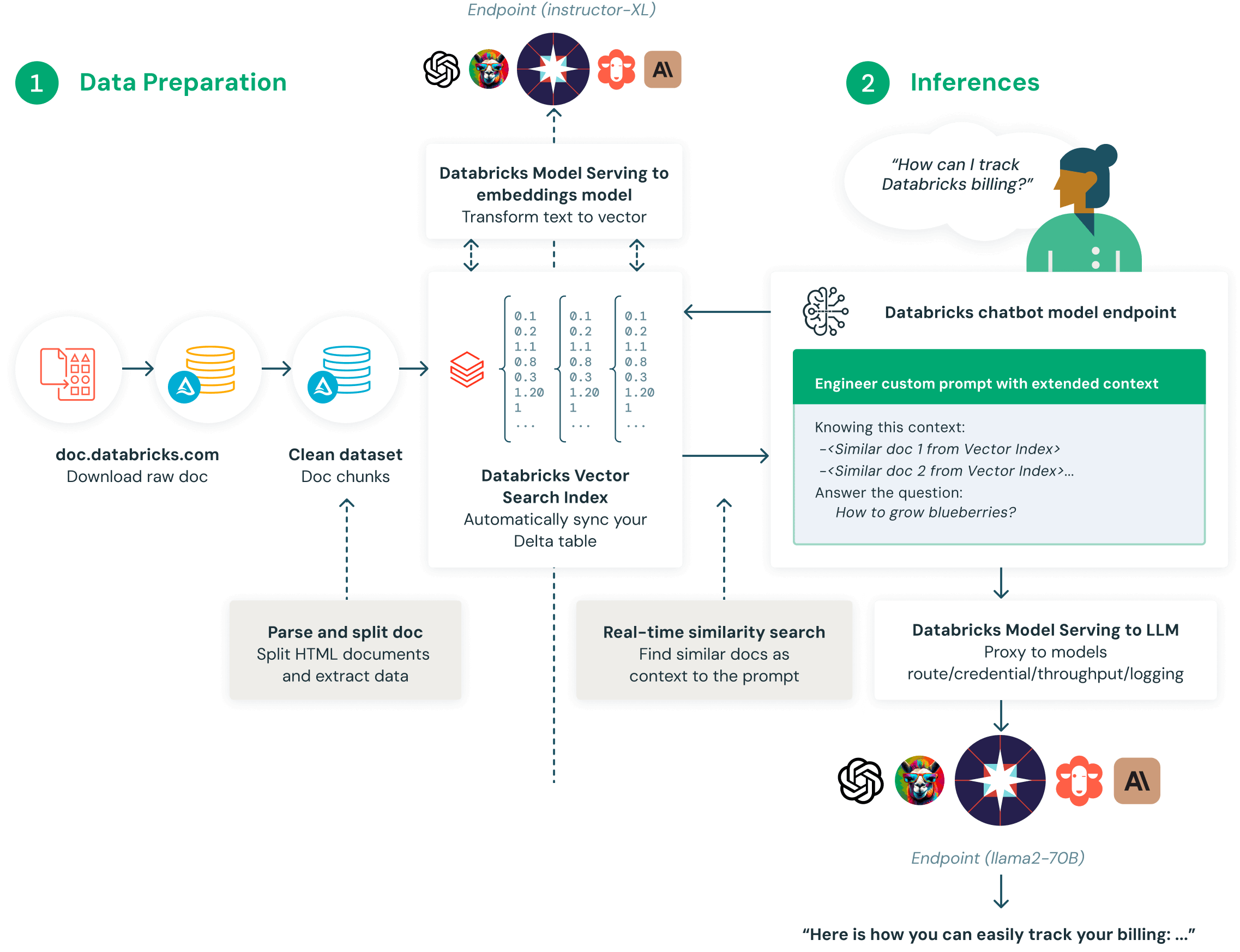

Retrieval Augmented Generation (RAG)

RAG findet Daten und/oder Dokumente, die für eine Frage oder Task relevant sind, und stellt sie als Kontext für das LLM bereit, um Antworten höherer Relevanz zu geben.

Databricks bietet eine Palette von RAG-Tools an, mit denen Sie alle Aspekte des RAG-Prozesses kombinieren und optimieren können, z. B. Datenaufbereitung, Abfragemodelle, Sprachmodelle (SaaS oder Open Source), Ranking- und Nachbearbeitungspipelines, Prompt Engineering und Training von Modellen mit eigenen Unternehmensdaten.

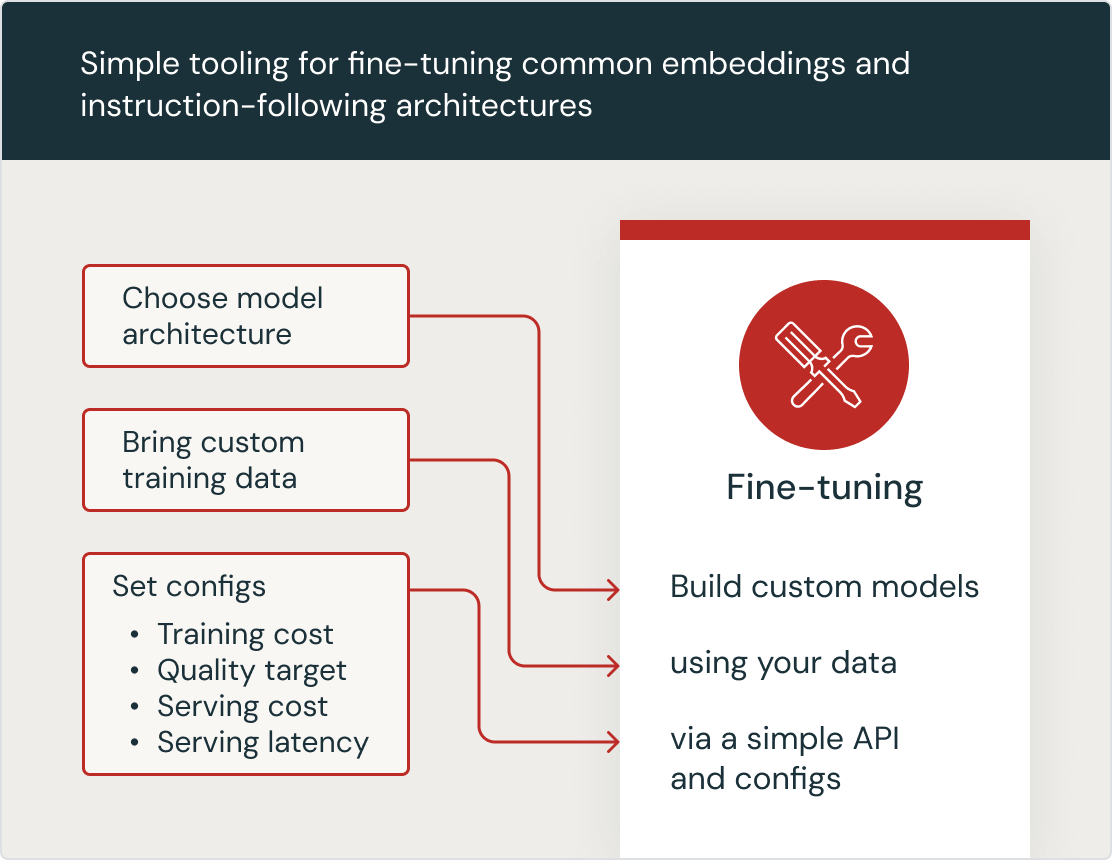

Fine-Tuning

Beim Fine-Tuning wird ein bestehendes LLM-Universalmodell angepasst. Hierzu wird das Modell unter Verwendung des geistigen Eigentums Ihres Unternehmens mit Ihren Daten zusätzlich trainiert. Mit Fine-Tuning von Databricks können Sie dies ganz bequem tun: Legen Sie mit Ihrem bevorzugten LLM-Modell los – beispielsweise einem von Databricks kuratierten Modell wie MPT-30B, Llama 2 oder BGE – und trainieren Sie dieses dann mit neuen Datasets weiter.

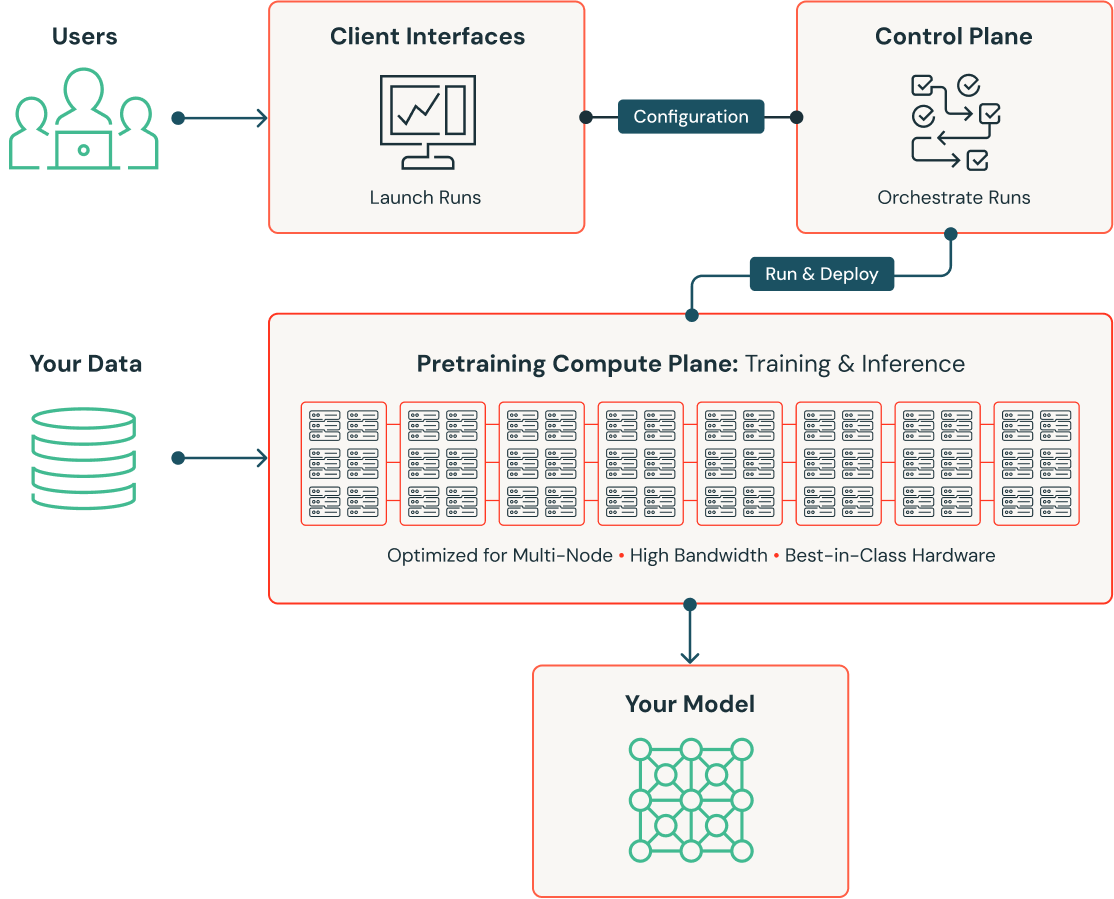

Pre-Training

Unter dem Begriff „Pre-Training“ versteht man die Erstellung eines neuen LLM-Modells von Grund auf. Damit soll sichergestellt werden, dass das grundlegende Wissen des Modells auf Ihr ganz spezielles Fachgebiet zugeschnitten ist. Durch Trainieren mit Ihrem geistigen Eigentum unter Verwendung Ihrer Daten entsteht ein maßgeschneidertes Modell, das sich grundlegend von anderen Modellen unterscheidet. Databricks Mosaic AI Pretraining ist eine optimierte Trainingslösung, mit der neue LLMs mit mehreren Milliarden Parametern in nur wenigen Tagen und mit bis zu zehnfach niedrigeren Trainingskosten erstellt werden können.

Auswählen des geeignetsten Musters

Diese Architekturmuster schließen sich nicht gegenseitig aus. Vielmehr können (und sollten) sie in verschiedenen GenAI-Implementierungen kombiniert werden, um die Stärken des jeweiligen Modells zu nutzen. Databricks ist der einzige Anbieter, der alle vier GenAI-Architekturmuster unterstützt. Damit haben Sie die meisten Optionen und können sich entsprechend Ihren geschäftlichen Anforderungen weiterentwickeln.